Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Faut-il vraiment prévenir Google lors d'une refonte de site ?

- □ Google détecte-t-il vraiment le format WEBP par l'en-tête HTTP plutôt que par l'extension du fichier ?

- □ Comment Google évalue-t-il vraiment la proéminence d'une vidéo sur une page ?

- □ Le contenu dupliqué multilingue pénalise-t-il vraiment votre référencement international ?

- □ Faut-il préférer un ccTLD au .com pour cibler un marché local ?

- □ Pourquoi Google insiste-t-il pour isoler les migrations de site de toute autre refonte ?

- □ Hreflang : faut-il regrouper toutes les annotations dans un seul sitemap ou les séparer par langue ?

- □ Google propose-t-il un bouton pour réindexer massivement un site après refonte ?

- □ Strong vs Bold : Google fait-il vraiment la différence entre ces deux balises ?

- □ Le LCP ne mesure-t-il vraiment que le viewport visible au chargement ?

- □ Le sitemap XML est-il vraiment indispensable pour être indexé par Google ?

- □ Faut-il utiliser hreflang 'de' ou 'de-de' pour cibler les germanophones ?

- □ Google réessaie-t-il vraiment d'indexer vos pages après une erreur 401 ou serveur down ?

- □ Faut-il vraiment imbriquer ses données structurées pour indiquer le focus principal d'une page ?

- □ Faut-il vraiment privilégier l'attribut alt plutôt que l'OCR pour le texte dans les images ?

- □ Pourquoi le scroll infini pénalise-t-il l'indexation de vos pages e-commerce ?

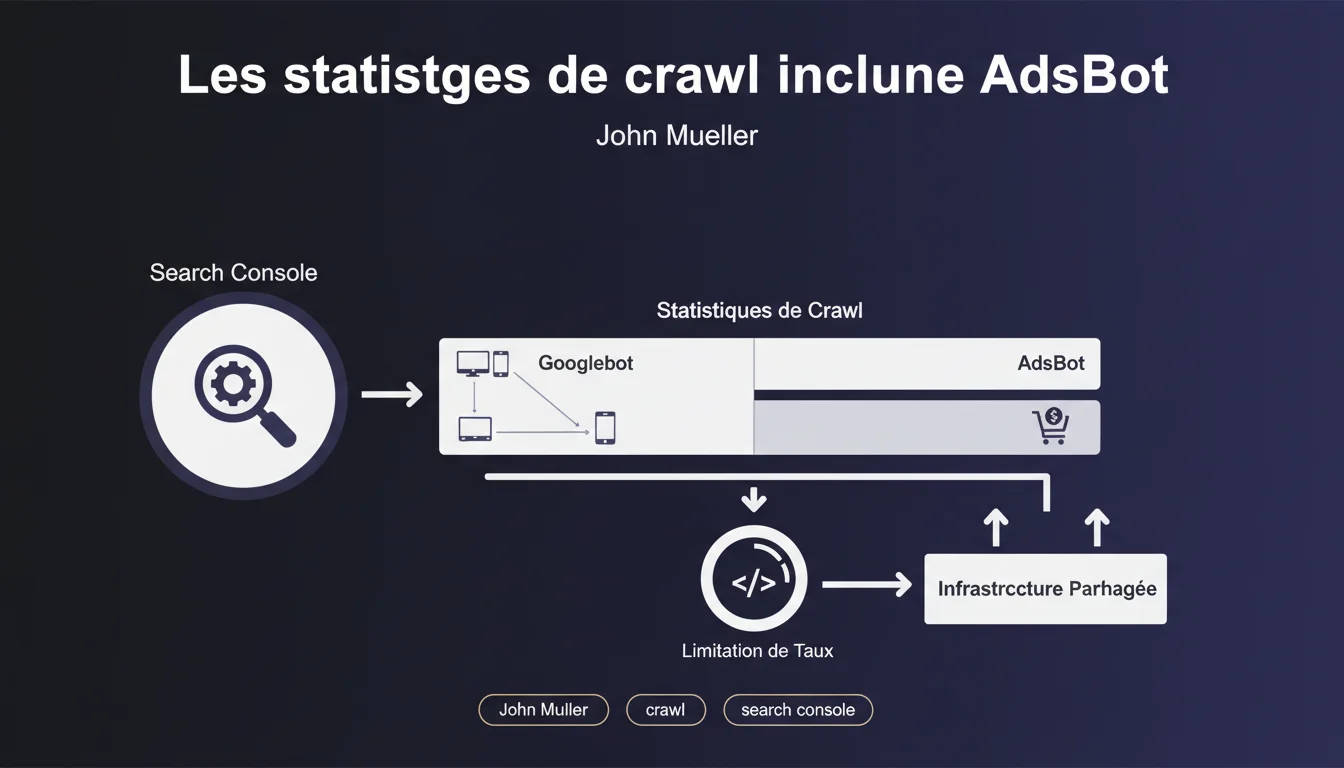

Les stats de crawl dans Search Console intègrent aussi AdsBot, qui partage l'infrastructure de Googlebot et subit les mêmes limitations de taux. Il apparaît distinct dans les types de Googlebot, mais consomme du budget de crawl commun. Concrètement : votre crawl budget n'est pas réservé qu'aux URLs organiques.

Ce qu'il faut comprendre

AdsBot et Googlebot partagent-ils réellement la même infrastructure ?

Oui, et c'est là que ça coince. AdsBot utilise exactement la même infrastructure technique que Googlebot pour crawler votre site. Ça signifie qu'il passe par les mêmes serveurs, respecte les mêmes règles de limitation de charge, et compte dans les mêmes métriques de crawl.

La nuance importante : Search Console affiche AdsBot séparément dans la section des types de Googlebot, ce qui peut créer une illusion d'indépendance. En réalité, les deux partagent le même pool de ressources allouées à votre site.

Qu'est-ce que ça change concrètement pour mon crawl budget ?

Votre crawl budget n'est pas un sac infini. Si AdsBot pompe 20% de vos crawls quotidiens pour vérifier des landing pages publicitaires, c'est autant de moins pour explorer vos nouvelles pages produits ou actualités.

Le problème se pose surtout sur les sites de taille moyenne avec des campagnes Google Ads actives : AdsBot peut crawler agressivement des centaines d'URLs publicitaires, parfois plus fréquemment que Googlebot standard ne visite vos contenus stratégiques.

Comment identifier l'impact d'AdsBot dans mes statistiques ?

Dans Search Console, section Paramètres > Statistiques d'exploration, vous pouvez filtrer par type de Googlebot. AdsBot y apparaît comme une catégorie distincte avec son propre volume de requêtes.

Comparez le ratio AdsBot/Googlebot classique. Si AdsBot représente plus de 15-20% de votre crawl total sur un site non e-commerce massif, vous avez probablement une campagne Ads mal optimisée qui génère du crawl inutile.

- Infrastructure partagée : AdsBot et Googlebot utilisent les mêmes ressources techniques

- Limitation commune : les mécanismes de taux de crawl s'appliquent globalement aux deux bots

- Visibilité séparée : Search Console distingue AdsBot dans les rapports mais il consomme le même budget

- Impact variable : dépend fortement du volume et de la structure de vos campagnes Google Ads

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, mais avec un bémol de taille. Sur les sites que je suis depuis des années, on constate effectivement des pics de crawl AdsBot corrélés aux lancements de campagnes. Ça valide la déclaration de Mueller.

Là où ça devient flou : [A vérifier] Google ne précise jamais le ratio de partage du crawl budget entre AdsBot et Googlebot classique. Sur certains sites e-commerce, j'ai vu AdsBot représenter jusqu'à 35% du crawl total pendant des semaines — difficile de croire que ça n'impacte pas l'indexation organique.

Quelles nuances faut-il apporter à cette affirmation ?

Le diable est dans les détails. Mueller dit « limité par les mêmes mécanismes de taux de crawl », mais ne dit pas si AdsBot a une priorité différente dans l'allocation de ce budget partagé.

Concrètement ? J'ai observé des situations où AdsBot crawlait des landing pages Ads plusieurs fois par jour alors que des pages produits organiques importantes restaient visitées une fois par semaine. Si les mécanismes sont vraiment identiques, pourquoi cette différence de fréquence ?

[A vérifier] Hypothèse : AdsBot pourrait avoir un système de priorité interne lié à la dépense publicitaire, ce qui expliquerait pourquoi certains sites Ads-intensifs voient leur crawl organique ralentir.

Dans quels cas cette règle devient-elle problématique ?

Trois scénarios où le partage d'infrastructure pose problème :

Sites avec crawl budget serré (actualités, marketplaces) : chaque requête AdsBot vers une landing page temporaire est une URL stratégique non crawlée. Sur un site d'événements avec 10 000 pages et un budget de 500 crawls/jour, 100 crawls AdsBot = 20% de capacité perdue.

Campagnes Ads mal structurées : des centaines d'URLs de destination uniques générées dynamiquement (paramètres UTM dans l'URL finale, variations infinies) créent un gouffre de crawl. AdsBot va tenter de toutes les explorer.

Impact pratique et recommandations

Que faut-il faire concrètement pour limiter l'impact d'AdsBot ?

Première action : auditez vos URLs de destination Google Ads. Ouvrez votre compte Ads, extrayez toutes les URLs finales de vos campagnes actives. Comptez les variations uniques. Si vous avez 50 campagnes pointant vers 500 URLs différentes, c'est 500 URLs qu'AdsBot va crawler régulièrement.

Rationalisez. Utilisez des landing pages génériques avec paramètres UTM au lieu de créer des URLs uniques par campagne. Configurez Search Console pour ignorer ces paramètres de tracking dans les statistiques.

Quelles erreurs éviter absolument ?

Ne bloquez jamais AdsBot dans le robots.txt. Soyons honnêtes : ça tuerait vos campagnes Google Ads. Google a besoin de vérifier que vos pages respectent les politiques publicitaires.

Évitez aussi de créer des URLs de destination en masse via des outils qui génèrent des variantes infinies (langue x région x produit x promo). Chaque URL = un crawl AdsBot potentiel. Sur un site multilingue, privilégiez la détection automatique de langue côté serveur plutôt que des URLs distinctes.

Comment vérifier que votre configuration est optimale ?

Monitoring hebdomadaire dans Search Console : regardez l'évolution du ratio requêtes AdsBot / requêtes Googlebot total. Si ce ratio augmente sans que votre budget Ads n'explose, c'est un signal d'alerte.

Croisez avec vos logs serveur. Comparez les URLs crawlées par AdsBot versus celles de vos campagnes actives. Si AdsBot crawle des URLs que vous n'utilisez plus en Ads depuis des semaines, c'est qu'il reste des redirections ou des liens orphelins à nettoyer.

- Centraliser les URLs de destination Ads sur un nombre limité de landing pages génériques

- Configurer les paramètres UTM dans Search Console pour les exclure des statistiques de performance

- Monitorer mensuellement le ratio AdsBot/Googlebot dans les stats d'exploration

- Nettoyer les anciennes URLs de campagnes inactives qui génèrent encore du crawl AdsBot

- Vérifier dans les logs serveur que AdsBot ne crawle pas des centaines de variantes d'URL inutiles

- Éviter les paramètres dynamiques dans les URLs finales Google Ads (privilégier ValueTrack)

❓ Questions frequentes

AdsBot consomme-t-il vraiment du crawl budget destiné au SEO ?

Peut-on bloquer AdsBot pour préserver le crawl budget SEO ?

Comment savoir si AdsBot impacte négativement mon site ?

Les paramètres UTM dans les URLs Ads génèrent-ils du crawl supplémentaire ?

AdsBot a-t-il une priorité différente de Googlebot dans l'allocation du crawl ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.