Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- 5:33 Peut-on vraiment contrôler quelle image apparaît dans les résultats de recherche texte ?

- 7:30 Pourquoi vos rapports Search Console se contredisent-ils constamment ?

- 8:40 Faut-il vraiment uploader sa liste de désaveu uniquement sur le domaine actuel ?

- 10:06 Pourquoi Google classe-t-il vos pages internes au-dessus de votre page catégorie ?

- 11:21 Pourquoi le test d'URL publique échoue-t-il si souvent dans Search Console ?

- 13:33 Pourquoi Google privilégie-t-il la qualité du contenu sur la technique face au statut 'Crawlé - non indexé' ?

- 15:15 Est-ce que des pages « Crawlé - non indexé » pénalisent tout votre site ?

- 18:55 Comment Google interprète-t-il réellement l'intention derrière vos requêtes ?

- 21:21 Les URLs simples influencent-elles vraiment le classement Google ?

- 22:22 Pourquoi Google peut-il ignorer votre JavaScript si vous placez un noindex dans le head ?

- 24:24 Les iframes dans le <head> sabotent-elles vraiment votre SEO ?

- 26:06 Comment vérifier précisément le comportement des redirections pour Googlebot ?

- 28:06 Une redirection 301 mal configurée peut-elle bloquer l'indexation de vos pages ?

- 30:28 Comment contrôler la date affichée dans les résultats de recherche Google ?

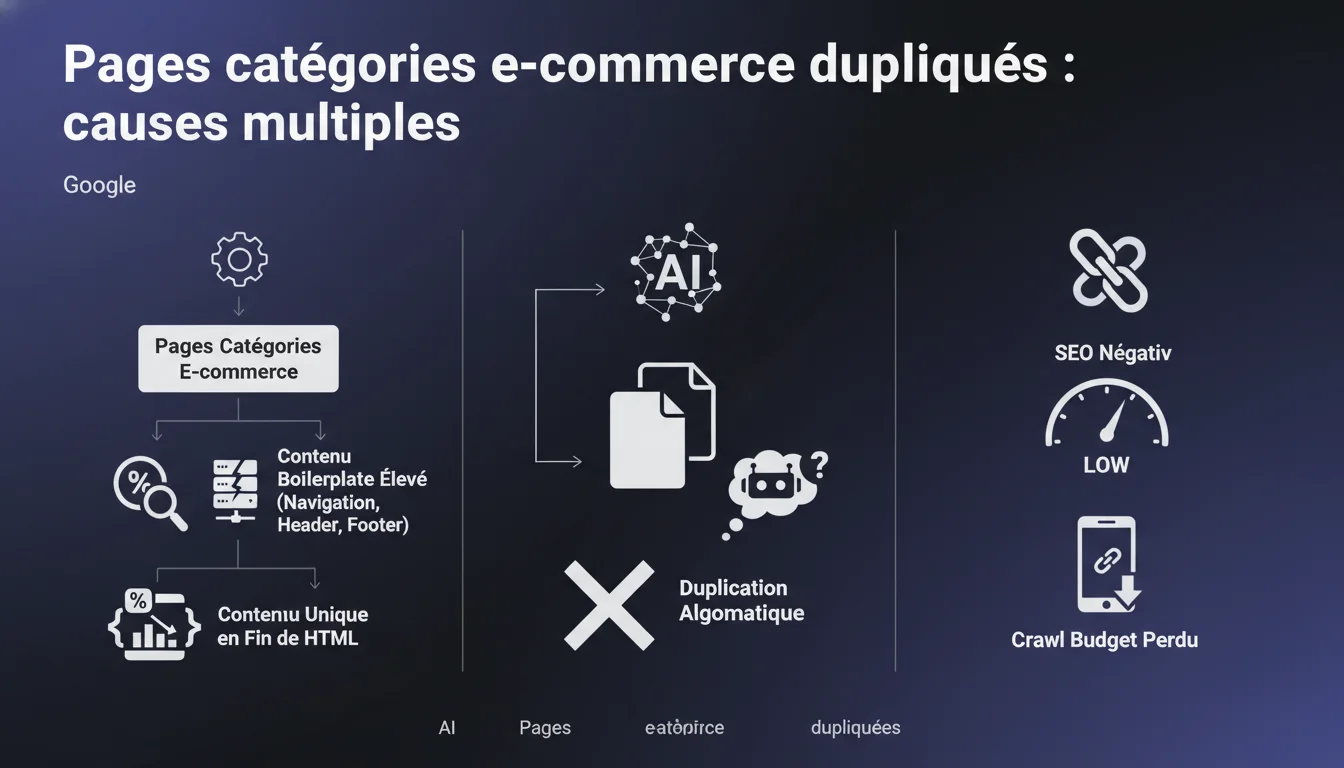

Google considère vos pages catégories comme dupliquées quand le boilerplate (navigation, header, footer) écrase le contenu unique. L'instabilité serveur aggrave le problème en empêchant le crawl complet. Solution directe : placez votre contenu spécifique en haut du code HTML, avant tout le reste.

Ce qu'il faut comprendre

Qu'est-ce qui rend une page catégorie « dupliquée » aux yeux de Google ?

Le problème n'est pas tant que vos pages se ressemblent visuellement — c'est inévitable sur un e-commerce avec des centaines de catégories. Ce qui déclenche le signal de duplication, c'est le ratio entre contenu boilerplate et contenu unique. Si votre navigation, votre header multiligne, vos filtres à facettes et votre footer représentent 80% du code HTML, Google ne voit pratiquement aucune différence entre vos catégories.

Concrètement, l'algo compare les pages entre elles. Si deux URLs partagent 90% de leur contenu crawlable, elles sont candidates à la déduplication. L'une sera indexée, l'autre non — ou pire, l'une sera préférée arbitrairement alors que ce n'est pas la plus stratégique.

Comment l'instabilité serveur transforme une page normale en duplicate ?

Point souvent négligé : un serveur qui timeout ou qui renvoie des réponses 500 intermittentes empêche Googlebot de récupérer le contenu complet. Si le crawler n'accède qu'aux premiers ko du HTML — donc header, nav, début de sidebar — il ne voit jamais votre bloc descriptif unique placé en bas de page.

Résultat : techniquement, vos pages ont du contenu différenciant, mais Google n'y accède pas. Il les catégorise donc comme quasi-identiques. L'instabilité crée un effet de bord qui mime structurellement une duplication.

Pourquoi placer le contenu unique en début de HTML change-t-il la donne ?

Google crawle le HTML de façon séquentielle. Les premiers ko ont plus de poids dans l'évaluation de l'unicité — c'est du pur pragmatisme algorithmique. Si votre texte unique apparaît après 150 lignes de <nav> et de filtres à facettes, il arrive tard dans le parsing et pèse moins lourd dans le diff.

En inversant l'ordre — contenu unique en tête, boilerplate après — vous forcez Google à rencontrer immédiatement ce qui distingue vos pages. Même si le crawler s'arrête à mi-parcours (timeout, crawl budget épuisé), il a déjà ingéré l'essentiel.

- Le boilerplate écrase le signal unique si son volume dépasse largement celui du contenu spécifique

- L'instabilité serveur amplifie le problème en empêchant l'accès au contenu situé bas dans le HTML

- L'ordre du code HTML influe directement sur la détection de l'unicité par Googlebot

- Une page peut être techniquement unique mais perçue comme duplicate pour des raisons purement techniques (accès partiel, ratio défavorable)

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. J'ai vu des centaines de sites e-commerce avec des pages catégories désindexées ou fusionnées dans l'index alors qu'elles avaient des descriptions uniques — mais placées après 200 lignes de markup. Le diagnostic standard révèle systématiquement un ratio contenu/boilerplate catastrophique. Google ne ment pas sur ce coup-là.

Ce qui est moins dit : la qualité du contenu unique compte aussi. Si vous remontez 50 mots de texte générique bourrés de mots-clés en haut du HTML, ça ne résout rien. L'unicité n'est pas juste une question de position, c'est aussi une question de substance. Mais Google reste pudique sur ce seuil qualitatif — [A vérifier] selon quels critères précis un texte est jugé « suffisamment unique » au-delà de sa simple différence lexicale.

L'instabilité serveur : excuse facile ou vrai problème structurel ?

Les deux. Oui, beaucoup de sites e-commerce sous-dimensionnent leurs serveurs et subissent des timeouts pendant les pics de crawl. Mais cette mention de Google sert aussi à déresponsabiliser l'algo : « Si on n'indexe pas vos pages, c'est peut-être votre infra qui déconne. » Pratique.

Dans la réalité, j'ai vu des sites avec une infra solide (CDN, caching agressif, monitoring poussé) rencontrer quand même des problèmes de duplication catégories. L'instabilité est un facteur aggravant, pas la cause racine. Le vrai problème reste le design HTML — mais Google préfère pointer aussi du doigt l'hébergement pour diluer sa propre responsabilité algorithmique.

Placer le contenu en haut du HTML : solution miracle ou palliatif ?

C'est un palliatif efficace, pas une solution miracle. Remonter le contenu unique améliore mécaniquement la détection, c'est indéniable. Mais ça peut créer des frictions UX (votre designer va hurler) et ça ne règle pas le problème de fond : trop de boilerplate.

La vraie solution passe par alléger la nav, réduire les éléments répétitifs, différencier réellement vos catégories avec du contenu étoffé. Remonter 3 lignes de texte générique ne sauvera personne. C'est un hack technique utile, mais il faut l'accompagner d'une refonte éditoriale sérieuse.

Impact pratique et recommandations

Que faut-il auditer en priorité sur vos pages catégories ?

Premier réflexe : mesurez le ratio contenu unique / boilerplate. Prenez le HTML source d'une catégorie, isolez tout ce qui est strictement identique entre deux catégories (header, nav, footer, sidebar filtres). Comparez au volume de texte vraiment spécifique. Si vous êtes sous 20% de contenu unique, vous êtes en zone rouge.

Deuxième audit : vérifiez les logs serveur pendant les pics de crawl Googlebot. Timeouts ? 500 intermittents ? Réponses partielles ? Si oui, votre infra bride l'indexation avant même que l'algo évalue votre contenu. Monitoring APM indispensable.

Comment restructurer le HTML sans casser l'UX ?

Utilisez le CSS Grid ou Flexbox avec order pour dissocier l'ordre visuel de l'ordre DOM. Placez votre bloc de contenu unique en haut du HTML (juste après <main>), mais affichez-le visuellement là où il fait sens pour l'utilisateur. Les crawlers lisent le DOM, les humains voient le rendu CSS.

Autre technique : chargez le boilerplate lourd en lazy (navigation secondaire, modules de réassurance) ou injectez-le côté client après le first paint. Googlebot verra d'abord votre contenu unique, l'UX reste intacte. Attention au JS rendering — assurez-vous que Google accède bien au contenu même si injecté post-chargement.

Quelles erreurs éviter absolument ?

Ne tombez pas dans le piège du contenu unique « invisible » (texte blanc sur blanc, display:none au chargement). Google détecte ces patterns et peut pénaliser. Le contenu doit être réellement accessible, juste priorisé dans l'ordre du code.

Évitez aussi de dupliquer votre effort éditorial : certains sites créent des descriptions catégories quasi-identiques parce qu'ils manquent de brief. L'unicité ne se décrète pas dans le HTML, elle se fabrique d'abord dans le CMS. Si vos rédacteurs tournent en rond, remonter le bloc ne changera rien.

- Auditer le ratio contenu unique / boilerplate sur un échantillon représentatif de catégories

- Vérifier les logs serveur pour détecter timeouts et erreurs 5xx pendant les crawls

- Déplacer les blocs de contenu unique en début de

<main>dans le DOM - Utiliser CSS Grid/Flexbox order pour maintenir l'affichage visuel souhaité

- Alléger la navigation et les modules répétitifs (réassurance, filtres redondants)

- Différencier réellement le contenu éditorial entre catégories (brief rédactionnel strict)

- Monitorer l'impact sur l'indexation via Search Console (pages indexées, couverture)

- Tester l'impact UX/conversion avant déploiement global (A/B test si volume suffisant)

Soyons honnêtes : restructurer l'HTML, alléger le boilerplate et orchestrer une refonte éditoriale à l'échelle d'un catalogue e-commerce, c'est un chantier technique et organisationnel conséquent. Entre les contraintes dev, les arbitrages UX et la coordination avec les équipes contenu, la complexité grimpe vite.

Si vous identifiez ces problématiques sur votre site mais que vous manquez de ressources internes ou d'expertise pour piloter la mise en conformité, solliciter un accompagnement spécialisé peut accélérer drastiquement la résolution. Une agence SEO technique saura auditer finement votre stack, proposer des implémentations sur mesure et suivre l'impact indexation sans mobiliser vos équipes pendant des mois.

❓ Questions frequentes

Quel est le seuil de ratio contenu unique / boilerplate toléré par Google ?

Faut-il aussi remonter les avis clients et les filtres à facettes dans le HTML ?

Comment vérifier que Googlebot accède bien à mon contenu unique même en bas de page ?

Un CDN ou un cache agressif peut-il aggraver l'instabilité perçue par Googlebot ?

Puis-je utiliser du lazy loading pour différer le boilerplate sans pénalité SEO ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.