Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- 5:33 Peut-on vraiment contrôler quelle image apparaît dans les résultats de recherche texte ?

- 7:30 Pourquoi vos rapports Search Console se contredisent-ils constamment ?

- 8:40 Faut-il vraiment uploader sa liste de désaveu uniquement sur le domaine actuel ?

- 10:06 Pourquoi Google classe-t-il vos pages internes au-dessus de votre page catégorie ?

- 11:21 Pourquoi le test d'URL publique échoue-t-il si souvent dans Search Console ?

- 13:33 Pourquoi Google privilégie-t-il la qualité du contenu sur la technique face au statut 'Crawlé - non indexé' ?

- 15:15 Est-ce que des pages « Crawlé - non indexé » pénalisent tout votre site ?

- 16:27 Pourquoi Google détecte-t-il mes pages catégories e-commerce comme du contenu dupliqué ?

- 18:55 Comment Google interprète-t-il réellement l'intention derrière vos requêtes ?

- 21:21 Les URLs simples influencent-elles vraiment le classement Google ?

- 22:22 Pourquoi Google peut-il ignorer votre JavaScript si vous placez un noindex dans le head ?

- 24:24 Les iframes dans le <head> sabotent-elles vraiment votre SEO ?

- 28:06 Une redirection 301 mal configurée peut-elle bloquer l'indexation de vos pages ?

- 30:28 Comment contrôler la date affichée dans les résultats de recherche Google ?

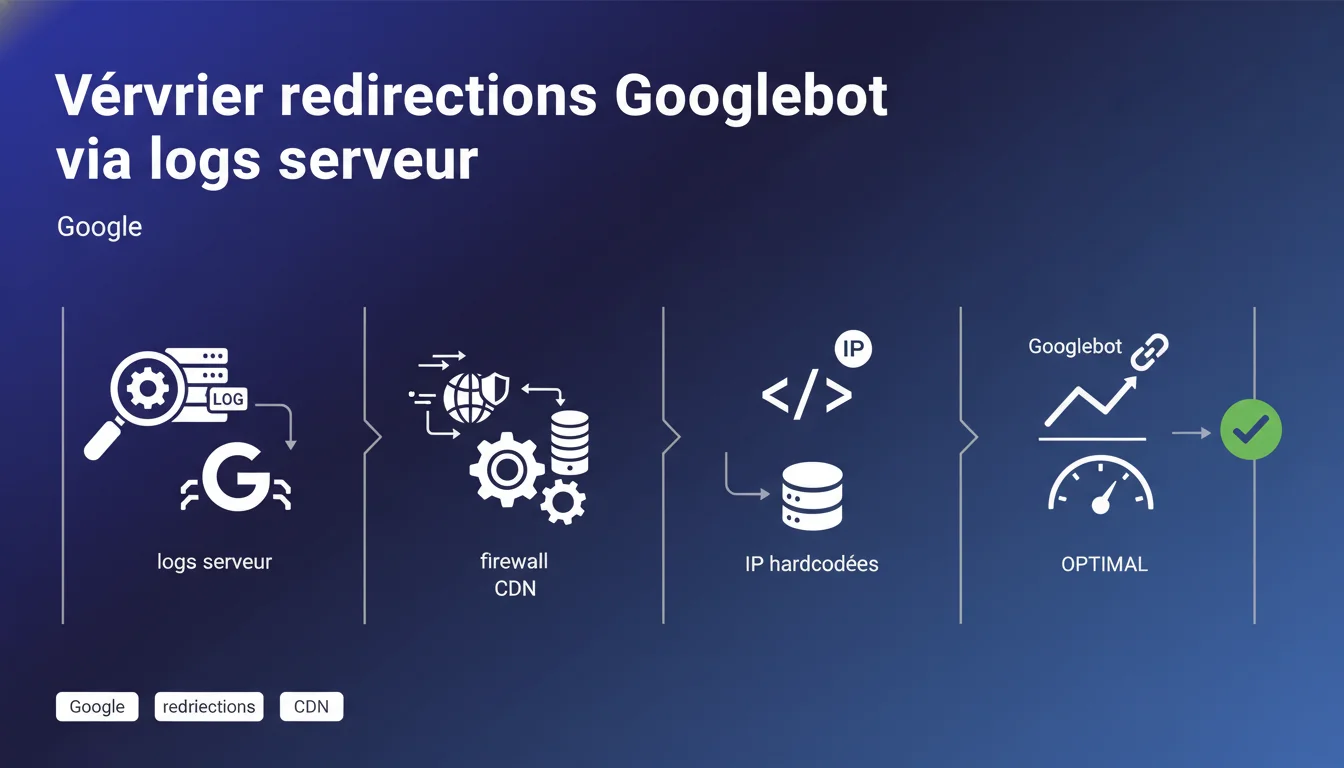

Google recommande d'examiner les logs serveur et les en-têtes de réponse pour le user-agent Googlebot pour vérifier le comportement des redirections. La déclaration souligne aussi l'importance de contrôler les règles firewall, CDN et IPs hardcodées dans le code qui peuvent altérer le comportement observé.

Ce qu'il faut comprendre

Pourquoi les logs serveur sont-ils la méthode la plus fiable ?

Contrairement aux outils de test en ligne qui simulent un crawl, les logs serveur enregistrent ce qui se passe réellement quand Googlebot accède à votre site. Ils capturent les requêtes brutes, les codes de statut HTTP retournés, et les éventuelles chaînes de redirections.

Cette approche élimine les faux positifs. Un outil tiers peut afficher un comportement différent de celui vécu par le bot — notamment si des règles conditionnelles s'appliquent selon le user-agent, l'IP source, ou des paramètres CDN.

Que faut-il vérifier exactement dans les en-têtes de réponse ?

Les en-têtes HTTP révèlent les codes de statut (301, 302, 307, 308), les headers Location, les potentielles redirections JavaScript ou meta refresh que Googlebot doit traiter. Un 301 visible côté utilisateur peut se transformer en 302 pour le bot si une règle serveur discrimine par user-agent.

Google insiste sur le fait de vérifier spécifiquement pour Googlebot, pas pour un navigateur classique. Certaines configurations renvoient des réponses différentes selon qui demande la page.

Quels éléments périphériques peuvent fausser le diagnostic ?

Les firewalls, CDN et IPs hardcodées dans le code peuvent introduire des redirections ou blocages invisibles pour un test manuel. Un firewall peut bloquer certaines plages IP de Googlebot, un CDN peut appliquer des règles de redirection géographique, un code peut forcer une redirection si l'IP ne correspond pas à une liste blanche.

Ces couches intermédiaires doivent être auditées pour comprendre le parcours complet d'une requête Googlebot.

- Examiner les logs serveur bruts pour le user-agent Googlebot

- Contrôler les en-têtes HTTP retournés (codes de statut, Location, Cache-Control)

- Auditer les règles firewall, CDN et IPs hardcodées qui peuvent modifier le comportement

- Ne pas se fier uniquement aux outils de test en ligne qui simulent un crawl

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, complètement. Les logs serveur sont depuis toujours la source de vérité pour diagnostiquer les problèmes de crawl et de redirections. Les outils tiers sont pratiques pour un premier diagnostic, mais ils ne capturent pas les nuances d'une infrastructure complexe.

On observe régulièrement des sites où un test manuel montre un 301 propre, alors que les logs révèlent une chaîne de 3 redirections pour Googlebot — généralement à cause d'un CDN mal configuré ou d'un firewall qui injecte ses propres règles.

Quelles nuances faut-il apporter ?

Google ne précise pas comment extraire et interpréter les logs serveur — ce qui n'est pas trivial pour tous les environnements. Les formats de logs varient (Apache, Nginx, IIS), et isoler les requêtes Googlebot demande des compétences techniques.

Autre point : l'accès aux logs n'est pas toujours garanti. Sur certaines plateformes SaaS ou hébergements mutualisés, vous n'avez pas accès direct aux logs bruts. Il faut alors passer par des proxies comme la Search Console, qui offre une vue partielle.

Quels sont les risques si on néglige cette vérification ?

Un site peut perdre du PageRank en chaîne si des redirections multiples diluent l'équité de lien. Ou pire : Googlebot peut abandonner le crawl après plusieurs sauts, laissant des pages importantes non indexées.

Les règles firewall ou CDN mal paramétrées peuvent aussi bloquer Googlebot sans que vous le sachiez — jusqu'à ce qu'une chute de trafic organique vous alerte, trop tard.

Impact pratique et recommandations

Que faut-il faire concrètement pour auditer les redirections ?

Commencez par extraire les logs serveur sur une période représentative (au moins 7 jours). Filtrez les lignes contenant le user-agent Googlebot (ou ses variantes comme Googlebot-Image, Googlebot-News).

Analysez ensuite les codes de statut pour identifier les redirections (301, 302, 307, 308). Tracez les chaînes : une URL A qui redirige vers B, qui redirige vers C. Idéalement, chaque redirection devrait être directe (A → C).

Croisez ces données avec les rapports Search Console — rubrique Couverture et Exploration. Si des URLs apparaissent comme redirigées dans la console mais pas dans vos logs, c'est un signal que des règles intermédiaires interviennent.

Quelles erreurs éviter lors de la vérification ?

Ne testez jamais uniquement avec un navigateur ou un outil qui ne spoofing pas correctement le user-agent Googlebot. Les règles serveur peuvent discriminer : un humain voit un comportement, le bot en voit un autre.

Évitez de négliger les règles CDN ou firewall. Un Cloudflare, Akamai ou firewall applicatif peut injecter des redirections ou des blocages que votre serveur web ne voit même pas dans ses propres logs.

Dernier point : ne confondez pas redirections serveur (HTTP 3xx) et redirections JavaScript ou meta refresh. Ces dernières sont traitées différemment par Googlebot — avec un délai potentiel.

Comment automatiser et maintenir cette surveillance ?

Mettez en place un monitoring régulier des logs avec des outils comme GoAccess, Splunk, ou des scripts Python/shell personnalisés. Créez des alertes si des chaînes de redirections apparaissent ou si le taux de codes 3xx augmente brusquement.

Intégrez aussi une revue des règles firewall et CDN dans vos processus de déploiement. Toute modification de configuration doit être testée avec un vrai user-agent Googlebot avant mise en production.

- Extraire les logs serveur pour le user-agent Googlebot sur 7 jours minimum

- Filtrer et analyser les codes HTTP 3xx pour repérer les chaînes de redirections

- Croiser avec les rapports Search Console (Couverture, Exploration)

- Auditer les règles firewall, CDN et IPs hardcodées dans le code

- Tester les redirections avec un user-agent Googlebot réel (pas un navigateur)

- Mettre en place un monitoring automatisé des logs avec alertes

- Documenter et versionner les configurations firewall/CDN

❓ Questions frequentes

Peut-on se fier uniquement aux outils de test en ligne pour vérifier les redirections ?

Comment isoler les requêtes Googlebot dans les logs serveur ?

Que faire si je n'ai pas accès aux logs serveur bruts ?

Une chaîne de redirections impacte-t-elle vraiment le SEO ?

Les règles CDN peuvent-elles modifier les redirections sans que je le sache ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.