Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- 5:33 Peut-on vraiment contrôler quelle image apparaît dans les résultats de recherche texte ?

- 8:40 Faut-il vraiment uploader sa liste de désaveu uniquement sur le domaine actuel ?

- 10:06 Pourquoi Google classe-t-il vos pages internes au-dessus de votre page catégorie ?

- 11:21 Pourquoi le test d'URL publique échoue-t-il si souvent dans Search Console ?

- 13:33 Pourquoi Google privilégie-t-il la qualité du contenu sur la technique face au statut 'Crawlé - non indexé' ?

- 15:15 Est-ce que des pages « Crawlé - non indexé » pénalisent tout votre site ?

- 16:27 Pourquoi Google détecte-t-il mes pages catégories e-commerce comme du contenu dupliqué ?

- 18:55 Comment Google interprète-t-il réellement l'intention derrière vos requêtes ?

- 21:21 Les URLs simples influencent-elles vraiment le classement Google ?

- 22:22 Pourquoi Google peut-il ignorer votre JavaScript si vous placez un noindex dans le head ?

- 24:24 Les iframes dans le <head> sabotent-elles vraiment votre SEO ?

- 26:06 Comment vérifier précisément le comportement des redirections pour Googlebot ?

- 28:06 Une redirection 301 mal configurée peut-elle bloquer l'indexation de vos pages ?

- 30:28 Comment contrôler la date affichée dans les résultats de recherche Google ?

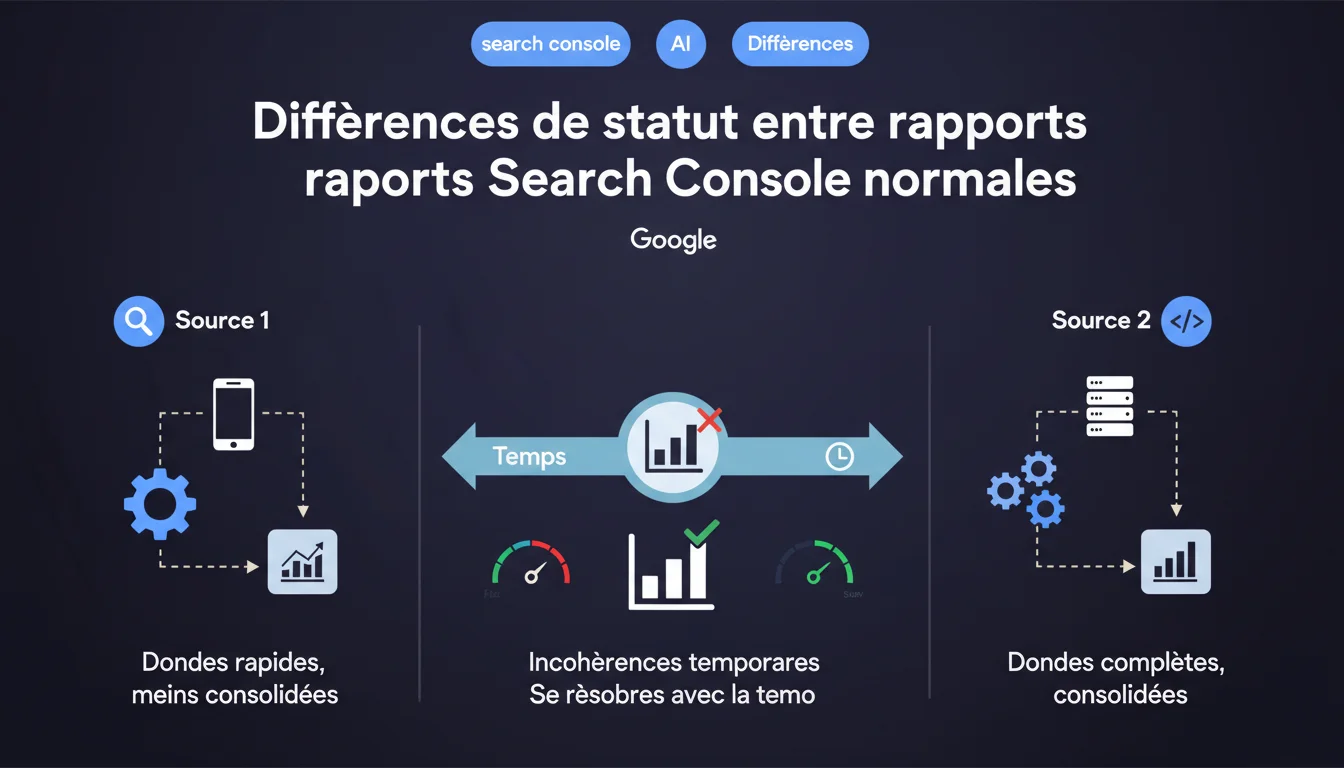

Google confirme que les différents rapports de Search Console puisent dans des sources de données distinctes et se mettent à jour à des fréquences variables. Ces décalages créent des incohérences temporaires entre les outils, mais ces contradictions finissent par disparaître avec le temps. En pratique : arrêtez de paniquer quand les chiffres ne collent pas.

Ce qu'il faut comprendre

Pourquoi Search Console affiche-t-il des données contradictoires ?

Chaque outil de Search Console ne puise pas dans la même base de données. Le rapport de performances, l'inspection d'URL, le rapport de couverture ou encore le rapport d'expérience sur la page fonctionnent avec des sources différentes et des cycles de mise à jour asynchrones.

Concrètement ? Une page peut apparaître indexée dans l'outil d'inspection d'URL mais absente du rapport de performances. Ou inversement : des impressions remontent dans les statistiques alors que la page est signalée en erreur ailleurs.

Ces incohérences sont-elles un bug à signaler ?

Non. Google l'affirme clairement : ces décalages sont normaux et temporaires. Les différents systèmes se synchronisent à leur rythme, et les écarts finissent par se résorber.

Le problème, c'est que Google ne précise ni les délais typiques ni les conditions qui prolongent ces incohérences. Un flou qui alimente l'anxiété chez les praticiens qui surveillent leurs migrations ou leurs corrections techniques.

Quels sont les points essentiels à retenir ?

- Les rapports Search Console utilisent des sources de données distinctes et ne se mettent pas à jour simultanément

- Les contradictions entre outils sont attendues et temporaires, pas des anomalies

- Ces décalages disparaissent généralement avec le temps, sans intervention manuelle

- Google ne donne aucun délai précis pour la résolution de ces incohérences

- Prendre des décisions SEO basées sur un seul rapport peut mener à des erreurs d'analyse

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et c'est même un soulagement que Google le reconnaisse officiellement. Sur le terrain, ces contradictions sont monnaie courante — surtout après une migration, un déploiement massif de corrections ou lors du lancement d'une nouvelle section.

Le problème, c'est l'absence totale de granularité. Google ne dit pas quels rapports sont prioritaires, ni lesquels se synchronisent en premier. Un praticien qui voit une page validée dans l'inspection d'URL mais toujours en erreur dans le rapport de couverture ne sait pas s'il doit attendre 24 heures ou 3 semaines.

Quelles nuances faut-il apporter à cette affirmation ?

[À vérifier] : Google affirme que ces incohérences "disparaissent généralement avec le temps", mais ne définit jamais ce "temps". Sur des sites à faible fréquence de crawl, ces décalages peuvent persister des semaines, voire des mois.

Autre point crucial : certaines contradictions ne se résorbent jamais. Quand une page est bloquée par le robots.txt mais remonte quand même des impressions dans les performances, ce n'est pas un décalage temporaire — c'est un signal que Google a mis cette URL en cache avant le blocage et continue de la servir dans certains contextes.

Dans quels cas faut-il s'inquiéter malgré tout ?

Si une incohérence persiste au-delà de 2-3 semaines sur un site crawlé quotidiennement, c'est un signal d'alerte. Ça peut signaler un problème structurel : pagination orpheline, URLs canonicalisées vers des pages inexistantes, ou conflits entre sitemaps et directives robots.

Impact pratique et recommandations

Que faut-il faire concrètement face à ces contradictions ?

D'abord, ne paniquez pas. Si vous venez de corriger une erreur technique ou de soumettre un nouveau sitemap, laissez passer au minimum 48-72 heures avant de conclure que ça ne fonctionne pas.

Ensuite, documentez. Prenez des captures d'écran des différents rapports avec leurs timestamps. Ça permet de tracer l'évolution et de repérer si une incohérence se résorbe ou stagne. Les logs serveur restent votre source de vérité : si Googlebot crawle effectivement vos pages et reçoit un 200, le reste n'est qu'une question de temps de propagation.

Quelles erreurs éviter absolument ?

Ne soumettez pas en boucle vos URLs à l'indexation via l'outil d'inspection. Ça ne règle aucun problème de synchronisation entre rapports — au contraire, ça peut saturer votre quota de requêtes prioritaires et diluer l'efficacité de l'outil.

Autre piège : recrawler massivement votre site en modifiant artificiellement les dates de modification dans votre sitemap XML. Google détecte ces manipulations et peut ralentir son crawl en représailles. Si une page est techniquement correcte, le crawl finira par passer — forcer la main est contre-productif.

Comment vérifier que votre analyse est fiable ?

- Croisez toujours au moins 3 sources : inspection d'URL, rapport de couverture, logs serveur

- Attendez un minimum de 72 heures après une correction technique avant de conclure à un échec

- Documentez les incohérences avec des captures d'écran horodatées pour suivre leur évolution

- Vérifiez dans vos logs serveur que Googlebot accède réellement aux pages concernées

- Ne vous fiez jamais uniquement au rapport de performances pour valider une indexation

- Si une contradiction persiste au-delà de 3 semaines sur un site actif, cherchez un problème structurel

❓ Questions frequentes

Combien de temps faut-il attendre avant qu'une incohérence entre rapports Search Console se résorbe ?

Quel rapport Search Console est le plus fiable pour vérifier l'indexation ?

Puis-je soumettre mes URLs plusieurs fois pour accélérer la synchronisation ?

Une page peut-elle générer des impressions même si elle apparaît en erreur dans le rapport de couverture ?

Comment savoir si une incohérence est normale ou révèle un vrai problème technique ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.