Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Les Web Components JavaScript sont-ils vraiment crawlables par Google ?

- □ Le balisage FAQ Schema impose-t-il un format strict de présentation ?

- □ Le balisage FAQ Schema garantit-il vraiment l'affichage des FAQ snippets dans Google ?

- □ Faut-il vraiment éviter de dupliquer son propre contenu pour le SEO ?

- □ Pourquoi Google pénalise-t-il les variations excessives d'un même contenu ?

- □ Comment vérifier si Googlebot voit vraiment votre contenu JavaScript ?

- □ WordPress pénalise-t-il vraiment le référencement par rapport au HTML statique ?

- □ Pourquoi vos pages ne sont-elles pas indexées malgré un site techniquement irréprochable ?

- □ Pourquoi les études utilisateurs externes sont-elles devenues incontournables pour résoudre les problèmes de qualité ?

- □ Faut-il vraiment faire confiance au rel=canonical pour contrôler l'indexation ?

- □ Les backlinks vers des 404 sont-ils vraiment perdus pour le SEO ?

- □ Le disavow tool efface-t-il vraiment toute trace des liens toxiques dans les algorithmes Google ?

- □ Un certificat SSL peut-il vraiment pénaliser votre référencement ?

- □ Une baisse progressive multi-domaines révèle-t-elle un problème de qualité plutôt que technique ?

- □ Bloquer Google Translate impacte-t-il vraiment votre référencement ?

- □ La balise meta notranslate peut-elle vraiment bloquer le lien « Traduire cette page » dans les SERP Google ?

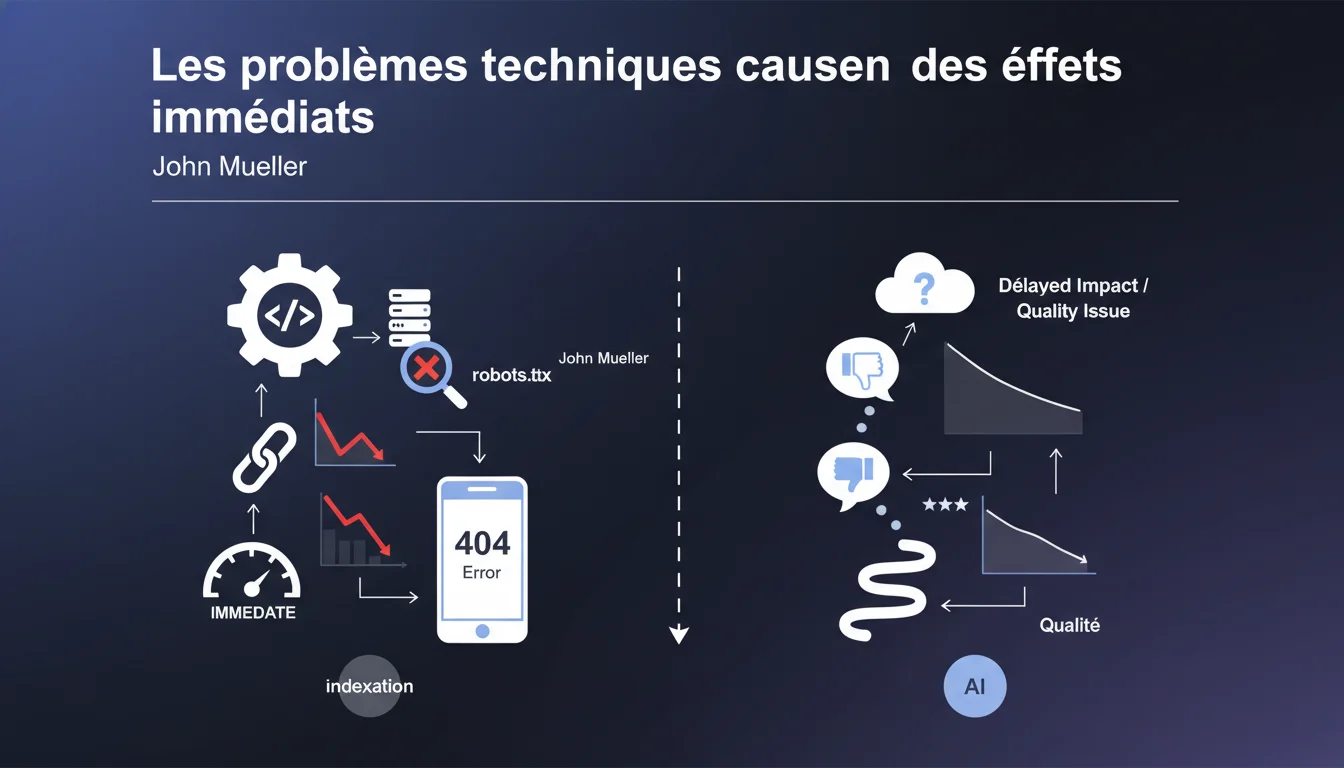

Les véritables blocages techniques (robots.txt, erreurs serveur) impactent l'indexation instantanément. Si un problème technique traîne depuis des mois sans conséquence visible et qu'une chute de trafic survient soudainement, cherchez du côté de la qualité du contenu plutôt que de la technique. Google distingue clairement les problèmes d'accès aux ressources des problèmes de pertinence.

Ce qu'il faut comprendre

Quels sont les « vrais » problèmes techniques selon Google ?

Mueller pointe du doigt les blocages d'accès et les erreurs serveur critiques. On parle ici de robots.txt mal configuré qui empêche Googlebot d'accéder à des sections entières, de codes HTTP 500 à répétition, ou de timeouts serveur chroniques.

Ces problèmes empêchent physiquement Google de crawler et indexer vos pages. L'effet est mécanique et immédiat — pas de crawl, pas d'indexation, pas de visibilité. C'est binaire.

Pourquoi cette distinction entre technique et qualité ?

Beaucoup de SEO cherchent des coupables techniques quand le trafic chute. C'est rassurant — un problème technique se règle, contrairement à un contenu devenu obsolète ou dépassé par la concurrence.

Mueller rappelle ici que si votre site fonctionne correctement depuis des mois et que Google le crawle sans souci, une baisse soudaine n'est probablement pas technique. Les algorithmes de qualité (Helpful Content, Core Updates) interviennent alors, et c'est un tout autre combat.

Quelle est la temporalité d'un vrai problème technique ?

L'impact est quasi instantané. Un robots.txt bloquant déployé par erreur ? Vos pages disparaissent de l'index en quelques jours maximum. Un serveur qui plante régulièrement ? Google réduit immédiatement son crawl budget.

À l'inverse, si votre problème technique supposé existe depuis six mois sans conséquence et qu'une baisse survient aujourd'hui, il faut chercher ailleurs. Corrélation n'est pas causalité.

- Impact immédiat : robots.txt bloquant, erreurs 5xx massives, DNS down, certificat SSL expiré

- Impact progressif : lenteur serveur modérée, soft 404, pagination mal gérée

- Pas d'impact direct : qualité du contenu, duplicate interne léger, structure HTML non-optimale mais valide

- Un problème ancien sans effet visible n'est probablement pas la cause d'une baisse récente

Avis d'un expert SEO

Cette affirmation résiste-t-elle aux observations terrain ?

Oui, et c'est même un des rares points où Google est parfaitement aligné avec ce qu'on observe. Les blocages techniques génèrent des alertes immédiates dans Search Console. Les erreurs d'indexation apparaissent sous 48-72h.

Par contre — et c'est là que ça coince — Mueller simplifie à l'extrême. Il oppose « technique » et « qualité » comme deux univers étanches. La réalité ? Beaucoup de problèmes vivent dans une zone grise.

Quelles nuances faut-il apporter à cette déclaration ?

Prenons le JavaScript rendu côté client. Techniquement, Google peut crawler. Mais si le rendu est lent ou instable, l'indexation devient chaotique. C'est technique ? C'est qualité ? Les deux, mon capitaine.

Même constat pour la cannibalisation de mots-clés. Problème d'architecture (donc technique) qui génère un flou sémantique (donc qualité). Ou les Core Web Vitals dégradés — techniquement mesurables, mais l'impact sur le ranking reste flou et progressif, pas binaire.

[À vérifier] : Google ne définit jamais précisément où s'arrête le « technique » et où commence la « qualité ». Cette frontière floue permet toutes les interprétations.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Les migrations de site sont un cas d'école. Techniquement, tout peut fonctionner (redirections 301 en place, robots.txt ok, serveur rapide), mais Google peut mettre des semaines à réévaluer l'autorité et la pertinence dans le nouveau contexte.

Les problèmes de crawl budget sur les très gros sites (millions de pages) ont aussi un effet différé. Google réduit progressivement son exploration, l'impact n'est pas immédiat mais cumulatif.

Impact pratique et recommandations

Comment distinguer un vrai problème technique d'un problème de qualité ?

Analysez la temporalité. Un problème technique majeur laisse des traces immédiates dans Search Console : chute brutale des pages indexées, pic d'erreurs serveur, explosion des erreurs d'exploration.

Si votre courbe de trafic plonge mais que Search Console reste silencieux sur les erreurs d'indexation, vous êtes probablement face à un problème algorithmique lié à la qualité ou la pertinence du contenu.

Que faut-il vérifier en priorité lors d'une baisse de trafic ?

Commencez par éliminer les causes techniques évidentes. Vérifiez que Google peut accéder à vos pages, que le serveur répond correctement, que le robots.txt n'a pas été modifié par erreur.

Si tout est vert côté technique, pivotez immédiatement vers l'analyse qualitative : positionnement des concurrents, fraîcheur du contenu, adéquation avec l'intention de recherche, signaux EEAT.

Quels outils utiliser pour diagnostiquer rapidement ?

- Search Console : onglet Couverture pour les erreurs d'indexation, onglet Statistiques d'exploration pour la santé du crawl

- Screaming Frog ou Oncrawl : audit complet des codes HTTP, temps de réponse, chaînes de redirection

- Logs serveur : vérifier que Googlebot accède bien aux ressources critiques (JS, CSS, images)

- PageSpeed Insights : Core Web Vitals et problèmes de rendu

- Comparaison SERP avant/après : identifier les concurrents qui ont pris vos positions

- Analyse du contenu : fraîcheur, profondeur, différenciation vs concurrence

❓ Questions frequentes

Combien de temps faut-il pour qu'un problème robots.txt impacte l'indexation ?

Une erreur 500 ponctuelle peut-elle faire chuter mon trafic durablement ?

Si mon site est lent mais accessible, est-ce un problème technique au sens de Mueller ?

Comment savoir si ma baisse de trafic vient d'une mise à jour algorithme ou d'un problème technique ?

Un contenu dupliqué est-il un problème technique ou de qualité ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.