Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Les Web Components JavaScript sont-ils vraiment crawlables par Google ?

- □ Le balisage FAQ Schema impose-t-il un format strict de présentation ?

- □ Le balisage FAQ Schema garantit-il vraiment l'affichage des FAQ snippets dans Google ?

- □ Faut-il vraiment éviter de dupliquer son propre contenu pour le SEO ?

- □ Pourquoi Google pénalise-t-il les variations excessives d'un même contenu ?

- □ Comment vérifier si Googlebot voit vraiment votre contenu JavaScript ?

- □ WordPress pénalise-t-il vraiment le référencement par rapport au HTML statique ?

- □ Pourquoi vos pages ne sont-elles pas indexées malgré un site techniquement irréprochable ?

- □ Faut-il vraiment faire confiance au rel=canonical pour contrôler l'indexation ?

- □ Les backlinks vers des 404 sont-ils vraiment perdus pour le SEO ?

- □ Le disavow tool efface-t-il vraiment toute trace des liens toxiques dans les algorithmes Google ?

- □ Un certificat SSL peut-il vraiment pénaliser votre référencement ?

- □ Une baisse progressive multi-domaines révèle-t-elle un problème de qualité plutôt que technique ?

- □ Les problèmes techniques SEO ont-ils vraiment un impact immédiat sur vos rankings ?

- □ Bloquer Google Translate impacte-t-il vraiment votre référencement ?

- □ La balise meta notranslate peut-elle vraiment bloquer le lien « Traduire cette page » dans les SERP Google ?

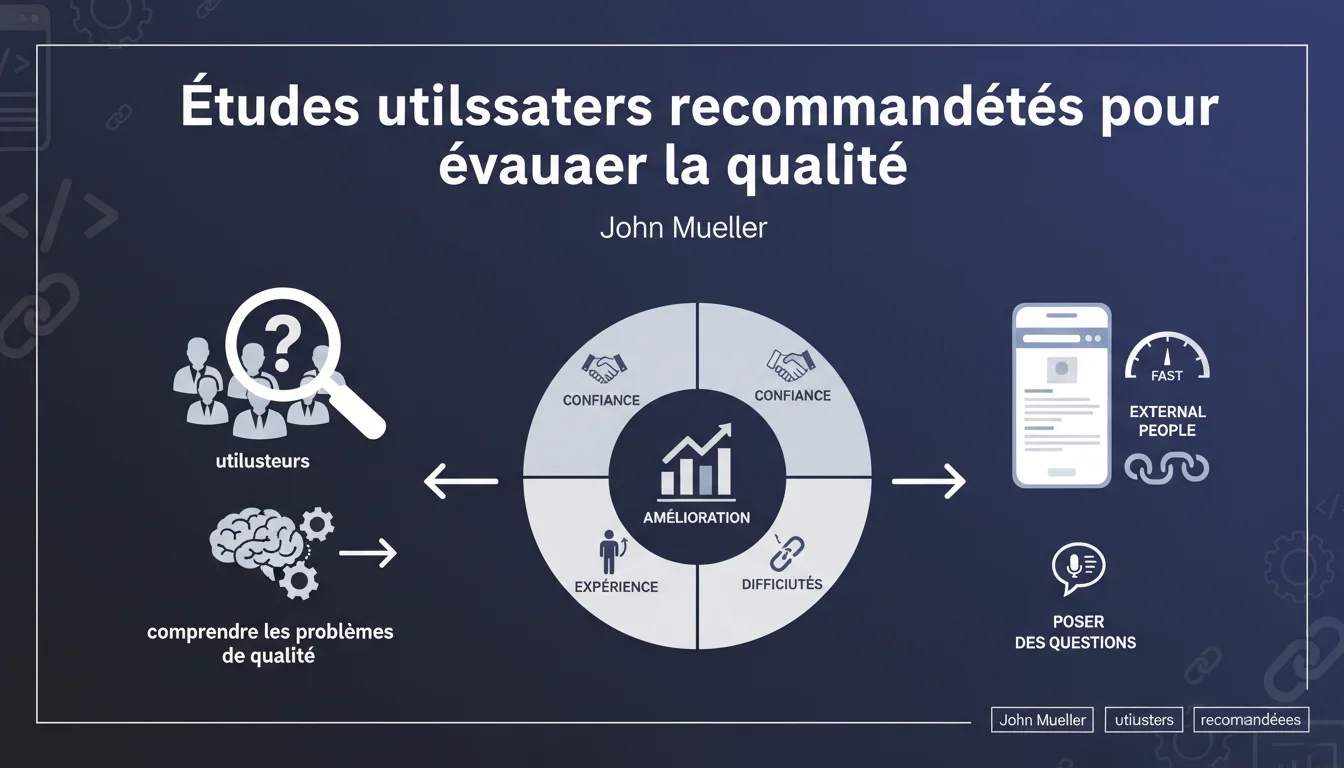

Google recommande explicitement de réaliser des études utilisateurs avec des personnes externes au site pour diagnostiquer les problèmes de qualité. L'objectif : identifier les failles de confiance, d'expérience et les frictions que l'équipe interne ne voit plus. Une démarche qui devient stratégique quand les Quality Raters Guidelines ne suffisent plus à comprendre pourquoi un site stagne.

Ce qu'il faut comprendre

Pourquoi Google pousse-t-il les webmasters vers les études utilisateurs ?

Parce que l'auto-évaluation a ses limites. Quand on travaille sur son propre site, on perd progressivement la capacité à détecter ce qui freine un visiteur lambda. Les biais cognitifs s'accumulent — on sait où cliquer, on connaît le jargon, on pardonne les défauts d'interface.

Google a compris que beaucoup de sites pénalisés par les mises à jour qualité (Helpful Content, Core Updates) ne comprennent pas ce qui cloche. Les équipes internes tournent en rond. D'où cette recommandation : sortir de sa bulle et confronter le site à des regards neufs.

Que signifie concrètement "faire des études utilisateurs" selon Google ?

Il ne s'agit pas de sondages superficiels. Google évoque trois axes d'investigation : la confiance (le site inspire-t-il crédibilité ?), l'expérience (la navigation est-elle fluide, intuitive ?) et les difficultés rencontrées (où l'utilisateur bloque-t-il, abandonne-t-il ?).

Concrètement ? Des sessions d'observation avec des utilisateurs représentatifs, des tests A/B qualitatifs, des entretiens semi-directifs. Pas besoin d'un budget pharaonique — même 5 à 10 personnes bien choisies peuvent révéler des patterns critiques.

En quoi est-ce différent des Quality Raters Guidelines ?

Les QRG donnent le cadre théorique que Google utilise pour entraîner ses algorithmes. Mais elles restent abstraites. Demander à un utilisateur externe « Ce site te semble-t-il crédible ? » produit une réponse vivante, ancrée dans l'expérience réelle.

Les QRG évaluent l'E-E-A-T via des critères documentés. Les études utilisateurs capturent les micro-frictions que les guidelines ne détaillent pas : une police illisible, un CTA ambigu, un tunnel de conversion anxiogène.

- Sortir de l'auto-évaluation pour casser les biais internes qui aveuglent les équipes

- Trois axes clés : confiance, expérience utilisateur, points de blocage

- Complémentarité avec les QRG : les guidelines donnent le cap, les études révèlent les obstacles invisibles

- Budget modulable : 5 à 10 utilisateurs suffisent souvent pour identifier les problèmes récurrents

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les évolutions algorithmiques observées ?

Totalement. Depuis Helpful Content Update, Google sanctionne les sites qui écrivent pour l'algorithme plutôt que pour l'humain. Les études utilisateurs forcent à inverser la logique : partir de ce que ressent réellement le visiteur, pas de ce qu'on croit qu'il attend.

On observe sur le terrain que les sites qui remontent post-pénalité sont ceux qui ont radicalement repensé leur UX et leur crédibilité — souvent après avoir confronté leur contenu à des bêta-testeurs externes. Ceux qui se contentent d'ajuster des balises ou de réécrire quelques paragraphes stagnent.

Quelles nuances faut-il apporter à cette déclaration ?

Première nuance : Google ne précise pas quel type d'études. Tests utilisateurs modérés ? Eye-tracking ? Questionnaires post-visite ? La méthodo compte. Un mauvais protocole (questions orientées, panel biaisé) produit des résultats inutilisables.

Deuxième nuance : cette recommandation cible surtout les sites YMYL et e-commerce où la confiance est critique. Pour un blog de niche avec 500 visiteurs/mois, l'effort peut être disproportionné. [A vérifier] : Google n'indique pas de seuil de trafic ou de typologie de site où cette démarche devient rentable.

Dans quels cas cette approche montre-t-elle ses limites ?

Les études utilisateurs révèlent des problèmes d'UX et de perception, pas des failles techniques que Google seul voit. Si ton site a un problème de crawl budget, de canonicalisation ou de structured data défaillant, un panel d'utilisateurs ne le détectera jamais.

Autre limite : les utilisateurs verbalisent mal certains critères E-E-A-T. Ils peuvent trouver un site « louche » sans savoir dire pourquoi — or, isoler la cause exacte (absence d'auteur ? design daté ? publicités invasives ?) demande une analyse post-étude rigoureuse.

Impact pratique et recommandations

Que faut-il faire concrètement pour lancer des études utilisateurs efficaces ?

D'abord, définir un objectif précis. « Améliorer la qualité » est trop vague. Mieux vaut cibler : « Comprendre pourquoi les visiteurs quittent la page produit sans ajouter au panier » ou « Identifier ce qui nuit à la crédibilité de nos articles de blog ».

Ensuite, recruter un panel représentatif : pas tes collègues, pas ta famille. Utilise des plateformes comme UserTesting, Testapic, ou recrute via des groupes Facebook thématiques. 5 à 10 personnes suffisent pour une première itération.

Protocole type : observe l'utilisateur naviguer sur ton site (partage d'écran), pose des questions ouvertes (« Que penses-tu de cette page ? », « Te sentirais-tu à l'aise pour acheter ici ? »), note les hésitations, les clics ratés, les commentaires spontanés.

Quelles erreurs éviter lors de la mise en œuvre ?

Erreur n°1 : poser des questions orientées. « Ce site te semble-t-il professionnel ? » pousse à répondre oui. Préfère : « Qu'est-ce qui te frappe en arrivant sur cette page ? »

Erreur n°2 : tester uniquement la homepage. Les pages de conversion, les articles de blog, les pages catégories méritent autant d'attention — c'est souvent là que se jouent les abandons.

Erreur n°3 : ne pas croiser les retours utilisateurs avec les données analytics. Si 3 personnes sur 5 disent que le menu est confus, mais que ton taux de rebond est faible, creuse : peut-être que les visiteurs s'adaptent malgré tout, ou que ton panel n'était pas représentatif.

Comment s'assurer que les insights se traduisent en gains SEO ?

Les études utilisateurs révèlent des axes d'amélioration — mais il faut ensuite prioriser. Hiérarchise les problèmes par impact potentiel : un défaut de crédibilité sur une page YMYL passe avant un bouton mal placé sur une page de contact.

Documente tout. Crée un rapport structuré avec captures d'écran, verbatims, recommandations chiffrées (« 7 utilisateurs sur 10 n'ont pas vu l'auteur de l'article »). Ce rapport devient une pièce maîtresse pour convaincre la direction d'investir dans la refonte.

Enfin, mesure l'effet des corrections. Déploie les changements par vagues, surveille l'évolution des Core Web Vitals, du temps passé, du taux de conversion. Retest avec un nouveau panel 3 mois plus tard pour valider les hypothèses.

- Recruter un panel externe représentatif (5 à 10 personnes minimum)

- Définir des objectifs précis (confiance, UX, points de friction)

- Observer sans influencer : questions ouvertes, pas de suggestions orientées

- Tester plusieurs types de pages (pas seulement la homepage)

- Croiser les retours utilisateurs avec les données analytics

- Prioriser les corrections selon leur impact E-E-A-T et conversion

- Documenter les insights dans un rapport actionnable

- Mesurer l'effet des optimisations post-déploiement

❓ Questions frequentes

Les études utilisateurs remplacent-elles un audit SEO technique ?

Combien de personnes faut-il interroger pour obtenir des résultats fiables ?

Peut-on réaliser ces études en interne ou faut-il externaliser ?

Comment savoir si les problèmes détectés impactent réellement le SEO ?

Cette approche est-elle pertinente pour tous les types de sites ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.