Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Les Web Components JavaScript sont-ils vraiment crawlables par Google ?

- □ Le balisage FAQ Schema impose-t-il un format strict de présentation ?

- □ Le balisage FAQ Schema garantit-il vraiment l'affichage des FAQ snippets dans Google ?

- □ Faut-il vraiment éviter de dupliquer son propre contenu pour le SEO ?

- □ Pourquoi Google pénalise-t-il les variations excessives d'un même contenu ?

- □ Comment vérifier si Googlebot voit vraiment votre contenu JavaScript ?

- □ WordPress pénalise-t-il vraiment le référencement par rapport au HTML statique ?

- □ Pourquoi les études utilisateurs externes sont-elles devenues incontournables pour résoudre les problèmes de qualité ?

- □ Faut-il vraiment faire confiance au rel=canonical pour contrôler l'indexation ?

- □ Les backlinks vers des 404 sont-ils vraiment perdus pour le SEO ?

- □ Le disavow tool efface-t-il vraiment toute trace des liens toxiques dans les algorithmes Google ?

- □ Un certificat SSL peut-il vraiment pénaliser votre référencement ?

- □ Une baisse progressive multi-domaines révèle-t-elle un problème de qualité plutôt que technique ?

- □ Les problèmes techniques SEO ont-ils vraiment un impact immédiat sur vos rankings ?

- □ Bloquer Google Translate impacte-t-il vraiment votre référencement ?

- □ La balise meta notranslate peut-elle vraiment bloquer le lien « Traduire cette page » dans les SERP Google ?

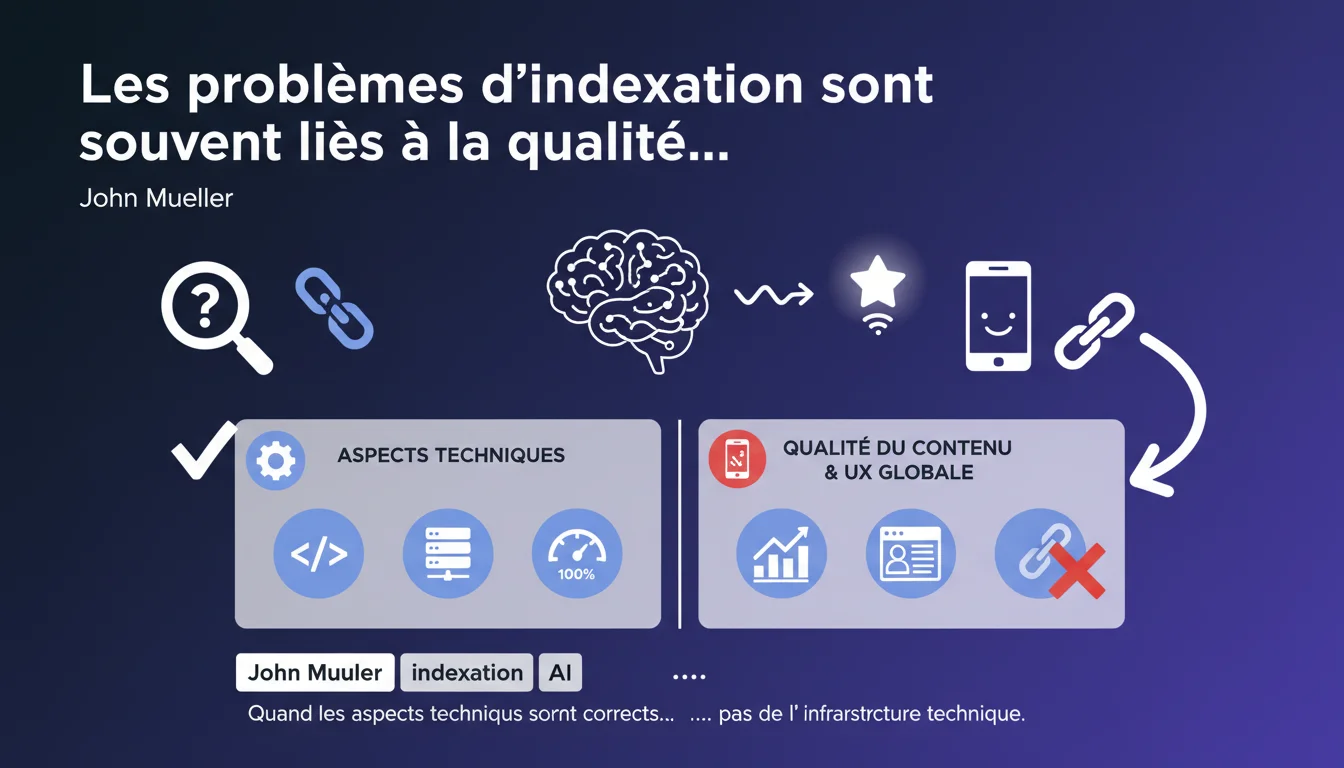

Quand votre infrastructure technique est au point mais que certaines pages ne s'indexent pas ou ne rankent pas, Google pointe du doigt la qualité perçue du contenu et l'expérience globale du site. Le message est clair : arrêtez de chercher le problème dans le robots.txt ou les sitemaps — c'est votre contenu qui ne passe pas la barre.

Ce qu'il faut comprendre

Que signifie réellement « qualité perçue du contenu » selon Google ?

Google ne parle pas ici de fautes d'orthographe ou de tournures maladroites. La qualité perçue renvoie à la capacité d'une page à répondre efficacement à l'intention de recherche, à apporter une valeur ajoutée par rapport à ce qui existe déjà, et à engager l'utilisateur.

Concrètement, une page peut être parfaitement rédigée mais jugée « de faible qualité » si elle reproduit ce que disent déjà 50 autres sites sans rien apporter de neuf. Google évalue aussi des signaux comportementaux — temps passé, taux de rebond, interactions — même si l'entreprise reste floue sur leur poids exact.

L'infrastructure technique est-elle devenue secondaire ?

Non. Ce que Mueller sous-entend, c'est que dans la majorité des cas diagnostiqués, le problème n'est pas là. Si votre site est crawlable, que les balises canonical sont propres et que le sitemap XML est correct, continuer à traquer un hypothétique bug technique est une perte de temps.

Cela dit, « aspects techniques corrects » reste une notion vague. Qu'est-ce qui est « correct » aux yeux de Google ? Un temps de chargement de 2 secondes ou de 4 ? Un Core Web Vitals « moyen » ou « bon » ? Cette déclaration présuppose un diagnostic technique déjà exhaustif — ce qui, dans la réalité, n'est pas toujours le cas.

Qu'entend Google par « expérience globale du site » ?

L'expérience globale déborde largement du contenu textuel. Elle englobe la navigation, la clarté de l'architecture, la vitesse perçue, l'absence de publicités agressives, la lisibilité mobile, et la cohérence éditoriale.

Un site qui multiplie les pop-ups intrusifs, qui noie l'utilisateur sous des call-to-action contradictoires ou dont le maillage interne est chaotique sera pénalisé — même si chaque page prise isolément est « de qualité ». Google évalue le contexte dans lequel le contenu est servi, pas uniquement le contenu lui-même.

- Qualité perçue ≠ qualité rédactionnelle : il s'agit de la valeur ajoutée face à la concurrence et de l'adéquation à l'intention de recherche.

- Technique « correcte » est une notion floue : Google ne précise pas les seuils exacts de vitesse, de Core Web Vitals ou de structure qui valident ce critère.

- L'expérience globale compte autant que le contenu : navigation, architecture, UX mobile et absence de friction sont scrutés.

- Les signaux comportementaux jouent probablement un rôle : même si Google ne le dit pas explicitement, le taux de rebond et l'engagement influencent la perception de qualité.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. Côté « oui » : on constate effectivement que des sites techniquement impeccables peinent à ranker quand leur contenu est générique, dupliqué ou sans angle éditorial. Les algorithmes de Google — Helpful Content Update en tête — ciblent explicitement le contenu faible ou produit à la chaîne.

Côté « non » : dire que « le problème vient généralement de la qualité » évacue un peu vite des cas edge plus complexes. Des sites peuvent subir des pénalités algorithmiques liées à des patterns techniques discrets — pagination mal gérée, facettes e-commerce indexées à tort, duplication cross-domain — que les outils standards ne détectent pas toujours. [A vérifier] : combien de sites diagnostiqués comme « problème de qualité » avaient en réalité un souci technique non identifié ?

Quelles nuances faut-il apporter à cette affirmation ?

Mueller parle d'un diagnostic par élimination : quand la technique est OK, alors c'est le contenu. Problème : qui définit « technique OK » ? Google ne publie pas de grille d'audit officielle. Un audit technique « standard » ne couvre pas nécessairement tous les signaux que Google observe — pensez aux métriques Real User Monitoring, aux signaux de sécurité, ou aux éventuels filtres anti-spam appliqués discrètement.

Autre nuance : cette déclaration présuppose que l'indexation et le ranking obéissent aux mêmes logiques. Or, une page peut être indexée mais invisible en raison d'un problème de E-E-A-T perçu au niveau du domaine, indépendamment de la qualité intrinsèque de la page. Google mélange ici deux enjeux distincts.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Certains secteurs — e-commerce à forte volumétrie, sites d'actualité multi-auteurs, agrégateurs — peuvent rencontrer des problèmes d'indexation structurels sans lien direct avec la qualité du contenu. Un crawl budget mal réparti, une arborescence trop profonde ou des paramètres d'URL mal configurés peuvent bloquer l'indexation de pages pourtant utiles.

De même, les sites multilingues ou multi-régionaux peuvent souffrir de problèmes liés aux hreflang, aux balises canonical ou à la géolocalisation serveur — des sujets techniques que Google sous-estime parfois dans ses communications publiques. Dans ces contextes, le réflexe « c'est forcément le contenu » est une impasse.

Impact pratique et recommandations

Que faut-il faire concrètement si vos pages ne s'indexent pas ?

Commencez par valider exhaustivement la couche technique. Ne vous contentez pas d'un « ça a l'air correct » : auditez le crawl via les logs serveur, vérifiez la cohérence des directives robots.txt, canonical et meta robots, testez la vitesse réelle (pas seulement les scores Lighthouse), et traquez les erreurs JavaScript qui bloquent le rendu.

Si vraiment rien ne ressort, alors seulement, pivotez vers le contenu. Analysez les pages indexées de vos concurrents : qu'apportent-elles que vous n'apportez pas ? Quels formats utilisent-ils (vidéo, infographies, données chiffrées) ? Votre contenu répond-il à une intention de recherche claire ou essaie-t-il de tout dire à tout le monde ?

Quelles erreurs éviter dans le diagnostic ?

Ne tombez pas dans le piège du « contenu-alibi » : ajouter 500 mots de remplissage à une page qui en faisait 300 ne résoudra rien si ces 500 mots n'apportent aucune valeur. Google ne compte pas les mots, il évalue la pertinence et la profondeur de traitement.

Évitez aussi de négliger les signaux UX : une page peut être excellente sur le fond mais pénalisée si elle est noyée dans un océan de publicités, si le CLS est catastrophique, ou si le maillage interne ne la met pas en valeur. L'expérience globale, c'est aussi la façon dont vous présentez le contenu.

- Auditer les logs serveur pour confirmer que Google crawle réellement les pages concernées

- Vérifier la cohérence des directives d'indexation (robots.txt, meta robots, canonical, sitemap)

- Tester le rendu JavaScript côté Google via l'outil d'inspection d'URL de la Search Console

- Analyser les Core Web Vitals en conditions réelles (Real User Monitoring), pas seulement en lab

- Comparer le contenu de vos pages avec celui des concurrents bien rankés : qu'apportent-ils de plus ?

- Évaluer l'expérience globale : navigation, maillage interne, intrusivité publicitaire, lisibilité mobile

- Identifier les signaux E-E-A-T au niveau du domaine : mentions externes, auteurs identifiés, cohérence éditoriale

Comment s'assurer que votre diagnostic est complet ?

Un diagnostic SEO exhaustif demande de croiser plusieurs couches d'analyse — technique, sémantique, UX, autorité — et de ne pas s'arrêter au premier symptôme identifié. Beaucoup de problèmes d'indexation résultent en réalité d'un cumul de micro-défauts qui, isolément, sembleraient anodins.

❓ Questions frequentes

Une page techniquement parfaite peut-elle vraiment ne pas être indexée à cause de sa qualité ?

Comment savoir si mon problème est technique ou lié au contenu ?

Qu'entend Google par « expérience globale du site » ?

Est-ce que les Core Web Vitals sont suffisants pour valider l'aspect technique ?

Faut-il négliger la technique et se concentrer uniquement sur le contenu ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.