Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Les Web Components JavaScript sont-ils vraiment crawlables par Google ?

- □ Le balisage FAQ Schema impose-t-il un format strict de présentation ?

- □ Le balisage FAQ Schema garantit-il vraiment l'affichage des FAQ snippets dans Google ?

- □ Pourquoi Google pénalise-t-il les variations excessives d'un même contenu ?

- □ Comment vérifier si Googlebot voit vraiment votre contenu JavaScript ?

- □ WordPress pénalise-t-il vraiment le référencement par rapport au HTML statique ?

- □ Pourquoi vos pages ne sont-elles pas indexées malgré un site techniquement irréprochable ?

- □ Pourquoi les études utilisateurs externes sont-elles devenues incontournables pour résoudre les problèmes de qualité ?

- □ Faut-il vraiment faire confiance au rel=canonical pour contrôler l'indexation ?

- □ Les backlinks vers des 404 sont-ils vraiment perdus pour le SEO ?

- □ Le disavow tool efface-t-il vraiment toute trace des liens toxiques dans les algorithmes Google ?

- □ Un certificat SSL peut-il vraiment pénaliser votre référencement ?

- □ Une baisse progressive multi-domaines révèle-t-elle un problème de qualité plutôt que technique ?

- □ Les problèmes techniques SEO ont-ils vraiment un impact immédiat sur vos rankings ?

- □ Bloquer Google Translate impacte-t-il vraiment votre référencement ?

- □ La balise meta notranslate peut-elle vraiment bloquer le lien « Traduire cette page » dans les SERP Google ?

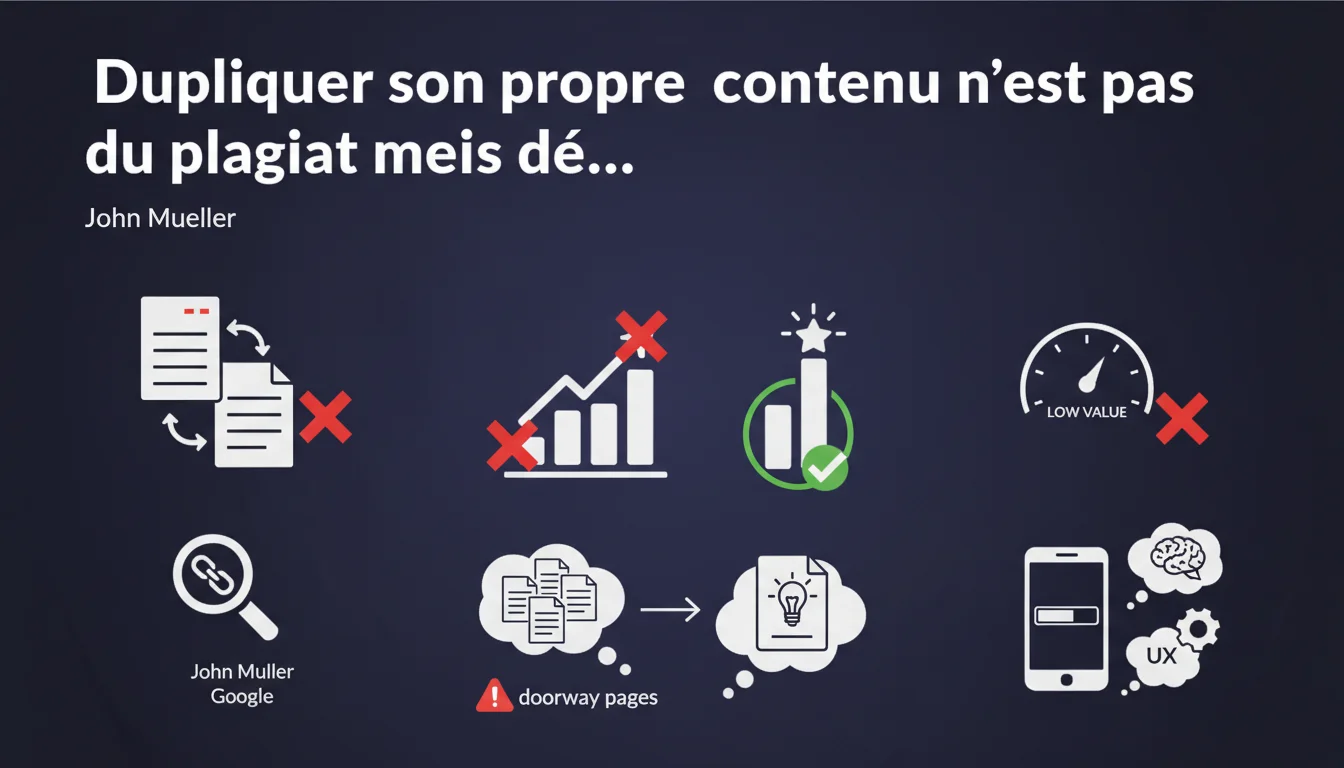

Réutiliser son propre contenu en changeant quelques mots n'est pas sanctionné par Google, mais apporte une valeur SEO proche de zéro. Mieux vaut concentrer ses efforts sur moins d'articles, mais de qualité supérieure. Attention : multiplier les variations peut basculer dans les doorway pages et déclencher des pénalités.

Ce qu'il faut comprendre

Qu'entend Google exactement par « dupliquer son propre contenu » ?

On parle ici de contenus quasi-identiques publiés sur plusieurs URL de votre propre site. Exemple typique : une même description produit avec quelques mots changés (couleur, taille) ou un article de blog décliné en trois versions pour cibler trois variantes d'un même mot-clé.

Google ne considère pas cette pratique comme du plagiat — vous êtes propriétaire du contenu original. Mais le moteur juge cette approche pauvre en valeur ajoutée : pourquoi indexer cinq pages qui disent la même chose ?

Pourquoi Google déconseille-t-il cette approche si elle n'est pas sanctionnée ?

La nuance est importante. Google ne pénalise pas systématiquement le duplicate content interne, mais il filtre. Concrètement : une seule version sera indexée et classée, les autres disparaîtront des résultats ou traîneront en queue de peloton.

Le vrai risque ? La dilution de votre crawl budget et de votre link equity. Vos ressources sont dispersées sur des URL faibles au lieu d'être concentrées sur des contenus solides.

Quelle est la frontière avec les doorway pages ?

C'est là que ça coince. Si vous créez de nombreuses variations — par exemple 50 pages quasi-identiques ciblant chacune une ville différente — Google peut requalifier ça en doorway pages. Et là, sanction.

La limite est floue. Trois variantes ? Probablement safe. Trente ? Vous jouez avec le feu. La question centrale : ces pages apportent-elles une expérience utilisateur distincte ou sont-elles juste des portes d'entrée pour capturer du trafic SEO ?

- Dupliquer son propre contenu n'est pas sanctionné en soi, mais apporte peu de valeur SEO

- Google privilégie une URL par contenu unique : les doublons sont filtrés, pas indexés

- Multiplier les variations peut basculer dans les doorway pages et déclencher des pénalités manuelles

- La frontière dépend du nombre de variantes et de leur valeur utilisateur réelle

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, et c'est confirmé par l'expérience quotidienne. Les sites qui dupliquent massivement leur contenu interne — e-commerce avec fiches produits quasi-identiques, sites multi-locations avec pages clonées — voient régulièrement leurs URL filtrées dans l'index. Pas de pénalité brutale, mais une invisibilité progressive.

Par contre, la notion de « nombreuses variations » reste délibérément vague. [À vérifier] : Google ne donne aucun seuil chiffré. Cinq pages ? Vingt ? Cent ? Impossible de tracer une ligne nette, et c'est probablement volontaire pour garder une marge d'appréciation manuelle.

Quelles nuances faut-il apporter à cette règle ?

La déclaration de Mueller sous-entend que qualité > quantité, mais il y a des exceptions terrain. Certains sites à forte autorité s'en sortent très bien avec des contenus légèrement dupliqués — parce qu'ils compensent par une architecture solide et un maillage interne intelligent.

Autre point : Mueller évoque « changer quelques mots », mais qu'en est-il des contenus structurellement identiques avec des données variables (prix, disponibilités, horaires) ? Ces pages sont techniquement dupliquées, mais apportent une vraie valeur utilisateur. Google les tolère généralement si le reste du contenu est différencié.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Les sites techniques — documentation, bases de connaissances, fiches techniques — ont souvent besoin de répéter des informations structurées. Ici, le duplicate partiel est nécessaire pour la cohérence. Google semble l'accepter si le contexte global diffère.

Impact pratique et recommandations

Que faut-il faire concrètement si on a déjà dupliqué du contenu ?

Première étape : auditer vos URL pour identifier les contenus quasi-identiques. Utilisez des outils de détection de duplicate (Screaming Frog, Siteliner, ou simplement des requêtes site: sur Google avec des extraits de texte).

Ensuite, trois options — selon le contexte :

- Fusionner les pages dupliquées en une seule version enrichie, puis rediriger les anciennes URL en 301

- Différencier réellement le contenu de chaque page (ajout d'informations spécifiques, cas d'usage, témoignages locaux, etc.)

- Utiliser la balise canonical pour indiquer à Google quelle version privilégier (mais ça ne règle pas le problème de valeur utilisateur)

- Supprimer purement les pages faibles qui n'apportent aucune valeur et drainent le crawl budget

Quelles erreurs éviter absolument ?

Ne créez pas de variations « cosmétiques » juste pour cibler des variantes de mots-clés. Google comprend les synonymes et les intentions de recherche — vous n'avez pas besoin d'une page pour « acheter chaussures running » et une autre pour « achat chaussures running ».

Évitez aussi le piège du « spinning » interne : réécrire un même contenu en changeant juste la structure des phrases. Google détecte la similarité sémantique, pas seulement les mots identiques.

- Ne multipliez pas les pages pour cibler des variantes mineures de mots-clés

- Ne comptez pas sur la balise canonical pour « réparer » une stratégie de contenu dupliqué massif

- Ne sous-estimez pas le risque de requalification en doorway pages si vous dépassez un certain volume

Comment vérifier que mon site est conforme après nettoyage ?

Lancez une commande site:votredomaine.com sur Google et parcourez les résultats. Si vous voyez des pages quasiment identiques indexées, c'est qu'il reste du travail. Vérifiez aussi vos rapports de couverture dans Google Search Console : les pages « Exclues » avec la mention « Contenu dupliqué » sont un signal clair.

Surveillez vos Core Web Vitals et votre crawl budget via les logs serveur : moins de pages inutiles = meilleure efficacité de crawl, meilleures performances globales.

❓ Questions frequentes

Est-ce que Google pénalise le duplicate content interne ?

Combien de variations d'une même page peut-on créer sans risque ?

La balise canonical suffit-elle pour gérer le duplicate content ?

Peut-on republier un même article sur plusieurs sections du site ?

Qu'est-ce qu'une doorway page exactement dans ce contexte ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.