Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Les Web Components JavaScript sont-ils vraiment crawlables par Google ?

- □ Le balisage FAQ Schema impose-t-il un format strict de présentation ?

- □ Le balisage FAQ Schema garantit-il vraiment l'affichage des FAQ snippets dans Google ?

- □ Faut-il vraiment éviter de dupliquer son propre contenu pour le SEO ?

- □ Pourquoi Google pénalise-t-il les variations excessives d'un même contenu ?

- □ Comment vérifier si Googlebot voit vraiment votre contenu JavaScript ?

- □ Pourquoi vos pages ne sont-elles pas indexées malgré un site techniquement irréprochable ?

- □ Pourquoi les études utilisateurs externes sont-elles devenues incontournables pour résoudre les problèmes de qualité ?

- □ Faut-il vraiment faire confiance au rel=canonical pour contrôler l'indexation ?

- □ Les backlinks vers des 404 sont-ils vraiment perdus pour le SEO ?

- □ Le disavow tool efface-t-il vraiment toute trace des liens toxiques dans les algorithmes Google ?

- □ Un certificat SSL peut-il vraiment pénaliser votre référencement ?

- □ Une baisse progressive multi-domaines révèle-t-elle un problème de qualité plutôt que technique ?

- □ Les problèmes techniques SEO ont-ils vraiment un impact immédiat sur vos rankings ?

- □ Bloquer Google Translate impacte-t-il vraiment votre référencement ?

- □ La balise meta notranslate peut-elle vraiment bloquer le lien « Traduire cette page » dans les SERP Google ?

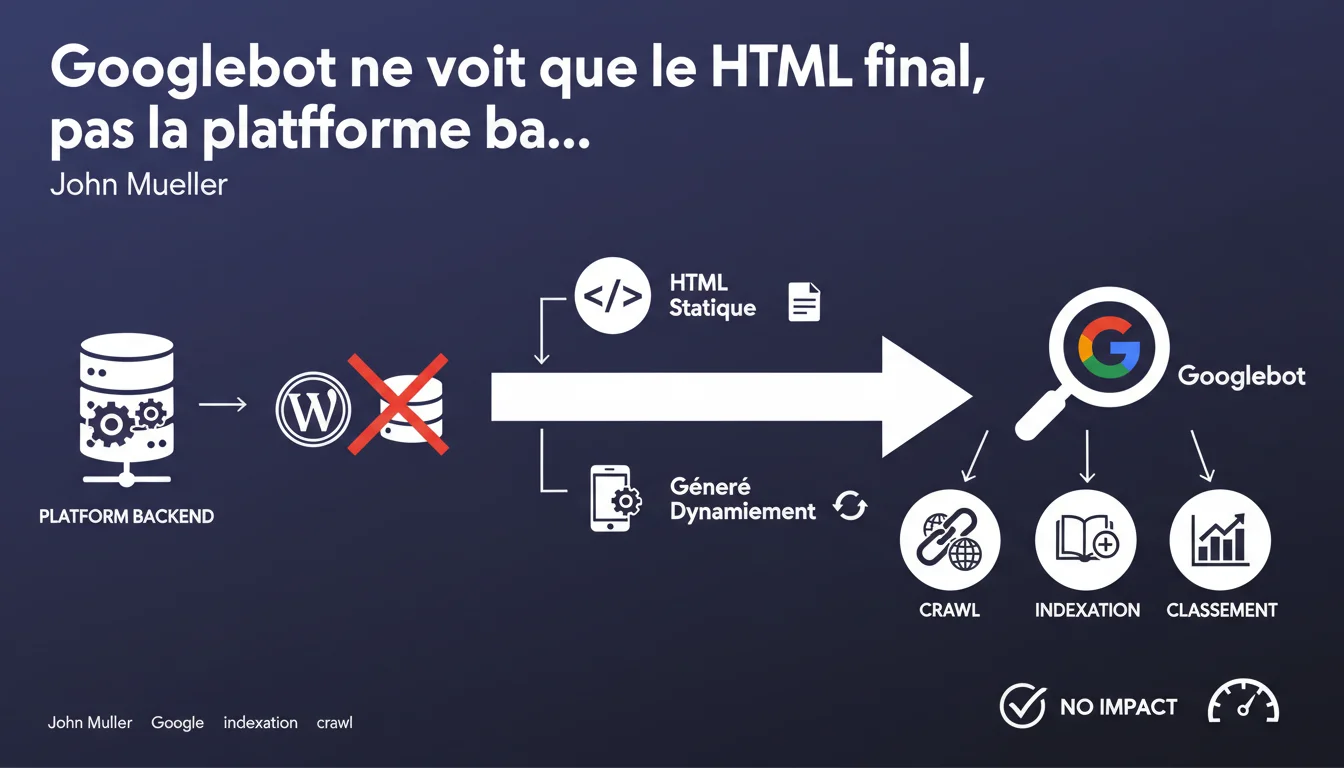

Googlebot ne fait aucune distinction entre du HTML statique ou du contenu généré dynamiquement par un CMS comme WordPress. Seul le HTML final rendu compte pour le crawl, l'indexation et le classement. La technologie backend est invisible et sans impact direct sur les performances SEO.

Ce qu'il faut comprendre

Que voit réellement Googlebot quand il crawle une page ?

Googlebot ne perçoit que le HTML final délivré par le serveur après toutes les étapes de génération. Qu'une page soit écrite à la main en HTML pur, assemblée par WordPress, générée par un framework JavaScript côté serveur, ou construite par n'importe quel autre CMS, le résultat final est identique aux yeux du bot : une structure HTML classique.

Cette déclaration rappelle un principe fondamental souvent mal compris. Les crawlers n'ont ni accès ni intérêt pour la base de données MySQL, le PHP, les fichiers de configuration ou l'architecture backend. Ils consomment uniquement le document HTML tel qu'il est servi au navigateur.

Cette affirmation signifie-t-elle que tous les CMS se valent pour le SEO ?

Non. La nuance est cruciale ici. Si la technologie en elle-même n'a pas d'impact direct, la façon dont elle génère le HTML final en a énormément. Un CMS mal configuré peut produire du HTML lourd, lent à charger, bourré de scripts bloquants ou de redirections inutiles.

WordPress bien optimisé peut rivaliser avec du HTML statique. WordPress mal géré — thème obèse, plugins redondants, cache inexistant — sera un boulet. Le problème n'est jamais le CMS, mais toujours l'implémentation.

Pourquoi cette clarification de Google maintenant ?

Parce que le mythe persiste. Certains professionnels pensent encore qu'un site statique bénéficie d'un avantage algorithmique intrinsèque, ou que Google favorise certaines plateformes. Cette déclaration coupe court à ces fantasmes.

Elle rappelle aussi que les performances réelles — vitesse, Core Web Vitals, qualité du HTML — comptent bien plus que la stack technique. Un site statique lent et mal structuré sera toujours battu par un WordPress rapide et propre.

- Googlebot crawle uniquement le HTML final rendu, pas le code source backend

- Aucune technologie (WordPress, Drupal, statique, JAMstack) n'a d'avantage ou de pénalité algorithmique intrinsèque

- L'impact SEO dépend uniquement de la qualité du HTML produit : structure, performance, accessibilité

- Un CMS mal configuré génère du mauvais HTML — et c'est ça qui pénalise, pas le CMS lui-même

- Les Core Web Vitals, le temps de chargement et la propreté du code sont les vrais critères discriminants

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Les tests A/B entre sites WordPress bien optimisés et sites statiques montrent des performances SEO équivalentes à contenu et backlinks égaux. Le facteur déterminant reste toujours la vitesse de rendu HTML et la qualité du balisage final.

Cependant — et c'est là que John Mueller simplifie un peu — la réalité est que WordPress mal géré représente 90% des sites WordPress. Thèmes bloated, plugins conflictuels, images non optimisées, absence de cache… Le CMS n'est pas en cause, mais l'écosystème et la facilité d'installation attirent des configurations catastrophiques.

Quelles nuances faut-il apporter à cette affirmation ?

Première nuance : le HTML final dépend de la qualité du thème et des plugins. Un thème qui injecte 2 Mo de CSS inutilisé et 47 requêtes JavaScript bloquantes génère certes du HTML valide, mais Google voit aussi les métriques de performance s'effondrer. Ça n'impacte pas le crawl stricto sensu, mais ça massacre les Core Web Vitals.

Deuxième nuance : certains CMS génèrent par défaut du HTML structuré (balises sémantiques, hiérarchie Hn cohérente, breadcrumbs), d'autres non. WordPress avec Yoast ou Rank Math produit souvent un meilleur balisage qu'un site statique codé à l'arrache. La technologie n'a pas d'impact, mais l'outillage qu'elle fournit, si.

[À vérifier] : Mueller ne mentionne pas explicitement le cas du JavaScript côté client (React, Vue en SPA). Techniquement, si le rendu final nécessite l'exécution JS et que le serveur ne livre pas de HTML pré-rendu, Googlebot doit executer le JS — ce qui ajoute une couche de complexité et de latence. La déclaration reste vraie (seul le HTML final compte), mais le chemin pour y arriver diffère.

Dans quels cas cette règle ne s'applique-t-elle pas pleinement ?

Quand le CMS génère du contenu différencié selon l'agent. Si WordPress détecte Googlebot et lui sert une version allégée différente de celle des utilisateurs, on entre dans du cloaking — même involontaire. Certains plugins de cache mal configurés peuvent causer ce problème.

Autre cas limite : les CMS qui génèrent du HTML mais cachent du contenu essentiel derrière des requêtes AJAX non indexables. Googlebot voit le HTML initial, mais pas le contenu chargé après interaction utilisateur. Techniquement conforme à la déclaration de Mueller, mais catastrophique en SEO.

Impact pratique et recommandations

Que faut-il faire concrètement si votre site est sous WordPress ou un autre CMS ?

Arrêtez de vous demander si WordPress est bon ou mauvais pour le SEO. La question n'a aucun sens. Concentrez-vous sur la qualité du HTML produit et les performances réelles mesurées par Google.

Auditez le HTML final : inspectez le code source tel que Googlebot le reçoit (via l'outil d'inspection d'URL dans Search Console). Vérifiez que la structure Hn est logique, que le contenu principal est bien présent, que les balises schema.org sont valides. Si c'est propre, vous êtes dans les clous.

Quelles erreurs éviter avec un CMS dynamique ?

Ne multipliez pas les plugins redondants. Chaque plugin WordPress ajoute du CSS, du JS, parfois des requêtes HTTP supplémentaires. Un site avec 40 plugins actifs génère rarement du HTML léger. Faites le tri brutal.

Évitez les thèmes « tout-en-un » bourrés de fonctionnalités que vous n'utiliserez jamais. Ces mastodontes génèrent un HTML obèse et des temps de chargement catastrophiques. Privilégiez un thème minimaliste (GeneratePress, Astra sans bloat) et ajoutez uniquement ce dont vous avez besoin.

Ne négligez jamais le cache et la compression. Un CMS dynamique qui régénère chaque page à chaque requête est une aberration. WP Rocket, LiteSpeed Cache ou équivalent : non négociable. La différence entre HTML statique et dynamique s'efface totalement avec un bon cache.

Comment vérifier que votre implémentation est optimale ?

Testez les Core Web Vitals en conditions réelles (PageSpeed Insights, Chrome UX Report). Si vos métriques sont dans le vert, votre CMS fait bien son job. Si elles sont dans le rouge, le problème vient de l'implémentation, pas de la technologie.

Comparez le HTML source (curl ou wget) avec ce que vous voyez dans l'inspecteur d'URL Search Console. S'il y a des différences majeures, vous avez un souci de rendu ou de cache côté serveur. Googlebot doit voir exactement ce qu'un navigateur reçoit.

- Auditez le HTML final via Search Console (outil d'inspection d'URL)

- Supprimez les plugins et fonctionnalités inutiles qui alourdissent le code

- Utilisez un thème léger et optimisé (évitez les usines à gaz)

- Activez une solution de cache robuste (WP Rocket, LiteSpeed, Varnish)

- Optimisez les images (WebP, lazy loading, dimensions adaptées)

- Vérifiez les Core Web Vitals en conditions réelles (PageSpeed Insights)

- Assurez-vous que Googlebot voit le même HTML qu'un visiteur standard

- Testez le TTFB : si > 600ms, améliorez l'hébergement ou la config serveur

❓ Questions frequentes

Un site en HTML statique est-il plus rapide qu'un site WordPress pour Googlebot ?

Google pénalise-t-il certains CMS comme Wix ou Shopify ?

Les sites WordPress ont-ils un problème de crawl budget à cause du PHP ?

Faut-il migrer vers du statique (JAMstack, Next.js) pour améliorer le SEO ?

Google voit-il les fichiers PHP ou la base de données MySQL ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 08/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.