Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Pourquoi la navigation à facettes cause-t-elle la moitié des problèmes de crawl ?

- □ Faut-il vraiment bloquer la navigation à facettes dans robots.txt ?

- □ Les paramètres d'action dans vos URLs sabotent-ils votre crawl budget ?

- □ Pourquoi Google intervient-il directement dans le code des plugins WordPress ?

- □ Faut-il vraiment se débarrasser des session IDs dans vos URLs ?

- □ Pourquoi vos paramètres de calendrier WordPress sabotent-ils votre crawl budget ?

- □ Le double encodage d'URLs tue-t-il vraiment votre crawl budget ?

- □ Pourquoi Googlebot doit-il crawler massivement un nouveau site avant de savoir s'il vaut le coup ?

- □ Faut-il attendre 24 heures pour qu'une modification de robots.txt soit prise en compte ?

- □ Faut-il abandonner les paramètres GET pour sécuriser son crawl budget ?

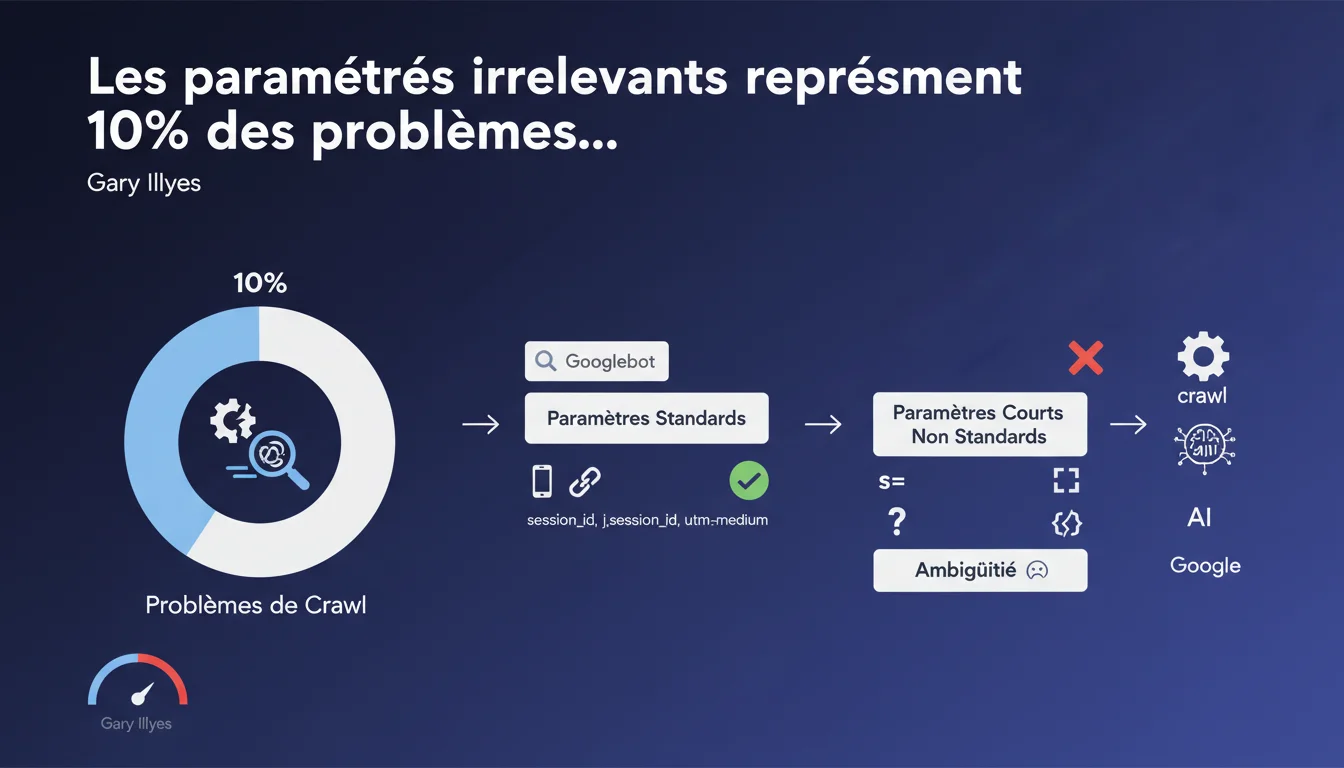

Google gère sans souci les paramètres standards (utm_*, session_id, j_session_id), mais les paramètres courts non standards (s=, p=, v=) représentent 10% des problèmes de crawl remontés. Leur ambiguïté empêche Google de déterminer s'ils génèrent du contenu dupliqué ou unique.

Ce qu'il faut comprendre

Pourquoi certains paramètres posent-ils problème à Google ?

Google crawle des milliards de pages chaque jour et doit décider lesquelles méritent d'être visitées. Quand il tombe sur example.com/produit?s=2, il ne sait pas si ce paramètre change le contenu (tri, filtre) ou s'il s'agit d'un simple tracking. Cette ambiguïté sémantique le force à crawler plusieurs variantes pour trancher.

Les paramètres standards comme utm_medium ou session_id sont connus de Google — il sait qu'ils ne modifient pas le contenu. Il peut donc les ignorer sans risque de manquer une page importante. C'est pour ça qu'ils ne causent pas de soucis de crawl.

Qu'est-ce qui rend un paramètre « non standard » exactement ?

Un paramètre court comme s= peut signifier « sort » (tri), « session », « size » (taille), voire « search ». Sans convention établie, Google ne peut pas deviner. Il va donc crawler plusieurs URL avec des valeurs différentes pour comprendre si le contenu change.

Cette mécanique bouffe du crawl budget inutilement si votre paramètre est juste du tracking. Résultat : Google perd du temps sur des doublons au lieu d'explorer vos nouvelles pages stratégiques.

- 10% des problèmes de crawl proviennent de paramètres non pertinents mal gérés

- Les paramètres standards (utm_*, session_id, j_session_id) sont automatiquement ignorés par Google

- Les paramètres courts ambigus (s=, p=, v=) forcent Google à crawler plusieurs variantes pour trancher

- Cette ambiguïté consomme du crawl budget qui aurait pu servir à indexer du contenu stratégique

Avis d'un expert SEO

Cette déclaration correspond-elle à ce qu'on observe sur le terrain ?

Oui, et c'est même un euphémisme. Les logs Apache/Nginx montrent que Google crawle effectivement des dizaines de variantes d'URL identiques quand les paramètres sont mal configurés. Sur un gros e-commerce avec des filtres façonniers, ça peut représenter 50 à 70% du crawl total gaspillé.

Le chiffre de 10% annoncé par Gary Illyes concerne les rapports remontés, pas l'ampleur réelle du problème. Beaucoup de sites souffrent de ce souci sans même le savoir — ils n'ont jamais ouvert leurs logs de crawl. [A vérifier] si ce chiffre inclut uniquement Search Console ou également les diagnostics internes de Google non publiés.

Pourquoi Google ne blackliste-t-il pas simplement tous les paramètres courts ?

Parce que certains paramètres courts sont légitimes et modifient le contenu. Un ?p=2 pour la pagination, un ?c=rouge pour une couleur de produit — ces URLs doivent être crawlées.

Google préfère crawler et analyser plutôt que de risquer de louper du contenu indexable. C'est à nous, praticiens SEO, de lui faciliter le travail via les canonicals, le robots.txt ou la Search Console. Le moteur ne va pas deviner nos intentions à notre place.

Les outils de gestion de paramètres dans Search Console sont-ils encore pertinents ?

Google a supprimé l'outil de gestion des paramètres d'URL de Search Console en 2022. La raison invoquée ? Il était sous-utilisé et source d'erreurs. Beaucoup de SEO configuraient mal les règles et bloquaient accidentellement du contenu important.

Aujourd'hui, Google recommande plutôt les canonicals et le robots.txt pour gérer ces cas. Soyons honnêtes : c'est moins granulaire, mais plus robuste. Une mauvaise canonical n'empêchera pas le crawl, juste l'indexation de la variante — moins risqué qu'un blocage robots.txt mal fichu.

Impact pratique et recommandations

Que faut-il faire concrètement pour nettoyer ses paramètres d'URL ?

Commencez par lister tous les paramètres présents dans vos logs de crawl Google. Screaming Frog ou OnCrawl peuvent extraire ça rapidement. Identifiez lesquels sont du tracking pur (utm_*, fbclid, gclid) et lesquels modifient le contenu.

Pour les paramètres de tracking, deux options : soit les canonical vers l'URL propre, soit les bloquer dans le robots.txt si vous ne voulez même pas que Google les crawle. Attention avec robots.txt — ça empêche le crawl mais aussi la consolidation du PageRank via canonical.

Les paramètres qui modifient le contenu (filtres, tri, pagination) doivent rester crawlables. Utilisez des canonicals cohérentes : par exemple, toutes les URLs triées canonicalisent vers la version par défaut. Évitez les chaînes de canonicals — ça ralentit la consolidation.

Quelles erreurs éviter absolument avec les paramètres d'URL ?

Ne bloquez jamais un paramètre via robots.txt sans avoir vérifié qu'il ne porte pas de contenu unique. Un client a un jour bloqué ?cat= pensant que c'était du tracking — c'était en fait ses pages catégories. Désindexation massive en 48h.

Autre piège classique : les canonicals circulaires. URL A canonical vers URL B qui canonical vers URL A. Google abandonne et indexe au pif. Vérifiez vos canonicals avec un crawler complet avant de déployer.

Enfin, attention aux paramètres générés côté client (JavaScript). Google peut les voir si vous utilisez du client-side routing avec des query strings. Assurez-vous que vos canonicals s'appliquent aussi dans le DOM rendu.

Comment vérifier que mon site est correctement configuré ?

- Crawlez votre site avec Screaming Frog et exportez toutes les URLs avec paramètres

- Vérifiez que chaque URL paramètrée a une canonical cohérente vers une version propre

- Analysez vos logs de crawl Google (7 jours minimum) pour identifier les paramètres sur-crawlés

- Comparez les URLs crawlées par Google avec celles présentes dans votre sitemap XML

- Testez vos règles robots.txt avec l'outil de test de Google (via API ou outils tiers)

- Surveillez les pages explorées non indexées dans Search Console — souvent signe de doublons paramétrés

❓ Questions frequentes

Google ignore-t-il automatiquement les paramètres UTM ?

Faut-il bloquer les paramètres de tracking dans le robots.txt ?

Comment savoir si un paramètre court est problématique sur mon site ?

Les paramètres de session (PHPSESSID, JSESSIONID) sont-ils gérés par Google ?

Peut-on utiliser les canonicals pour gérer les paramètres de pagination ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/02/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.