Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Pourquoi la navigation à facettes cause-t-elle la moitié des problèmes de crawl ?

- □ Faut-il vraiment bloquer la navigation à facettes dans robots.txt ?

- □ Les paramètres d'action dans vos URLs sabotent-ils votre crawl budget ?

- □ Pourquoi Google intervient-il directement dans le code des plugins WordPress ?

- □ Les paramètres d'URL courts mettent-ils vraiment votre crawl budget en danger ?

- □ Faut-il vraiment se débarrasser des session IDs dans vos URLs ?

- □ Pourquoi vos paramètres de calendrier WordPress sabotent-ils votre crawl budget ?

- □ Le double encodage d'URLs tue-t-il vraiment votre crawl budget ?

- □ Pourquoi Googlebot doit-il crawler massivement un nouveau site avant de savoir s'il vaut le coup ?

- □ Faut-il abandonner les paramètres GET pour sécuriser son crawl budget ?

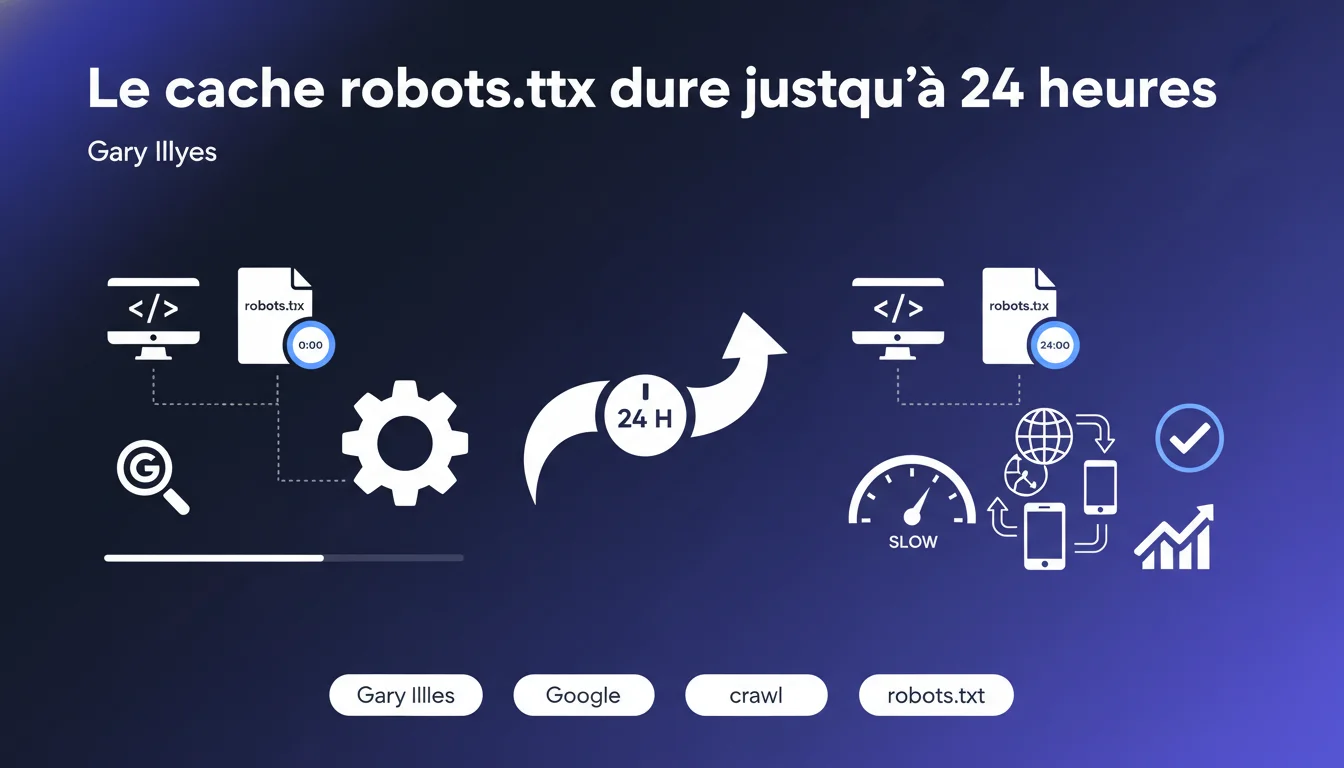

Google met en cache les fichiers robots.txt pendant une durée pouvant aller jusqu'à 24 heures. Toute modification apportée à ce fichier n'est donc pas instantanée et peut nécessiter près d'une journée avant d'être effective. Malgré ce délai, robots.txt reste l'outil le plus fiable pour contrôler le crawl de Googlebot.

Ce qu'il faut comprendre

Pourquoi Google met-il en cache le fichier robots.txt ?

Googlebot interroge des milliards de pages chaque jour. Vérifier le fichier robots.txt à chaque requête générerait une charge technique considérable, autant pour les serveurs de Google que pour ceux des sites crawlés.

La mise en cache permet à Google de réduire drastiquement le nombre de requêtes HTTP tout en conservant les directives d'exclusion. Ce mécanisme évite de saturer vos serveurs avec des appels répétés au même fichier.

Que signifie concrètement « jusqu'à 24 heures » ?

Le cache n'a pas une durée fixe de 24 heures pile. Gary Illyes utilise la formulation « jusqu'à » — cela signifie que le délai peut être plus court, mais ne dépassera probablement pas cette fenêtre.

Dans la pratique, le cache peut se rafraîchir après quelques heures seulement. Tout dépend de la fréquence de crawl de votre site et de la manière dont Google gère ses cycles de mise à jour internes.

Comment Google détecte-t-il une modification du robots.txt ?

Google ne surveille pas activement les modifications de votre fichier. Il revalide simplement le cache selon son propre calendrier de crawl.

Si vous modifiez robots.txt à 14h, Googlebot ne sera pas notifié instantanément. Il découvrira le changement lors de sa prochaine vérification programmée — et celle-ci peut intervenir dans quelques minutes comme dans 20 heures.

- Le cache robots.txt dure jusqu'à 24 heures, pas systématiquement 24 heures pleines

- Les modifications ne sont jamais instantanées — anticiper ce délai est crucial lors de migrations ou urgences

- Ce mécanisme protège les serveurs d'une charge excessive liée aux vérifications répétées

- Robots.txt reste la méthode la plus fiable pour contrôler le crawl malgré ce délai incompressible

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, largement. Les SEO qui ont déjà bloqué une section en urgence via robots.txt savent que l'effet n'est jamais immédiat. Le délai de 24 heures est observé régulièrement, parfois un peu moins sur des sites à crawl très fréquent.

Ce qui manque ici, c'est une précision sur les variations selon le crawl budget. Un site crawlé toutes les heures verra probablement son robots.txt rafraîchi plus vite qu'un site crawlé une fois par jour. [A vérifier] si Google applique un délai différent selon le tier du site.

Que faire quand 24 heures, c'est trop long ?

Soyons honnêtes : dans certains cas d'urgence (fuite de données sensibles, indexation accidentelle de contenus privés), 24 heures peuvent sembler une éternité.

Google propose l'outil de suppression d'URL dans Search Console pour ces situations critiques. C'est plus rapide — mais temporaire (90 jours). Pour un blocage définitif, robots.txt combiné à une balise noindex reste indispensable.

Le problème, c'est que beaucoup confondent vitesse et fiabilité. L'outil de suppression agit vite mais ne remplace pas une directive robots.txt pérenne. Les deux outils ne jouent pas dans la même catégorie.

Cette règle s'applique-t-elle à tous les crawlers ?

Gary Illyes parle ici de Googlebot uniquement. Bing, Yandex, ou les crawlers tiers (SEMrush, Ahrefs, etc.) ont leurs propres politiques de cache.

Certains crawlers tiers ignorent carrément robots.txt ou le mettent en cache bien plus longtemps. D'autres le respectent scrupuleusement mais avec des délais imprévisibles. Aucune garantie d'uniformité — et c'est un angle mort dans cette déclaration.

Impact pratique et recommandations

Que faut-il faire concrètement avant de modifier robots.txt ?

Anticipez systématiquement un délai de 24 heures minimum avant que vos modifications soient prises en compte par Google. Si vous préparez une migration ou un changement structurel, intégrez cette fenêtre dans votre planning.

Testez toujours votre fichier robots.txt avec l'outil de test robots.txt dans Search Console avant publication. Une erreur de syntaxe peut bloquer tout votre site — et vous ne le découvrirez peut-être que 24 heures plus tard.

Comment vérifier que les modifications sont bien appliquées ?

Utilisez l'outil d'inspection d'URL dans Search Console après 24-48 heures. Si Google indique que l'URL est bloquée par robots.txt alors que vous venez de la débloquer, c'est que le cache n'est pas encore rafraîchi.

Surveillez également les logs serveur. Si Googlebot continue de tenter de crawler des URLs que vous avez bloquées récemment, c'est normal pendant la période de cache. Au-delà de 48 heures, il y a probablement un problème.

Quelles erreurs éviter absolument ?

Ne comptez jamais sur robots.txt comme méthode de sécurité. Il bloque le crawl, pas l'accès direct. Les URLs restent accessibles si quelqu'un tape l'adresse complète ou clique sur un lien.

Évitez de bloquer les ressources CSS/JS via robots.txt — Google a besoin de ces fichiers pour analyser correctement le rendu des pages. Cette erreur classique peut dégrader votre évaluation Mobile-Friendly.

- Prévoir systématiquement 24-48 heures avant qu'une modification soit effective

- Tester le fichier robots.txt avec l'outil Search Console avant toute publication

- Ne jamais utiliser robots.txt comme unique protection de contenus sensibles

- Surveiller les logs serveur pour confirmer que Googlebot respecte bien les nouvelles directives

- Documenter chaque modification (date, raison, URLs concernées) pour faciliter le suivi

- Combiner robots.txt avec noindex pour un blocage définitif de l'indexation

❓ Questions frequentes

Peut-on forcer Google à rafraîchir le cache robots.txt plus rapidement ?

Le délai de 24 heures s'applique-t-il aussi aux désactivations de directives ?

Si je bloque une URL via robots.txt, disparaît-elle immédiatement de l'index Google ?

Est-ce que tous les crawlers respectent ce délai de cache de 24 heures ?

Que faire si Google crawle encore des URLs bloquées après 48 heures ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/02/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.