Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Faut-il vraiment bloquer la navigation à facettes dans robots.txt ?

- □ Les paramètres d'action dans vos URLs sabotent-ils votre crawl budget ?

- □ Pourquoi Google intervient-il directement dans le code des plugins WordPress ?

- □ Les paramètres d'URL courts mettent-ils vraiment votre crawl budget en danger ?

- □ Faut-il vraiment se débarrasser des session IDs dans vos URLs ?

- □ Pourquoi vos paramètres de calendrier WordPress sabotent-ils votre crawl budget ?

- □ Le double encodage d'URLs tue-t-il vraiment votre crawl budget ?

- □ Pourquoi Googlebot doit-il crawler massivement un nouveau site avant de savoir s'il vaut le coup ?

- □ Faut-il attendre 24 heures pour qu'une modification de robots.txt soit prise en compte ?

- □ Faut-il abandonner les paramètres GET pour sécuriser son crawl budget ?

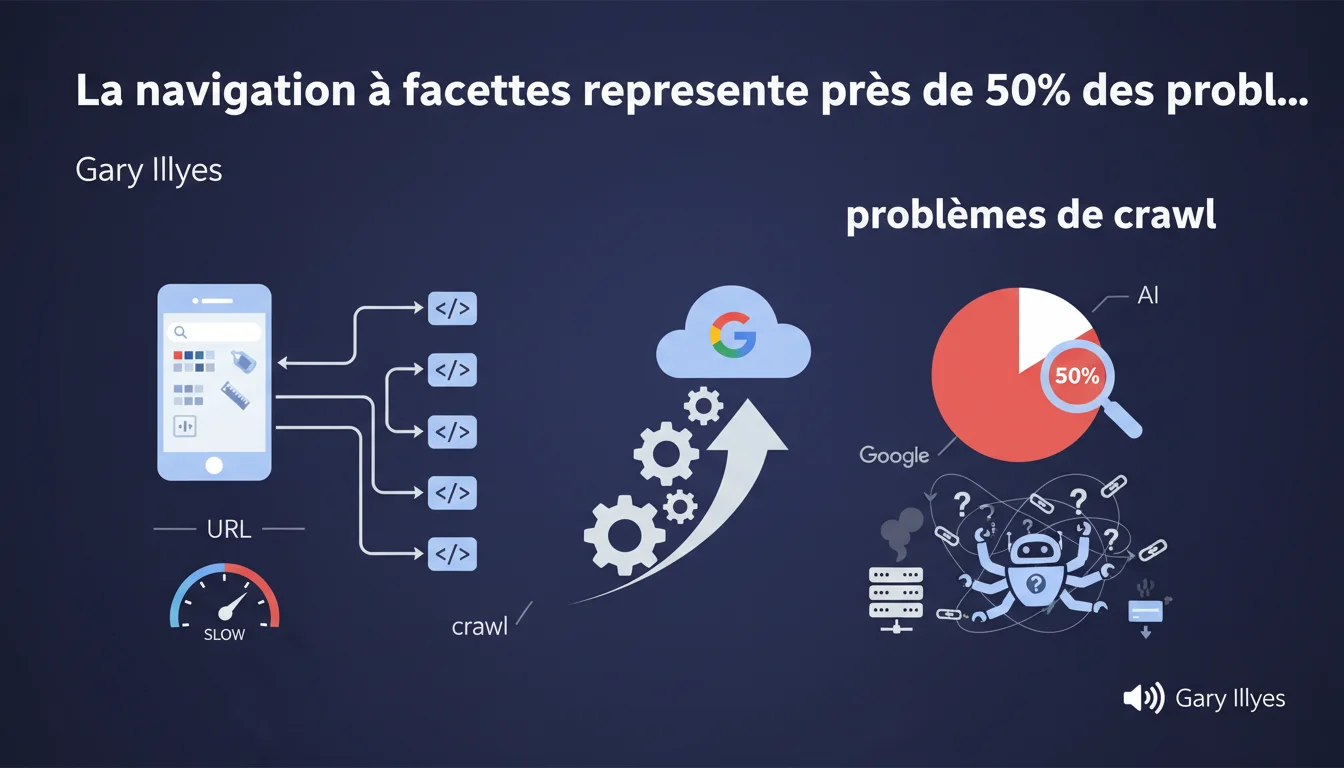

Gary Illyes révèle que la navigation à facettes représente près de 50% des rapports de problèmes de crawl reçus par Google. Les combinaisons d'URLs générées par les filtres et tris sur les sites e-commerce submergent les serveurs et forcent Googlebot à crawler un volume massif d'URLs pour déterminer leur pertinence. C'est un signal clair : la majorité des sites e-commerce ne maîtrisent toujours pas ce fondamental.

Ce qu'il faut comprendre

Qu'est-ce que la navigation à facettes et pourquoi pose-t-elle problème ?

La navigation à facettes, c'est ce système de filtres et tris qu'on retrouve sur tous les sites e-commerce. Couleur, taille, prix, marque, note client — chaque combinaison génère une URL unique. Sur un catalogue de 1000 produits avec 5 filtres à 3 options chacune, tu te retrouves potentiellement avec des centaines de milliers d'URLs.

Le problème ? Googlebot ne sait pas a priori lesquelles sont utiles. Il doit crawler massivement pour comprendre quelles pages méritent d'être indexées et lesquelles sont de simples doublons ou des combinaisons vides. Résultat : ton serveur encaisse des milliers de requêtes inutiles.

Pourquoi Google reçoit-il autant de rapports sur ce sujet spécifique ?

Parce que c'est un problème structurel récurrent. La navigation à facettes est techniquement simple à implémenter côté développement, mais catastrophique côté SEO si elle n'est pas cadrée. Les plateformes e-commerce génèrent ces URLs par défaut, sans distinction entre ce qui est pertinent et ce qui ne l'est pas.

Et soyons honnêtes — beaucoup de sites se retrouvent avec des crawls budget gaspillés, des timeout serveur, ou pire, des pages pertinentes qui ne sont jamais crawlées parce que Googlebot s'épuise sur des combinaisons de filtres absurdes.

Que signifie ce chiffre de 50% concrètement ?

Ça veut dire que sur l'ensemble des problèmes de crawl remontés à Google, la moitié concerne la navigation à facettes. C'est énorme. Ça montre que malgré des années d'articles et de recommandations, la majorité des sites e-commerce n'ont toujours pas réglé ce basique.

C'est aussi un indicateur clair : si tu gères un site avec des filtres, il y a une chance sur deux que tu aies un problème de crawl latent que tu n'as même pas détecté.

- 50% des rapports de crawl concernent les facettes — c'est le problème structurel numéro un en e-commerce

- Les combinaisons d'URLs explosent rapidement avec plusieurs filtres actifs

- Googlebot doit crawler massivement pour trier le pertinent du superflu

- Les serveurs peuvent être submergés si le volume d'URLs n'est pas maîtrisé

- Ce n'est pas un problème nouveau, mais il reste majoritairement non résolu

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, totalement. Tous les SEO qui bossent en e-commerce connaissent ce cauchemar. Tu audites un site, tu ouvres Search Console, et tu vois des milliers d'URLs crawlées qui correspondent à des combinaisons de filtres vides ou redondantes. Le crawl budget est bouffé par des pages inutiles pendant que des fiches produits stratégiques restent ignorées.

Ce qui est intéressant, c'est que Google le dit ouvertement : c'est leur premier problème remontés. Ça valide ce qu'on répète depuis des années — la navigation à facettes, si elle n'est pas pensée SEO, c'est une catastrophe technique.

Quelles nuances faut-il apporter à cette affirmation ?

Le chiffre de 50% ne signifie pas que 50% des sites ont ce problème — mais que 50% des rapports de problèmes de crawl concernent ce sujet. Nuance importante. Ça peut aussi refléter le fait que les sites e-commerce sont surreprésentés dans ces rapports, tout simplement parce qu'ils génèrent mécaniquement plus d'URLs.

Autre point : Google dit que Googlebot doit crawler pour déterminer la pertinence. Soyons clairs — c'est à nous de lui faciliter le travail. Si tu attends que Googlebot « comprenne » tout seul quelles pages sont pertinentes, tu vas attendre longtemps et gaspiller du crawl budget. Canonical, noindex, robots.txt, paramètres dans Search Console — il y a des outils pour cadrer ça proprement.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si tu gères un site vitrine ou un blog, ce problème ne te concerne probablement pas. La navigation à facettes, c'est vraiment un enjeu e-commerce, marketplaces, sites d'annonces. Tout ce qui propose des filtres multiples sur un catalogue volumineux.

Maintenant, même sur un site e-commerce de taille moyenne, si tu as bien configuré tes canonical tags et tes paramètres d'URL dans Search Console, tu peux limiter la casse. Le problème touche surtout ceux qui ont laissé filer la situation — ou qui ont un CMS qui génère tout et n'importe quoi sans garde-fou.

Impact pratique et recommandations

Que faut-il faire concrètement sur un site e-commerce ?

Première étape : identifier les combinaisons de filtres pertinentes. Toutes les pages filtrées ne se valent pas. Une page « chaussures rouges » peut avoir du volume de recherche. Une page « chaussures rouges pointure 42 en cuir avec livraison express » n'a probablement aucun intérêt SEO.

Ensuite, il faut bloquer l'indexation des combinaisons inutiles. Plusieurs méthodes : canonical vers la page mère, noindex sur les pages filtrées sans potentiel, robots.txt pour bloquer les paramètres d'URL spécifiques. Le choix dépend de ton architecture et de tes objectifs.

Quelles erreurs éviter absolument ?

L'erreur classique, c'est de tout laisser ouvert. Aucun canonical, aucun noindex, toutes les combinaisons crawlables et indexables. Résultat : ton serveur rame, ton crawl budget part en fumée, et tu te retrouves avec du contenu dupliqué massif.

Autre piège : bloquer trop agressivement dans le robots.txt. Si tu empêches Googlebot de crawler ces pages, il ne peut pas suivre les liens internes qui passent par elles. Tu risques de couper des chemins de crawl vers des pages importantes. Mieux vaut autoriser le crawl mais contrôler l'indexation avec noindex ou canonical.

Comment vérifier que mon site est bien configuré ?

Ouvre Search Console, regarde les pages crawlées mais non indexées. Si tu vois des centaines d'URLs avec des paramètres de filtres, c'est mauvais signe. Vérifie aussi les logs serveur : combien de requêtes Googlebot fait-il sur des URLs filtrées ?

Utilise aussi l'outil d'inspection d'URL pour tester quelques combinaisons. Si Google dit « URL canonique différente de celle demandée », c'est bon signe — ça veut dire que ton canonical fonctionne. Si toutes les combinaisons sont considérées comme canoniques, il y a un problème.

- Auditer les URLs filtrées crawlées dans Search Console

- Identifier les combinaisons de filtres à fort potentiel SEO vs celles inutiles

- Mettre en place des canonical tags vers les pages mères pour les combinaisons sans intérêt

- Utiliser noindex sur les pages filtrées redondantes ou vides

- Configurer les paramètres d'URL dans Search Console pour guider Googlebot

- Éviter de bloquer le crawl dans robots.txt si ça coupe des chemins de navigation interne

- Monitorer régulièrement les logs serveur pour détecter un crawl excessif

- Tester les pages filtrées avec l'outil d'inspection d'URL pour valider les canonical

❓ Questions frequentes

Dois-je bloquer toutes mes pages filtrées avec un noindex ?

Canonical ou noindex pour gérer les facettes ?

Est-ce que robots.txt suffit pour gérer le crawl des facettes ?

Comment savoir si mes facettes posent problème ?

Les paramètres d'URL dans Search Console sont-ils encore utiles ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/02/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.