Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Comment Google évalue-t-il réellement la qualité de son moteur : mesures globales ou analyse segmentée ?

- □ La pertinence topique est-elle devenue un critère SEO dépassé ?

- □ Google applique-t-il vraiment un principe d'équilibre entre types de sites dans ses résultats ?

- □ Pourquoi vos stratégies de mots-clés longue traîne sont-elles dépassées depuis l'arrivée du NLU ?

- □ Google privilégie-t-il vraiment la promotion plutôt que la pénalité ?

- □ Pourquoi Google a-t-il conçu les Featured Snippets autour de la compréhension sémantique plutôt que du matching de mots-clés ?

- □ Comment Google mesure-t-il vraiment la satisfaction des utilisateurs dans ses résultats de recherche ?

- □ E-E-A-T est-il vraiment un facteur de ranking ou juste un mythe SEO ?

- □ Pourquoi Google se méfie-t-il du volume de requêtes comme indicateur de qualité ?

- □ Les Quality Rater Guidelines sont-elles vraiment un mode d'emploi pour le SEO ?

- □ Comment Google priorise-t-il les bugs de recherche et qu'est-ce que ça change pour le SEO ?

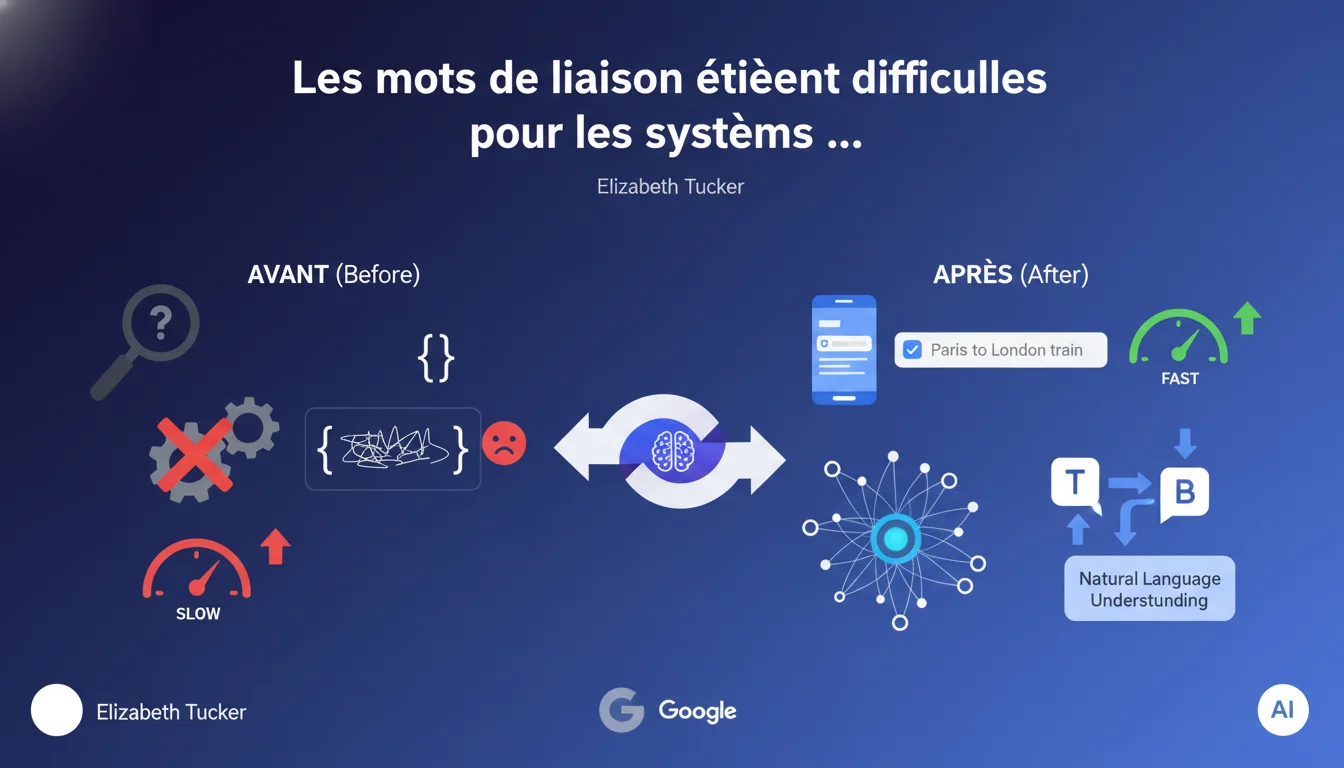

Les prépositions et mots de liaison (comme 'not') ont longtemps été le talon d'Achille des algorithmes Google. L'arrivée des modèles Transformer et BERT a révolutionné la compréhension du langage naturel, permettant enfin de saisir les nuances et négations. Pour les SEO, cela change la donne sur l'optimisation sémantique et l'intention de recherche.

Ce qu'il faut comprendre

Pourquoi les mots de liaison posaient-ils problème aux anciens systèmes Google ?

Les premiers algorithmes de Google reposaient sur une approche par correspondance de mots-clés. Un mot comme 'not' était souvent ignoré ou mal interprété, car les systèmes n'avaient pas la capacité de comprendre la négation ou le contexte global d'une phrase.

Résultat concret : une requête comme "restaurants not expensive" pouvait renvoyer des résultats pour "restaurants expensive", car l'algorithme se focalisait sur les termes principaux et écartait les prépositions jugées non significatives.

Qu'est-ce qui a changé avec Transformer et BERT ?

Les modèles Transformer introduisent une architecture qui traite les mots dans leur contexte complet, pas isolément. BERT (Bidirectional Encoder Representations from Transformers) va encore plus loin : il analyse les mots dans les deux directions — avant et après — pour saisir les nuances.

Concrètement ? Google peut désormais distinguer "voiture sans permis" de "voiture avec permis", ou "recette sans gluten" de "recette gluten". Les mots de liaison deviennent enfin déterminants dans l'interprétation de l'intention.

Quelle implication directe pour l'optimisation de contenu ?

Les contenus doivent désormais refléter les variations sémantiques réelles des requêtes utilisateurs. Si votre cible cherche "freelance sans diplôme", écrire "freelance" ne suffira plus — le qualificatif change radicalement l'intention.

Les stratégies de longue traîne prennent une dimension nouvelle : chaque mot compte, y compris ceux qu'on négligeait autrefois.

- Les mots de liaison (not, without, with, for, against, etc.) sont désormais interprétés correctement par Google

- L'architecture Transformer permet une compréhension bidirectionnelle du contexte

- BERT a marqué un tournant en traitant les nuances et négations dans les requêtes

- L'optimisation sémantique doit intégrer ces variations pour matcher l'intention réelle

- Les contenus génériques ou trop larges perdent en pertinence face à des contenus précis et contextualisés

Avis d'un expert SEO

Cette déclaration explique-t-elle vraiment pourquoi certains contenus perdent du terrain ?

Oui, et c'est un point crucial souvent sous-estimé. Les sites qui produisaient du contenu générique en ciblant uniquement les termes principaux se retrouvent dépassés. Si votre page "recettes" ignore les qualificatifs ("sans sucre", "sans cuisson", "pour débutants"), elle perd face à des contenus plus spécifiques.

On observe depuis plusieurs années que les featured snippets favorisent les réponses qui intègrent précisément les nuances de la requête. Ce n'est pas un hasard — c'est BERT en action.

Faut-il pour autant multiplier les variantes à l'infini ?

Non, et c'est là que ça coince. Certains SEO tombent dans le piège du sur-optimisation sémantique : créer 50 pages pour couvrir toutes les combinaisons de prépositions. Mauvaise idée.

Google comprend les synonymes et variations — inutile de créer une page "chaussures sans lacets", une autre "chaussures sans scratch", etc. Une seule page bien structurée, avec des sections ciblées, fait mieux le job. [A verifier] : Google n'a jamais précisé le seuil où deux variantes justifient deux pages distinctes.

Cette évolution change-t-elle vraiment la stratégie de recherche de mots-clés ?

Totalement. Les outils traditionnels (volumes de recherche, CPC) ne capturent pas les intentions nuancées. "Crédit sans apport" et "crédit avec apport" ont des volumes proches, mais des intentions radicalement différentes.

Les SEO doivent désormais croiser plusieurs sources : Search Console (requêtes réelles), People Also Ask (variations naturelles), et outils NLP pour identifier les clusters sémantiques pertinents. Les stratégies de contenu basées uniquement sur des volumes de recherche deviennent obsolètes.

Impact pratique et recommandations

Que faut-il revoir dans l'architecture de contenu existante ?

Commence par auditer tes pages piliers. Identifie les requêtes avec qualificatifs ("sans", "avec", "pour", "contre") qui génèrent du trafic mais atterrissent sur des pages généralistes. C'est là que tu perds de l'engagement.

Ensuite, restructure : crée des sections dédiées ou des FAQ qui adressent explicitement ces nuances. Une page "Formation marketing digital" devrait inclure des sections "Formation sans prérequis", "Formation avec certification", etc.

Comment identifier les opportunités de contenu à fort potentiel ?

Exploite la Search Console : filtre les requêtes par impression (>100) avec un CTR faible (<5%). Tu y trouveras souvent des variations avec prépositions que ton contenu actuel ne traite pas explicitement.

Croise avec Answer the Public ou AlsoAsked pour cartographier les questions naturelles incluant ces mots de liaison. C'est du traffic qualifié qui cherche des réponses précises.

Quelles erreurs éviter dans l'optimisation sémantique post-BERT ?

Première erreur : le keyword stuffing sémantique. Répéter "voiture sans permis" 15 fois dans 300 mots n'apporte rien. BERT comprend le contexte — écris naturellement.

Deuxième piège : négliger la cohérence thématique. Si ta page traite "crédit sans apport", tout le contenu doit rester cohérent avec cette contrainte spécifique. Pas de dérives vers le crédit classique.

- Audite les requêtes Search Console contenant des prépositions et négations

- Identifie les pages généralistes qui reçoivent du trafic sur des intentions spécifiques

- Crée des sections dédiées ou pages distinctes selon la distance sémantique

- Utilise les FAQ structurées pour adresser les variations naturelles

- Intègre les qualificatifs dans les balises title et H2 quand c'est pertinent

- Évite la cannibalisation : une variation mineure ne justifie pas toujours une page séparée

- Teste les featured snippets : reformule pour matcher précisément les requêtes avec prépositions

- Surveille le taux de rebond sur les pages généralistes : indicateur d'un mismatch d'intention

❓ Questions frequentes

BERT a-t-il remplacé tous les anciens algorithmes de Google ?

Faut-il créer une page séparée pour chaque variation avec préposition ?

Les outils de recherche de mots-clés traditionnels sont-ils obsolètes ?

Comment vérifier si mon contenu est optimisé pour BERT ?

Cette évolution favorise-t-elle les contenus longs ou courts ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 27/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.