Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Pourquoi Google avait-il tant de mal à comprendre les mots de liaison comme 'not' dans les requêtes ?

- □ Comment Google évalue-t-il réellement la qualité de son moteur : mesures globales ou analyse segmentée ?

- □ La pertinence topique est-elle devenue un critère SEO dépassé ?

- □ Google applique-t-il vraiment un principe d'équilibre entre types de sites dans ses résultats ?

- □ Pourquoi vos stratégies de mots-clés longue traîne sont-elles dépassées depuis l'arrivée du NLU ?

- □ Google privilégie-t-il vraiment la promotion plutôt que la pénalité ?

- □ Pourquoi Google a-t-il conçu les Featured Snippets autour de la compréhension sémantique plutôt que du matching de mots-clés ?

- □ E-E-A-T est-il vraiment un facteur de ranking ou juste un mythe SEO ?

- □ Pourquoi Google se méfie-t-il du volume de requêtes comme indicateur de qualité ?

- □ Les Quality Rater Guidelines sont-elles vraiment un mode d'emploi pour le SEO ?

- □ Comment Google priorise-t-il les bugs de recherche et qu'est-ce que ça change pour le SEO ?

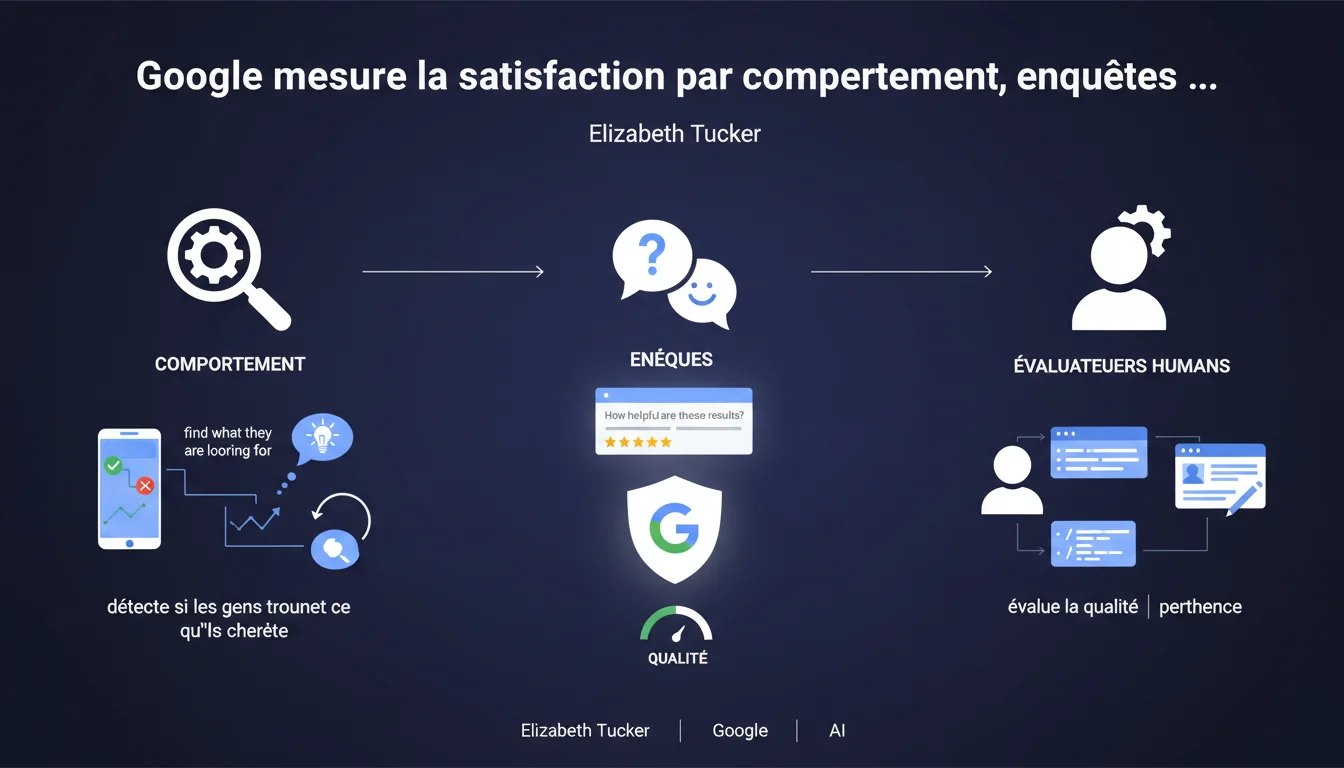

Google combine trois approches pour évaluer la qualité de ses résultats : des sondages utilisateurs directs, une équipe d'évaluateurs humains qui jugent la pertinence sur des échantillons de requêtes, et l'analyse comportementale pour détecter si les internautes trouvent effectivement ce qu'ils cherchent. Ces trois axes influencent directement le classement — ce n'est pas qu'une histoire d'algorithme aveugle.

Ce qu'il faut comprendre

Quelles sont ces trois méthodes d'évaluation concrètement ?

Google utilise d'abord des sondages directs affichés dans les SERP, notamment la question "How helpful are these results?". Ces micro-enquêtes captent la perception immédiate de l'utilisateur sur la qualité des résultats proposés.

Ensuite, une armée d'évaluateurs humains (les fameux Quality Raters) travaille sur des échantillons de requêtes. Ils appliquent les Search Quality Rater Guidelines pour juger si les pages répondent réellement à l'intention de recherche. Ces données servent à entraîner et ajuster les algorithmes.

Enfin, l'analyse comportementale : Google observe comment les utilisateurs interagissent avec les résultats. Clics, retours arrière rapides (pogo-sticking), temps passé, reformulations de requête — autant de signaux qui révèlent si quelqu'un a trouvé satisfaction ou non.

Pourquoi Google combine-t-il autant de sources ?

Parce qu'aucune métrique isolée ne dit toute la vérité. Un CTR élevé peut simplement signaler un titre clickbait — pas forcément de la qualité. Un long temps de visite peut indiquer de l'engagement... ou de la confusion totale sur une page mal conçue.

En croisant ces trois dimensions, Google construit une image plus fiable de ce qui satisfait vraiment les utilisateurs. C'est aussi un garde-fou contre les manipulations : difficile de tromper simultanément des humains formés, des utilisateurs réels et des patterns comportementaux cohérents.

Qu'est-ce que ça change pour un site qui cherche à ranker ?

Ça signifie qu'optimiser uniquement pour l'algorithme ne suffit plus — si tant est que ça ait jamais suffi. Google évalue la satisfaction réelle, pas juste la conformité technique ou sémantique.

Un contenu peut cocher toutes les cases SEO classiques (mots-clés, structure, backlinks) et pourtant générer des signaux comportementaux négatifs si l'expérience déçoit. À l'inverse, une page qui répond parfaitement à l'intention, même sans optimisation poussée, peut surperformer grâce aux retours positifs des utilisateurs et évaluateurs.

- Google ne se fie pas qu'aux machines : l'humain reste au cœur de l'évaluation qualité

- Les sondages utilisateurs influencent directement la perception de Google sur la pertinence des SERP

- L'analyse comportementale détecte les signaux de satisfaction ou d'insatisfaction post-clic

- Ces trois méthodes se renforcent mutuellement pour contrer les manipulations SEO

- Un contenu techniquement parfait mais qui déçoit l'utilisateur ne tiendra pas dans la durée

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, et ça explique beaucoup de choses. Les SEO expérimentés ont depuis longtemps constaté que des pages avec taux de rebond élevé et temps de visite faible perdent progressivement des positions — même avec un profil de liens solide et un contenu dense en mots-clés.

La présence d'évaluateurs humains n'est pas nouvelle, mais Google insiste désormais ouvertement sur leur rôle. Ça confirme que les Search Quality Rater Guidelines ne sont pas juste un document de communication : c'est un vrai cahier des charges qui oriente l'entraînement des algorithmes. Comprendre ces guidelines devient donc indispensable — pas optionnel.

Quelles zones d'ombre subsistent dans cette explication ?

Google reste volontairement flou sur le poids exact de chaque méthode. Est-ce que les sondages "How helpful" ont un impact direct sur le classement d'une page précise, ou servent-ils seulement à calibrer l'algorithme globalement ? [À vérifier]

L'analyse comportementale pose aussi question : quels signaux précis sont suivis ? Le dwell time ? Le taux de reformulation de requête ? Le ratio clic/retour immédiat ? Google ne le précise jamais officiellement — et pour cause, dévoiler ces métriques ouvrirait la porte à des manipulations massives.

Cette approche multi-sources crée-t-elle de nouveaux angles d'optimisation ?

Absolument. Si Google mesure la satisfaction par comportement ET sondages ET évaluateurs humains, ça signifie qu'il faut optimiser pour l'expérience post-clic, pas juste pour le clic lui-même.

Concrètement : un titre accrocheur mais trompeur peut générer du CTR, mais si les utilisateurs repartent aussitôt déçus, Google captera ces signaux négatifs. Idem pour un contenu techniquement irréprochable mais illisible, mal structuré ou qui ne répond pas vraiment à l'intention — les Quality Raters le sanctionneront dans leurs évaluations.

Ça valorise les sites qui bossent vraiment l'UX, la clarté informationnelle, la rapidité de réponse à l'intention. Pas juste le bourrage de mots-clés ou l'achat de liens.

Impact pratique et recommandations

Que faut-il modifier concrètement dans sa stratégie SEO ?

Commence par auditer l'expérience utilisateur sur tes pages les plus stratégiques. Utilise des outils comme Hotjar ou Crazy Egg pour observer les comportements réels : où les gens cliquent, jusqu'où ils scrollent, où ils partent.

Ensuite, croise avec les données Search Console : si une page a un bon CTR mais un mauvais positionnement qui stagne ou recule, c'est probablement que l'expérience post-clic déçoit. Google capte ces signaux et ajuste en conséquence.

Améliore la clarté de la réponse dès les premiers écrans. L'utilisateur doit comprendre immédiatement qu'il est au bon endroit et que sa réponse arrive. Pas de blabla introductif interminable — surtout sur mobile.

Comment aligner son contenu avec les attentes des Quality Raters ?

Plonge-toi dans les Search Quality Rater Guidelines. C'est un pavé de 170 pages, mais c'est LA référence pour comprendre ce que Google considère comme un contenu de qualité.

Focus particulier sur les concepts E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness). Si ton contenu touche à la santé, la finance, le droit — les fameuses YMYL (Your Money Your Life) —, ces critères sont encore plus scrutés.

Ajoute des signaux d'autorité explicites : auteur identifié avec biographie, sources citées, dates de mise à jour visibles, contact facilement accessible. Ces éléments rassurent à la fois les évaluateurs humains et les utilisateurs.

Quelles erreurs critiques faut-il éviter absolument ?

- Sacrifier la lisibilité pour bourrer des mots-clés — les évaluateurs humains détectent instantanément le contenu artificiel

- Utiliser des titres clickbait qui ne correspondent pas au contenu réel — ça génère du pogo-sticking massif

- Négliger le mobile : une majorité d'utilisateurs consultent depuis un smartphone, et une mauvaise UX mobile plombe les signaux comportementaux

- Ignorer les Core Web Vitals : une page lente ou instable génère de la frustration, donc des signaux négatifs mesurables

- Publier du contenu superficiel ou générique qui ne répond pas vraiment à l'intention — les Quality Raters sont formés pour détecter le "thin content" déguisé

- Cacher les informations importantes derrière des popups ou des murs de contenu — Google pénalise les intrusive interstitials

Google ne se contente plus d'analyser des signaux techniques. La satisfaction utilisateur mesurée concrètement — via sondages, évaluateurs formés et comportements observables — est désormais au cœur du classement.

Ça exige une approche SEO plus mature : optimiser pour l'expérience réelle, pas juste pour l'algorithme. Auditer régulièrement ce qui se passe post-clic. Aligner le contenu avec les attentes des Quality Raters. Traquer impitoyablement tout ce qui génère de la frustration utilisateur.

Ces optimisations croisées — technique, contenu, UX, signaux comportementaux — peuvent vite devenir complexes à orchestrer seul, surtout sur des sites d'envergure. Si tu veux structurer une approche cohérente qui prend en compte ces différentes dimensions, l'accompagnement par une agence SEO spécialisée peut t'aider à prioriser les chantiers et éviter les impasses.

❓ Questions frequentes

Les sondages 'How helpful are these results' influencent-ils directement le classement d'une page ?

Peut-on accéder aux évaluations des Quality Raters sur son propre site ?

Quels signaux comportementaux Google utilise-t-il concrètement ?

Un site peut-il bien ranker malgré des signaux comportementaux négatifs ?

Les Quality Raters peuvent-ils pénaliser directement un site ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 27/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.