Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Pourquoi Google avait-il tant de mal à comprendre les mots de liaison comme 'not' dans les requêtes ?

- □ Comment Google évalue-t-il réellement la qualité de son moteur : mesures globales ou analyse segmentée ?

- □ La pertinence topique est-elle devenue un critère SEO dépassé ?

- □ Google applique-t-il vraiment un principe d'équilibre entre types de sites dans ses résultats ?

- □ Pourquoi vos stratégies de mots-clés longue traîne sont-elles dépassées depuis l'arrivée du NLU ?

- □ Google privilégie-t-il vraiment la promotion plutôt que la pénalité ?

- □ Pourquoi Google a-t-il conçu les Featured Snippets autour de la compréhension sémantique plutôt que du matching de mots-clés ?

- □ Comment Google mesure-t-il vraiment la satisfaction des utilisateurs dans ses résultats de recherche ?

- □ E-E-A-T est-il vraiment un facteur de ranking ou juste un mythe SEO ?

- □ Pourquoi Google se méfie-t-il du volume de requêtes comme indicateur de qualité ?

- □ Les Quality Rater Guidelines sont-elles vraiment un mode d'emploi pour le SEO ?

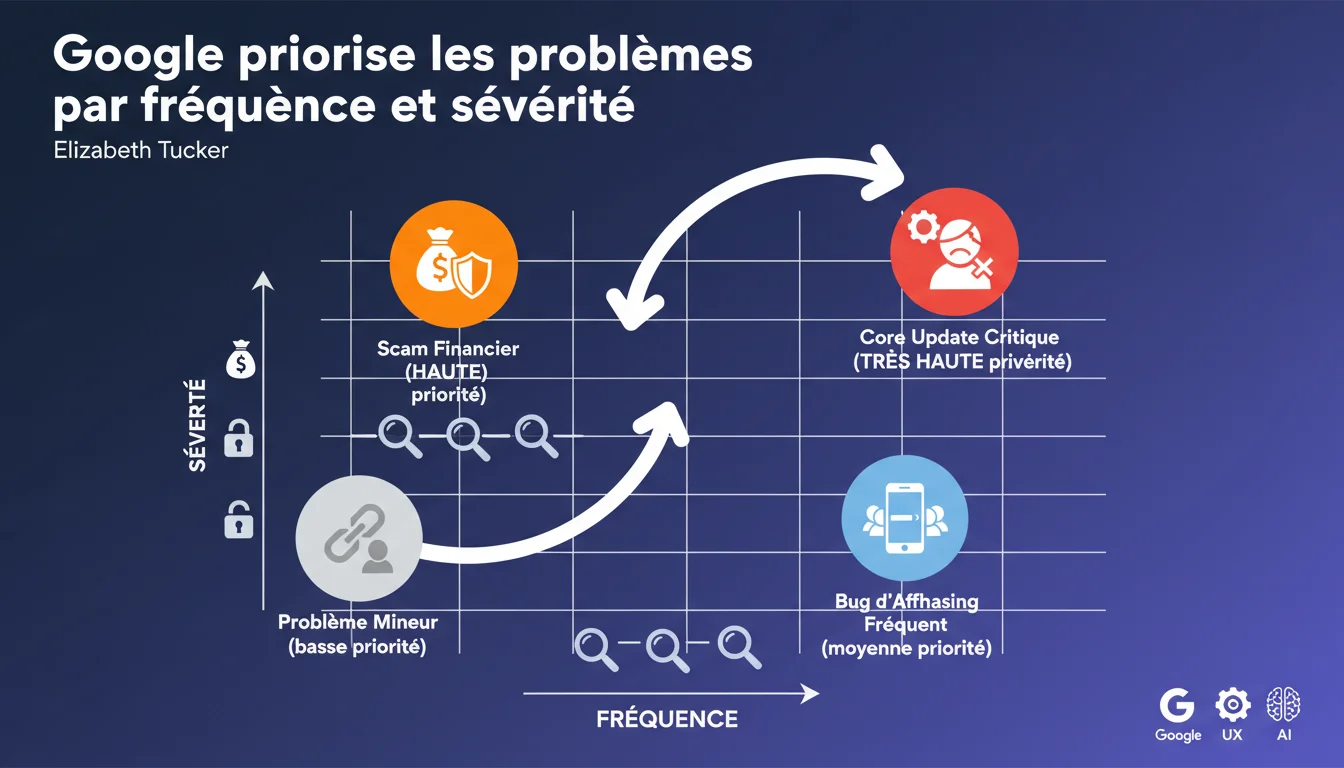

Google classe ses corrections de bugs selon deux critères : la fréquence (nombre d'utilisateurs touchés) et la sévérité (gravité de l'impact). Un problème rare mais grave, comme un scam financier, passera devant un bug fréquent mais mineur. Pour le SEO, ça veut dire qu'un problème technique affectant peu de pages mais critiques peut être traité avant un dysfonctionnement généralisé mais bénin.

Ce qu'il faut comprendre

Pourquoi Google adopte-t-il cette logique de priorisation ?

Chaque jour, Google reçoit des milliers de signalements de bugs — problèmes d'indexation, résultats erronés, featured snippets mal attribués, pages disparues sans raison. Impossible de tout traiter simultanément.

La matrice fréquence/sévérité permet de trier rationnellement. Un bug qui touche 0,01 % des requêtes mais expose des utilisateurs à des arnaques financières monte au sommet de la liste. À l'inverse, un glitch visuel présent sur 5 % des résultats mais sans conséquence concrète attendra.

Qu'est-ce que ça implique concrètement pour un site web ?

Si ton site subit un problème d'indexation rare mais bloquant — mettons, une page stratégique invisible depuis trois semaines alors que le reste se porte bien — ne compte pas sur une résolution rapide. Google jugera probablement l'impact global faible.

En revanche, si ce même problème affecte des milliers de sites simultanément (désindexation massive après une mise à jour), la fréquence grimpe et Google réagit. C'est pour ça qu'on voit parfois des correctifs déployés en 48h pour des bugs généralisés, et rien pendant des mois sur des cas isolés.

Quels sont les critères exacts de sévérité selon Google ?

Google reste volontairement flou sur les seuils. On sait que la sévérité inclut : exposition à du contenu dangereux, perte de revenus pour des sites légitimes, dégradation de l'expérience utilisateur critique.

Mais aucune grille de notation publique. Un problème d'indexation coûtant 10 000 € par jour à un e-commerce sera-t-il jugé « sévère » ? Probablement pas si un seul site est touché. C'est là que le bât blesse : la perception de sévérité est asymétrique entre Google (qui pense écosystème) et les webmasters (qui pensent survie).

- Fréquence : nombre d'utilisateurs ou de requêtes affectés, pas seulement le nombre de sites

- Sévérité : impact sur la sécurité, la fiabilité des résultats, l'intégrité financière

- Scams et contenus dangereux sont toujours prioritaires, même si rares

- Les bugs purement cosmétiques ou affectant des niches ultra-spécifiques passent en queue

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. On constate effectivement que certains bugs massifs — comme la désindexation accidentelle de millions de pages en mars dernier — sont corrigés en quelques jours. Mais côté « sévérité », c'est plus discutable.

Des sites victimes de negative SEO via du spam massif ou des attaques de contenu dupliqué attendent parfois des mois avant que Google ne réagisse, alors que l'impact financier est catastrophique pour eux. Google semble définir « sévère » à l'échelle de l'écosystème global, pas à l'échelle d'un site individuel. [A vérifier] : existe-t-il un seuil chiffré de sites affectés pour qu'un bug devienne « fréquent » ?

Quelles nuances faut-il apporter à cette logique ?

La déclaration ne précise pas comment Google mesure la fréquence. Est-ce le nombre de sites ? Le volume de requêtes ? Le trafic perdu ? Un bug touchant 100 petits blogs et un autre touchant 5 sites générant 10 millions de sessions par mois — lequel est « plus fréquent » ?

Autre point : Google utilise le terme « scams financiers » comme exemple de sévérité maximale. OK, mais qu'en est-il des contenus médicaux erronés, des fausses informations en période électorale, ou des résultats biaisés pour des requêtes sensibles ? La hiérarchie de sévérité n'est jamais rendue publique.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Quand un problème touche un site de très forte autorité ou un partenaire stratégique (presse majeure, institutions), la réactivité est souvent supérieure — même si officiellement, Google nie tout traitement préférentiel. Coincidence statistique ? Peut-être. Mais les observations suggèrent le contraire.

Également, si un bug génère une couverture médiatique négative ou un tollé sur les réseaux sociaux, la « sévérité » grimpe artificiellement. Google a corrigé des problèmes mineurs en 24h simplement parce qu'ils devenaient un cauchemar en relations publiques.

Impact pratique et recommandations

Que faut-il faire concrètement face à un problème d'indexation ou de ranking ?

D'abord, documenter massivement. Si tu remontes un bug via Search Console ou les forums officiels, prouve que le problème est fréquent : captures d'écran, URLs affectées, données Analytics montrant la chute de trafic, témoignages d'autres sites.

Plus tu démontres que d'autres sont touchés, plus tu augmentes la « fréquence » perçue — et donc tes chances que Google intervienne. Un signalement isolé sans contexte finit à la poubelle.

Quelles erreurs éviter quand on signale un problème à Google ?

Ne te contente pas de dire « mon site a disparu ». Chiffre l'impact : nombre de pages désindexées, volume de trafic perdu, durée du problème. Google réagit aux données, pas aux émotions.

Évite aussi de diluer ton signalement avec des hypothèses non vérifiées (« c'est sûrement un bug de Googlebot »). Reste factuel. Si tu suspectes un problème côté Google, montre que toutes les causes côté site ont été écartées : crawl budget OK, robots.txt propre, sitemap à jour, temps de réponse corrects.

- Compiler une liste précise des URLs affectées avec dates et symptômes

- Vérifier que le problème n'est pas causé par une erreur technique interne (logs serveur, redirections, canonicals)

- Chercher si d'autres sites rapportent le même problème (forums, Twitter, communautés SEO)

- Documenter l'impact chiffré : trafic perdu, pages désindexées, revenus affectés

- Signaler via les canaux officiels (Search Console, formulaires de feedback) avec des données solides

- Préparer un plan de contournement : pages alternatives, redirections temporaires, communication utilisateurs

Comment anticiper les priorités de Google pour éviter les mauvaises surprises ?

Accepte que les bugs rares mais graves pour toi ne seront probablement pas corrigés rapidement. Si ton business repose sur une poignée de pages critiques, diversifie tes sources de trafic : SEA, social, email, direct.

Investis dans une infrastructure technique robuste : monitoring temps réel, alertes automatiques sur les chutes d'indexation, sauvegardes régulières des positions, logs d'accès pour tracer les passages de Googlebot. Plus tu détectes tôt, plus tu limites les dégâts.

❓ Questions frequentes

Comment Google mesure-t-il la fréquence d'un bug de recherche ?

Un problème d'indexation grave sur mon site sera-t-il traité rapidement par Google ?

Pourquoi certains bugs sont-ils corrigés en 48h et d'autres ignorés pendant des mois ?

Que signifie concrètement la notion de 'sévérité' pour Google ?

Comment maximiser mes chances que Google traite mon signalement de bug ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 27/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.