Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Pourquoi Google avait-il tant de mal à comprendre les mots de liaison comme 'not' dans les requêtes ?

- □ Comment Google évalue-t-il réellement la qualité de son moteur : mesures globales ou analyse segmentée ?

- □ Google applique-t-il vraiment un principe d'équilibre entre types de sites dans ses résultats ?

- □ Pourquoi vos stratégies de mots-clés longue traîne sont-elles dépassées depuis l'arrivée du NLU ?

- □ Google privilégie-t-il vraiment la promotion plutôt que la pénalité ?

- □ Pourquoi Google a-t-il conçu les Featured Snippets autour de la compréhension sémantique plutôt que du matching de mots-clés ?

- □ Comment Google mesure-t-il vraiment la satisfaction des utilisateurs dans ses résultats de recherche ?

- □ E-E-A-T est-il vraiment un facteur de ranking ou juste un mythe SEO ?

- □ Pourquoi Google se méfie-t-il du volume de requêtes comme indicateur de qualité ?

- □ Les Quality Rater Guidelines sont-elles vraiment un mode d'emploi pour le SEO ?

- □ Comment Google priorise-t-il les bugs de recherche et qu'est-ce que ça change pour le SEO ?

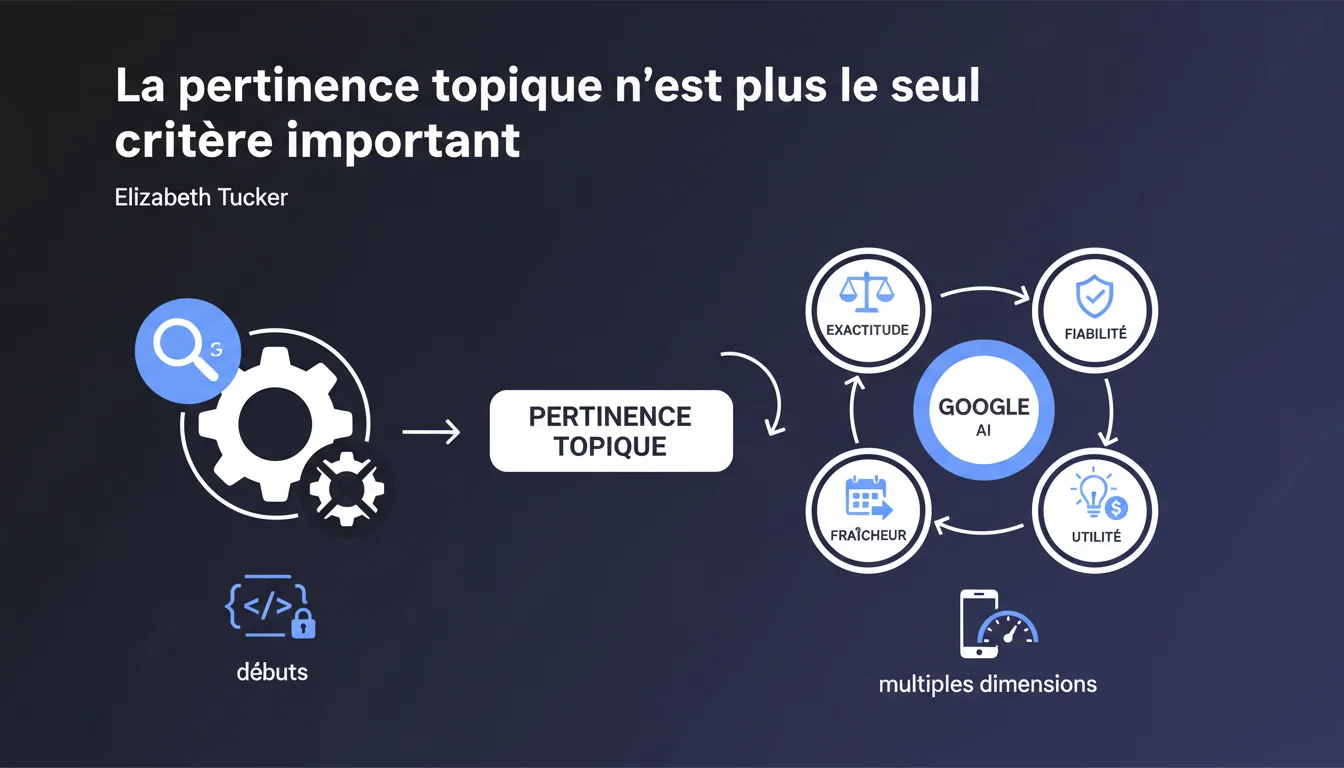

Google affirme que la pertinence thématique ne suffit plus à ranker. Le moteur évalue maintenant l'exactitude, la fiabilité, la fraîcheur et l'utilité réelle des contenus. Une déclaration qui repositionne fondamentalement les priorités SEO au-delà du simple match sémantique.

Ce qu'il faut comprendre

Pourquoi Google remet-il en question la pertinence topique ?

La pertinence thématique a longtemps été le critère dominant pour comprendre et classer les pages. Pendant des années, l'enjeu principal était de déterminer si un document répondait à l'intention de recherche d'un point de vue sémantique.

Google reconnaît aujourd'hui que ce paradigme est insuffisant. Un contenu peut être parfaitement optimisé sur le plan topique tout en étant truffé d'inexactitudes, obsolète ou simplement inutile à l'utilisateur. La déclaration marque un glissement vers des critères qualitatifs multidimensionnels.

Quels sont ces nouveaux critères qui complètent la pertinence topique ?

Elizabeth Tucker liste quatre dimensions : exactitude (les informations sont-elles factuellement correctes ?), fiabilité (la source est-elle digne de confiance ?), fraîcheur (le contenu est-il à jour ?), et utilité (apporte-t-il une vraie valeur ajoutée ?).

Ces critères ne sont pas nouveaux en soi — ils font écho aux E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) et aux concepts de Helpful Content. Ce qui change, c'est la hiérarchie : la pertinence topique devient une condition nécessaire mais non suffisante.

Comment Google mesure-t-il ces dimensions en pratique ?

La déclaration reste délibérément floue sur les mécanismes techniques. On sait que Google utilise des signaux indirects — comportement utilisateur, citations externes, consensus scientifique, historique de mises à jour — mais aucun algorithme spécifique n'est mentionné.

Les modèles de langage (LLM) jouent probablement un rôle croissant dans l'évaluation de la cohérence factuelle et de l'utilité perçue, mais Google ne détaille pas leur implémentation dans le ranking. [À vérifier]

- La pertinence topique reste un prérequis, pas une garantie de visibilité

- Google évalue désormais quatre dimensions qualitatives : exactitude, fiabilité, fraîcheur, utilité

- Ces critères s'alignent avec les principes E-E-A-T et Helpful Content

- Les mécanismes de mesure restent opaques et reposent sur des signaux indirects

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment les observations terrain ?

Oui, mais avec des nuances importantes. On observe depuis plusieurs Core Updates que des contenus parfaitement optimisés sur le plan sémantique perdent des positions au profit de pages moins denses mais mieux sourcées ou plus récentes.

Le problème ? Google ne définit pas d'échelle de mesure. Qu'est-ce qu'un contenu « exact » ou « utile » ? Ces notions restent subjectives et contextuelles. Un article médical nécessite des sources académiques, un tuto bricolage valorise l'expérience personnelle. La déclaration passe sous silence ces variations sectorielles.

Quels secteurs sont les plus impactés par ce changement de paradigme ?

Les verticales YMYL (santé, finance, juridique) sont les premières concernées. L'exactitude et la fiabilité y deviennent des filtres quasi-binaires : un contenu inexact est sanctionné, peu importe sa qualité sémantique.

En revanche, dans les requêtes informationnelles génériques ou les contenus d'opinion, la pertinence topique conserve un poids majeur. Un blog lifestyle peut ranker sans sourcing académique si l'utilité perçue est forte. [À vérifier] : Google applique-t-il vraiment une pondération différenciée selon la requête ou reste-t-on sur un modèle uniforme ?

Cette déclaration cache-t-elle une difficulté technique de Google ?

Probablement. Évaluer l'exactitude ou l'utilité à l'échelle du web est infiniment plus complexe que de calculer un TF-IDF. Google s'appuie sur des signaux imparfaits : clics, temps de session, liens externes.

Le risque ? Que le moteur confonde popularité et exactitude. Un contenu viral mais factuellement faux peut générer des signaux comportementaux positifs à court terme. Google ne précise pas comment il arbitre ces contradictions — et c'est un angle mort majeur.

Impact pratique et recommandations

Que faut-il modifier concrètement dans sa stratégie de contenu ?

Arrête de croire qu'un champ sémantique exhaustif suffit. Un article de 3000 mots bourré de keywords mais sans source ni mise à jour récente devient une cible vulnérable. Privilégie la densité d'information vérifiable plutôt que le volume.

Ajoute systématiquement des dates de publication et de révision visibles. Si ton contenu traite d'un sujet évolutif (techno, réglementation, santé), planifie des mises à jour semestrielles. Google valorise explicitement la fraîcheur — ne le laisse pas deviner.

Comment renforcer l'exactitude et la fiabilité perçues par Google ?

Cite des sources primaires : études, rapports officiels, bases de données. Les liens externes vers des sites autoritaires ne diluent pas ton PageRank — ils renforcent ta crédibilité contextuelle.

Identifie clairement les auteurs et leurs qualifications. Un article médical signé par un médecin avec lien vers son profil professionnel envoie des signaux E-E-A-T forts. Un contenu anonyme, même excellent, part avec un handicap.

Quelles erreurs éviter face à ces nouveaux critères ?

Ne sacrifie pas la pertinence topique sous prétexte de privilégier l'exactitude. Les deux sont cumulatifs, pas alternatifs. Un contenu hors-sujet mais « fiable » ne rankera pas non plus.

Évite les signaux contradictoires : un article daté de trois ans avec une mention « mis à jour récemment » mais aucun changement visible dans le contenu. Google détecte ces incohérences via les archives et les variations de crawl.

- Auditer les contenus existants : identifier ceux qui manquent de sources, de dates ou d'auteurs identifiés

- Prioriser les mises à jour sur les pages YMYL et celles qui ont perdu du trafic récemment

- Ajouter des références externes crédibles dans chaque article (minimum 2-3 liens vers des sources autoritaires)

- Implémenter un calendrier de révision automatique pour les contenus datés

- Structurer les pages auteurs avec bio détaillée et liens professionnels (LinkedIn, publications, certifications)

- Surveiller les métriques comportementales (temps de session, taux de rebond) pour détecter les signaux d'utilité perçue

❓ Questions frequentes

La pertinence topique ne compte-t-elle vraiment plus pour le ranking ?

Comment Google mesure-t-il l'exactitude d'un contenu ?

Les backlinks restent-ils importants dans ce nouveau paradigme ?

Faut-il privilégier du contenu court et précis ou long et exhaustif ?

Cette déclaration annonce-t-elle un algorithme spécifique à venir ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 27/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.