Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Pourquoi Google avait-il tant de mal à comprendre les mots de liaison comme 'not' dans les requêtes ?

- □ La pertinence topique est-elle devenue un critère SEO dépassé ?

- □ Google applique-t-il vraiment un principe d'équilibre entre types de sites dans ses résultats ?

- □ Pourquoi vos stratégies de mots-clés longue traîne sont-elles dépassées depuis l'arrivée du NLU ?

- □ Google privilégie-t-il vraiment la promotion plutôt que la pénalité ?

- □ Pourquoi Google a-t-il conçu les Featured Snippets autour de la compréhension sémantique plutôt que du matching de mots-clés ?

- □ Comment Google mesure-t-il vraiment la satisfaction des utilisateurs dans ses résultats de recherche ?

- □ E-E-A-T est-il vraiment un facteur de ranking ou juste un mythe SEO ?

- □ Pourquoi Google se méfie-t-il du volume de requêtes comme indicateur de qualité ?

- □ Les Quality Rater Guidelines sont-elles vraiment un mode d'emploi pour le SEO ?

- □ Comment Google priorise-t-il les bugs de recherche et qu'est-ce que ça change pour le SEO ?

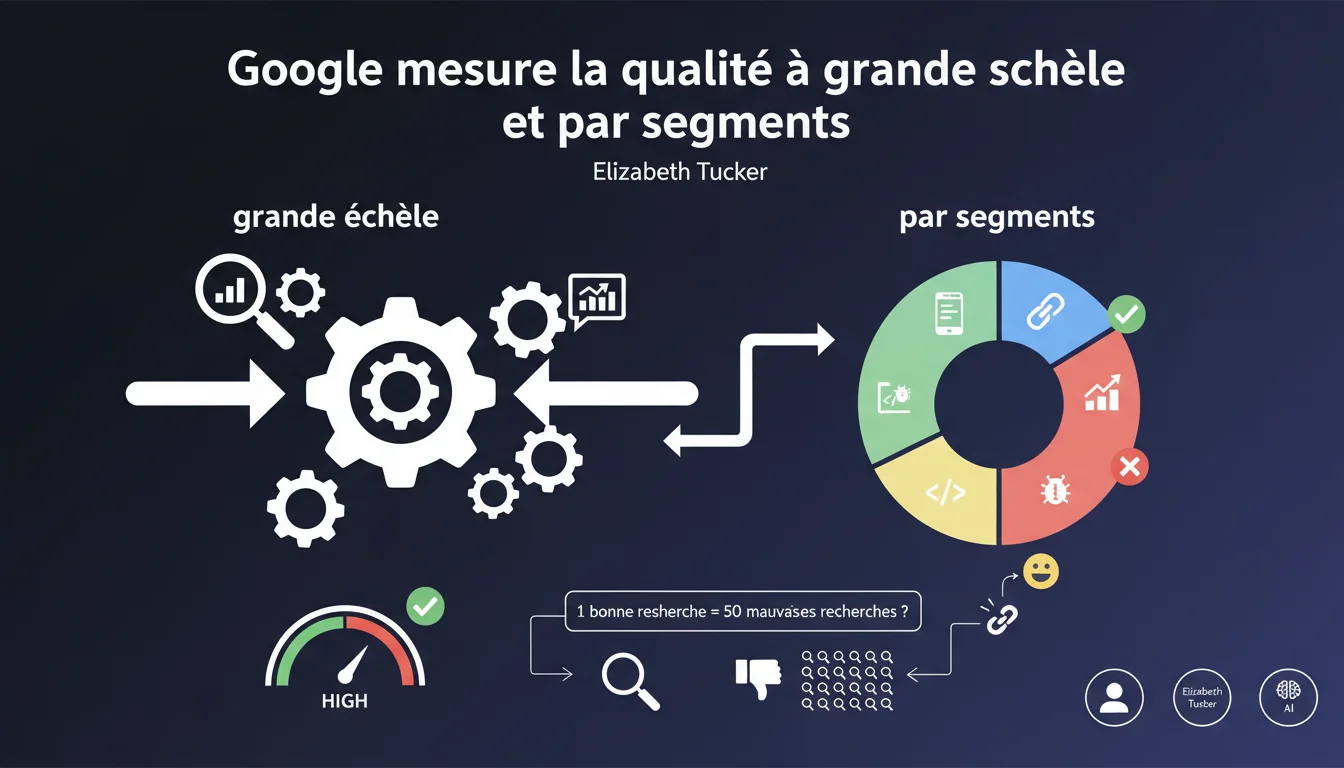

Google ne se contente pas de mesures agrégées pour juger de la performance de son moteur. Il identifie aussi des segments spécifiques de recherches — certains fonctionnent bien, d'autres non. L'arbitrage est permanent : améliorer un type de requête peut dégrader 50 autres. Cette logique d'équilibre segmenté explique pourquoi certaines mises à jour d'algorithme semblent contradictoires selon les niches.

Ce qu'il faut comprendre

Que signifie concrètement "mesurer la qualité à grande échelle" ?

Google opère sur des milliards de requêtes quotidiennes. Les mesures agrégées lui permettent de suivre des indicateurs macro : taux de clics, temps avant rebond, reformulations, satisfaction globale. Ces métriques donnent une vue d'ensemble sur la santé du moteur.

Mais cette approche globale masque les disparités. Une moyenne peut être excellente alors que des segments entiers de requêtes — une industrie, une intention, un format — sous-performent. Google doit donc zoomer sur ces poches de qualité médiocre pour corriger le tir.

Pourquoi segmenter l'analyse par type de recherche ?

Toutes les requêtes ne sont pas égales. Une recherche informationnelle, une requête locale, une question produit ou une recherche d'images ne sollicitent pas les mêmes signaux de classement. Les attentes utilisateurs varient radicalement.

En isolant ces segments, Google peut ajuster ses algorithmes de manière chirurgicale. Par exemple, renforcer la fraîcheur pour les actualités sans pénaliser les contenus evergreen. Ou valoriser les avis utilisateurs pour les requêtes commerciales sans polluer les résultats académiques.

Pourquoi améliorer une recherche en détériore-t-il cinquante autres ?

C'est le cœur du problème : les signaux de classement sont interconnectés. Modifier le poids d'un critère pour un segment crée des effets de bord ailleurs. Favoriser les sites autoritaires pour les requêtes médicales peut écraser les contenus de niche pertinents sur d'autres sujets.

Google doit arbitrer en permanence. Chaque ajustement est un compromis entre segments gagnants et perdants. L'objectif n'est pas la perfection partout, mais un équilibre acceptable sur l'ensemble du spectre de recherche.

- Google combine mesures globales (vue macro) et analyse segmentée (vue micro)

- Chaque type de requête a ses propres critères de qualité et signaux prioritaires

- Améliorer un segment peut dégrader d'autres segments par effet de bord

- Les mises à jour d'algorithme sont des arbitrages permanents entre gains et pertes sectorielles

- La cohérence parfaite sur tous les segments est structurellement impossible

Avis d'un expert SEO

Cette logique explique-t-elle les variations erratiques post-mises à jour ?

Absolument. Sur le terrain, on observe régulièrement des sites qui gagnent 30% de trafic sur certaines requêtes et en perdent 40% sur d'autres — lors de la même mise à jour. Ce n'est pas du hasard, c'est l'arbitrage en action.

Google optimise pour des segments de recherche, pas pour des sites. Si ton site couvre plusieurs niches ou intentions, tu peux être gagnant sur l'une et perdant sur l'autre. Les analyses post-update qui se contentent de dire "mon trafic global a baissé de 10%" passent à côté de l'essentiel : quels segments ont bougé, et pourquoi.

Peut-on anticiper sur quels segments Google va arbitrer ?

[A vérifier] — Google ne communique jamais ses priorités segmentaires à l'avance. On peut observer des tendances : renforcement des contenus E-E-A-T sur YMYL, valorisation des pages produits riches, promotion des contenus vidéo sur certaines intentions.

Mais prédire quel segment sera sacrifié pour en améliorer un autre relève de la spéculation. Les Quality Raters Guidelines donnent des indices, mais elles décrivent un idéal, pas les compromis techniques nécessaires pour l'atteindre à grande échelle.

Faut-il en conclure que Google favorise certains segments au détriment d'autres ?

Oui, mais pas par malveillance — par nécessité technique. Google ne peut pas optimiser tous les segments simultanément avec la même intensité. Il priorise ceux où la satisfaction utilisateur est la plus dégradée, ou ceux qui génèrent le plus de volume.

Concretement ? Les recherches commerciales, locales et informationnelles mainstream reçoivent plus d'attention que les niches spécialisées ou les long-tail obscures. Si ton site opère sur des segments "secondaires" pour Google, attends-toi à plus de volatilité inexpliquée — tu subis les effets de bord d'optimisations pensées pour d'autres requêtes.

Impact pratique et recommandations

Que faut-il faire concrètement pour s'adapter à cette logique segmentée ?

Arrête de penser "mon site" et commence à penser "mes segments de requêtes". Découpe ton trafic par intention (informationnelle, commerciale, navigationnelle), par format (article, fiche produit, guide), par niche thématique.

Identifie quels segments sont stratégiquement critiques pour ton business. Concentre tes efforts SEO sur ceux-là — contenu, signaux E-E-A-T, optimisations techniques. Les autres segments peuvent être maintenus en mode "pilote automatique" avec un effort minimal.

Comment détecter si une mise à jour a joué en ta faveur ou défaveur sur un segment ?

Ne te contente pas de suivre le trafic global. Segmente tes Search Console data par cluster de requêtes. Compare les impressions, clics et positions moyennes avant/après update pour chaque cluster.

Si un segment chute brutalement alors que d'autres restent stables ou progressent, c'est que Google a modifié ses critères pour ce type de recherche — et que ton contenu ne répond plus aux nouveaux standards. Investigue : nouveaux concurrents mieux positionnés ? Changement de format de SERP ? Signal manquant ?

Quelles erreurs éviter face à cette réalité d'arbitrage ?

- Ne pas diluer tes efforts SEO uniformément sur tous les segments — priorise ceux à fort ROI

- Ne pas paniquer si un segment perd du trafic alors que d'autres progressent — c'est la mécanique normale des updates

- Ne pas copier une stratégie SEO qui fonctionne sur un segment différent du tien — les signaux valorisés ne sont pas les mêmes

- Ne pas ignorer les segments secondaires longtemps : un effet de bord peut devenir structurel si Google généralise un ajustement

- Ne pas optimiser pour "Google en général" — optimise pour l'intention et le contexte de chaque segment

❓ Questions frequentes

Google privilégie-t-il certains types de recherches au détriment d'autres ?

Pourquoi mon site gagne du trafic sur certaines requêtes et en perd sur d'autres lors d'une même mise à jour ?

Comment identifier quels segments de requêtes sont affectés par une mise à jour Google ?

Faut-il optimiser uniformément tout mon site ou prioriser certains segments ?

Les Quality Raters Guidelines reflètent-elles ces arbitrages entre segments ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 27/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.