Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Pourquoi les frameworks JavaScript génèrent-ils des soft 404 sur les sites à fort inventaire ?

- □ Robots.txt bloque-t-il vos ressources critiques sans que vous le sachiez ?

- □ Pourquoi héberger robots.txt sur plusieurs CDN peut-il saboter votre crawl budget ?

- □ Une requête AJAX qui échoue peut-elle tuer l'indexation de toute votre page ?

- □ Comment Chrome DevTools peut-il révéler les problèmes de rendu que Googlebot rencontre sur vos pages ?

- □ Pourquoi Google pénalise-t-il les sites qui gèrent mal leurs erreurs JavaScript ?

- □ La résoumission manuelle d'URLs via Search Console accélère-t-elle vraiment la réindexation ?

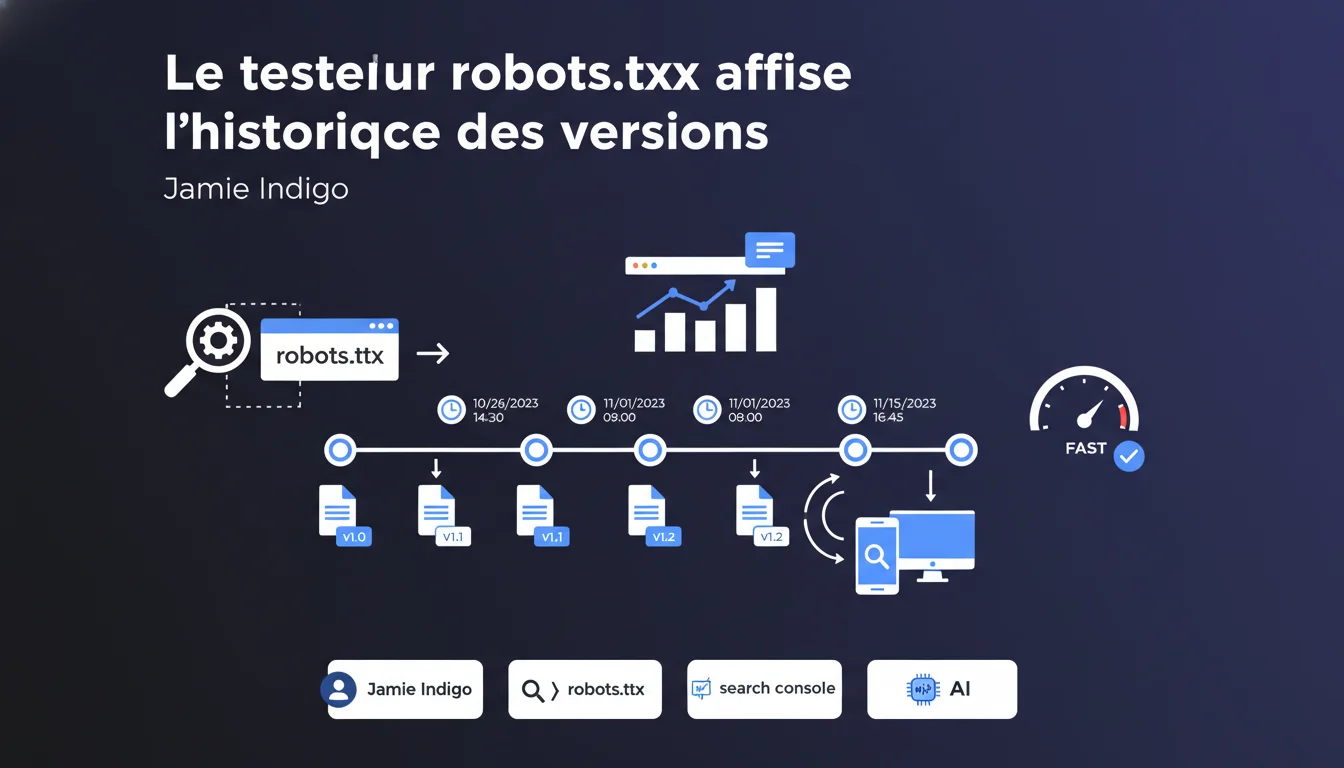

Search Console affiche désormais un historique horodaté du fichier robots.txt, permettant de visualiser précisément à quoi il ressemblait à une date et heure données. Cette traçabilité facilite le diagnostic des problèmes de crawl liés à des modifications passées du fichier et simplifie l'audit SEO technique.

Ce qu'il faut comprendre

Qu'est-ce que cette fonctionnalité apporte concrètement ?

Le testeur robots.txt de Google Search Console intègre maintenant un système d'horodatage historique. Concrètement, vous pouvez remonter dans le temps et voir exactement ce que contenait votre fichier robots.txt à un moment précis.

Cette transparence règle un problème récurrent : identifier la source d'une chute de trafic ou d'une désindexation accidentelle. Avant, il fallait recouper logs serveur, archives manuelles et autres outils externes — souvent sans certitude. Maintenant, l'historique est centralisé directement dans l'interface Google.

Pourquoi un historique du robots.txt est-il si utile ?

Parce que le robots.txt est un point de contrôle critique du crawl. Une directive mal placée, une ligne ajoutée par erreur lors d'un déploiement, et des sections entières du site disparaissent de l'index.

Le problème — et c'est du vécu — c'est que ces erreurs ne se détectent parfois que des semaines plus tard, quand le trafic organique s'effondre. À ce moment-là, retrouver ce qui s'est passé relève de l'enquête policière. L'historique horodaté change ça : vous voyez immédiatement quand le fichier a été modifié et ce qui a changé.

Cette fonction remplace-t-elle un suivi manuel ?

Elle complète, mais ne remplace pas totalement. Si vous avez un système de versioning Git ou un monitoring automatisé du robots.txt, tant mieux — gardez-le.

Search Console offre la vision de Google, c'est-à-dire ce que Googlebot a vu et à quel moment. C'est utile pour recouper avec vos propres archives, surtout si un changement non documenté s'est glissé en production.

- Horodatage précis des versions successives du robots.txt

- Permet de corréler des chutes de trafic avec des modifications du fichier

- Facilite les audits techniques et la résolution d'incidents de crawl

- Centralise l'historique dans Search Console, sans dépendre d'outils tiers

- Ne remplace pas un système de versioning interne mais offre la perspective de Googlebot

Avis d'un expert SEO

Cette fonctionnalité arrive-t-elle tardivement ?

Soyons honnêtes : oui. L'historique du robots.txt aurait dû exister depuis des années. C'est un fichier qui contrôle l'accès au site, et jusqu'à présent, aucun historique officiel n'était disponible côté Google.

Les SEO ont longtemps dû improviser avec des scripts maison, des archives Wayback Machine ou des alertes manuelles. Que Google intègre enfin cette traçabilité est positif, mais ça reste du rattrapage.

Que faut-il vérifier en priorité dans cet historique ?

Première chose : les périodes de transition. Migrations de site, refontes, déploiements majeurs — c'est là que les erreurs se glissent. Un développeur ajoute un Disallow: / le temps d'un test et oublie de l'enlever. Ou une directive censée bloquer un environnement de staging se retrouve en prod.

Ensuite, regardez les corrélations temporelles. Une chute de pages indexées dans Search Console ? Allez vérifier si une modification du robots.txt coïncide. Si oui, vous avez votre coupable.

Cette transparence change-t-elle la donne pour les audits ?

Ça simplifie certains diagnostics, clairement. Mais [A verifier] : on ne sait pas encore si Google conserve l'historique sur plusieurs années ou seulement sur une période limitée. Si c'est limité à quelques mois, l'utilité pour les audits rétrospectifs sera réduite.

Par ailleurs, cette fonctionnalité ne dit rien sur comment Googlebot a interprété le fichier à un instant T. Si une directive était ambiguë ou mal formatée, vous voyez le fichier brut, mais pas nécessairement l'effet réel sur le crawl. Croisez toujours avec les logs serveur.

Impact pratique et recommandations

Que faire immédiatement avec cette fonction ?

Premier réflexe : allez consulter l'historique de votre robots.txt dans Search Console. Même si vous n'avez pas de problème identifié, familiarisez-vous avec l'interface et vérifiez que les versions affichées correspondent à vos déploiements.

Ensuite, si vous avez constaté des anomalies de crawl ou d'indexation récentes, remontez dans l'historique pour voir si une modification du fichier coïncide. C'est souvent plus parlant qu'une simple inspection du fichier actuel.

Quelles précautions prendre pour éviter les erreurs ?

Première règle : ne jamais éditer robots.txt directement en production sans test préalable. Utilisez un environnement de staging, validez la syntaxe, puis déployez.

Deuxième point : mettez en place une alerte automatique sur les modifications du fichier. Ça peut être un script qui compare le fichier actuel avec une version de référence et vous notifie en cas de changement. Couplé à l'historique Search Console, vous avez une double sécurité.

Comment intégrer cette fonction dans un workflow d'audit ?

Intégrez systématiquement la consultation de l'historique robots.txt dans vos audits techniques. Surtout lors d'investigations sur des chutes de trafic inexpliquées.

Documentez les modifications détectées et corrélez-les avec les événements du site — migrations, déploiements, pics de trafic. Si une directive a bloqué des sections critiques pendant plusieurs jours, quantifiez l'impact en termes de pages désindexées et de trafic perdu.

- Consulter l'historique robots.txt dans Search Console dès maintenant

- Vérifier que les versions affichées correspondent à vos archives internes

- Corréler toute modification avec des anomalies de crawl ou d'indexation

- Mettre en place des alertes automatiques sur les changements du fichier

- Intégrer l'historique dans les audits techniques systématiques

- Former les équipes dev à ne jamais éditer robots.txt en production sans validation

- Documenter chaque modification du fichier avec date, auteur et raison

❓ Questions frequentes

L'historique du robots.txt est-il conservé indéfiniment dans Search Console ?

Peut-on comparer deux versions du robots.txt directement dans l'interface ?

Cette fonctionnalité fonctionne-t-elle pour tous les sites dans Search Console ?

Que faire si l'historique montre une version incorrecte du robots.txt ?

L'historique aide-t-il à diagnostiquer des problèmes sur d'autres moteurs de recherche ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 02/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.