Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Pourquoi les frameworks JavaScript génèrent-ils des soft 404 sur les sites à fort inventaire ?

- □ Robots.txt bloque-t-il vos ressources critiques sans que vous le sachiez ?

- □ Pourquoi l'historique du robots.txt dans Search Console change-t-il la donne ?

- □ Pourquoi héberger robots.txt sur plusieurs CDN peut-il saboter votre crawl budget ?

- □ Une requête AJAX qui échoue peut-elle tuer l'indexation de toute votre page ?

- □ Comment Chrome DevTools peut-il révéler les problèmes de rendu que Googlebot rencontre sur vos pages ?

- □ La résoumission manuelle d'URLs via Search Console accélère-t-elle vraiment la réindexation ?

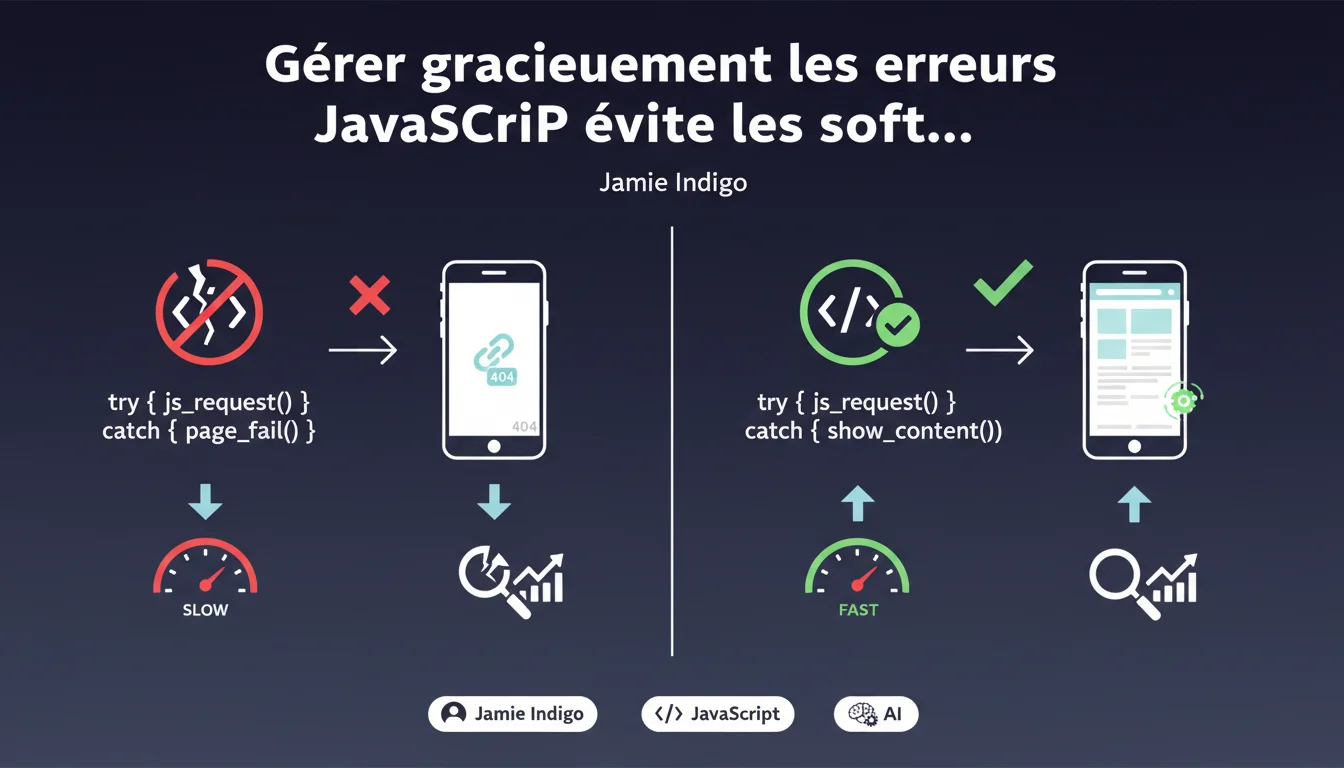

Google recommande d'implémenter une gestion d'erreur gracieuse en JavaScript pour éviter que l'échec d'un script ne transforme toute une page en soft 404. Si un élément individuel plante, le reste du contenu doit rester accessible au crawl. C'est une question de préservation du contenu indexable, pas juste d'UX.

Ce qu'il faut comprendre

Qu'est-ce qu'une erreur JavaScript « non gracieuse » aux yeux de Google ?

Quand un script échoue sans gestion d'erreur, il peut bloquer l'exécution du reste de la page. Résultat : Googlebot arrive, tente de rendre la page, et se retrouve face à un DOM vide ou quasi-vide. Techniquement, le serveur renvoie un 200, mais le contenu utile n'apparaît jamais.

C'est exactement la définition d'un soft 404 : une page qui prétend exister mais qui ne livre rien d'exploitable. Google la traite alors comme une page vide, avec toutes les conséquences que ça implique pour l'indexation.

Pourquoi cette recommandation maintenant ?

Les sites modernes empilent les dépendances JavaScript : frameworks front, modules tiers, API externes. Un seul maillon qui casse, et c'est parfois tout l'édifice qui s'effondre. Google voit passer un nombre croissant de pages qui échouent silencieusement côté rendu.

Jamie Indigo tape dans le mille : si un composant individuel plante — une pub, un widget social, un module analytics —, ça ne doit pas tuer toute la page. Le contenu principal doit survivre, sinon vous perdez votre indexation pour une broutille technique.

Que signifie « gérer gracieusement » concrètement ?

Ça veut dire encapsuler vos appels risqués dans des blocs try/catch, prévoir des fallbacks, isoler les composants critiques des composants secondaires. L'idée : compartimenter les risques.

Si votre carrousel d'images plante, la fiche produit doit quand même s'afficher. Si l'appel à votre API de prix échoue, affichez au moins la description et les caractéristiques. Google crawle, il voit du contenu, il indexe. Sinon, soft 404.

- Soft 404 = page qui renvoie 200 mais sans contenu exploitable pour Googlebot

- Une erreur JS non gérée peut bloquer tout le rendu côté client

- La gestion gracieuse isole les échecs et préserve le contenu principal

- Google recommande explicitement de compartimenter les risques JavaScript

Avis d'un expert SEO

Cette recommandation est-elle vraiment nouvelle ?

Non. Les bonnes pratiques de développement front prêchent la gestion d'erreur depuis des années. Ce qui change, c'est que Google le dit publiquement et le relie directement aux soft 404. C'est un signal clair : ils ont identifié ce pattern comme un problème d'indexation récurrent.

Sur le terrain, on voit régulièrement des sites perdre des positions suite à une mise à jour JS qui introduit une régression silencieuse. Le contenu disparaît du crawl, Google désindexe progressivement, et personne ne comprend pourquoi — parce que la page « fonctionne » en apparence.

Quelles nuances faut-il apporter ?

Soyons honnêtes : tous les sites ne sont pas égaux face au JavaScript. Un site statique ou SSR (Server-Side Rendering) est bien moins exposé à ce risque qu'une SPA (Single Page Application) qui charge tout en client-side.

Si votre stack repose massivement sur du rendu côté client, cette recommandation devient critique. Si vous servez du HTML prérendu, vous avez déjà une couche de protection. Mais même dans ce cas, un script externe mal géré peut pourrir votre DOM.

[À vérifier] : Google ne précise pas à quelle fréquence il réévalue une page classée soft 404 suite à une erreur JS. Si vous corrigez le problème, combien de temps avant que l'indexation se rétablisse ? Aucune donnée officielle là-dessus.

Dans quels cas cette règle ne s'applique-t-elle pas directement ?

Si vous faites du rendu côté serveur (Next.js SSR, PHP classique, etc.), Googlebot récupère déjà le contenu en HTML pur. L'erreur JS côté client n'impacte pas le crawl initial. Vous restez vulnérable si vous comptez sur de l'hydratation ou du contenu enrichi en JavaScript, mais le risque de soft 404 est réduit.

En revanche, si votre contenu principal se charge via des appels API en front — typique des architectures headless —, vous êtes en première ligne. Une erreur non catchée, et c'est le vide.

Impact pratique et recommandations

Que faut-il faire concrètement pour sécuriser son JavaScript ?

Première étape : auditer votre code front pour identifier les points de fragilité. Tout appel réseau, toute dépendance externe, tout module tiers est un risque potentiel. Encapsulez ces appels dans des blocs try/catch ou des Promises avec gestion d'erreur explicite.

Ensuite, testez le rendu avec Googlebot. Utilisez l'outil d'inspection d'URL de la Search Console, mais aussi des tests en conditions réelles (latence réseau, CDN lents, scripts tiers défaillants). Ne vous fiez pas uniquement aux tests locaux, qui tournent dans des conditions idéales.

Quelles erreurs éviter absolument ?

Ne laissez jamais un script externe bloquer le rendu critique. Si un CDN tombe, votre page doit survivre. Utilisez les attributs async ou defer, et prévoyez des timeouts pour les appels qui traînent.

Évitez aussi de tout miser sur un framework front sans SSR ou prérendu. Si votre site est une SPA pure sans fallback HTML, vous jouez à la roulette russe avec Googlebot. Chaque erreur JS devient un risque d'indexation.

Comment vérifier que mon site est conforme ?

Testez vos pages avec des outils de rendu JavaScript : Screaming Frog en mode JS, PageSpeed Insights, et surtout la Search Console. Vérifiez que le contenu principal apparaît bien dans le HTML rendu, même si des composants secondaires échouent.

Mettez en place un monitoring JavaScript en production : suivez les erreurs côté client avec un outil comme Sentry ou LogRocket. Si une erreur se déclenche pour 10 % de vos utilisateurs, elle se déclenche aussi pour Googlebot dans certaines conditions.

- Encapsuler tous les appels réseau et dépendances externes dans des blocs try/catch

- Tester le rendu avec l'outil d'inspection d'URL de la Search Console

- Implémenter un monitoring JavaScript en production (Sentry, LogRocket, etc.)

- Prévoir des fallbacks HTML pour le contenu critique

- Utiliser async/defer pour les scripts non critiques

- Auditer régulièrement les erreurs JS remontées par vos outils de monitoring

- Vérifier que le contenu principal reste accessible même si des modules tiers plantent

❓ Questions frequentes

Un soft 404 causé par une erreur JavaScript entraîne-t-il une pénalité manuelle ?

Le SSR (Server-Side Rendering) résout-il définitivement ce problème ?

Comment savoir si mon site est affecté par des soft 404 liés au JavaScript ?

Tous les scripts externes doivent-ils être chargés en async ou defer ?

Une erreur JavaScript côté client impacte-t-elle les Core Web Vitals ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 02/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.