Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Pourquoi les frameworks JavaScript génèrent-ils des soft 404 sur les sites à fort inventaire ?

- □ Robots.txt bloque-t-il vos ressources critiques sans que vous le sachiez ?

- □ Pourquoi l'historique du robots.txt dans Search Console change-t-il la donne ?

- □ Pourquoi héberger robots.txt sur plusieurs CDN peut-il saboter votre crawl budget ?

- □ Une requête AJAX qui échoue peut-elle tuer l'indexation de toute votre page ?

- □ Comment Chrome DevTools peut-il révéler les problèmes de rendu que Googlebot rencontre sur vos pages ?

- □ Pourquoi Google pénalise-t-il les sites qui gèrent mal leurs erreurs JavaScript ?

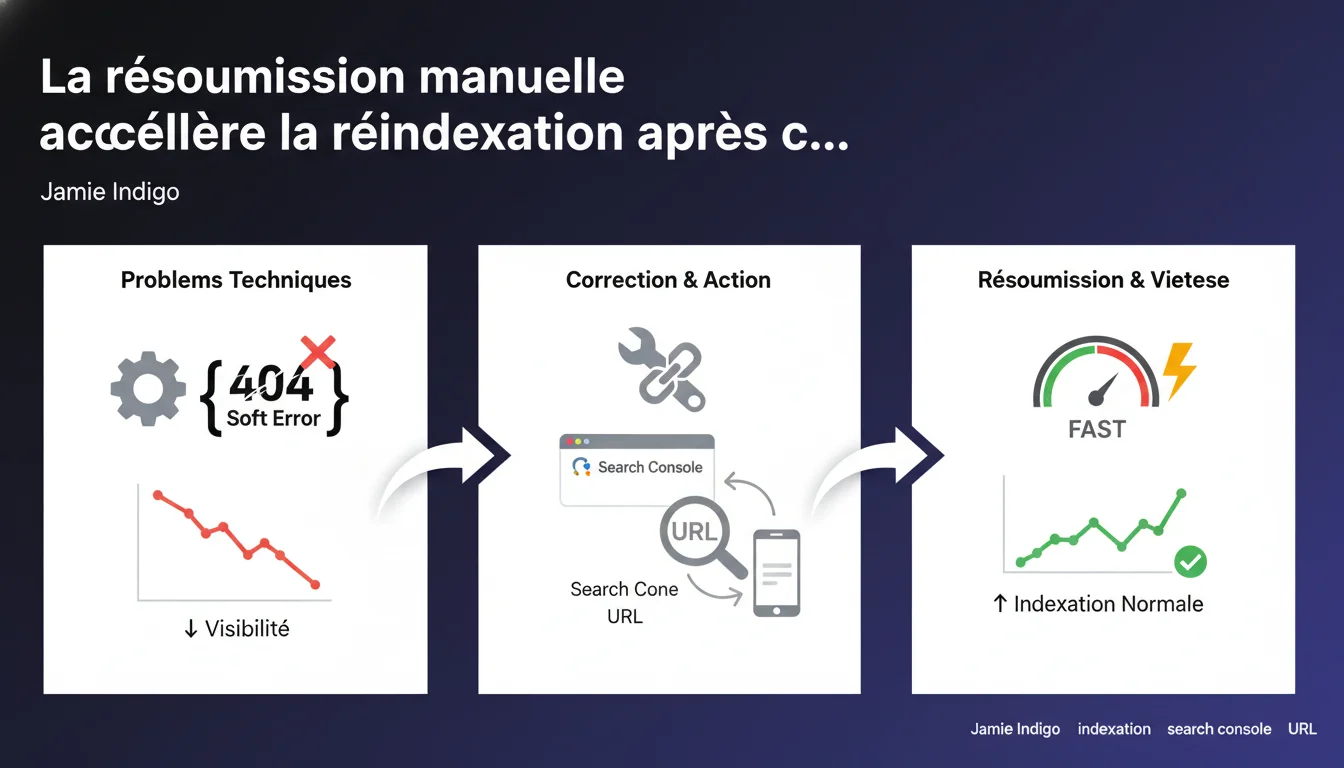

Google confirme que résoumettre manuellement des URLs corrigées via Search Console permet de suivre précisément leur comportement et accélère leur retour dans l'index après résolution de problèmes techniques comme les soft 404. Cette approche offre un contrôle granulaire sur le processus de réindexation plutôt que d'attendre le passage naturel de Googlebot.

Ce qu'il faut comprendre

Qu'est-ce qu'un soft 404 et pourquoi pose-t-il problème ?

Un soft 404 survient lorsqu'une page renvoie un code HTTP 200 (OK) alors qu'elle devrait signaler une erreur 404. La page affiche un contenu vide, générique ou indique que la ressource n'existe pas — mais techniquement, le serveur prétend que tout va bien.

Google détecte ces incohérences et traite ces pages comme inexistantes, ce qui les exclut de l'index. Le problème ? Une fois marquées ainsi, elles ne reviennent pas automatiquement dans l'index même après correction du problème technique sous-jacent.

Pourquoi la résoumission manuelle fait-elle une différence ?

Normalement, après correction, vous attendez que Googlebot recrawle naturellement les URLs concernées. Ça peut prendre des jours, voire des semaines selon votre crawl budget et la fréquence de passage du bot.

La résoumission via Search Console déclenche une priorisation active de ces URLs. Google les examine rapidement et met à jour leur statut d'indexation si les corrections sont effectives. C'est particulièrement utile pour des pages stratégiques qui génèrent du trafic ou des conversions.

Quel est l'avantage du suivi spécifique mentionné par Google ?

Réoumettre manuellement crée un historique traçable dans Search Console. Vous voyez précisément quand l'URL a été réexaminée, si elle a été réindexée, et éventuellement quels problèmes persistent.

Sans cette démarche, vous naviguez à l'aveugle — impossible de distinguer si l'absence d'indexation vient d'un crawl pas encore effectué ou d'un problème technique non résolu.

- Soft 404 : pages renvoyant 200 mais traitées comme inexistantes par Google

- La correction technique seule ne garantit pas une réindexation rapide

- La résoumission manuelle priorise le crawl et offre un suivi granulaire

- Particulièrement efficace pour des pages à fort enjeu business

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Oui, on constate régulièrement que la résoumission accélère effectivement le processus. Sur des sites à faible crawl budget ou avec des milliers de pages, attendre le passage naturel peut prendre un temps fou.

Cependant — et c'est crucial — réoumettre ne force pas l'indexation. Si le problème technique persiste ou si la page présente d'autres défauts (contenu mince, qualité douteuse), Google la refusera à nouveau. La résoumission n'est pas une baguette magique qui contourne les critères de qualité.

Dans quels cas cette approche ne sert-elle à rien ?

Si votre site reçoit un crawl quotidien intensif — typiquement les gros médias ou e-commerces avec forte fraîcheur de contenu — l'avantage de la résoumission manuelle devient marginal. Googlebot repassera naturellement sous 24-48h de toute façon.

Autre cas : si vous avez des centaines d'URLs en soft 404, réoumettre une par une via l'outil Search Console devient impraticable. [A vérifier] Google ne fournit aucune indication sur un seuil au-delà duquel la méthode devient contre-productive ou si une résoumission groupée via sitemap XML aurait le même effet accélérateur.

Quelle nuance faut-il apporter sur le « suivi spécifique » ?

Réoumettre crée effectivement une trace, mais Search Console ne garantit pas un feedback détaillé en temps réel. Vous verrez « URL soumise et indexée » ou un message d'erreur, mais rarement une explication fouillée si ça coince.

Le « suivi » reste donc relatif : vous savez qu'une action a été tentée, pas nécessairement pourquoi ça a échoué si c'est le cas. Pour diagnostiquer finement, vous devrez croiser avec les logs serveur, le rapport de couverture et éventuellement les outils tiers.

Impact pratique et recommandations

Que faire concrètement après correction d'un soft 404 ?

Une fois le problème technique résolu — par exemple, vous avez corrigé un template qui renvoyait du contenu vide avec un 200 —, rendez-vous dans Search Console > Inspection d'URL. Collez l'URL corrigée, lancez un test en direct pour vérifier que Googlebot voit bien le bon contenu, puis cliquez sur « Demander une indexation ».

Surveillez ensuite le rapport de couverture sur quelques jours. Si l'URL repasse en « Valide », c'est gagné. Si elle reste en erreur, creusez : le code HTTP est-il correct ? Le contenu est-il suffisamment étoffé ? Y a-t-il un noindex ou un robots.txt bloquant ?

Quelles erreurs éviter lors de la résoumission ?

Ne réoumettez jamais une URL avant d'avoir vérifié en live qu'elle est corrigée. Tester avec l'outil d'inspection évite de soumettre une page encore défectueuse, ce qui ne ferait que perdre du temps et brouiller vos indicateurs.

Autre piège : réoumettre massivement des URLs sans hiérarchiser. Concentrez-vous d'abord sur les pages stratégiques (celles qui génèrent du trafic organique ou des conversions). Les pages annexes suivront naturellement lors du prochain crawl approfondi.

Comment vérifier que la correction a bien pris effet ?

Au-delà de Search Console, croisez avec vos logs serveur. Vérifiez que Googlebot recrawle effectivement les URLs résoumises et qu'il reçoit bien un 200 avec du contenu complet. Comparez les dates de crawl avant/après résoumission : un passage rapide confirme la priorisation.

Utilisez aussi une commande site:URL dans Google quelques jours plus tard pour confirmer l'indexation effective. Si l'URL n'apparaît toujours pas, c'est qu'un problème subsiste — et il faut investiguer plus loin.

- Corriger d'abord le problème technique (code HTTP, contenu, template)

- Tester l'URL avec l'outil d'inspection avant de réoumettre

- Demander l'indexation via Search Console

- Surveiller le rapport de couverture sur 3-7 jours

- Croiser avec les logs serveur pour confirmer le recrawl

- Prioriser les pages à fort impact business

- Ne pas réoumettre en masse sans stratégie

❓ Questions frequentes

Réoumettre une URL plusieurs fois accélère-t-il encore plus le processus ?

Peut-on réoumettre via sitemap XML plutôt qu'URL par URL ?

Combien de temps faut-il attendre avant de voir l'effet d'une résoumission ?

La résoumission fonctionne-t-elle pour d'autres problèmes que les soft 404 ?

Y a-t-il un quota de résoumissions quotidiennes dans Search Console ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 02/03/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.