Declaration officielle

Ce qu'il faut comprendre

Existe-t-il vraiment un bouton magique pour réindexer tout son site ?

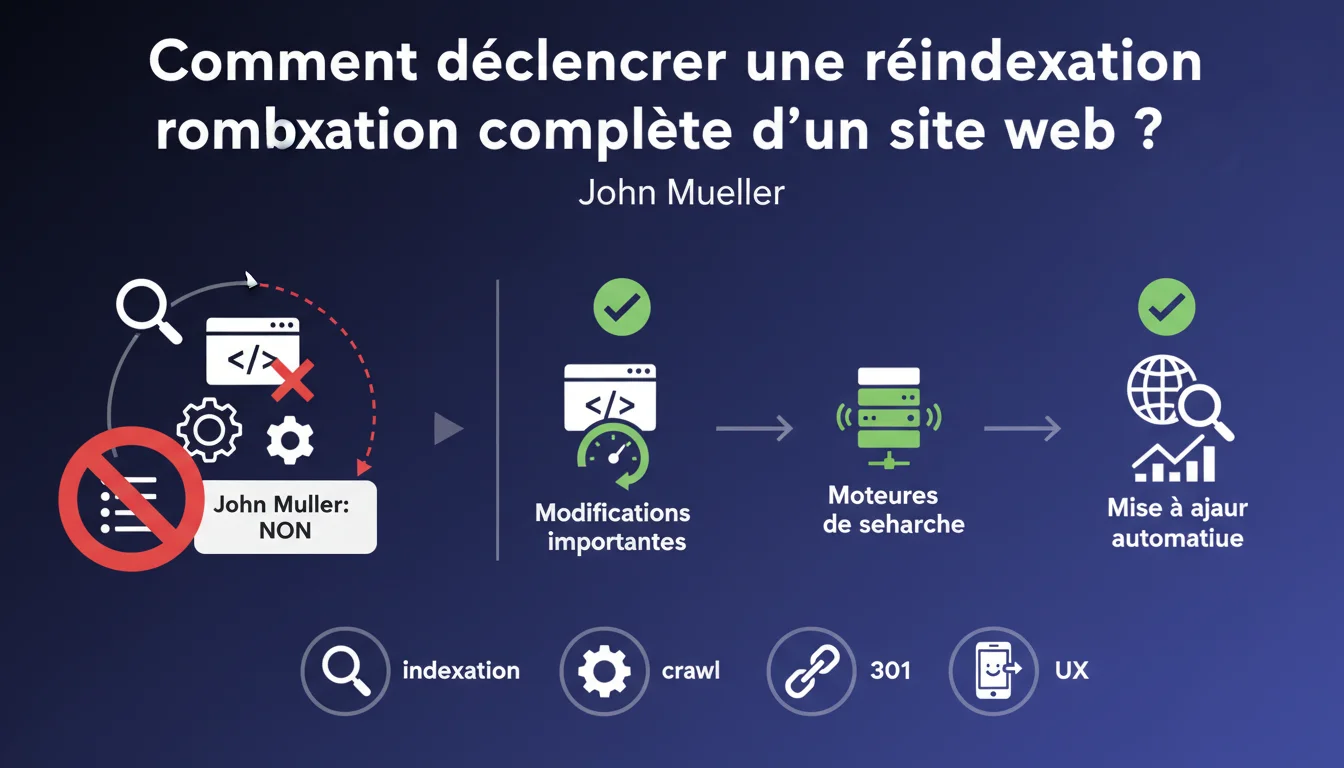

La réponse de John Mueller est sans appel : aucun mécanisme ne permet de déclencher une réindexation complète d'un site web en une seule action. Cette limitation est volontaire de la part de Google.

Les moteurs de recherche appliquent leurs propres rythmes de crawl et d'indexation, basés sur de nombreux critères comme la popularité du site, sa fraîcheur de contenu et son budget crawl. Même avec un sitemap XML soumis, chaque URL sera traitée individuellement selon les priorités de Google.

Comment Google procède-t-il alors pour mettre à jour un site ?

Lorsque des modifications importantes sont apportées à un site, Google les détecte progressivement lors de ses passages réguliers. Le moteur ajuste automatiquement son rythme de crawl en fonction de l'activité détectée.

La Search Console permet certes de soumettre des URLs individuelles pour indexation, mais cette fonctionnalité est volontairement limitée à environ 10 URLs par jour. Cette contrainte empêche les abus et force une approche plus stratégique.

Quelles sont les recommandations officielles pour accélérer le processus ?

Mueller insiste sur l'importance d'une architecture technique solide. Les codes HTTP appropriés (301 pour les redirections, 404 pour les pages supprimées) aident Google à comprendre les changements structurels du site.

Le maillage interne stratégique joue un rôle crucial : lier les pages clés depuis les pages importantes du site accélère leur découverte et réindexation. Les informations critiques (comme des nouveaux numéros de téléphone) doivent être placées sur les pages à forte autorité.

- Aucune méthode officielle ne permet une réindexation massive instantanée

- Google applique un processus graduel et automatique de mise à jour

- La limite de 10 URLs par jour via Search Console force une approche sélective

- Les codes HTTP corrects (301, 404) facilitent la compréhension des changements

- Le maillage interne depuis les pages importantes accélère la découverte

- Les informations critiques doivent figurer sur les pages prioritaires

Avis d'un expert SEO

Cette approche de Google est-elle cohérente avec ce qu'on observe sur le terrain ?

Absolument. Dans ma pratique, j'ai constaté que les sites avec un bon historique de crawl et une autorité établie voient leurs modifications détectées en quelques jours, tandis que les sites moins prioritaires peuvent attendre plusieurs semaines.

La limitation à 10 URLs par jour via Search Console reflète une volonté de Google de maîtriser la charge serveur et d'éviter les manipulations massives. C'est aussi un signal : si vous devez soumettre manuellement des centaines d'URLs, c'est probablement que votre architecture pose problème.

Quelles nuances importantes faut-il apporter à cette déclaration ?

Bien que Mueller affirme qu'aucune action n'est nécessaire, la réalité est plus complexe. En pratique, des actions stratégiques peuvent accélérer significativement le processus de réindexation.

Augmenter la fréquence de publication de contenu de qualité, améliorer le temps de réponse serveur, ou obtenir des liens externes vers les pages modifiées sont autant de leviers qui influencent positivement le budget crawl. Google crawle plus souvent ce qui change fréquemment et ce qui est populaire.

Dans quels cas cette approche passive peut-elle être problématique ?

Pour les sites e-commerce avec des milliers de produits mis à jour quotidiennement, attendre passivement peut signifier des informations obsolètes (prix, stocks) dans les résultats pendant des semaines. C'est commercialement inacceptable.

De même, lors d'une migration de site, d'une correction massive d'erreurs techniques, ou d'un problème de sécurité résolu, la patience peut coûter cher en visibilité et revenus. Dans ces situations critiques, une approche proactive combinant plusieurs techniques devient indispensable.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser la réindexation ?

Concentrez-vous sur l'optimisation du budget crawl. Éliminez les pages inutiles (facettes infinies, pages de pagination profonde), bloquez-les via robots.txt ou balises noindex. Plus vous économisez du budget crawl sur le superflu, plus Google peut se concentrer sur vos pages stratégiques.

Utilisez le sitemap XML intelligemment : incluez uniquement vos pages indexables importantes, mettez à jour les dates de modification (lastmod) pour signaler les changements, et soumettez régulièrement votre sitemap via Search Console.

Développez un maillage interne stratégique. Vos pages les plus crawlées (généralement homepage, catégories principales) doivent faire des liens vers les pages que vous souhaitez voir indexées rapidement. C'est votre levier le plus puissant.

Quelles erreurs courantes faut-il absolument éviter ?

Ne submergez pas la Search Console avec les 10 URLs quotidiennes autorisées pour des pages mineures. Réservez ce quota aux pages vraiment stratégiques : nouvelles pages importantes, corrections urgentes, contenus time-sensitive.

Évitez de modifier massivement votre site sans planification. Les refonte brutales sans redirections appropriées ou les changements d'URL massifs sans stratégie causent des pertes de visibilité prolongées. Google prend du temps à tout réindexer.

Ne négligez jamais les codes de statut HTTP. Des 302 au lieu de 301, des soft 404, ou des chaînes de redirections complexes perturbent Google et ralentissent considérablement la réindexation.

Comment surveiller efficacement l'état de réindexation de son site ?

Utilisez le rapport de couverture dans la Search Console pour identifier les pages exclues ou non indexées. Analysez les raisons (crawl budget insuffisant, noindex accidentel, canonical mal configuré) et corrigez systématiquement.

Surveillez les statistiques de crawl pour comprendre le rythme auquel Google visite votre site. Une baisse soudaine peut indiquer un problème technique (temps de réponse, erreurs serveur) qu'il faut corriger rapidement.

Créez des alertes personnalisées pour surveiller l'indexation de vos pages stratégiques via des requêtes "site:" ciblées. Vérifiez que les titres, descriptions et contenus affichés correspondent bien aux dernières versions.

- Optimiser le budget crawl en éliminant les pages inutiles et les contenus dupliqués

- Maintenir un sitemap XML à jour avec uniquement les pages stratégiques indexables

- Développer un maillage interne fort depuis les pages à haute autorité

- Utiliser systématiquement les redirections 301 pour les changements d'URL permanents

- Réserver le quota Search Console (10 URLs/jour) aux pages vraiment prioritaires

- Surveiller régulièrement le rapport de couverture et les statistiques de crawl

- Placer les informations critiques sur les pages les plus crawlées du site

- Améliorer la vitesse serveur et corriger toutes les erreurs techniques

- Planifier les modifications massives avec une stratégie de migration claire

💬 Commentaires (0)

Soyez le premier à commenter.