Declaration officielle

Autres déclarations de cette vidéo 6 ▾

- □ Google crawle-t-il vraiment le HTML rendu ou seulement le code source ?

- □ Le DOM dynamique modifié par JavaScript est-il vraiment pris en compte par Google ?

- □ Pourquoi Google indexe-t-il le HTML rendu plutôt que le HTML source ?

- □ Faut-il vraiment abandonner l'inspection de code source au profit de Search Console pour voir ce que Google indexe ?

- □ Pourquoi « Afficher le code source » ne montre-t-il pas ce que Google indexe vraiment ?

- □ Pourquoi l'onglet Elements de Chrome révèle-t-il plus que le code source pour le SEO ?

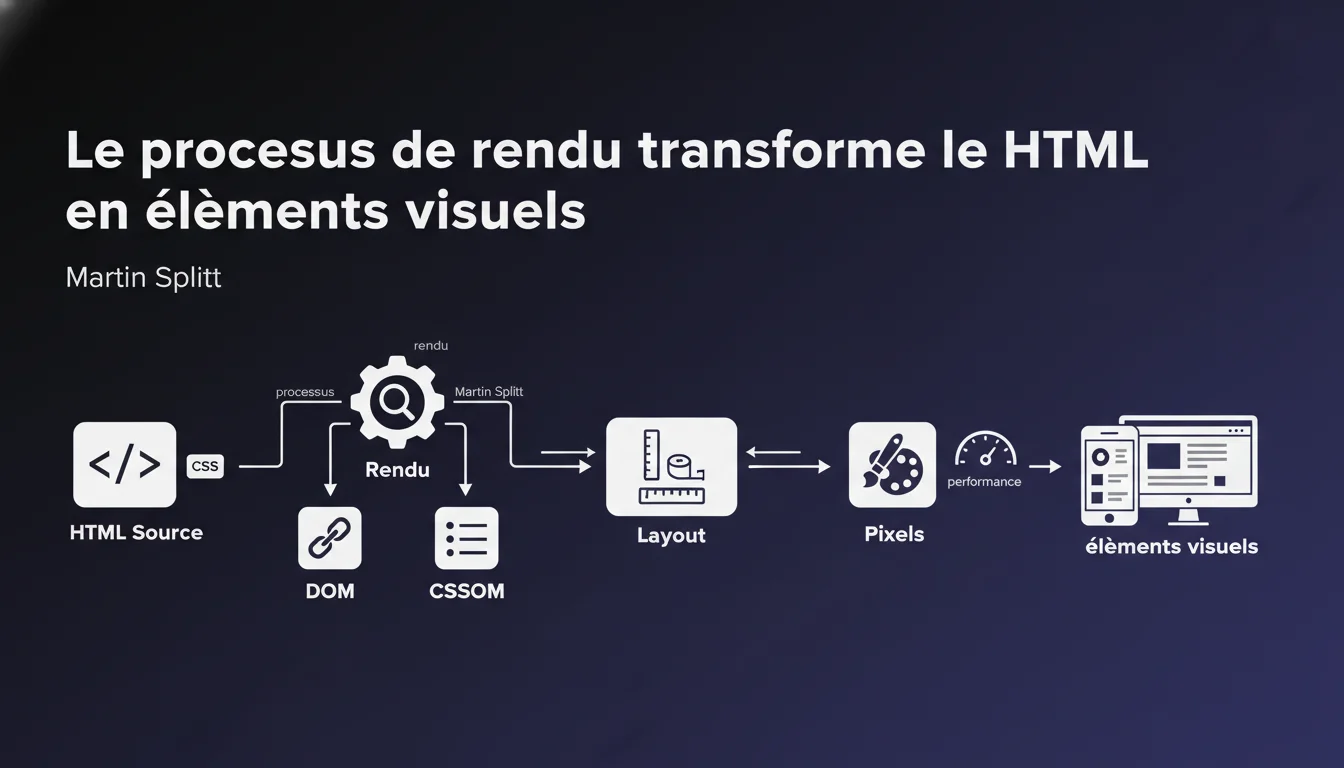

Google rappelle que le rendu transforme le code HTML et CSS en éléments visuels via le DOM, le CSSOM, puis le layout et l'affichage final. Pour le SEO, cela signifie que le contenu visible par Googlebot dépend directement de la capacité du crawler à exécuter ce rendu — un point critique pour les sites en JavaScript.

Ce qu'il faut comprendre

Qu'est-ce que le rendu et pourquoi Google insiste-t-il sur ce point ?

Le rendu désigne la série d'opérations par lesquelles un navigateur (ou Googlebot) convertit le code source HTML et CSS en une page affichable. Ce processus passe par la construction du DOM (Document Object Model), du CSSOM (CSS Object Model), le calcul du layout (positionnement des éléments), puis le rendu final des pixels.

Google met l'accent sur ce processus parce que beaucoup de sites modernes génèrent leur contenu via JavaScript. Si Googlebot ne parvient pas à exécuter correctement le rendu, il ne voit pas le même contenu que l'utilisateur — ce qui pose des problèmes d'indexation évidents.

En quoi le rendu diffère-t-il entre un navigateur classique et Googlebot ?

Un navigateur Chrome ou Firefox exécute le rendu en temps réel, à chaque chargement de page. Googlebot, lui, fonctionne en deux temps : il crawle d'abord le HTML brut, puis passe certaines pages dans une file d'attente de rendu pour exécuter le JavaScript.

Cette file d'attente introduit un délai — parfois de plusieurs jours. Si votre contenu essentiel n'apparaît qu'après exécution JS, il risque de ne pas être indexé immédiatement, voire jamais si le crawl budget est serré.

Quels éléments du rendu impactent directement le SEO ?

Trois phases du rendu méritent une attention particulière : la construction du DOM (le HTML doit contenir le contenu critique dès le départ), le CSSOM (les ressources CSS bloquantes ralentissent le rendu), et le layout (les décalages visuels imprévus dégradent les Core Web Vitals).

Si une ressource CSS ou JS bloque le rendu, Googlebot peut abandonner avant d'avoir vu le contenu complet. Les sites en SSR (Server-Side Rendering) ou avec du contenu statique dans le HTML initial ont un avantage net.

- Le DOM et le CSSOM doivent être construits avant que le contenu soit visible — y compris pour Googlebot

- Le JavaScript retarde le rendu et peut créer un écart entre ce que voit l'utilisateur et ce qu'indexe Google

- Les ressources bloquantes (CSS, JS volumineux) ralentissent ou empêchent le rendu complet

- Les Core Web Vitals (LCP, CLS) dépendent directement de la vitesse et de la stabilité du rendu

- Un contenu généré uniquement côté client risque de ne jamais apparaître dans l'index si le crawl budget est limité

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui, totalement. On observe régulièrement des sites dont le contenu n'est pas indexé parce qu'il n'apparaît que dans le DOM après exécution JS. Les sites e-commerce en React ou Vue sans SSR en sont les victimes classiques.

Ce qui manque dans la déclaration de Splitt, c'est la précision sur les délais de rendu chez Google. Dire que Googlebot exécute le rendu, c'est vrai — mais combien de temps après le crawl initial ? Quelques heures ? Plusieurs jours ? [À vérifier] : Google ne donne jamais de chiffres précis, alors qu'en production, ces délais peuvent tuer la visibilité de contenus sensibles au temps (actualités, promos).

Quelles nuances faut-il apporter à cette affirmation ?

Premier point : le rendu n'est pas binaire. Googlebot ne rend pas toutes les pages avec la même priorité. Les pages importantes (homepage, catégories clés) passent probablement plus vite dans la file de rendu que des pages profondes.

Deuxième nuance — et c'est rarement dit clairement : le rendu peut échouer silencieusement. Si une ressource JS critique ne charge pas, Googlebot peut indexer une version partielle sans que vous le sachiez. Les outils comme Search Console ne signalent pas toujours ces échecs de manière explicite.

Dans quels cas cette règle ne s'applique-t-elle pas comme prévu ?

Les sites avec un contenu lourd en médias ou animations peuvent poser problème. Le rendu de Googlebot n'attend pas indéfiniment : si votre contenu n'apparaît qu'après 10 secondes de chargement JS, il y a de fortes chances que le bot abandonne.

Autre cas : les sites qui dépendent de cookies ou de localStorage pour afficher du contenu. Googlebot ne conserve pas l'état entre les crawls — si votre contenu n'apparaît qu'après une interaction utilisateur (clic, scroll), il restera invisible.

Impact pratique et recommandations

Que faut-il faire concrètement pour garantir un rendu optimal ?

Premier réflexe : servez le contenu critique dans le HTML initial. Titres, paragraphes principaux, liens internes — tout cela doit exister dans le DOM avant toute exécution JS. Le SSR (Next.js, Nuxt) ou la génération statique (Gatsby, Hugo) règlent le problème à la source.

Ensuite, auditez vos ressources bloquantes. Un fichier CSS de 500 Ko non optimisé peut retarder le rendu de plusieurs secondes. Utilisez le defer ou async pour les scripts non critiques, et fractionnez vos CSS par route si possible.

Quelles erreurs éviter absolument ?

Ne cachez jamais du contenu essentiel derrière un display:none ou un visibility:hidden qui ne se lève qu'au scroll. Googlebot ne scroll pas — ce contenu restera invisible.

Évitez aussi les SPA (Single Page Applications) pures sans pré-rendu. Si chaque page charge un bundle JS de 2 Mo avant d'afficher quoi que ce soit, vous êtes en danger. Les framework modernes (Next, Nuxt, SvelteKit) offrent des solutions hybrides — utilisez-les.

Comment vérifier que mon site est conforme aux exigences de rendu ?

Utilisez l'outil d'inspection d'URL dans Google Search Console pour comparer le HTML rendu avec ce que vous voyez dans votre navigateur. Vérifiez que le contenu textuel apparaît bien dans l'onglet "HTML rendu".

Testez aussi avec des outils comme Screaming Frog en mode "JavaScript Rendering" pour simuler le comportement de Googlebot. Comparez les résultats avec et sans JS activé — tout écart significatif est un signal d'alerte.

- Servir le contenu critique (H1, paragraphes principaux, liens) dans le HTML initial, avant toute exécution JS

- Optimiser les ressources bloquantes : minifier CSS/JS, utiliser defer/async, lazy-load les images

- Privilégier le SSR ou la génération statique pour les sites en framework moderne

- Tester systématiquement avec l'outil d'inspection d'URL de Search Console

- Auditer le rendu avec Screaming Frog ou un outil équivalent activant le JS

- Éviter les contenus cachés par CSS qui ne se révèlent qu'au scroll ou au clic

- Surveiller les Core Web Vitals (LCP, CLS) qui reflètent la qualité du rendu

❓ Questions frequentes

Googlebot exécute-t-il toujours le JavaScript de mes pages ?

Le contenu chargé en AJAX est-il indexé par Google ?

Comment savoir si Google voit le même contenu que mes utilisateurs ?

Le SSR est-il obligatoire pour un bon référencement en JavaScript ?

Les Core Web Vitals sont-ils liés au processus de rendu ?

🎥 De la même vidéo 6

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 06/07/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.