Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Robots.txt vs no-index : pourquoi tant de pros SEO mélangent encore ces deux mécanismes ?

- □ Faut-il vraiment optimiser tout le site après une mise à jour algorithmique ?

- □ Search Console intègre les données IA : mais savez-vous vraiment ce que vous mesurez ?

- □ Faut-il vraiment optimiser différemment son site pour les AI Overviews de Google ?

- □ Google Trends est-il vraiment un outil stratégique pour orienter sa ligne éditoriale SEO ?

- □ Comment Search Console peut-il vraiment révéler ce que cherche votre audience ?

- □ Le SEO est-il vraiment mort ou juste en train de muter sous nos yeux ?

- □ Comment la qualité du contenu influence-t-elle directement le taux d'indexation par Google ?

- □ Votre CDN ou firewall bloque-t-il Googlebot sans que vous le sachiez ?

- □ Comment Google Trends utilise-t-il réellement le Knowledge Graph pour identifier les topics ?

- □ L'index Google a-t-il vraiment une limite de capacité ?

- □ Le marketing traditionnel est-il devenu indispensable pour ranker sur Google ?

- □ Les données structurées sont-elles vraiment inutiles pour le classement SEO ?

- □ Faut-il vraiment faire vérifier toutes vos traductions automatiques pour le SEO ?

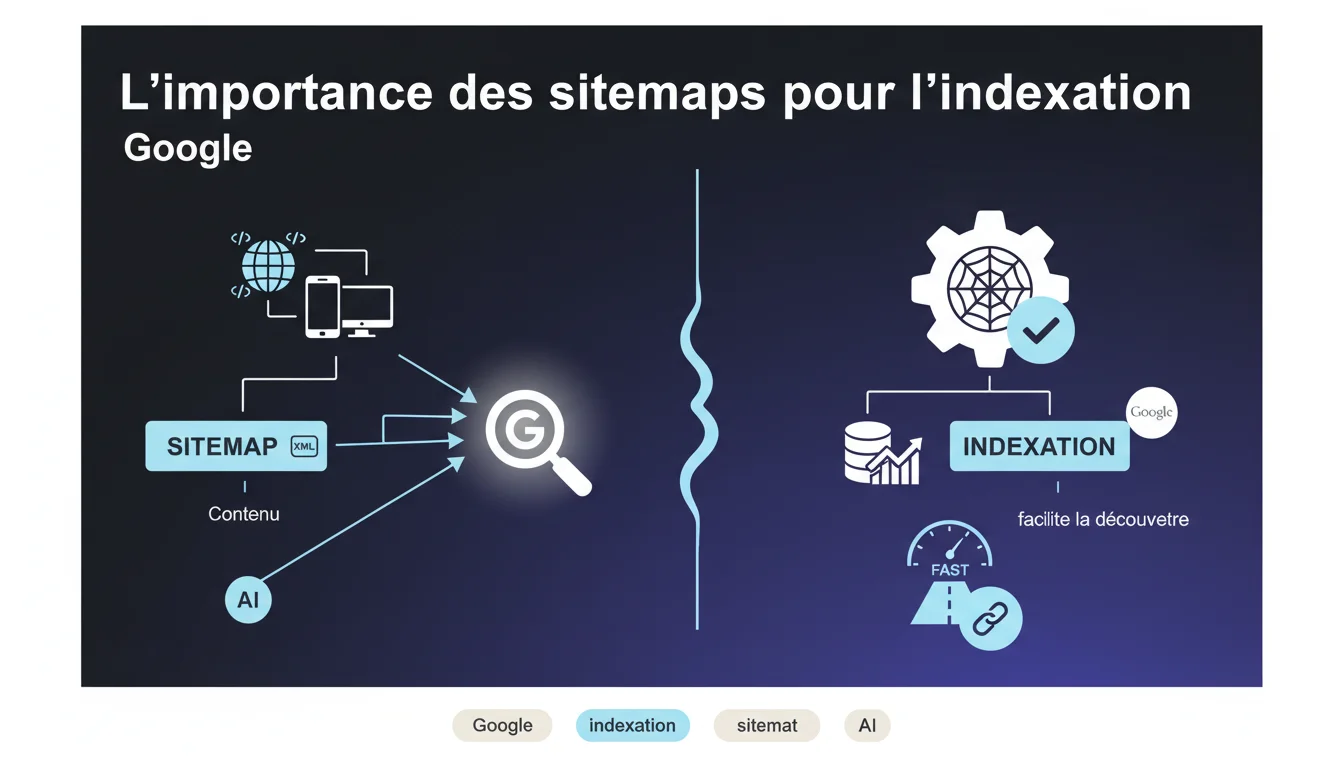

Google confirme que les sitemaps facilitent la découverte de contenu, mais ne garantissent en rien son indexation. Ce qui compte : s'assurer que le moteur sait où trouver vos URLs et peut les crawler sans friction. L'enjeu reste moins le sitemap lui-même que la capacité de Google à accéder au contenu et à le juger digne d'indexation.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur la notion de « découverte » plutôt que d'indexation ?

Parce que soumettre une URL via un sitemap ne crée aucune obligation pour Google. Le moteur prend connaissance de l'existence de la page, mais c'est tout. La décision d'indexer ou non dépend ensuite de critères de qualité, de duplication, de budget crawl, de cannibalisation potentielle.

En clair : un sitemap est un signal, pas un ordre. Google reste maître de ses choix d'indexation, et ce document XML ne fait que faciliter la phase amont — la découverte — sans préjuger de la suite.

Quelle différence entre « exploration » et « indexation » dans ce contexte ?

L'exploration (crawl), c'est le passage du bot sur une URL pour en récupérer le contenu. L'indexation, c'est la décision d'ajouter cette page à l'index et de la rendre éligible au classement dans les résultats. Le sitemap n'influe que sur la première étape.

Google peut très bien crawler une page découverte via sitemap et décider de ne pas l'indexer — parce qu'elle est jugée de faible qualité, trop similaire à d'autres, ou tout simplement inutile pour l'utilisateur. Le crawl n'est qu'une condition nécessaire, pas suffisante.

Que signifie concrètement « exploré sans obstacles » ?

Cela renvoie aux barrières techniques qui empêchent Googlebot d'accéder au contenu : robots.txt bloquant, redirections en chaîne, temps de réponse serveur trop long, JavaScript mal géré, pages orphelines non liées. Un sitemap ne compense pas ces problèmes.

Si votre infrastructure est bancale, le sitemap devient un cache-misère. Google découvrira les URLs, tentera de les crawler, échouera ou abandonnera — et vous vous retrouverez avec des pages « Découvertes – actuellement non indexées » dans la Search Console.

- Un sitemap facilite la découverte, il ne force pas l'indexation

- L'indexation dépend de la qualité du contenu et de l'absence de freins techniques

- Un sitemap ne remplace ni un bon maillage interne, ni une architecture propre

- Google peut crawler sans indexer — le sitemap n'y change rien

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Totalement. On voit régulièrement des sites avec des sitemaps impeccables mais des taux d'indexation catastrophiques. Pourquoi ? Parce que Google a crawlé, a évalué, et a décidé de ne pas indexer. Le sitemap a joué son rôle — signaler les URLs — mais la qualité n'a pas suivi.

À l'inverse, des sites sans sitemap mais avec un maillage interne solide et du contenu de qualité s'en sortent très bien. Le sitemap est un confort, pas une béquille. Si votre site est bien architecturé, Google trouvera vos pages de toute façon.

Dans quels cas un sitemap devient-il vraiment indispensable ?

Pour les gros sites avec des milliers de pages, notamment ceux qui publient fréquemment (médias, e-commerce à catalogues vastes, places de marché). Le sitemap accélère la découverte des nouvelles URLs et limite le risque que des pages récentes passent inaperçues.

Mais aussi pour les sites avec des sections mal liées — des silos étanches, des pages profondes difficiles d'accès. Dans ce cas, le sitemap compense partiellement un maillage interne défaillant. Soyons honnêtes : ce n'est pas la solution idéale, mais ça peut éviter que certaines pages restent invisibles.

Quelles erreurs les praticiens commettent-ils encore avec les sitemaps ?

Première erreur : y inclure toutes les URLs du site sans distinction. Pages de mentions légales, paramètres de filtres, variantes linguistiques mal gérées, contenus thin — tout y passe. Résultat : Google perd du temps à crawler des pages sans intérêt.

Deuxième erreur : croire qu'un sitemap mal entretenu est mieux que pas de sitemap. Si votre fichier contient des URLs en 404, des redirections, des pages bloquées par le robots.txt, il devient contre-productif. Google détecte ces incohérences et ajuste à la baisse la confiance accordée à ce signal.

Troisième erreur : ne pas segmenter les sitemaps par type de contenu. Un site e-commerce avec produits, catégories, blog, pages institutionnelles devrait avoir plusieurs sitemaps. Cela facilite le suivi dans la Search Console et permet d'identifier précisément où se situent les problèmes d'indexation.

Impact pratique et recommandations

Que faut-il auditer en priorité sur votre sitemap actuel ?

Commencez par vérifier que toutes les URLs présentes dans le sitemap retournent un code 200. Pas de redirections, pas de 404, pas de pages bloquées par le robots.txt. Chaque URL doit être accessible directement et proprement.

Ensuite, assurez-vous que seules les pages stratégiques et indexables figurent dans le sitemap. Excluez tout ce qui porte une balise noindex, tout ce qui est en canonique vers une autre page, tout ce qui relève de la navigation technique (paramètres de tri, filtres, pagination mal gérée).

Enfin, vérifiez la fréquence de mise à jour du sitemap. Si vous publiez du contenu quotidiennement mais que votre sitemap n'est régénéré qu'une fois par semaine, Google perd du temps. Automatisez la mise à jour pour qu'elle reflète en temps réel l'état de votre site.

Quelles actions techniques concrètes mettre en place dès maintenant ?

Segmentez vos sitemaps par type de contenu — produits, catégories, articles, pages statiques. Cela facilite le suivi granulaire dans la Search Console et permet d'identifier précisément les sections problématiques.

Ajoutez la balise <lastmod> pour chaque URL, en indiquant la vraie date de dernière modification. Google l'utilise pour prioriser le crawl des pages récemment mises à jour. Ne mentez pas sur cette date : si vous indiquez une modification hier alors que la page n'a pas changé depuis 6 mois, vous érodez la confiance du moteur.

Implémentez un système de monitoring qui alerte automatiquement si le sitemap contient des erreurs (URLs 404, redirections, pages bloquées). Un sitemap qui pourrit silencieusement devient un handicap.

- Vérifier que toutes les URLs du sitemap retournent un code 200

- Exclure les pages en noindex, canonicalisées ou non stratégiques

- Segmenter les sitemaps par type de contenu (produits, articles, catégories)

- Automatiser la mise à jour du sitemap à chaque publication ou modification

- Ajouter la balise <lastmod> avec des dates fiables

- Monitorer régulièrement le sitemap pour détecter les erreurs (404, redirections)

- Vérifier dans la Search Console le taux de couverture des URLs soumises

- Ne pas dépasser 50 000 URLs par fichier sitemap (ou 50 Mo non compressé)

Comment s'assurer que cette optimisation produit des résultats mesurables ?

Suivez dans la Search Console le rapport de couverture lié à votre sitemap. Comparez le nombre d'URLs soumises au nombre d'URLs indexées. Un écart important signale un problème de qualité ou d'accessibilité, pas un problème de sitemap.

Mesurez également le délai entre publication et indexation pour vos contenus frais. Si votre sitemap est bien configuré et que votre contenu est de qualité, ce délai devrait être court — quelques heures à quelques jours selon la fréquence de crawl de votre site.

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/12/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.