Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Robots.txt vs no-index : pourquoi tant de pros SEO mélangent encore ces deux mécanismes ?

- □ Faut-il vraiment optimiser tout le site après une mise à jour algorithmique ?

- □ Search Console intègre les données IA : mais savez-vous vraiment ce que vous mesurez ?

- □ Faut-il vraiment optimiser différemment son site pour les AI Overviews de Google ?

- □ Google Trends est-il vraiment un outil stratégique pour orienter sa ligne éditoriale SEO ?

- □ Comment Search Console peut-il vraiment révéler ce que cherche votre audience ?

- □ Le SEO est-il vraiment mort ou juste en train de muter sous nos yeux ?

- □ Comment la qualité du contenu influence-t-elle directement le taux d'indexation par Google ?

- □ Un sitemap suffit-il vraiment à garantir l'indexation de vos pages ?

- □ Comment Google Trends utilise-t-il réellement le Knowledge Graph pour identifier les topics ?

- □ L'index Google a-t-il vraiment une limite de capacité ?

- □ Le marketing traditionnel est-il devenu indispensable pour ranker sur Google ?

- □ Les données structurées sont-elles vraiment inutiles pour le classement SEO ?

- □ Faut-il vraiment faire vérifier toutes vos traductions automatiques pour le SEO ?

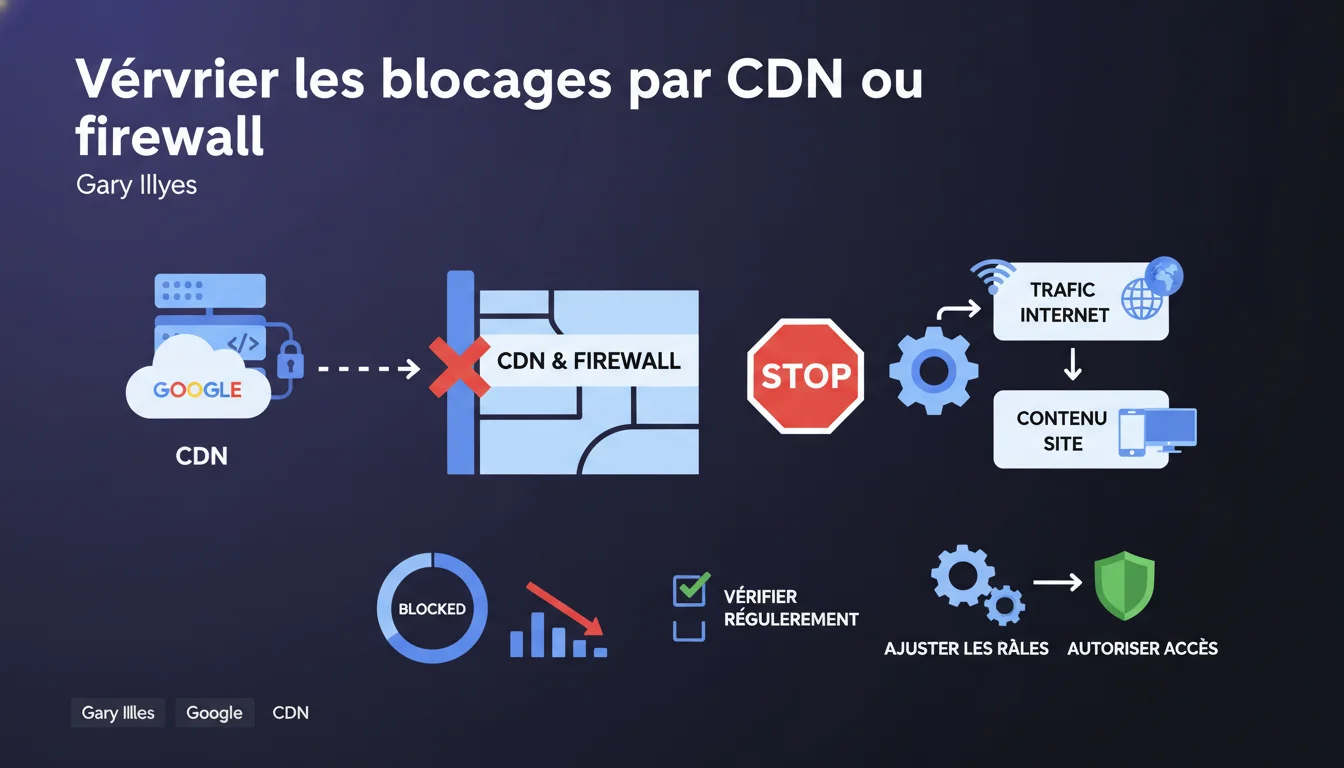

Les CDN et pare-feu peuvent bloquer automatiquement Googlebot via des règles que vous n'avez pas configurées vous-même. Gary Illyes rappelle qu'un audit régulier de ces couches techniques est indispensable pour éviter une désindexation partielle ou totale. Ce n'est pas un risque théorique — c'est un cas de figure documenté qui frappe même des sites bien gérés.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur ce point maintenant ?

Parce que les CDN et WAF modernes embarquent des systèmes de protection adaptatifs qui évoluent en permanence. Une mise à jour de règles côté Cloudflare, Akamai ou Imperva peut suffire à déclencher un blocage inopiné de Googlebot.

Le problème, c'est que ces ajustements sont souvent automatiques et opaques. Vous n'êtes pas notifié, vous ne recevez pas d'alerte — et pendant ce temps, votre site devient invisible pour Google.

Quels types de blocages sont concernés ?

On parle de rate limiting trop agressif, de règles anti-bot mal calibrées, de géofiltrage qui cible par erreur les IP de Googlebot, ou encore de CAPTCHAs servis aux crawlers.

Les CDN détectent parfois un pic de requêtes légitimes (Google qui crawl une section mise à jour, par exemple) et l'interprètent comme une attaque DDoS. Résultat : Googlebot se prend un 403 ou un 503, et vos pages ne sont plus crawlées.

Est-ce que Google peut contourner ces blocages ?

Non. Contrairement à ce que certains croient encore, Google ne dispose pas de passe-droit technique pour forcer l'accès à votre contenu si votre infrastructure le bloque.

Si Googlebot reçoit un code de réponse bloquant ou un délai d'attente dépassé, il enregistre l'échec et repasse plus tard — ou abandonne si le problème persiste. C'est pour ça que ces blocages peuvent détruire votre crawl budget et provoquer une érosion progressive du trafic organique.

- Les CDN modernes appliquent des règles automatiques qui peuvent bloquer Googlebot sans intervention humaine

- Google ne contourne pas les blocages — il enregistre l'erreur et réduit la fréquence de crawl

- Un audit régulier des logs CDN/WAF est indispensable pour détecter ces situations avant qu'elles n'impactent le trafic

- Les mises à jour de règles côté fournisseur sont souvent silencieuses et peuvent créer des régressions inattendues

Avis d'un expert SEO

Cette recommandation est-elle alignée avec ce qu'on observe sur le terrain ?

Complètement. J'ai vu des sites perdre 30 à 40 % de leur trafic organique en trois semaines à cause d'une règle Cloudflare activée par défaut après une migration de plan tarifaire. Le client n'avait rien touché — c'est le CDN qui avait appliqué un preset plus strict.

Ce qui est vicieux, c'est que Google Search Console ne remonte pas toujours ces erreurs immédiatement. Vous pouvez avoir des soft blocks (rate limiting qui ralentit mais ne bloque pas totalement) qui passent sous le radar pendant des semaines, le temps que Google réduise progressivement sa couverture de crawl.

Quels sont les fournisseurs les plus problématiques ?

Soyons honnêtes : Cloudflare, Sucuri et Imperva reviennent régulièrement dans les diagnostics. Pas parce qu'ils sont mauvais — au contraire, leurs protections sont efficaces — mais justement parce qu'elles sont trop efficaces par défaut.

Les configurations « out of the box » ciblent la sécurité maximale, pas l'optimisation SEO. Si vous activez le « I'm Under Attack Mode » de Cloudflare ou un challenge JavaScript systématique, vous tuez votre crawl. Et certains prestataires l'activent sans même vous demander votre avis.

Faut-il whitelister Googlebot manuellement ?

Oui, et pas seulement Googlebot — aussi Googlebot-Image, Googlebot-Video, Google-InspectionTool, Storebot (pour le Merchant Center), et idéalement les autres moteurs si vous êtes multi-marché (Bingbot, Yandex, Baidu).

Mais attention : une whitelist mal configurée peut ouvrir une faille de sécurité si vous vous basez uniquement sur le User-Agent, qui est facilement spoofable. Il faut whitelister par plage IP officielle (Google publie ses ranges via DNS lookup) et vérifier régulièrement qu'elles sont à jour.

Impact pratique et recommandations

Comment vérifier si votre CDN bloque Googlebot ?

Première étape : croiser les logs d'accès de votre CDN avec ceux de Google Search Console. Si GSC remonte des erreurs 403, 503 ou des timeouts sur des URLs stratégiques, allez vérifier les logs bruts côté CDN pour confirmer que ces requêtes ont bien été bloquées.

Deuxième étape : utiliser l'outil « Inspection d'URL » dans GSC et demander une indexation en temps réel. Si l'exploration échoue avec une erreur serveur, c'est probablement votre couche de protection qui intervient. Comparez ensuite avec un test depuis votre navigateur — si vous voyez la page mais que Google ne la voit pas, c'est un blocage ciblé.

Troisième étape : auditer les règles actives dans votre WAF/CDN. Cloudflare a une section « Firewall Events », Akamai propose des dashboards similaires. Cherchez les hits sur des User-Agents Google, les rate limits dépassés, les CAPTCHA servis à des bots légitimes.

Quelles erreurs critiques faut-il absolument éviter ?

Ne jamais activer un challenge JavaScript obligatoire pour toutes les requêtes. Google peut exécuter du JS, mais ça ralentit le crawl et augmente le risque d'échec. Si vous devez le faire, exemptez au minimum les bots vérifiés.

Ne pas se fier uniquement au User-Agent pour whitelister. Les attaquants le spoofent systématiquement. Utilisez les reverse DNS lookups (Google documente la méthode officielle) ou les plages IP publiées par Google.

Éviter les configurations « set and forget ». Un CDN, ça se monitore. Si vous n'avez pas d'alerte automatique quand Googlebot se prend un 403, vous êtes en aveugle — et vous ne découvrirez le problème que quand le trafic aura déjà chuté.

Que faut-il mettre en place concrètement ?

- Auditer les règles actives dans votre CDN/WAF et identifier celles qui ciblent les bots

- Whitelister les User-Agents officiels de Google par plage IP vérifiée (pas uniquement par UA)

- Configurer des alertes automatiques sur les erreurs 403/503 servies aux crawlers dans GSC

- Croiser régulièrement les logs CDN avec les rapports de couverture GSC pour détecter les incohérences

- Tester l'accès Googlebot via l'outil d'inspection d'URL après chaque mise à jour de règles CDN

- Désactiver les modes de protection extrêmes (« Under Attack Mode ») sauf en cas d'attaque avérée, et les désactiver dès que la menace est passée

- Documenter toutes les exceptions SEO dans votre firewall pour éviter qu'elles ne soient écrasées lors d'une migration ou d'une mise à jour

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/12/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.