Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Robots.txt vs no-index : pourquoi tant de pros SEO mélangent encore ces deux mécanismes ?

- □ Faut-il vraiment optimiser tout le site après une mise à jour algorithmique ?

- □ Search Console intègre les données IA : mais savez-vous vraiment ce que vous mesurez ?

- □ Faut-il vraiment optimiser différemment son site pour les AI Overviews de Google ?

- □ Google Trends est-il vraiment un outil stratégique pour orienter sa ligne éditoriale SEO ?

- □ Comment Search Console peut-il vraiment révéler ce que cherche votre audience ?

- □ Le SEO est-il vraiment mort ou juste en train de muter sous nos yeux ?

- □ Comment la qualité du contenu influence-t-elle directement le taux d'indexation par Google ?

- □ Un sitemap suffit-il vraiment à garantir l'indexation de vos pages ?

- □ Votre CDN ou firewall bloque-t-il Googlebot sans que vous le sachiez ?

- □ Comment Google Trends utilise-t-il réellement le Knowledge Graph pour identifier les topics ?

- □ Le marketing traditionnel est-il devenu indispensable pour ranker sur Google ?

- □ Les données structurées sont-elles vraiment inutiles pour le classement SEO ?

- □ Faut-il vraiment faire vérifier toutes vos traductions automatiques pour le SEO ?

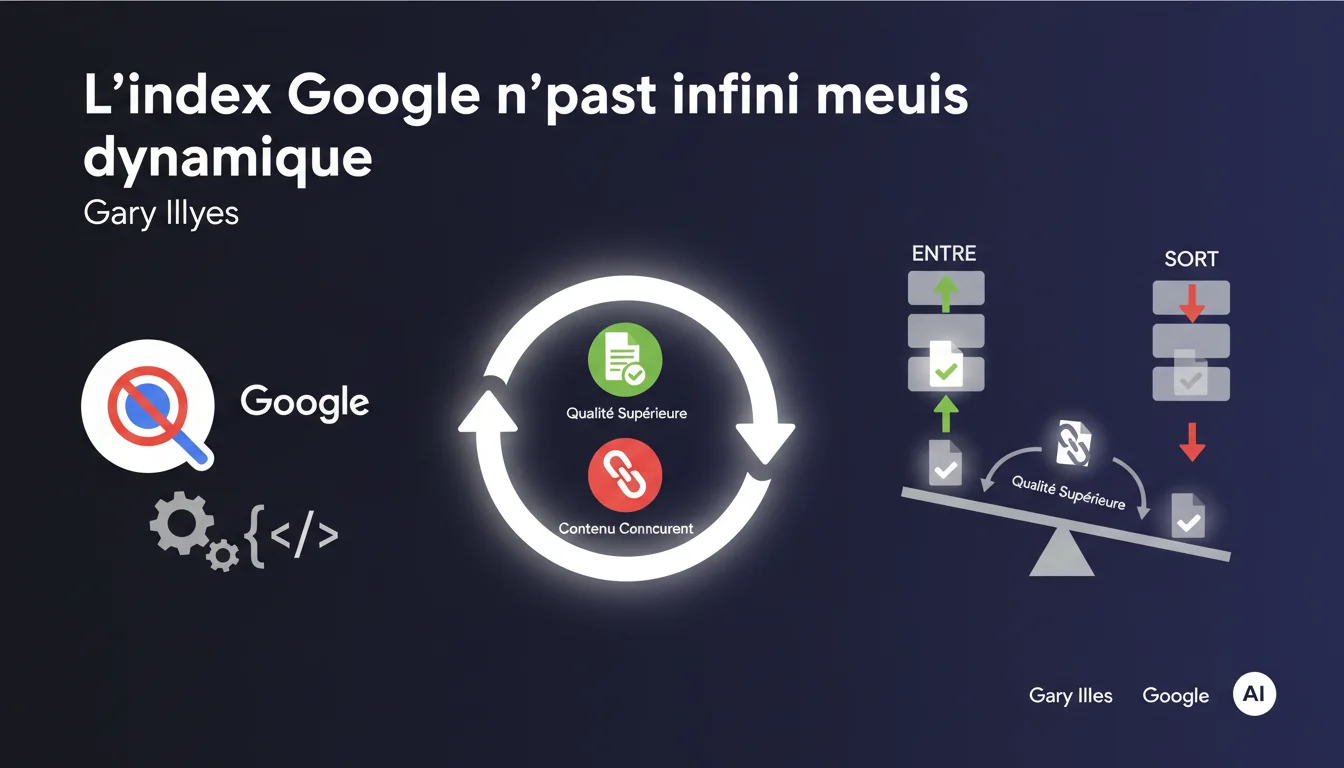

L'index de Google n'est pas infini et fonctionne comme un espace à capacité limitée. Les pages entrent et sortent dynamiquement selon leur qualité relative : publier du contenu supérieur à celui d'un concurrent peut faire sortir ce dernier de l'index pour laisser place au vôtre. C'est une guerre d'occupation d'espace, pas juste une course à l'indexation.

Ce qu'il faut comprendre

Qu'est-ce que ça signifie concrètement qu'un index ait une "limite technique" ?

Google ne peut pas stocker et indexer l'intégralité du web. Il y a des contraintes physiques : serveurs, datacenters, capacité de traitement.

Mais la vraie limite n'est pas tant absolue que relative. Google choisit en permanence quelles pages méritent d'occuper cet espace précieux. Si ton contenu n'apporte rien de plus que ce qui existe déjà, il peut être écarté — ou ne jamais entrer.

Comment fonctionne ce mécanisme "dynamique" d'entrée-sortie ?

L'index n'est pas figé. Des pages disparaissent de l'index même si elles sont techniquement accessibles et crawlables. D'autres y entrent après avoir été ignorées pendant des mois.

Gary Illyes parle ici d'un principe de compétition directe : si tu publies mieux qu'un concurrent sur un sujet donné, ta page peut prendre sa place. Ce n'est pas du ranking (position dans les résultats), c'est de l'indexation elle-même.

Pourquoi cette déclaration arrive-t-elle maintenant ?

Parce que trop de SEO s'imaginent encore que "crawlé = indexé". Faux. Le Googlebot peut crawler ta page sans jamais la mettre dans l'index si elle ne passe pas la barre qualité.

Avec l'explosion du contenu généré par IA, Google doit gérer un tsunami de pages médiocres. Cette déclaration pose un cadre explicite : on ne garde que ce qui a de la valeur différenciante.

- L'index Google a une capacité limitée, ce n'est pas un entrepôt sans fond

- Les pages entrent et sortent selon leur qualité relative par rapport aux concurrents

- Crawler une page ne garantit pas son indexation

- La compétition ne se joue pas qu'au niveau du ranking, mais dès l'indexation elle-même

Avis d'un expert SEO

Cette déclaration remet-elle en cause ce qu'on sait du fonctionnement de Google ?

Non, mais elle officialise ce que beaucoup d'entre nous observent depuis des années. Les disparitions mystérieuses de pages de l'index, les "Crawled - currently not indexed" qui explosent dans la Search Console — tout ça prend sens.

Ce qui est neuf, c'est la franchise du message. Google admet ouvertement qu'il y a une forme de rationnement. Que l'index n'est pas un droit acquis, mais un privilège mérité.

Quelles nuances faut-il apporter à cette affirmation ?

Soyons honnêtes : Google ne va pas désindexer Amazon ou Wikipedia parce que tu as publié un meilleur article. La "qualité" dont parle Gary n'est pas absolue — elle dépend aussi du contexte, de l'autorité du domaine, de l'historique.

Un nouveau site avec du contenu excellent peut mettre des mois à obtenir sa place, même s'il surpasse objectivement la concurrence. La confiance dans le domaine reste un facteur déterminant. Et c'est là que ça coince : le mécanisme décrit par Gary est réel, mais il ne s'applique pas avec la même vitesse ni la même équité partout.

Autre nuance : les pages sortent et rentrent de l'index. Ce n'est pas toujours définitif. Une page peut disparaître temporairement, puis revenir — parfois sans qu'on comprenne pourquoi.

Ce discours n'est-il pas une manière de justifier l'incompétence du moteur ?

On peut le voir comme ça. "Désolé, on a plus de place" sonne comme une excuse facile quand ton contenu légitime n'est pas indexé alors que des fermes de contenu IA pullulent dans l'index.

Mais la réalité technique est là : Google ne peut pas tout garder. Le problème, c'est que leurs critères de tri sont opaques et parfois incohérents. Ils te disent "fais du contenu de qualité", mais la définition de cette qualité reste floue.

Impact pratique et recommandations

Que faut-il faire concrètement pour sécuriser sa présence dans l'index ?

D'abord, arrête de publier pour publier. Chaque nouvelle page doit apporter une valeur différenciante par rapport à ce qui existe déjà — y compris sur ton propre site.

Ensuite, consolide ton existant. Si tu as des pages faibles qui ne servent à rien, supprime-les ou fusionne-les. Mieux vaut 50 pages solides dans l'index que 500 pages dont 400 sont ignorées.

Surveille la Search Console comme le lait sur le feu. Les statuts "Crawled - currently not indexed" ou "Discovered - currently not indexed" sont des signaux d'alerte. Si ces statuts explosent, c'est que Google considère ton contenu comme non-prioritaire.

Comment éviter de se faire éjecter de l'index par un concurrent ?

Maintiens tes contenus à jour. Une page qui date de 5 ans et qui n'a jamais été retouchée est une cible facile. Actualise régulièrement tes articles stratégiques, ajoute des données récentes, améliore la structure.

Renforce les signaux d'autorité : liens internes cohérents, maillage thématique solide, backlinks de qualité. Si deux pages se battent pour une place dans l'index, c'est celle qui bénéficie du meilleur contexte d'autorité qui gagne.

Et surtout, différencie-toi. Ne réécris pas la même chose que tout le monde avec des mots différents. Apporte un angle unique, des données exclusives, une expertise réelle. Le contenu générique est une espèce en voie de disparition.

- Auditer régulièrement les statuts d'indexation dans la Search Console

- Supprimer ou consolider les pages à faible valeur ajoutée

- Actualiser les contenus stratégiques au moins tous les 6-12 mois

- Renforcer le maillage interne vers les pages prioritaires

- Éviter la publication de contenu générique ou dupliqué

- Surveiller l'apparition de nouveaux concurrents sur tes requêtes clés

- Investir dans des contenus différenciants (données exclusives, études, expertises)

Quelles erreurs éviter face à cette réalité de l'index limité ?

Ne panique pas si quelques pages sortent temporairement de l'index. C'est parfois temporaire. Attends quelques semaines avant de prendre des décisions radicales.

Évite de multiplier les pages quasi-identiques. Les facettes e-commerce à l'infini, les variations mineures de contenu — tout ça peut te desservir dans un contexte d'index rationné.

Et ne crois pas que la technique seule va te sauver. Un site techniquement parfait mais avec du contenu médiocre sera éjecté au profit d'un site moyen techniquement mais avec un contenu exceptionnel.

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/12/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.