Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Robots.txt vs no-index : pourquoi tant de pros SEO mélangent encore ces deux mécanismes ?

- □ Faut-il vraiment optimiser tout le site après une mise à jour algorithmique ?

- □ Search Console intègre les données IA : mais savez-vous vraiment ce que vous mesurez ?

- □ Faut-il vraiment optimiser différemment son site pour les AI Overviews de Google ?

- □ Google Trends est-il vraiment un outil stratégique pour orienter sa ligne éditoriale SEO ?

- □ Comment Search Console peut-il vraiment révéler ce que cherche votre audience ?

- □ Le SEO est-il vraiment mort ou juste en train de muter sous nos yeux ?

- □ Un sitemap suffit-il vraiment à garantir l'indexation de vos pages ?

- □ Votre CDN ou firewall bloque-t-il Googlebot sans que vous le sachiez ?

- □ Comment Google Trends utilise-t-il réellement le Knowledge Graph pour identifier les topics ?

- □ L'index Google a-t-il vraiment une limite de capacité ?

- □ Le marketing traditionnel est-il devenu indispensable pour ranker sur Google ?

- □ Les données structurées sont-elles vraiment inutiles pour le classement SEO ?

- □ Faut-il vraiment faire vérifier toutes vos traductions automatiques pour le SEO ?

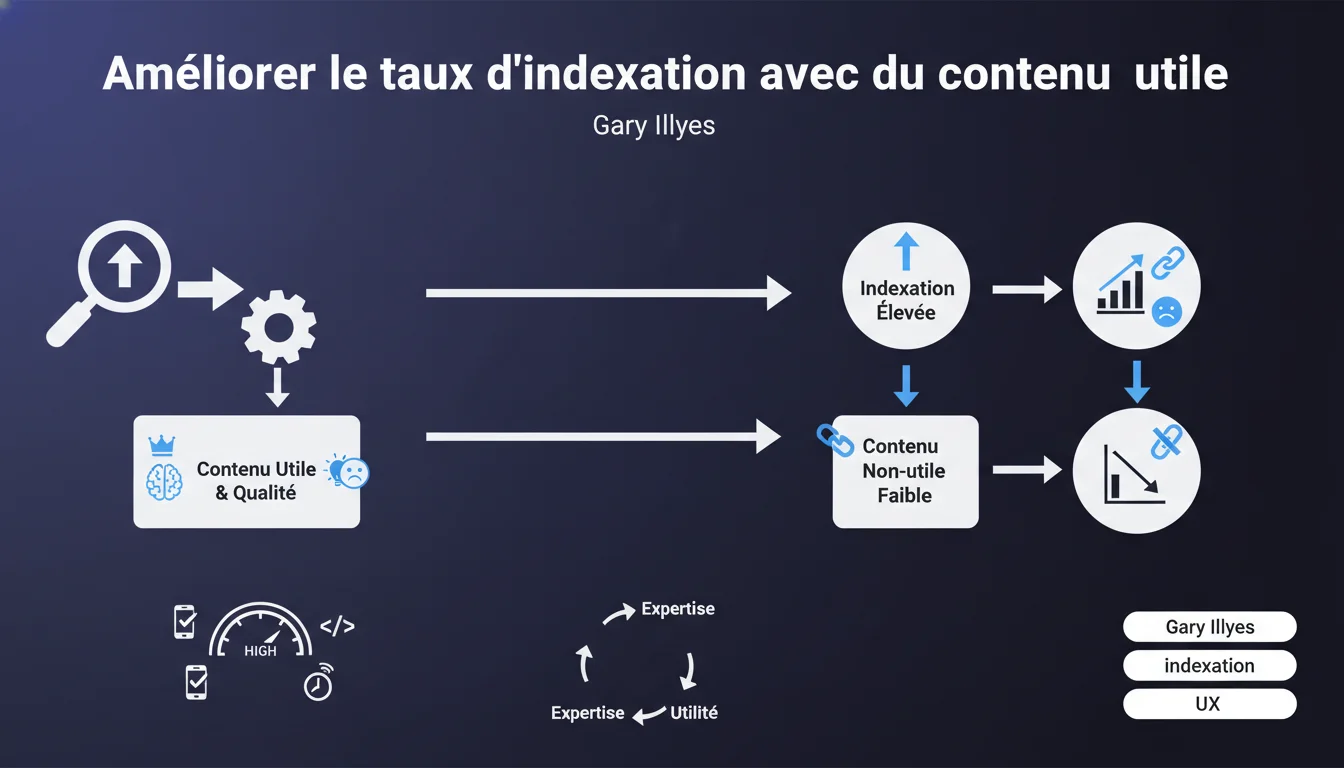

Google affirme que le taux d'indexation dépend directement de la qualité et de l'utilité du contenu pour les utilisateurs. Publier du contenu peu utile ou de faible expertise entraîne une baisse des taux d'indexation. La stratégie de volume sans qualité devient donc contre-productive pour la visibilité organique.

Ce qu'il faut comprendre

Qu'est-ce que Google entend par « taux d'indexation » ?

Le taux d'indexation désigne la proportion de pages d'un site que Google choisit effectivement d'ajouter à son index parmi toutes celles qu'il a explorées. Ce n'est pas une simple question de crawl — Googlebot peut visiter une page sans jamais l'indexer.

Cette distinction est fondamentale. Beaucoup de sites souffrent d'un budget de crawl insuffisant, mais encore plus d'un problème de sélectivité : Google explore, mais refuse d'indexer. Et selon cette déclaration, c'est la qualité perçue du contenu qui détermine cette décision.

Pourquoi Google lie-t-il indexation et utilité du contenu ?

Google optimise ses ressources. Indexer des milliards de pages coûte en stockage et calcul. Si le contenu n'apporte rien aux utilisateurs, l'indexer devient un gaspillage — et Google l'évite désormais activement.

Cette logique s'inscrit dans la continuité des Helpful Content Updates. L'algorithme ne se contente plus de classer : il filtre en amont. Les sites qui multiplient les pages faibles voient leur taux d'indexation chuter, même si techniquement tout est crawlable.

Que signifie « contenu créé avec expertise » dans ce contexte ?

L'expertise ici ne se résume pas à E-E-A-T. Google cherche des signaux concrets : profondeur de traitement, données originales, expérience de première main, cohérence thématique.

Un contenu « expert » répond à une intention utilisateur de manière exhaustive et crédible. Ce n'est pas une question de longueur — des pages courtes mais denses peuvent surperformer des pavés génériques.

- Le taux d'indexation devient un indicateur qualité, pas seulement technique

- Google filtre activement les pages jugées peu utiles avant indexation

- L'expertise et la valeur ajoutée sont désormais des critères d'indexation, pas seulement de ranking

- Les stratégies de volume sans qualité sont sanctionnées dès l'indexation

- Un site peut être techniquement parfait mais sous-indexé si le contenu est faible

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. Depuis fin 2022, on observe des chutes d'indexation massives sur des sites qui produisaient en masse du contenu générique ou automatisé. Des milliers de pages disparaissent de l'index sans erreur technique apparente.

Les outils comme Search Console montrent des pages « Explorée, actuellement non indexée » en explosion. Le pattern est clair : Google explore, évalue, puis rejette. Ce n'est plus un problème de robots.txt ou de sitemap — c'est un jugement éditorial automatisé.

Quelles nuances faut-il apporter à cette affirmation ?

Soyons honnêtes : « utile » reste flou. Google ne publie aucun seuil quantifiable. Un même contenu peut être indexé sur un site autoritaire et rejeté sur un domaine récent — l'autorité du domaine joue encore.

Et c'est là que ça coince. Cette déclaration laisse entendre que la qualité suffit, mais on sait que la structure technique, les signaux de confiance et l'historique du domaine pèsent lourd dans la décision d'indexation. Un nouveau site avec du contenu excellent peut galérer pendant des mois.

Cette approche favorise-t-elle vraiment l'utilisateur final ?

En théorie oui, en pratique c'est discutable. Google réduit le bruit, c'est positif. Mais l'algorithme confond parfois « niche » et « peu utile ». Des contenus spécialisés avec une audience réduite mais réelle peuvent être exclus de l'index.

Concrètement ? Des sites B2B ultra-techniques, des ressources académiques pointues, des blogs experts sur des sujets de niche perdent de la visibilité. Google privilégie le mainstream, au risque d'appauvrir la diversité de l'information indexée.

Impact pratique et recommandations

Que faut-il auditer en priorité sur son site ?

Commencez par Search Console, rapport « Pages ». Filtrez sur « Explorée, actuellement non indexée » et « Détectée, actuellement non indexée ». Ces pages sont votre priorité absolue.

Analysez leur profil : sont-elles vraiment utiles ? Apportent-elles quelque chose d'unique ? Si oui, il faut renforcer leur signal de qualité. Si non, mieux vaut les fusionner ou les supprimer — polluer l'index avec du faible affecte l'ensemble du site.

Quelles erreurs éviter absolument ?

Première erreur : croire qu'augmenter le volume compensera la chute d'indexation. C'est l'inverse. Publier plus de contenu médiocre accélère la dégradation du taux d'indexation.

Deuxième erreur : négliger la mise à jour du contenu existant. Google réévalue l'utilité en continu. Des pages indexées depuis des années peuvent basculer en « non indexée » si elles deviennent obsolètes ou dépassées par la concurrence.

Troisième erreur : sous-estimer l'importance des signaux d'engagement. Google observe le comportement utilisateur post-clic. Un contenu que personne ne lit, même indexé, finit par disparaître.

Comment adapter concrètement sa stratégie de contenu ?

Passez d'une logique de volume à une logique de densité. Mieux vaut 10 pages exceptionnelles que 100 pages correctes. Concentrez vos ressources sur du contenu qui démontre une véritable expertise.

Intégrez des données originales, des études de cas, de l'expérience terrain. Ce sont les marqueurs d'utilité que Google valorise. Le contenu générique reformulé n'a plus sa place — même bien écrit.

- Auditer les pages « Explorée, actuellement non indexée » dans Search Console

- Évaluer honnêtement l'utilité réelle de chaque page : apporte-t-elle quelque chose d'unique ?

- Fusionner ou supprimer les contenus faibles plutôt que de les laisser polluer le site

- Réduire le volume de publication et augmenter la profondeur de traitement

- Enrichir le contenu existant avec des données originales et de l'expérience de première main

- Mettre à jour régulièrement les pages anciennes pour maintenir leur pertinence

- Surveiller les signaux d'engagement (temps passé, scroll, interactions) comme indicateurs d'utilité

- Abandonner les stratégies de « content farms » ou de production automatisée

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/12/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.