Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Googlebot signale-t-il des soft 404 sur vos pages géolocalisées vides ?

- □ Le cloaking géolocalisé est-il vraiment acceptable pour Google ?

- □ Afficher du contenu national par défaut est-il considéré comme du cloaking par Google ?

- □ Le cloaking est-il vraiment un problème si l'utilisateur n'est pas trompé ?

- □ Faut-il attendre avant de juger l'impact d'une mise à jour algorithmique Google ?

- □ Pourquoi l'analyse des fichiers logs est-elle indispensable pour les gros sites ?

- □ Pourquoi une page vide détruit-elle votre expérience utilisateur et votre SEO ?

- □ Comment garantir une expérience cohérente avec les attentes utilisateur sans risquer une pénalité pour cloaking ?

- □ Faut-il vraiment comparer l'état réel des pages avant et après une baisse de trafic ?

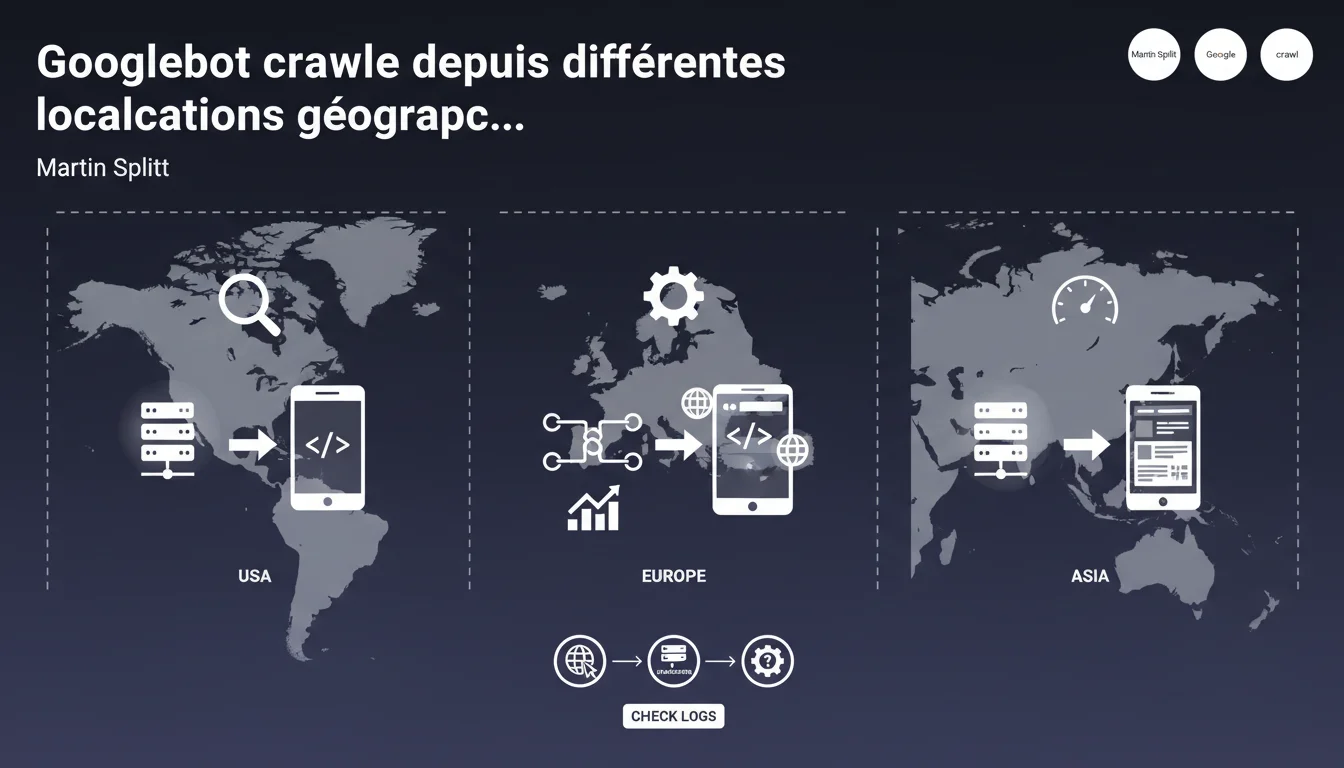

Googlebot ne crawle pas uniquement depuis les États-Unis : il peut accéder à vos pages depuis différentes localisations géographiques. Si votre site adapte son contenu selon la géolocalisation de l'utilisateur, Google risque d'indexer des versions différentes selon l'origine du crawl. Vérifier les IP dans vos logs devient une étape indispensable pour comprendre ce que Google voit réellement.

Ce qu'il faut comprendre

Pourquoi Google crawle-t-il depuis plusieurs pays ?

Google ne se contente plus d'explorer le web depuis un seul datacenter centralisé. Googlebot distribue maintenant son crawl à travers plusieurs zones géographiques, ce qui lui permet de mieux comprendre comment les sites adaptent leur contenu selon la localisation des visiteurs.

Cette approche répond à une réalité simple : de nombreux sites web proposent du contenu différent selon le pays d'origine de l'utilisateur. Redirection automatique vers une version locale, affichage de prix en devise locale, modification des produits disponibles — autant de pratiques courantes que Google veut désormais capturer fidèlement.

Quelles conséquences concrètes pour l'indexation ?

Le problème devient évident quand on y réfléchit : si votre site sert du contenu différent selon la géolocalisation, Google peut indexer des versions contradictoires de vos pages. Un crawl depuis les États-Unis verra une chose, un crawl depuis l'Allemagne en verra une autre.

Martin Splitt insiste sur un point précis : analyser les adresses IP dans vos logs serveur n'est plus optionnel. C'est le seul moyen fiable d'identifier d'où provient réellement le crawl de Googlebot et donc quel contenu a été indexé.

Comment identifier l'origine géographique du crawl ?

Les logs serveur contiennent les adresses IP de chaque requête effectuée par Googlebot. En croisant ces IP avec leur localisation géographique, vous pouvez déterminer depuis quel pays Google a accédé à chaque page.

Cette information devient critique pour diagnostiquer des incohérences d'indexation. Si une page n'apparaît pas dans les résultats comme prévu, vérifier l'origine du crawl peut révéler que Google a indexé une version géolocalisée non souhaitée.

- Googlebot crawle depuis plusieurs localisations géographiques, pas uniquement depuis les États-Unis

- Les sites avec contenu géolocalisé peuvent être indexés différemment selon l'origine du crawl

- L'analyse des adresses IP dans les logs permet d'identifier la provenance exacte du crawl

- Cette pratique de Google vise à mieux comprendre les variations de contenu selon la localisation

- Sans vérification des logs, impossible de savoir quelle version de votre contenu Google a réellement indexée

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Oui, et ce n'est pas une nouveauté récente. Les SEO qui analysent leurs logs serveur régulièrement ont constaté depuis plusieurs années que Googlebot apparaît avec des IP provenant de différents pays. Ce qui change, c'est que Google l'officialise clairement.

Martin Splitt reste cependant vague sur un point essentiel : comment Google choisit-il depuis quelle localisation crawler une page donnée ? [À vérifier] Aucune information sur la fréquence, la logique de sélection, ou si certaines pages sont systématiquement crawlées depuis plusieurs localisations. Cette opacité complique l'anticipation.

Quels risques réels pour les sites internationaux ?

Le danger principal concerne les sites qui redirigent automatiquement selon l'IP sans laisser d'alternative. Si Googlebot crawle depuis la France et que vous redirigez systématiquement vers /fr/, la version anglaise ou allemande risque de ne jamais être indexée correctement.

Autre cas problématique : les sites qui affichent du contenu radicalement différent selon la géolocalisation (prix, disponibilité produits, mentions légales). Google peut indexer une version qui ne correspond pas à votre cible prioritaire. Soyons honnêtes — beaucoup de sites e-commerce tombent dans ce piège sans même s'en rendre compte.

Faut-il traiter Googlebot différemment selon son origine ?

Non, et c'est justement l'erreur à éviter. Servir un contenu différent à Googlebot selon son IP relève du cloaking, une pratique explicitement sanctionnée par Google. L'objectif doit être de montrer à tous les crawls la même structure, quitte à utiliser hreflang pour indiquer les variantes linguistiques.

La vraie question devient : comment s'assurer que Google crawle bien toutes vos versions internationales ? La réponse passe par une architecture technique claire (sous-domaines ou sous-répertoires dédiés), des balises hreflang correctes, et surtout — l'absence de redirections automatiques basées uniquement sur l'IP.

Impact pratique et recommandations

Comment vérifier d'où Googlebot crawle mon site ?

Première étape : activer et analyser vos logs serveur. Vous avez besoin de voir les adresses IP exactes des requêtes effectuées par Googlebot. Des outils comme Oncrawl, Botify ou des scripts personnalisés permettent de croiser ces IP avec leur géolocalisation.

Concrètement ? Exportez vos logs, filtrez les user-agents Googlebot, récupérez les IP, puis utilisez une base de données de géolocalisation (MaxMind par exemple) pour identifier leur origine. Si vous constatez des crawls depuis des pays que vous ne ciblez pas, creusez pour comprendre pourquoi.

Quelles erreurs éviter avec du contenu géolocalisé ?

Ne redirigez jamais automatiquement en fonction de l'IP sans offrir d'alternative visible. Google doit pouvoir accéder à toutes vos versions linguistiques/régionales sans être forcé sur une seule. Utilisez plutôt une bannière suggérant un changement de version, ou un sélecteur de langue accessible.

Évitez également de bloquer complètement certaines sections de votre site selon la géolocalisation. Si un produit n'est pas disponible en France, mieux vaut afficher une page avec une mention claire plutôt qu'une 403 ou une redirection vers la homepage.

Que faire si Google indexe la mauvaise version de mes pages ?

Vérifiez d'abord vos balises hreflang — elles doivent pointer correctement vers toutes les variantes de chaque page. Ensuite, contrôlez dans vos logs quel contenu Googlebot reçoit réellement selon son origine géographique.

Si vous constatez des incohérences, testez manuellement l'accès à vos pages depuis différentes localisations (VPN, proxies). Comparez ce que vous voyez avec ce qui apparaît dans l'index Google via des recherches localisées (paramètre &gl= dans l'URL).

- Activer l'enregistrement détaillé des logs serveur avec user-agent et IP

- Analyser régulièrement la géolocalisation des IP de Googlebot

- Vérifier que toutes vos versions régionales/linguistiques sont accessibles sans redirection forcée

- Implémenter correctement les balises hreflang sur toutes les variantes de pages

- Tester l'accès à vos pages depuis différentes localisations géographiques

- Comparer le contenu servi avec ce qui apparaît dans l'index Google par pays

- Éviter tout blocage ou modification de contenu basé uniquement sur l'IP

- Documenter les variations de contenu légitimes (prix, disponibilité) de manière transparente

❓ Questions frequentes

Googlebot crawle-t-il toutes mes pages depuis plusieurs pays ?

Dois-je autoriser tous les pays dans mon pare-feu pour Googlebot ?

Les redirections 302 géolocalisées posent-elles problème ?

Comment savoir quelle version de ma page Google a indexée ?

Est-ce que Search Console indique d'où provient le crawl ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/12/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.