Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Googlebot signale-t-il des soft 404 sur vos pages géolocalisées vides ?

- □ Le cloaking géolocalisé est-il vraiment acceptable pour Google ?

- □ Afficher du contenu national par défaut est-il considéré comme du cloaking par Google ?

- □ Le cloaking est-il vraiment un problème si l'utilisateur n'est pas trompé ?

- □ Googlebot crawle-t-il vraiment votre site depuis plusieurs pays ?

- □ Faut-il attendre avant de juger l'impact d'une mise à jour algorithmique Google ?

- □ Pourquoi l'analyse des fichiers logs est-elle indispensable pour les gros sites ?

- □ Comment garantir une expérience cohérente avec les attentes utilisateur sans risquer une pénalité pour cloaking ?

- □ Faut-il vraiment comparer l'état réel des pages avant et après une baisse de trafic ?

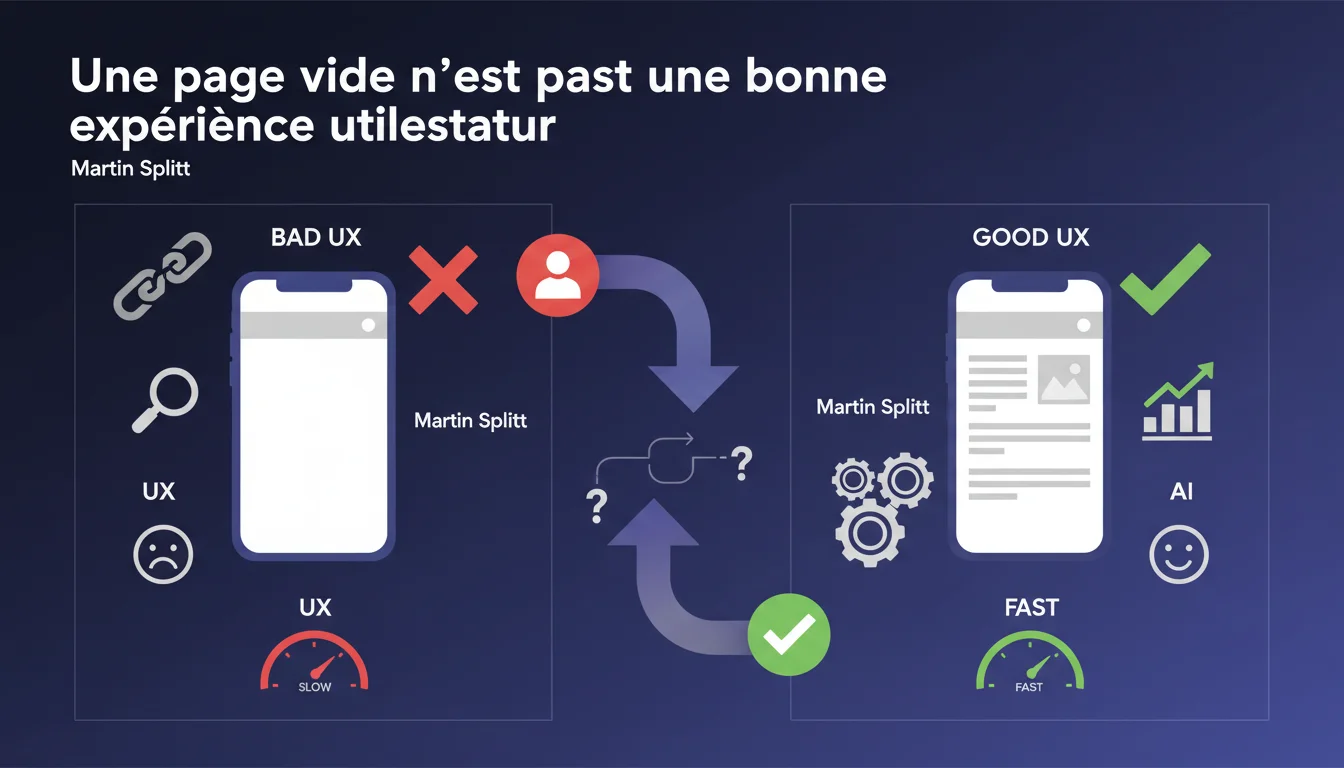

Google considère qu'afficher une page vide aux utilisateurs qui refusent la géolocalisation constitue une mauvaise expérience utilisateur. Mieux vaut toujours proposer du contenu par défaut plutôt que de laisser une page blanche. Cette position impacte directement la qualité perçue de votre site par les crawlers et les utilisateurs.

Ce qu'il faut comprendre

Quel est le contexte de cette déclaration de Martin Splitt ?

De nombreux sites conditionnent l'affichage de leur contenu à l'acceptation de la géolocalisation. Certains poussent cette logique jusqu'à afficher une page complètement vide si l'utilisateur refuse de partager sa position.

Cette pratique pose un double problème. D'abord côté utilisateur : une page blanche ne donne aucune information sur ce que propose le site, aucune raison de rester. Ensuite côté crawl : Googlebot ne partage pas de géolocalisation — il voit donc potentiellement la même page vide que les utilisateurs récalcitrants.

Que signifie vraiment « mauvaise expérience utilisateur » pour Google ?

Quand Google parle d'expérience utilisateur, il pense d'abord au comportement observé. Une page vide génère mécaniquement un taux de rebond élevé, un temps de visite nul et aucun engagement. Ces signaux sont interprétés comme une absence de pertinence.

La notion d'UX chez Google est indissociable des Core Web Vitals et des métriques comportementales. Une page vide peut techniquement charger vite — mais elle échoue sur tous les critères qualitatifs : utilité, pertinence, satisfaction.

Pourquoi afficher du contenu par défaut plutôt que rien ?

Proposer un contenu par défaut permet de maintenir une valeur minimale pour tous les visiteurs, quel que soit leur niveau de consentement. Cela peut être une liste générique de produits, une carte nationale, une sélection éditoriale non géolocalisée.

Cette approche préserve l'indexation. Si Googlebot arrive sur votre page et trouve du contenu à crawler, il peut l'évaluer et le classer. Une page vide, c'est du vide indexé — autant dire un gaspillage de crawl budget et un signal négatif.

- Une page vide provoque rebond immédiat et absence d'engagement

- Googlebot ne partage pas de géolocalisation et verra la version vide

- Proposer du contenu par défaut maintient une valeur minimale pour l'indexation

- L'expérience utilisateur se mesure aussi en comportement : temps, interactions, satisfaction

- Une page techniquement rapide mais vide échoue sur les critères qualitatifs

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, totalement. Les sites qui bloquent l'accès au contenu via des mécanismes de consentement agressifs (géoloc, cookies, notifications push) voient systématiquement leurs performances SEO se dégrader. Le cas de la géolocalisation est même plus critique que celui des cookies : les navigateurs et les crawlers la refusent par défaut.

J'ai vu des e-commerces perdre 40% de leur trafic organique après avoir conditionné l'affichage de leurs fiches produits à l'activation de la géoloc. Googlebot indexait des pages vides, les positionnait mal, puis les déclassait progressivement. Le signal était limpide : pas de contenu visible = pas de pertinence.

Dans quels cas cette règle peut-elle être nuancée ?

Il existe des cas limites — par exemple un site de petites annonces hyper-locales où la géolocalisation est intrinsèque au service. Mais même là, mieux vaut afficher un message explicatif, une carte nationale cliquable ou une recherche par code postal que du vide total.

Certains développeurs pensent contourner le problème en affichant un spinner ou un loader permanent. Mauvaise idée : c'est techniquement du contenu, mais c'est encore pire côté UX et signaux comportementaux. [À vérifier] — Google n'a jamais explicité comment il traite les loaders infinis, mais les métriques utilisateur parlent d'elles-mêmes.

Quelles implications pour les sites multi-langues ou multi-régions ?

Beaucoup de sites internationaux utilisent la géoloc pour rediriger automatiquement vers la bonne version linguistique ou régionale. Si cette redirection échoue (refus de géoloc), il faut absolument afficher une landing page par défaut avec sélecteur manuel.

Google privilégie les sites qui laissent l'utilisateur choisir — et qui affichent du contenu même en l'absence de détection automatique. C'est un équilibre entre personnalisation et accessibilité. Ne jamais sacrifier l'accessibilité au profit d'une expérience hyper-personnalisée qui exclut une partie des visiteurs.

Impact pratique et recommandations

Que faut-il faire concrètement pour éviter les pages vides ?

Première étape : auditer les pages qui dépendent de la géolocalisation. Utilisez les outils de développement de votre navigateur pour bloquer manuellement l'accès à la géoloc et parcourir votre site. Notez toutes les pages qui s'affichent vides ou bloquées.

Ensuite, implémentez un contenu de fallback : une version par défaut, générique, accessible à tous. Pour un site e-commerce, ça peut être l'intégralité du catalogue sans filtrage géographique. Pour un site de services locaux, une carte interactive avec recherche manuelle par ville.

Testez aussi avec Google Search Console et l'outil d'inspection d'URL. Regardez comment Googlebot rend vos pages — si vous voyez du vide alors que votre navigateur affiche du contenu, vous avez un problème de rendu JavaScript ou de détection serveur.

Quelles erreurs techniques éviter absolument ?

Ne conditionnez jamais l'affichage du HTML à une variable JavaScript côté client qui dépend de la géoloc. Le contenu doit être présent dans le DOM initial, quitte à le masquer ou l'ajuster ensuite si l'utilisateur consent.

Évitez les pop-ups ou modales bloquantes qui empêchent l'accès au contenu tant que la géoloc n'est pas acceptée. Google peut les considérer comme des interstitiels intrusifs — une pratique déjà pénalisée depuis des années, surtout sur mobile.

Ne comptez pas sur une redirection 302 temporaire basée sur la géoloc pour gérer plusieurs versions d'une page. Google peut mal interpréter ces redirections et indexer la mauvaise version. Préférez un contenu unique avec personnalisation progressive.

Comment vérifier que mon site est conforme aux attentes de Google ?

Utilisez le test de compatibilité mobile et l'outil d'inspection d'URL dans Search Console. Comparez le rendu avec et sans consentement géoloc. Analysez vos Core Web Vitals : une page vide charge vite mais aura un LCP catastrophique si le contenu n'apparaît jamais.

Surveillez vos métriques comportementales dans Google Analytics : taux de rebond, temps sur page, pages par session. Une hausse brutale du rebond sur certaines pages peut signaler un problème d'affichage conditionnel.

Enfin, testez sur plusieurs navigateurs et appareils. Chrome, Safari et Firefox gèrent différemment les permissions de géolocalisation — ce qui fonctionne sur l'un peut échouer sur l'autre.

- Auditer toutes les pages dépendant de la géolocalisation en bloquant manuellement l'accès

- Implémenter un contenu de fallback générique visible par défaut

- Vérifier le rendu Googlebot via Search Console et l'outil d'inspection d'URL

- Ne jamais conditionner l'affichage du HTML initial à une variable JavaScript côté client

- Éviter les pop-ups bloquantes demandant la géoloc avant d'accéder au contenu

- Tester le site sur plusieurs navigateurs et appareils avec géoloc désactivée

- Surveiller les métriques comportementales : rebond, temps, engagement

- Analyser les Core Web Vitals, notamment le LCP, sur les pages concernées

❓ Questions frequentes

Googlebot partage-t-il des données de géolocalisation lors du crawl ?

Peut-on utiliser une détection IP côté serveur pour contourner ce problème ?

Une page vide impacte-t-elle le crawl budget ?

Les Core Web Vitals sont-ils affectés par une page vide ?

Faut-il utiliser un code HTTP spécifique si l'utilisateur refuse la géoloc ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/12/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.