Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Googlebot signale-t-il des soft 404 sur vos pages géolocalisées vides ?

- □ Le cloaking géolocalisé est-il vraiment acceptable pour Google ?

- □ Afficher du contenu national par défaut est-il considéré comme du cloaking par Google ?

- □ Le cloaking est-il vraiment un problème si l'utilisateur n'est pas trompé ?

- □ Googlebot crawle-t-il vraiment votre site depuis plusieurs pays ?

- □ Faut-il attendre avant de juger l'impact d'une mise à jour algorithmique Google ?

- □ Pourquoi l'analyse des fichiers logs est-elle indispensable pour les gros sites ?

- □ Pourquoi une page vide détruit-elle votre expérience utilisateur et votre SEO ?

- □ Comment garantir une expérience cohérente avec les attentes utilisateur sans risquer une pénalité pour cloaking ?

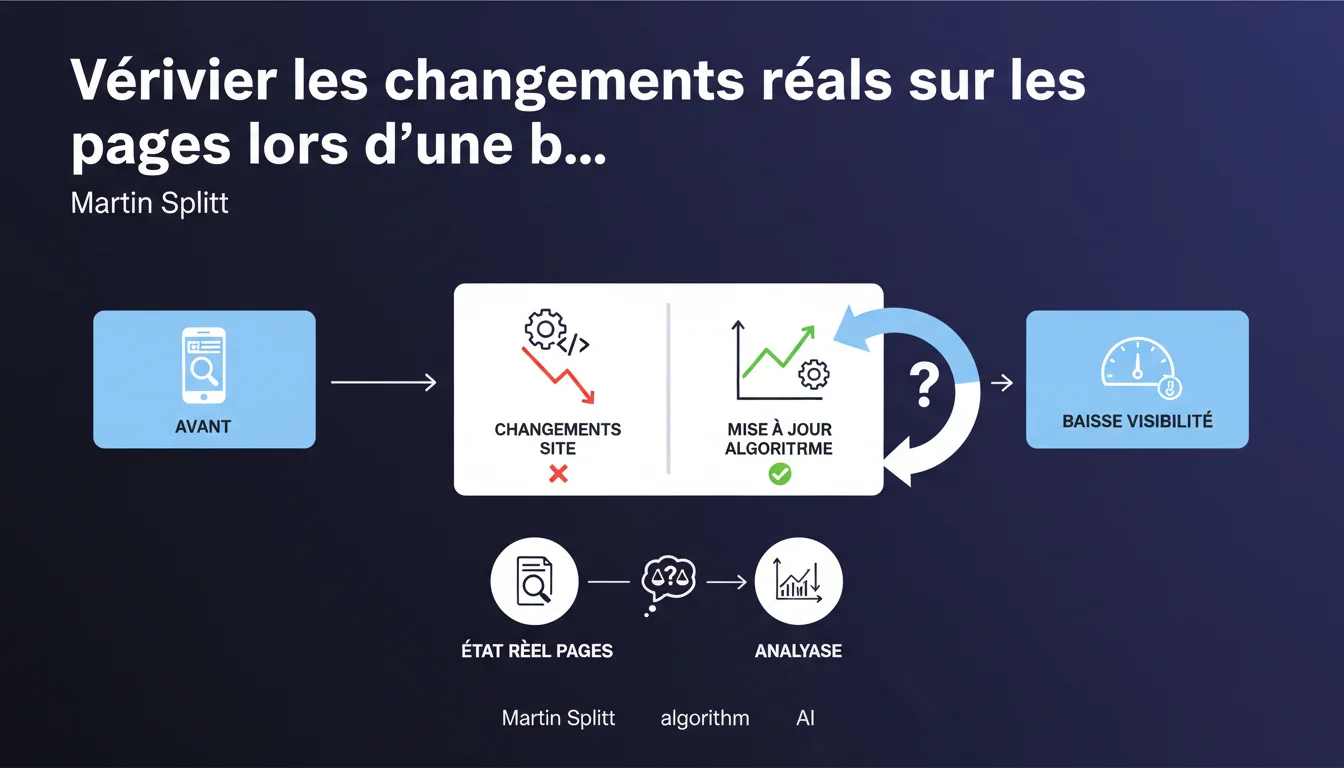

Google rappelle qu'une baisse de visibilité n'est pas toujours liée à une mise à jour algorithmique. Avant d'accuser l'algorithme, il faut vérifier si des modifications ont été apportées aux pages elles-mêmes — car c'est souvent là que se trouve l'explication.

Ce qu'il faut comprendre

Pourquoi cette déclaration semble-t-elle si évidente ?

Parce qu'elle l'est. Martin Splitt ne révolutionne rien ici. Il recentre le débat sur un réflexe de base : avant de crier au Core Update, on vérifie si on n'a pas cassé quelque chose soi-même.

Le problème, c'est que trop de sites accusent Google de tous les maux alors qu'une modification de template, un changement de CMS ou une refonte mal gérée explique la chute. Google n'a pas bougé — c'est le site qui a changé.

Qu'est-ce qui constitue un "changement réel" sur une page ?

Ici, on parle de modifications techniques ou éditoriales visibles par Googlebot. Pas juste un bouton de couleur différente.

Ça inclut : restructuration du contenu, suppression de blocs de texte, ajout de JavaScript bloquant le rendu, balises title/meta modifiées, redirections mal configurées, contenus passés en no-index par erreur, changements de serveur avec latence accrue, etc.

Comment Google détecte-t-il ces changements ?

Google crawle, indexe, compare. Si le contenu HTML rendu diffère entre deux passages, l'algorithme peut réévaluer la pertinence de la page.

Le delta peut être subtil : une balise canonical qui change, un schema markup mal formaté, un temps de chargement qui explose. Tout ça impacte le classement — indépendamment de toute mise à jour.

- Une baisse de trafic coïncidant avec une mise à jour Google n'implique pas forcément une pénalité algorithmique.

- Comparer l'état réel des pages (HTML, temps de réponse, contenu rendu) avant/après est indispensable pour diagnostiquer une chute.

- Les outils de crawl historique (Wayback Machine, archives internes, logs serveur) sont essentiels pour cette analyse.

- Google ne communique pas sur chaque micro-ajustement — donc attribuer une baisse à "l'algo" sans preuve est une erreur méthodologique.

Avis d'un expert SEO

Cette déclaration est-elle vraiment utile ou juste du bon sens ?

Les deux. C'est du bon sens, oui — mais un bon sens souvent négligé sous pression client. Quand le trafic chute de 40%, l'urgence pousse à chercher un coupable externe (Google) plutôt qu'à auditer méthodiquement ses propres changements.

Martin Splitt rappelle une discipline de base : tenir un journal des modifications. Sans ça, impossible de corréler une baisse à une action précise. Combien de sites n'ont aucune traçabilité de leurs déploiements ? Trop.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si le site n'a strictement rien changé (ni contenu, ni technique, ni hébergement) et qu'une baisse brutale survient le jour d'un Core Update confirmé, alors oui, l'algo est probablement en cause.

Mais même là, il faut croiser avec les données concurrentes : si tout le secteur baisse, c'est sectoriel. Si seul ton site plonge, c'est toi. [A vérifier] : Google ne fournit pas d'outil officiel pour comparer l'état indexé d'une page à deux dates précises — on doit bricoler avec Cache Google (quand il existe encore), archives, et crawls.

Quelle est la vraie difficulté pratique ?

Reconstituer l'état exact d'une page telle que Googlebot l'a vue à une date antérieure. Le code source actuel ne suffit pas si du JavaScript modifie le DOM après coup.

Il faut crawler avec un outil qui rend le JS (Screaming Frog en mode JavaScript, OnCrawl, Botify, etc.), comparer les snapshots HTML, croiser avec les logs serveur pour voir si Googlebot a bien recrawlé après la modif. C'est chronophage — et souvent négligé faute de ressources internes.

Impact pratique et recommandations

Que faut-il faire concrètement face à une baisse de trafic ?

Première étape : dresser la timeline des modifications. Git commits, tickets JIRA, logs de déploiement, mises à jour CMS/plugins, changements serveur. Tout doit être daté.

Deuxième étape : comparer l'état crawlé avant/après. Si tu n'as pas de crawl historique, utilise Wayback Machine, Google Cache (si encore dispo), ou les snapshots de ton outil SEO (Oncrawl, Botify, Semrush Site Audit gardent parfois l'historique).

Quels outils utiliser pour cette comparaison ?

Pour le contenu et structure HTML : Screaming Frog en mode comparaison de crawls, diff tools (WinMerge, Beyond Compare) sur des exports HTML. Pour le rendu JS : un crawler headless (Puppeteer, Playwright) qui capture le DOM final.

Pour les logs serveur : Botify Log Analyzer, OnCrawl, ou scripts maison (Python + pandas) pour croiser dates de crawl Google et dates de modification. Si Googlebot n'a pas recrawlé après ta modif, la baisse ne peut pas venir de là.

Comment éviter de reproduire l'erreur ?

Mettre en place un process de validation SEO pré-déploiement. Checklist technique (balises, redirects, canonicals, temps de réponse), crawl de staging, comparaison diff, tests en environnement sandbox avant la prod.

Automatiser autant que possible : tests unitaires sur les balises critiques, monitoring temps réel post-déploiement (alertes si le nombre de pages indexables chute, si les title changent massivement, etc.).

- Tenir un journal exhaustif de toutes les modifications (code, contenu, infra, plugins tiers)

- Crawler le site régulièrement et archiver les snapshots HTML (au minimum mensuel, idéalement hebdo)

- Configurer des alertes Search Console sur les erreurs d'indexation et les variations brutales de clics

- Croiser la date de baisse avec les logs serveur pour vérifier si Googlebot a recrawlé juste après une modif

- Comparer le HTML rendu (post-JS) et pas seulement le source brut

- Auditer les dépendances externes (CDN, scripts tiers, plugins) qui peuvent changer sans que tu le saches

- Ne pas attribuer systématiquement une baisse à un Core Update sans preuve objective

❓ Questions frequentes

Comment savoir si une baisse est due à une mise à jour Google ou à une modification interne ?

Quels outils permettent de comparer l'état d'une page à deux dates différentes ?

Faut-il comparer le HTML source ou le HTML rendu après JavaScript ?

Un changement de CDN ou d'hébergeur peut-il expliquer une baisse de trafic ?

Google fournit-il un outil officiel pour voir l'historique d'indexation d'une page ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/12/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.