Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Googlebot signale-t-il des soft 404 sur vos pages géolocalisées vides ?

- □ Afficher du contenu national par défaut est-il considéré comme du cloaking par Google ?

- □ Le cloaking est-il vraiment un problème si l'utilisateur n'est pas trompé ?

- □ Googlebot crawle-t-il vraiment votre site depuis plusieurs pays ?

- □ Faut-il attendre avant de juger l'impact d'une mise à jour algorithmique Google ?

- □ Pourquoi l'analyse des fichiers logs est-elle indispensable pour les gros sites ?

- □ Pourquoi une page vide détruit-elle votre expérience utilisateur et votre SEO ?

- □ Comment garantir une expérience cohérente avec les attentes utilisateur sans risquer une pénalité pour cloaking ?

- □ Faut-il vraiment comparer l'état réel des pages avant et après une baisse de trafic ?

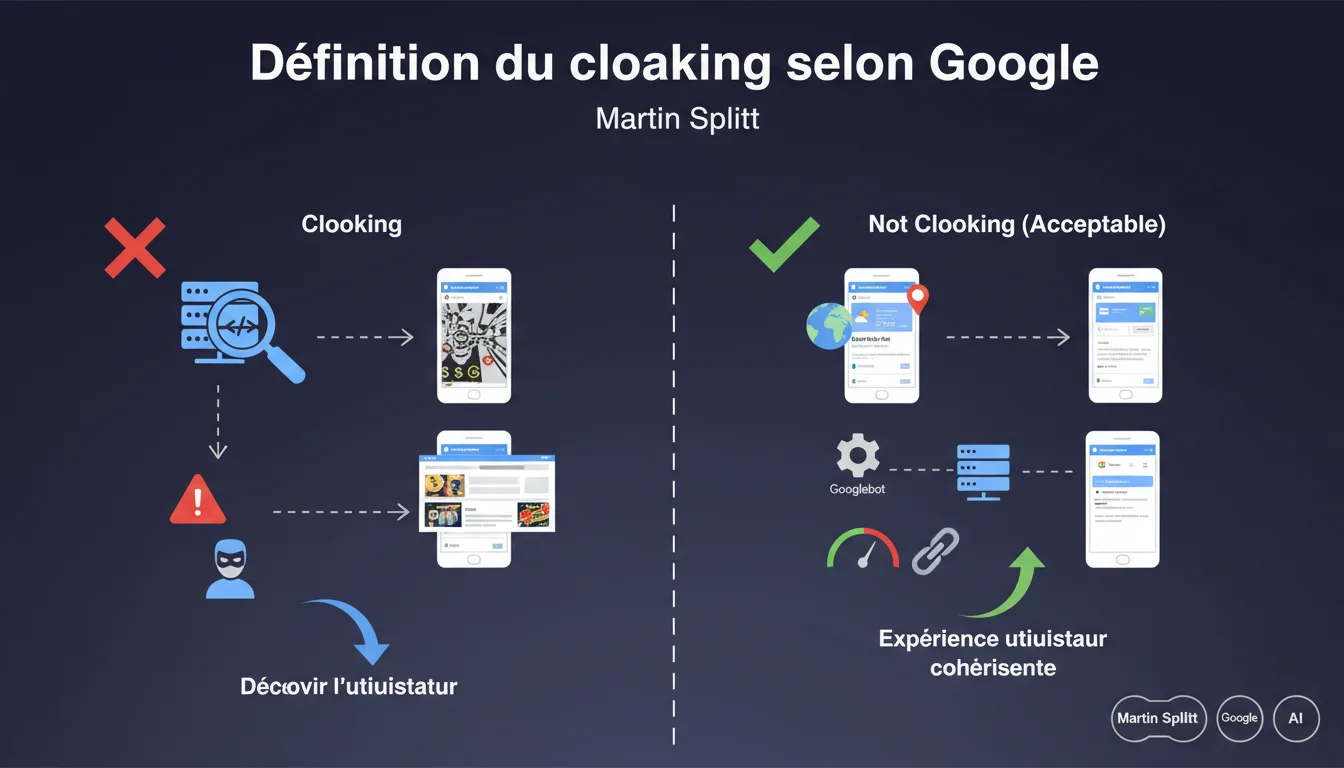

Google redéfinit le cloaking : afficher du contenu différent selon la géolocalisation n'est pas forcément une manipulation, tant que l'expérience utilisateur reste cohérente et que ce n'est pas ciblé spécifiquement sur Googlebot. La nuance est cruciale : c'est l'intention de tromper qui caractérise le cloaking, pas simplement la variation de contenu.

Ce qu'il faut comprendre

Qu'est-ce qui distingue vraiment le cloaking d'une personnalisation légitime ?

Martin Splitt déplace le curseur : le cloaking n'est pas défini par la différence de contenu en soi, mais par l'intention de tromper. Un site e-commerce qui affiche des prix en euros pour la France et en dollars pour les États-Unis ne fait pas du cloaking — il adapte son contenu à son audience.

La distinction tient en un mot : cohérence. Si un utilisateur français atterrit sur une page et voit du contenu pertinent pour la France, il n'y a pas tromperie. Si Googlebot voit une version optimisée bourée de mots-clés pendant que l'utilisateur voit du contenu vide ou différent, là on bascule dans l'abus.

Pourquoi Google précise-t-il « pas spécifiquement pour Googlebot » ?

C'est le point de friction principal. Tout contenu servi différemment à Googlebot par rapport aux utilisateurs déclenche un signal d'alerte. Google tolère la géolocalisation tant qu'elle s'applique uniformément — utilisateurs ET crawlers.

Concrètement : si votre site détecte l'IP de Googlebot et lui sert une version survitaminée alors que les vrais visiteurs voient autre chose, vous êtes en infraction. La règle est simple : Googlebot doit voir ce que voit un utilisateur lambda dans les mêmes conditions géographiques.

Quelles implications pour les stratégies multi-régionales ?

Cette clarification ouvre la porte à des pratiques SEO géolocalisées assumées : pages spécifiques par pays, redirections basées sur l'IP, contenus adaptés aux législations locales. Tant que c'est transparent et cohérent, Google ne pénalise pas.

La limite reste floue pour les cas complexes — serveurs CDN qui distribuent du contenu selon la latence, A/B testing géolocalisé, contenus dynamiques basés sur la langue du navigateur. Google ne détaille pas ces zones grises.

- Le cloaking = intention de tromper, pas simplement variation de contenu

- La géolocalisation est tolérée si elle sert l'utilisateur, pas uniquement le bot

- Googlebot doit voir la même expérience qu'un utilisateur dans sa zone géographique

- La cohérence entre promesse (dans les SERPs) et contenu livré est le critère clé

Avis d'un expert SEO

Cette définition est-elle vraiment nouvelle ou juste un rappel ?

Soyons honnêtes : Google a toujours eu une définition vague du cloaking. Les guidelines mentionnent « contenu différent pour les utilisateurs et les moteurs », sans préciser les cas limites. Cette déclaration apporte une nuance bienvenue, mais elle reste insuffisante pour trancher certains cas d'usage courants.

Sur le terrain, on observe que Google tolère de facto certaines formes de personnalisation depuis des années — prix dynamiques, stocks locaux, contenu restreint par région. Ce que Splitt fait ici, c'est officialiser ce qui était déjà une pratique acceptée tacitement.

Dans quels cas cette règle reste-t-elle ambiguë ?

Problème numéro un : comment Google détermine-t-il l'intention de tromper ? Si un site affiche des promos uniquement pour les IP françaises et que Googlebot crawle depuis les USA, est-ce du cloaking ? [À vérifier] — la documentation officielle ne tranche pas.

Deuxième zone grise : les paywalls et contenus premium. Montrer l'article complet à Googlebot et une version tronquée aux utilisateurs non-abonnés — c'est techniquement du contenu différent, mais Google a explicitement validé cette pratique. La cohérence logique avec la définition de Splitt ? Discutable.

Troisième point : les tests A/B géolocalisés. Si vous testez deux versions d'une landing page selon les régions, Googlebot va forcément tomber sur une version ou l'autre. Est-ce acceptable ? Splitt ne le dit pas. D'après les observations terrain, ça passe tant que les deux versions sont SEO-friendly et servent réellement aux utilisateurs.

Les données terrain contredisent-elles cette déclaration ?

Partiellement. On voit régulièrement des sites pénalisés pour personnalisation agressive du contenu — même quand elle est techniquement « cohérente » avec la géolocalisation. Google n'aime pas les variations trop importantes entre régions si elles sentent l'optimisation forcée.

Exemple concret : un site qui affiche 500 mots en France et 2000 mots aux États-Unis, prétextant des « préférences culturelles ». Google peut interpréter ça comme une manipulation, même si l'utilisateur voit bien le contenu promis. La règle non-écrite : les variations doivent être justifiées par des besoins utilisateurs réels, pas par des tactiques SEO.

Impact pratique et recommandations

Que faut-il vérifier sur votre site dès maintenant ?

Première étape : auditez vos règles de personnalisation. Listez tous les cas où votre site sert du contenu différent selon l'IP, la langue, la région. Pour chacun, posez-vous la question : est-ce que cette variation améliore réellement l'expérience utilisateur, ou c'est juste pour bourrer des mots-clés locaux ?

Deuxième vérification : testez ce que voit Googlebot. Utilisez l'outil d'inspection d'URL dans la Search Console, ou simulez le crawl depuis différentes localisations avec des outils comme Screaming Frog configuré avec un user-agent Googlebot. Si vous constatez des écarts entre la version utilisateur et la version bot, creusez.

Quelles erreurs éviter absolument ?

Erreur classique : bloquer ou rediriger Googlebot différemment des utilisateurs. Si votre CDN ou votre pare-feu traite Googlebot comme un cas particulier, vous risquez gros. Googlebot doit suivre le même parcours qu'un visiteur réel de la même région.

Autre piège : les contenus « fantômes » invisibles pour l'utilisateur mais présents pour le bot. Du texte caché en CSS, des listes de mots-clés en blanc sur fond blanc servies uniquement à Googlebot — c'est du cloaking pur et dur, même si vous le justifiez par de la géolocalisation.

Dernière bévue fréquente : ne pas documenter vos choix. Si Google vous envoie une action manuelle, vous devrez prouver que votre personnalisation sert l'utilisateur. Gardez des traces : analytics montrant les taux de conversion par région, études utilisateurs, législations locales imposant certains contenus.

Comment sécuriser votre approche géolocalisée ?

Règle d'or : la transparence. Si vous affichez des prix différents selon les pays, mentionnez-le clairement (« Prix pour la France », sélecteur de région visible). Si vous bloquez du contenu pour des raisons légales, expliquez pourquoi (« Ce produit n'est pas disponible dans votre région »).

Pour les contenus multi-langues, utilisez hreflang correctement. Google doit comprendre que vos variations sont linguistiques/régionales, pas du bourrage SEO. Chaque version doit être indexable et accessible depuis sa région cible.

- Auditez toutes les règles de personnalisation géographique actuelles

- Testez la version crawlée par Googlebot vs. celle vue par les utilisateurs

- Supprimez toute différence de contenu ciblant spécifiquement les bots

- Documentez les raisons business/légales de chaque variation régionale

- Implémentez hreflang pour les contenus multi-langues/régionaux

- Ajoutez des indicateurs visuels clairs (sélecteur de région, mentions de prix locaux)

- Surveillez les actions manuelles dans la Search Console

❓ Questions frequentes

Puis-je afficher des prix différents selon les pays sans risquer une pénalité ?

Est-ce du cloaking si je bloque du contenu pour raisons légales dans certains pays ?

Comment savoir si mon CDN fait du cloaking involontaire ?

Les tests A/B géolocalisés sont-ils considérés comme du cloaking ?

Dois-je utiliser hreflang même si je personnalise juste quelques éléments par région ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/12/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.