Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Faut-il vraiment bloquer les traductions automatiques par IA de votre site en noindex ?

- □ Les recherches site: polluent-elles vos données Search Console ?

- □ Pourquoi Google vous demande d'ignorer les scores de PageSpeed Insights ?

- □ Faut-il vraiment arrêter d'optimiser les Core Web Vitals à tout prix ?

- □ Faut-il se méfier d'un domaine expiré racheté ?

- □ L'IA peut-elle vraiment produire du contenu SEO de qualité avec une simple relecture humaine ?

- □ La traduction automatique peut-elle vraiment pénaliser votre classement SEO ?

- □ Les liens d'affiliation pénalisent-ils vraiment le référencement de vos pages ?

- □ Faut-il vraiment réparer tous les backlinks cassés pointant vers votre site ?

- □ NextJS impose-t-il vraiment des bonnes pratiques SEO spécifiques ?

- □ Peut-on canonicaliser des pages à 93% identiques sans risque pour son SEO ?

- □ Faut-il rediriger ou désactiver un sous-domaine SEO non utilisé ?

- □ Faut-il encore s'inquiéter des liens toxiques pointant vers votre site ?

- □ Faut-il vraiment faire correspondre le titre et le H1 d'une page ?

- □ Le contenu localisé échappe-t-il vraiment à la pénalité pour duplicate content ?

- □ Pourquoi Google déconseille-t-il d'utiliser les requêtes site: pour vérifier l'indexation ?

- □ Pourquoi un bon classement ne garantit-il pas un CTR élevé sur Google ?

- □ Les erreurs JavaScript dans la console impactent-elles vraiment le référencement de votre site ?

- □ Faut-il vraiment une page dédiée par vidéo pour ranker dans les résultats enrichis ?

- □ La syndication de contenu est-elle un pari risqué pour votre visibilité organique ?

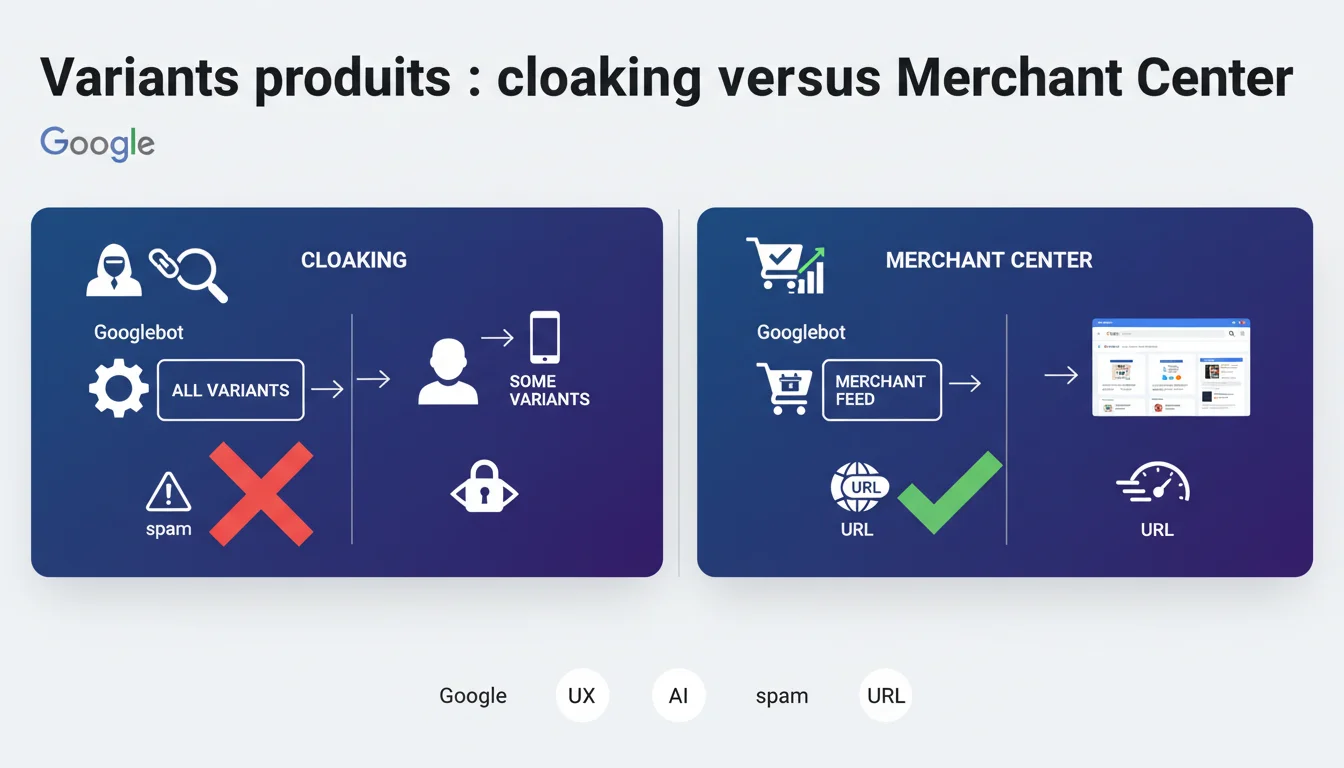

Afficher toutes les variantes d'un produit uniquement à Googlebot (mais pas aux utilisateurs) est considéré comme du cloaking et viole les règles anti-spam de Google. La solution officielle ? Utiliser Merchant Center pour soumettre ces variantes — elles apparaîtront dans les résultats Shopping même si les URL ne sont pas indexées dans la recherche classique. Le e-commerce à deux vitesses est désormais la norme.

Ce qu'il faut comprendre

Le cloaking de variantes produits, c'est quoi exactement ?

Le cloaking, dans sa définition classique, consiste à servir un contenu différent à Googlebot et aux utilisateurs. Google vient ici préciser un cas spécifique : créer des pages listant toutes les variantes d'un produit (couleurs, tailles, matières) uniquement pour le robot, alors que l'utilisateur humain ne voit qu'une version réduite ou un sélecteur dynamique.

Cette pratique est tentante — on multiplie les pages indexables, on capture plus de longue traîne. Sauf que pour Google, c'est une manipulation flagrante de l'index. L'intention est claire : gonfler artificiellement la surface de crawl sans offrir la même expérience à l'utilisateur final.

Pourquoi Google sanctionne-t-il cette approche maintenant ?

Les sites e-commerce ont longtemps jonglé avec cette zone grise. Techniquement, afficher toutes les combinaisons produits pour Googlebot permettait d'améliorer la visibilité organique sur des requêtes ultra-précises. Mais Google a durci le ton : cette pratique dilue la qualité de l'index et crée des duplications massives.

La position officielle est sans appel — si l'utilisateur ne peut pas accéder naturellement à cette page, Googlebot ne devrait pas la voir non plus. C'est une redéfinition stricte du principe d'équité entre bot et humain. Pas de passe-droit, même pour du contenu « techniquement » légitime.

Merchant Center, l'alternative imposée — mais est-ce suffisant ?

Google pousse explicitement vers Merchant Center comme solution de contournement. En soumettant vos variantes via ce flux structuré, elles apparaissent dans Google Shopping et les résultats enrichis, sans nécessiter d'indexation dans la recherche web classique.

Soyons honnêtes : c'est un transfert de pouvoir. Vous abandonnez le contrôle de l'indexation organique classique pour dépendre d'un flux propriétaire Google. Merchant Center devient le passage obligé pour toute stratégie e-commerce sérieuse — et ça, c'est un changement structurel.

- Le cloaking de variantes produits (contenu visible uniquement pour Googlebot) est une violation des règles anti-spam

- Merchant Center devient l'outil recommandé pour soumettre les variantes sans indexation web classique

- Les variantes soumises via Merchant Center apparaissent dans Shopping et les résultats enrichis

- Cette approche marque un basculement vers les flux structurés plutôt que l'indexation HTML traditionnelle

- La distinction bot/humain est désormais une ligne rouge non négociable pour Google

Avis d'un expert SEO

Cette règle est-elle vraiment nouvelle ou juste une clarification ?

Le principe du cloaking est vieux comme le SEO. Ce qui change ici, c'est l'explicitation d'un cas précis : les variantes produits e-commerce. Google n'invente rien, il ferme une porte que certains avaient laissée entrouverte.

En pratique, beaucoup de sites ont déjà pris des pénalités manuelles pour ce type de manipulation — mais sans message clair sur le « pourquoi ». Cette déclaration officialise ce que les SEO avertis savaient déjà : si Googlebot voit 50 URL là où l'utilisateur en voit 5, vous jouez avec le feu. [À vérifier] : est-ce que Google détecte systématiquement ce type de cloaking, ou seulement lors d'audits manuels ? Les retours terrain suggèrent que la détection automatique reste inégale selon les secteurs.

Merchant Center, une solution ou une dépendance déguisée ?

Google vend Merchant Center comme l'alternative propre. En réalité, c'est un verrou stratégique. Vous externalisez vos données produits vers un système propriétaire, vous perdez la maîtrise de l'indexation organique classique, et vous entrez dans une logique de flux où Google décide ce qui remonte ou pas.

Le problème ? Merchant Center est exigeant. Un flux mal structuré, des données incomplètes, des incohérences entre votre site et le feed — et vos variantes disparaissent. Contrairement à une page HTML indexée que vous contrôlez, ici vous dépendez entièrement de la validation Google. C'est un trade-off qu'il faut assumer les yeux ouverts.

[À vérifier] : est-ce que les variantes soumises via Merchant Center bénéficient du même poids SEO que des pages organiques classiques ? Les observations montrent que non — l'affichage dans Shopping n'égale pas une position organique top 3. C'est une visibilité de second ordre.

Dans quels cas cette règle pose-t-elle un vrai dilemme ?

Imaginons un site avec des milliers de variantes (textile, mobilier sur mesure). Créer une page HTML par combinaison serait suicidaire en termes de crawl budget et de cannibalisation. Mais ne pas le faire, c'est renoncer à capter des requêtes ultra-spécifiques comme « robe fleurie taille 42 manches longues ».

La solution Merchant Center ne résout qu'en partie ce dilemme — elle capte le trafic Shopping, mais abandonne la recherche organique classique. Pour des sites qui vivent de la longue traîne SEO, c'est un sacrifice. Il n'y a pas de solution miracle ici, juste un arbitrage entre conformité et performance.

Impact pratique et recommandations

Que faut-il faire concrètement si vous êtes concerné ?

D'abord, auditez votre site. Comparez ce que voit Googlebot (via Search Console ou un crawler configuré avec le user-agent Google) et ce que voit un utilisateur réel. Si vous détectez des pages ou des contenus uniquement accessibles au bot, vous êtes en violation.

Ensuite, basculez vers Merchant Center si ce n'est pas déjà fait. Configurez un flux produit propre avec toutes les variantes, y compris celles qui n'ont pas d'URL dédiée. Utilisez les attributs structurés (color, size, material) pour que Google comprenne les relations entre variantes.

Enfin, supprimez ou consolidez les pages « fantômes » créées pour Googlebot. Si une variante n'a pas de page utilisateur viable, elle ne doit pas être indexée — point. Redirigez proprement vers la page mère ou vers une page de sélection de variantes.

Quelles erreurs éviter absolument ?

Ne jouez pas avec le feu en masquant subtilement du contenu via JavaScript conditionnel ou détection de user-agent. Google a les outils pour détecter ces patterns de cloaking sophistiqué, et les pénalités tombent sans avertissement.

Évitez aussi de négliger Merchant Center sous prétexte que « ça ne remplace pas l'organique ». C'est vrai, mais c'est devenu la seule voie officiellement soutenue pour gérer les variantes sans risque de sanction. Un flux mal géré ou abandonné, c'est une perte sèche de visibilité Shopping.

Attention également aux duplications involontaires. Si vous gardez des URL de variantes indexées tout en les soumettant via Merchant Center, vous créez des conflits. Google ne sait plus quelle version afficher, et vous diluez votre autorité. Choisissez une stratégie, et tenez-vous-y.

Comment vérifier que votre site est conforme ?

Utilisez l'outil Inspection d'URL de Search Console pour comparer le rendu HTML brut et le rendu « tel que vu par Google ». Si des blocs entiers de variantes n'apparaissent que dans le second, c'est un signal d'alarme.

Lancez un crawl avec Screaming Frog ou équivalent en mode Googlebot, puis refaites-le en mode navigateur classique. Exportez les deux listes d'URL et comparez-les. Toute URL présente uniquement dans le crawl bot est potentiellement problématique.

Consultez aussi les rapports de couverture Search Console. Des pages indexées mais non accessibles via navigation utilisateur classique (pas de lien interne, pas de sitemap HTML) sont des indices de cloaking involontaire. Google les indexe parce qu'elles sont dans le sitemap XML, mais aucun utilisateur ne peut y accéder naturellement — c'est exactement ce qu'il faut corriger.

- Auditer la différence entre contenu vu par Googlebot et contenu vu par les utilisateurs réels

- Configurer et optimiser un flux Merchant Center avec toutes les variantes produits

- Supprimer ou rediriger les pages « fantômes » créées uniquement pour les robots

- Éviter toute détection de user-agent pour afficher du contenu différencié

- Comparer les crawls Googlebot vs navigateur pour identifier les écarts

- Vérifier la cohérence entre indexation Search Console et navigation utilisateur

- Choisir une stratégie unique : soit URL indexées classiques, soit flux Merchant Center — pas les deux

❓ Questions frequentes

Puis-je créer des pages de variantes si elles sont accessibles aux utilisateurs ?

Merchant Center remplace-t-il complètement l'indexation organique pour les variantes ?

Comment Google détecte-t-il le cloaking de variantes produits ?

Que faire si mon site a déjà des milliers de variantes indexées ?

Est-ce que l'utilisation de JavaScript pour afficher les variantes est autorisée ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.