Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Faut-il vraiment bloquer les traductions automatiques par IA de votre site en noindex ?

- □ Les recherches site: polluent-elles vos données Search Console ?

- □ Pourquoi Google vous demande d'ignorer les scores de PageSpeed Insights ?

- □ Faut-il vraiment arrêter d'optimiser les Core Web Vitals à tout prix ?

- □ Faut-il se méfier d'un domaine expiré racheté ?

- □ L'IA peut-elle vraiment produire du contenu SEO de qualité avec une simple relecture humaine ?

- □ Les liens d'affiliation pénalisent-ils vraiment le référencement de vos pages ?

- □ Faut-il vraiment réparer tous les backlinks cassés pointant vers votre site ?

- □ NextJS impose-t-il vraiment des bonnes pratiques SEO spécifiques ?

- □ Peut-on canonicaliser des pages à 93% identiques sans risque pour son SEO ?

- □ Faut-il rediriger ou désactiver un sous-domaine SEO non utilisé ?

- □ Faut-il encore s'inquiéter des liens toxiques pointant vers votre site ?

- □ Faut-il vraiment faire correspondre le titre et le H1 d'une page ?

- □ Le contenu localisé échappe-t-il vraiment à la pénalité pour duplicate content ?

- □ Pourquoi Google déconseille-t-il d'utiliser les requêtes site: pour vérifier l'indexation ?

- □ Pourquoi un bon classement ne garantit-il pas un CTR élevé sur Google ?

- □ Les erreurs JavaScript dans la console impactent-elles vraiment le référencement de votre site ?

- □ Pourquoi afficher toutes les variantes produits à Googlebot peut-il détruire votre indexation ?

- □ Faut-il vraiment une page dédiée par vidéo pour ranker dans les résultats enrichis ?

- □ La syndication de contenu est-elle un pari risqué pour votre visibilité organique ?

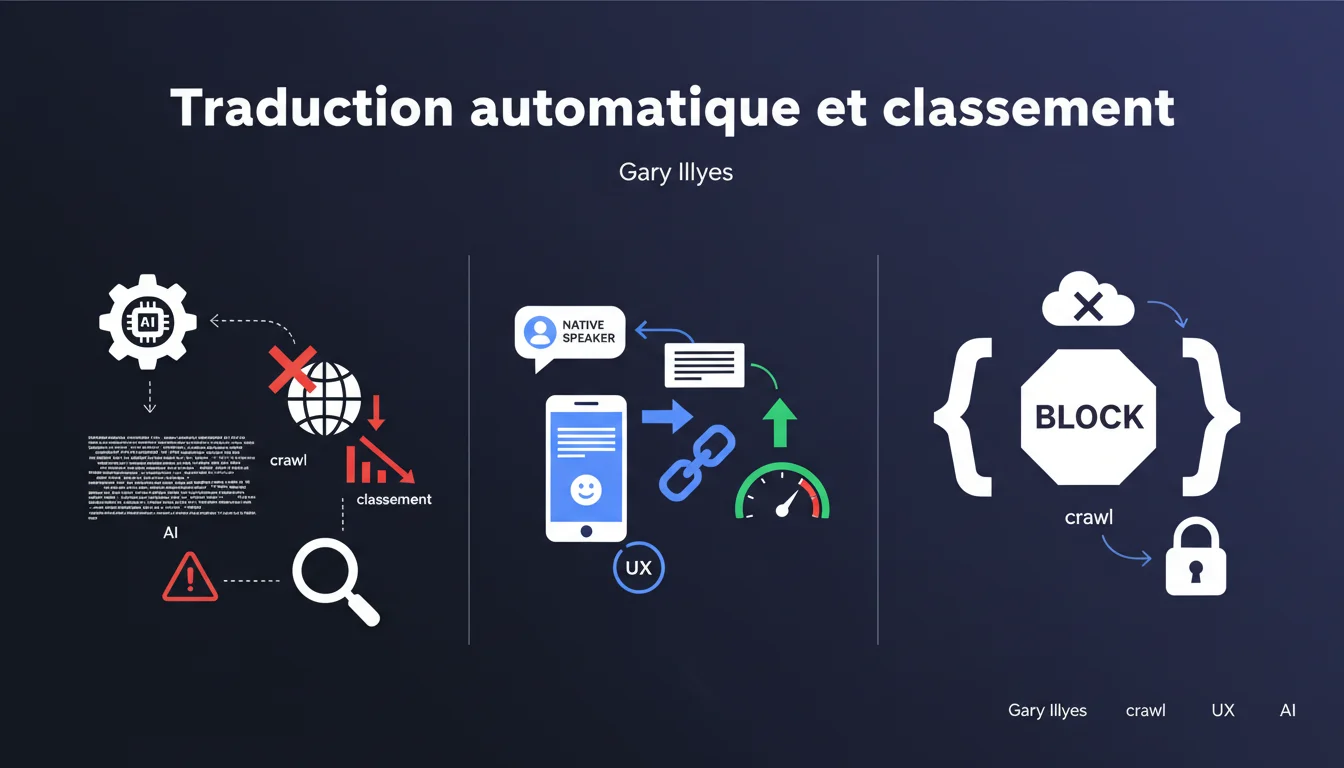

Google confirme qu'une traduction automatique de mauvaise qualité impacte négativement le classement. La solution ? Faire relire systématiquement par un locuteur natif ou bloquer le crawl des versions traduites automatiquement. Pas de nuance : soit vous assurez la qualité, soit vous cachez le contenu à Google.

Ce qu'il faut comprendre

Pourquoi Google sanctionne-t-il spécifiquement les traductions automatiques ?

La réponse tient en un mot : utilité. Une traduction approximative crée une expérience utilisateur médiocre — phrases bancales, contresens, formulations maladroites. Google détecte ces signaux via des métriques comportementales et son analyse sémantique.

Ce qui coince, c'est que le moteur ne fait plus la différence entre un contenu mal écrit et une traduction bâclée. Les deux produisent les mêmes symptômes : taux de rebond élevé, temps de visite faible, absence d'engagement. Pour l'algorithme, c'est du contenu de faible qualité, point final.

Qu'entend Google par « traduction de mauvaise qualité » exactement ?

La déclaration reste volontairement floue. On parle ici de traductions qui sonnent robotiques, avec des erreurs grammaticales récurrentes, des expressions idiomatiques mal rendues ou du vocabulaire inadapté au contexte culturel.

Concrètement ? Un texte qui fait tiquer un lecteur natif dès les premières lignes. Pas besoin d'être linguiste — si ça se lit comme du Google Translate brut, c'est raté. Le seuil de tolérance n'est jamais explicité par Google, mais l'observation terrain montre que les sites multilingues avec traductions non relues perdent systématiquement en visibilité sur leurs versions internationales.

Le blocage du crawl est-il vraiment la seule alternative à la relecture ?

Gary Illyes présente deux options : soit vous garantissez la qualité via relecture native, soit vous bloquez purement et simplement l'accès de Googlebot. C'est un choix binaire assez radical.

Dans les faits, cette seconde option revient à abandonner le référencement international des pages concernées. Utile uniquement si ces versions traduites servent un objectif non-SEO (support client interne, documentation technique limitée). Pour 99% des sites e-commerce ou éditoriaux, ce n'est pas une option — c'est un aveu d'échec.

- Traduction automatique non relue = risque de pénalité algorithmique

- Relecture par locuteur natif = seule garantie reconnue par Google

- Blocage crawl = renoncement au SEO international sur ces pages

- Aucune tolérance ou seuil de qualité minimum communiqué officiellement

- Les signaux comportementaux jouent probablement un rôle dans la détection

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment ce qu'on observe sur le terrain ?

Oui, mais avec des nuances. Les sites qui déploient du contenu traduit automatiquement sans relecture constatent effectivement une sous-performance chronique sur leurs versions internationales. Positions plus basses, CTR médiocres, trafic organique anémique.

Ce qui est moins clair, c'est le mécanisme exact. Google prétend évaluer la qualité linguistique, mais dans la pratique, ce sont surtout les métriques d'engagement qui trahissent un contenu mal traduit. Un visiteur espagnol qui quitte immédiatement une page parce que le texte est incompréhensible envoie un signal sans ambiguïté. [A vérifier] : Google dispose-t-il vraiment d'un système d'analyse linguistique suffisamment fin pour détecter une mauvaise traduction indépendamment des signaux comportementaux ? Rien dans cette déclaration ne le prouve.

Tous les secteurs sont-ils logés à la même enseigne ?

Non, et c'est un angle mort de cette déclaration. Un site e-commerce avec des fiches produits formulaires et répétitives encaisse mieux une traduction approximative qu'un blog éditorial ou un site B2B où la qualité rédactionnelle conditionne la crédibilité.

De même, certaines paires de langues sont plus risquées. Traduire de l'anglais vers le français ou l'allemand avec DeepL ou Google Translate donne des résultats exploitables moyennant relecture légère. Passer du japonais au portugais ? C'est la loterie. Gary Illyes ignore ces subtilités — il parle comme si toutes les traductions automatiques se valaient.

Le conseil de bloquer le crawl est-il pertinent ?

Franchement ? C'est un non-sens stratégique pour 95% des cas d'usage. Si vous avez investi dans une version multilingue de votre site, c'est précisément pour capter du trafic international. Bloquer Googlebot revient à saborder cet objectif.

La seule situation où ça se justifie : vous avez publié par erreur du contenu traduit automatiquement, sans ressources pour le corriger à court terme, et vous préférez éviter une pénalité temporaire. C'est du damage control, pas une stratégie. Le vrai conseil aurait été : ne publiez jamais de traduction automatique non relue en production.

Impact pratique et recommandations

Comment auditer la qualité des traductions existantes sur votre site ?

Première étape : identifier les pages traduites automatiquement. Si vous utilisez un plugin ou un système de traduction automatique, listez toutes les URLs concernées. Croisez avec les données Search Console pour repérer les versions linguistiques qui sous-performent anormalement (impressions faibles, CTR bas, positions médiocres).

Ensuite, testez manuellement avec des locuteurs natifs. Pas besoin d'auditer 10 000 pages — prenez un échantillon représentatif (homepage, pages catégories principales, 5-10 articles ou fiches produits). Si ces pages-clés sonnent faux, le reste du site est probablement compromis. Demandez aux testeurs de noter sur 5 la fluidité, la clarté et la crédibilité du contenu.

Quelles erreurs éviter absolument dans un workflow de traduction ?

Erreur n°1 : publier directement la sortie brute d'un outil de traduction automatique. Même DeepL, pourtant excellent, produit des phrases qui nécessitent ajustements. Les expressions idiomatiques, les jeux de mots, les références culturelles — tout ça passe à la trappe avec une machine.

Erreur n°2 : confier la relecture à un non-natif « qui se débrouille bien » dans la langue cible. Un français qui parle couramment espagnol ne détectera pas les nuances subtiles qu'un Madrilène ou un Mexicain repère instantanément. Google non plus d'ailleurs, mais vos visiteurs, eux, le remarqueront — et leur comportement trahira la supercherie.

Erreur n°3 : négliger le contexte culturel. Une traduction techniquement correcte peut être culturellement inadaptée. Un call-to-action trop direct fonctionne en anglais US, beaucoup moins en japonais. Ces décalages tuent la conversion et dégradent les métriques d'engagement.

Que faire si vous avez déjà publié du contenu traduit automatiquement ?

Trois options, par ordre de priorité. Option 1 : relecture et correction immédiate par locuteurs natifs, au moins sur les pages à fort trafic potentiel. Priorisez les landing pages, les catégories principales, les articles qui rankent déjà un peu. Laissez tomber les pages zombie sans potentiel.

Option 2 : si le budget manque, dépubliez temporairement les versions linguistiques problématiques (via noindex ou blocage crawl) le temps de les corriger. Mieux vaut avoir 3 langues propres que 10 langues médiocres. Communiquez clairement aux utilisateurs que ces versions sont en maintenance.

Option 3 : si vraiment aucune ressource n'est disponible, supprimez définitivement les versions traduites automatiquement et redirigez vers la version originale. Vous perdez le potentiel SEO international, mais vous évitez la pénalité. C'est un renoncement, pas une stratégie — mais parfois, c'est le moins pire.

- Auditer toutes les pages traduites automatiquement, identifier celles qui sous-performent dans Search Console

- Tester manuellement un échantillon représentatif avec des locuteurs natifs (fluidité, clarté, crédibilité)

- Prioriser la relecture des pages à fort potentiel SEO (homepage, catégories, top articles)

- Ne jamais publier une traduction automatique sans relecture, même « rapide »

- Vérifier que les traducteurs sont locuteurs natifs et comprennent le contexte culturel

- Dépublier temporairement (noindex) les versions linguistiques de mauvaise qualité si budget insuffisant

- Monitorer les métriques d'engagement par langue (taux rebond, temps visite, conversions)

- Documenter le workflow de traduction pour garantir la qualité sur les futurs contenus

La traduction automatique non relue est un boulet SEO pour vos versions internationales. Google ne pardonne pas les contenus médiocres, quelle qu'en soit la raison. La relecture par locuteur natif n'est pas négociable si vous visez un référencement sérieux à l'international.

Le conseil de bloquer le crawl est un aveu d'échec — ne l'envisagez qu'en dernier recours. L'investissement dans des traductions de qualité est rentable : meilleures positions, meilleur taux de conversion, meilleure perception de marque. Ces optimisations multilingues peuvent être complexes à orchestrer seul, surtout si vous gérez plusieurs langues simultanément. Faire appel à une agence SEO spécialisée dans l'international permet d'obtenir un accompagnement personnalisé sur le workflow de traduction, la priorisation des langues et l'audit qualité — un investissement qui sécurise votre expansion internationale.

❓ Questions frequentes

Est-ce que Google pénalise automatiquement toute page traduite par machine ?

Peut-on utiliser DeepL ou Google Translate comme base de travail ?

Si je bloque le crawl de mes pages traduites, est-ce que je perds tout référencement international ?

Comment vérifier si mes traductions actuelles posent problème ?

Une mauvaise traduction sur une langue peut-elle affecter le classement des autres versions ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.