Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Faut-il vraiment bloquer les traductions automatiques par IA de votre site en noindex ?

- □ Les recherches site: polluent-elles vos données Search Console ?

- □ Pourquoi Google vous demande d'ignorer les scores de PageSpeed Insights ?

- □ Faut-il vraiment arrêter d'optimiser les Core Web Vitals à tout prix ?

- □ Faut-il se méfier d'un domaine expiré racheté ?

- □ L'IA peut-elle vraiment produire du contenu SEO de qualité avec une simple relecture humaine ?

- □ La traduction automatique peut-elle vraiment pénaliser votre classement SEO ?

- □ Les liens d'affiliation pénalisent-ils vraiment le référencement de vos pages ?

- □ Faut-il vraiment réparer tous les backlinks cassés pointant vers votre site ?

- □ NextJS impose-t-il vraiment des bonnes pratiques SEO spécifiques ?

- □ Peut-on canonicaliser des pages à 93% identiques sans risque pour son SEO ?

- □ Faut-il rediriger ou désactiver un sous-domaine SEO non utilisé ?

- □ Faut-il encore s'inquiéter des liens toxiques pointant vers votre site ?

- □ Faut-il vraiment faire correspondre le titre et le H1 d'une page ?

- □ Le contenu localisé échappe-t-il vraiment à la pénalité pour duplicate content ?

- □ Pourquoi un bon classement ne garantit-il pas un CTR élevé sur Google ?

- □ Les erreurs JavaScript dans la console impactent-elles vraiment le référencement de votre site ?

- □ Pourquoi afficher toutes les variantes produits à Googlebot peut-il détruire votre indexation ?

- □ Faut-il vraiment une page dédiée par vidéo pour ranker dans les résultats enrichis ?

- □ La syndication de contenu est-elle un pari risqué pour votre visibilité organique ?

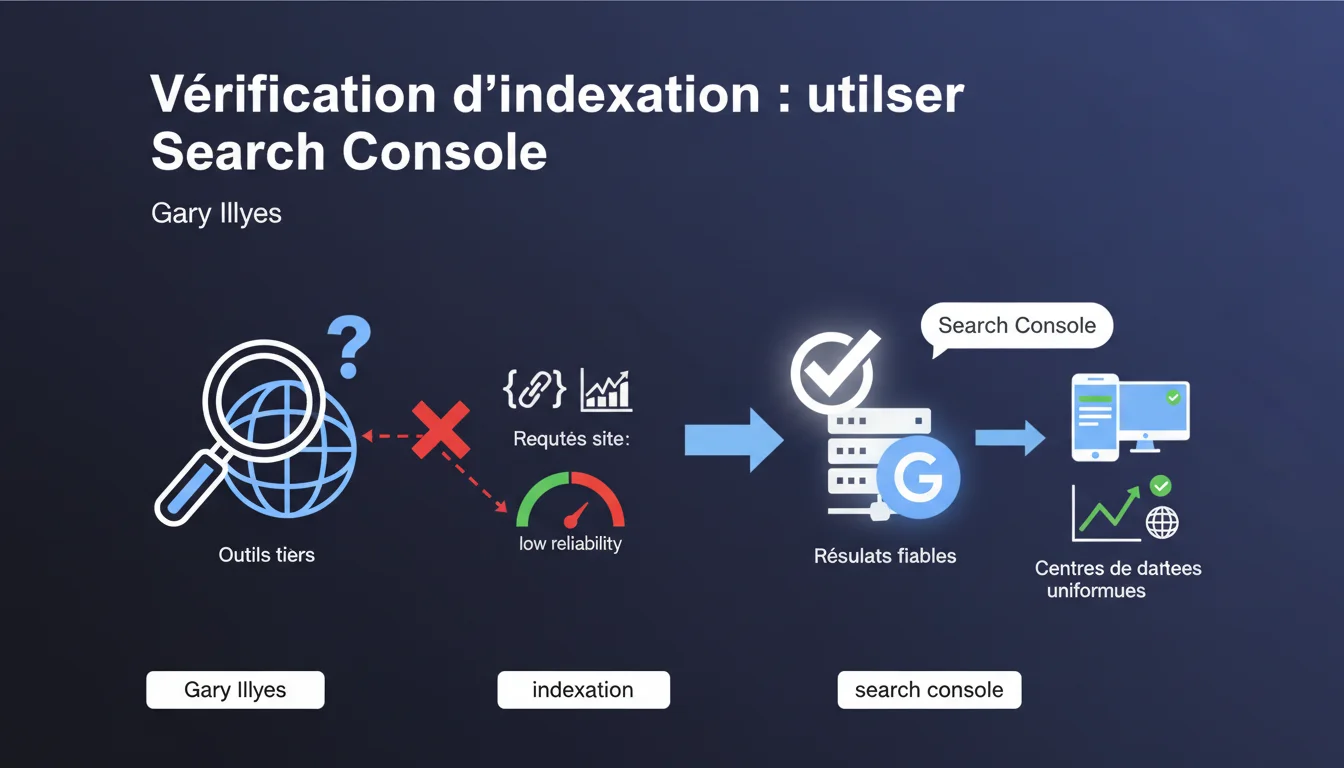

Gary Illyes recommande d'utiliser exclusivement Search Console pour vérifier l'indexation d'un site. Les requêtes site: et les outils tiers sont peu fiables car ils retournent des résultats variables selon le centre de données interrogé. Search Console reste la seule source de vérité pour diagnostiquer les problèmes d'indexation.

Ce qu'il faut comprendre

Les requêtes site: sont-elles vraiment si peu fiables ?

Oui, et c'est un problème structurel du fonctionnement de Google. Quand vous lancez une requête site:votredomaine.com, vous interrogez un centre de données spécifique qui peut avoir une version différente de l'index selon sa localisation géographique et sa synchronisation.

Concrètement ? Vous pouvez voir 150 pages indexées le matin, 180 l'après-midi, puis 165 le lendemain — sans qu'aucune modification n'ait été faite sur votre site. Cette variabilité rend impossible tout diagnostic sérieux basé sur ces chiffres.

Pourquoi Search Console est-elle plus fiable ?

Search Console agrège des données provenant de l'ensemble de l'infrastructure Google, pas d'un seul centre de données. Elle consolide les informations sur plusieurs jours et vous donne une vision stabilisée de ce qui est réellement crawlé, indexé et classé.

L'outil de vérification d'URL en temps réel teste l'indexabilité d'une page spécifique et vous indique précisément pourquoi elle n'est pas indexée si c'est le cas. Aucune requête site: ne peut faire ça.

Qu'en est-il des outils tiers ?

Les outils comme Ahrefs, SEMrush ou Screaming Frog ne peuvent pas accéder directement à l'index Google. Ils s'appuient soit sur leurs propres crawls (qui ne reflètent pas la réalité de Googlebot), soit sur des approximations basées sur des requêtes API limitées.

Ces outils restent utiles pour identifier des problèmes techniques (redirections, erreurs 404, balises canoniques), mais ne peuvent pas confirmer qu'une page est effectivement indexée par Google.

- Les requêtes site: interrogent un seul centre de données et donnent des résultats variables

- Search Console consolide les données de toute l'infrastructure Google

- L'outil de vérification d'URL teste l'indexabilité en temps réel

- Les outils tiers ne peuvent pas accéder directement à l'index Google

- Seule Search Console fournit une vision fiable de l'état d'indexation

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les observations terrain ?

Totalement. Depuis des années, les professionnels SEO constatent cette instabilité des requêtes site:. On a tous vécu ce moment où un client panique parce que "le nombre de pages indexées a chuté de 30%" alors qu'aucune modification n'a été faite.

Le problème, c'est que beaucoup continuent d'utiliser ces requêtes par habitude ou parce qu'elles sont rapides. Mais rapide ne veut pas dire fiable — et en SEO, un diagnostic basé sur de mauvaises données mène à de mauvaises décisions.

Quelles limites Search Console présente-t-elle malgré tout ?

Soyons honnêtes : Search Console n'est pas parfaite non plus. Les données sont agrégées sur 1-2 jours, ce qui signifie que vous ne verrez pas une indexation en temps réel. Si vous publiez une page urgente et voulez vérifier qu'elle est indexée immédiatement, GSC ne vous donnera pas de réponse instantanée.

Par ailleurs, l'outil de vérification d'URL teste l'indexabilité mais ne garantit pas l'indexation effective. Une page peut être techniquement indexable sans jamais entrer dans l'index si Google estime qu'elle n'apporte pas de valeur. [À vérifier] : Google ne donne jamais de seuil clair sur ce qui déclenche ou non l'indexation d'une page jugée "de faible qualité".

Dans quels cas peut-on encore utiliser les requêtes site: ?

Pour un contrôle rapide et approximatif, ça reste acceptable. Par exemple, vérifier qu'un nouveau site commence à être crawlé, ou repérer grossièrement des pages surprises indexées (versions de test, paramètres URL, contenus dupliqués).

Mais jamais pour mesurer l'évolution de l'indexation dans le temps, ni pour diagnostiquer un problème précis. Dans ces cas-là, Search Console est obligatoire.

Impact pratique et recommandations

Que faut-il faire concrètement pour vérifier l'indexation ?

Première règle : installez et configurez correctement Search Console pour tous vos sites et toutes vos versions (www, non-www, HTTPS). Ajoutez tous les sous-domaines pertinents si votre architecture le nécessite.

Ensuite, consultez régulièrement le rapport de couverture d'index. C'est là que Google vous dit combien de pages sont indexées, combien sont exclues, et surtout pourquoi elles sont exclues (crawlées mais non indexées, détectées mais non crawlées, erreurs 404, bloquées par robots.txt, etc.).

Pour une page spécifique, utilisez l'outil de vérification d'URL : collez l'URL, cliquez sur "Tester l'URL en direct", et Google vous dira si elle est indexable. Si elle ne l'est pas, le rapport détaillé vous expliquera pourquoi (balise noindex, canonical vers une autre page, redirection, etc.).

Quelles erreurs éviter absolument ?

Ne basez jamais une décision stratégique sur une requête site:. Si votre client ou votre boss vous dit "on a perdu 50% de nos pages indexées d'après site:", vérifiez d'abord dans Search Console avant de paniquer.

Autre erreur fréquente : ignorer les sections "Exclues" du rapport de couverture. Une page peut être techniquement accessible mais exclue pour cause de contenu dupliqué, faible qualité perçue ou canonicalisation. C'est souvent là que se cachent les vrais problèmes.

Comment automatiser le suivi de l'indexation ?

Connectez Search Console à Google Data Studio (ou Looker Studio) pour créer des dashboards personnalisés. Vous pouvez suivre l'évolution du nombre de pages indexées/exclues dans le temps, croiser avec les données Analytics, et détecter rapidement les anomalies.

Configurez également des alertes par email dans Search Console pour être prévenu en cas de pic d'erreurs 404, de problèmes de couverture ou de chute brutale du nombre de pages indexées.

- Installer Search Console sur toutes les versions du site (www, non-www, HTTPS, sous-domaines)

- Consulter le rapport de couverture d'index au moins une fois par semaine

- Utiliser l'outil de vérification d'URL pour diagnostiquer les pages non indexées

- Analyser les sections "Exclues" pour identifier les problèmes de qualité ou de duplication

- Connecter Search Console à un outil de reporting pour automatiser le suivi

- Configurer des alertes email pour détecter les anomalies rapidement

- Ne jamais se fier uniquement aux requêtes site: pour mesurer l'indexation

❓ Questions frequentes

Peut-on faire confiance aux chiffres d'indexation affichés par les outils SEO tiers ?

Combien de temps faut-il attendre pour voir une nouvelle page indexée dans Search Console ?

Si une page est marquée 'indexable' dans l'outil de vérification d'URL, est-elle forcément indexée ?

Les variations du nombre de pages indexées dans Search Console sont-elles normales ?

Faut-il complètement abandonner les requêtes site: ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.