Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Faut-il vraiment bloquer les traductions automatiques par IA de votre site en noindex ?

- □ Les recherches site: polluent-elles vos données Search Console ?

- □ Faut-il vraiment arrêter d'optimiser les Core Web Vitals à tout prix ?

- □ Faut-il se méfier d'un domaine expiré racheté ?

- □ L'IA peut-elle vraiment produire du contenu SEO de qualité avec une simple relecture humaine ?

- □ La traduction automatique peut-elle vraiment pénaliser votre classement SEO ?

- □ Les liens d'affiliation pénalisent-ils vraiment le référencement de vos pages ?

- □ Faut-il vraiment réparer tous les backlinks cassés pointant vers votre site ?

- □ NextJS impose-t-il vraiment des bonnes pratiques SEO spécifiques ?

- □ Peut-on canonicaliser des pages à 93% identiques sans risque pour son SEO ?

- □ Faut-il rediriger ou désactiver un sous-domaine SEO non utilisé ?

- □ Faut-il encore s'inquiéter des liens toxiques pointant vers votre site ?

- □ Faut-il vraiment faire correspondre le titre et le H1 d'une page ?

- □ Le contenu localisé échappe-t-il vraiment à la pénalité pour duplicate content ?

- □ Pourquoi Google déconseille-t-il d'utiliser les requêtes site: pour vérifier l'indexation ?

- □ Pourquoi un bon classement ne garantit-il pas un CTR élevé sur Google ?

- □ Les erreurs JavaScript dans la console impactent-elles vraiment le référencement de votre site ?

- □ Pourquoi afficher toutes les variantes produits à Googlebot peut-il détruire votre indexation ?

- □ Faut-il vraiment une page dédiée par vidéo pour ranker dans les résultats enrichis ?

- □ La syndication de contenu est-elle un pari risqué pour votre visibilité organique ?

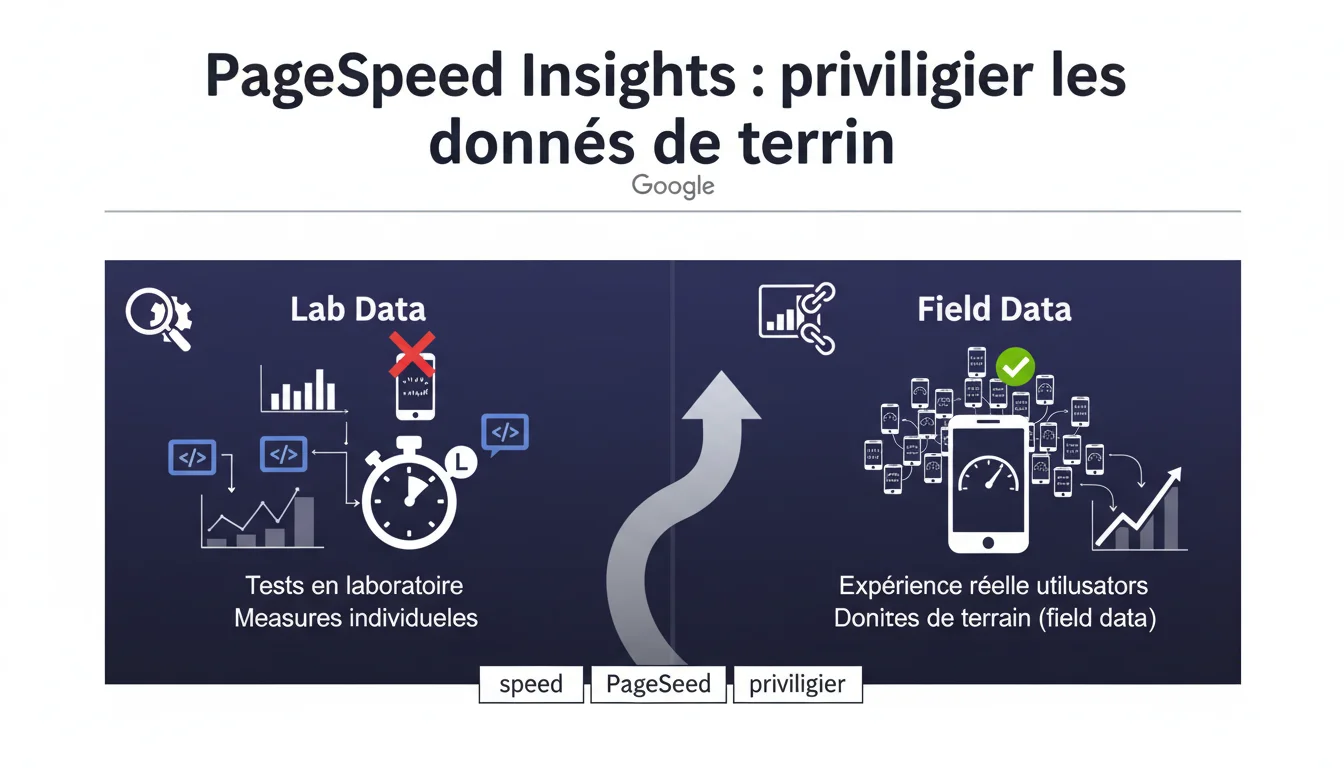

Google recommande de privilégier les données de terrain (field data) issues de vrais utilisateurs plutôt que les tests en laboratoire de PageSpeed Insights, qui fluctuent. Les mesures synthétiques sont utiles pour diagnostiquer, mais seules les métriques réelles reflètent l'expérience utilisateur et impactent le classement.

Ce qu'il faut comprendre

Quelle est la différence entre données de terrain et tests en laboratoire ?

Les données de terrain (field data) proviennent du Chrome User Experience Report (CrUX), qui collecte les performances réelles des pages visitées par de vrais utilisateurs. Ces métriques varient selon les appareils, connexions et contextes d'utilisation.

Les tests en laboratoire (lab data) de PageSpeed Insights simulent un chargement dans un environnement contrôlé et standardisé. Lighthouse génère ces scores avec des paramètres fixes — même appareil virtuel, même connexion, même cache vide. Résultat : ces tests peuvent varier d'une exécution à l'autre sans que votre site ait changé.

Pourquoi Google insiste sur cette distinction maintenant ?

Parce que trop de praticiens SEO obsèdent sur le score Lighthouse affiché en haut de PageSpeed Insights. Ce chiffre de 0 à 100 devient une fixation, alors qu'il ne reflète qu'une simulation ponctuelle.

Google utilise exclusivement les Core Web Vitals mesurés en conditions réelles (LCP, FID/INP, CLS) pour le classement. Un site avec un score labo médiocre mais d'excellentes métriques terrain ne sera pas pénalisé. L'inverse est vrai : un 95/100 en labo n'empêche pas un déclassement si les utilisateurs réels subissent une expérience dégradée.

Comment accéder aux données de terrain pour mon site ?

Trois sources principales : le rapport CrUX dans PageSpeed Insights (section du haut, avant les recommandations Lighthouse), la Search Console (onglet Expérience) et le CrUX Dashboard sur Google Data Studio. Ces outils affichent les percentiles 75 des métriques — le seuil utilisé par Google pour évaluer votre site.

Si votre site manque de trafic, CrUX peut ne pas avoir assez de données. Dans ce cas, les tests labo restent votre seul indicateur — mais ils ne garantissent rien sur le classement.

- Les données de terrain (CrUX) reflètent l'expérience réelle et impactent le classement

- Les tests en laboratoire (Lighthouse) sont des simulations utiles pour diagnostiquer, mais fluctuent naturellement

- Google utilise le percentile 75 des métriques réelles pour déterminer si un site passe les seuils des Core Web Vitals

- Un bon score Lighthouse n'est pas une garantie de bon classement si les données terrain sont médiocres

- Pour les sites à faible trafic, CrUX peut ne pas disposer de données — il faut alors se fier aux tests labo en attendant

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. On observe régulièrement des sites avec des scores Lighthouse catastrophiques (30-40/100) qui performent parfaitement dans les SERPs, parce que leurs métriques CrUX sont excellentes. À l'inverse, des sites optimisés à fond pour Lighthouse se plaignent de ne pas voir d'amélioration de visibilité — parce qu'en conditions réelles, avec du contenu dynamique, des A/B tests ou des scripts tiers, l'expérience se dégrade.

Le problème : trop d'audits SEO se contentent de capturer un score PageSpeed et de proposer des recommandations techniques basées sur Lighthouse. C'est insuffisant. Un audit sérieux doit croiser les deux sources — et surtout surveiller l'évolution des données terrain sur plusieurs semaines.

Quelles nuances faut-il apporter à cette recommandation ?

Si votre site n'a pas assez de trafic pour figurer dans CrUX, les tests labo deviennent votre seul signal. Dans ce cas, optimisez pour Lighthouse — non pas pour le score global, mais pour les métriques individuelles (LCP, CLS, TBT) qui préfigurent les Core Web Vitals réels.

Attention aussi aux variations géographiques. CrUX agrège les données par origine (domaine + protocole), mais un site performant en Europe peut être catastrophique en Asie si le CDN est mal configuré. PageSpeed Insights propose maintenant des filtres par région — utilisez-les si vous ciblez plusieurs zones.

Enfin, soyons honnêtes : un score Lighthouse reste un outil de communication efficace auprès des clients ou de la direction. Mais il faut expliquer clairement que ce chiffre n'est qu'un diagnostic, pas un objectif business. [À vérifier] : Google n'a jamais publié de corrélation chiffrée entre amélioration des Core Web Vitals et gains de trafic — les études de cas existent, mais les résultats varient énormément selon les secteurs.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Pour les sites en préproduction ou les pages non indexées, les données terrain n'existent pas. Là, les tests labo sont indispensables pour détecter les régressions avant mise en production.

De même, si vous déployez une refonte majeure, il faudra attendre 28 jours (durée de collecte CrUX) avant de mesurer l'impact réel. Entre-temps, Lighthouse vous permet de valider que les fondations techniques sont solides.

Impact pratique et recommandations

Que faut-il faire concrètement pour privilégier les données de terrain ?

Premier réflexe : installez la Search Console et vérifiez l'onglet Expérience > Core Web Vitals. Google y affiche les URLs qui échouent, nécessitent une amélioration ou passent les seuils. C'est votre source de vérité — pas PageSpeed Insights.

Ensuite, configurez un monitoring RUM (Real User Monitoring) via des outils comme SpeedCurve, Treo, ou directement avec l'API web-vitals de Google. Ces solutions collectent les métriques de vos vrais visiteurs en continu, sans dépendre de CrUX qui agrège sur 28 jours glissants.

Enfin, segmentez vos analyses. Un CrUX global médiocre peut masquer des disparités énormes entre pages : votre homepage peut être irréprochable tandis que vos fiches produits plombent la moyenne. Identifiez les URLs critiques et priorisez-les.

Quelles erreurs éviter lors de l'analyse des performances ?

Ne comparez jamais un test labo effectué sur un MacBook Pro en fibre optique avec les données terrain d'utilisateurs sur mobile 3G. Les conditions d'exécution n'ont rien à voir. Lighthouse simule un Moto G4 avec connexion 4G bridée — c'est déjà plus réaliste, mais ça reste une moyenne.

Évitez aussi de vous focaliser sur le score composite de Lighthouse (le fameux chiffre vert). Ce score pondère différentes métriques avec des poids arbitraires qui ne reflètent pas forcément vos priorités business. Concentrez-vous sur LCP, CLS et INP — les trois métriques que Google utilise réellement pour le classement.

Dernier piège : ignorer les variations saisonnières. Un site e-commerce peut voir ses métriques se dégrader pendant les soldes à cause du trafic accru, des bannières promotionnelles supplémentaires, des A/B tests intensifs. Ces dégradations temporaires ne justifient pas une refonte technique panique.

Comment vérifier que mon site est conforme aux attentes de Google ?

Consultez régulièrement le rapport Core Web Vitals de la Search Console. Si toutes vos URLs passent au vert (Good), vous êtes dans les clous. Si certaines pages échouent, Google vous indique les URLs concernées et les métriques problématiques.

Comparez ensuite avec les données PageSpeed Insights pour ces mêmes URLs. Si CrUX indique un problème mais que Lighthouse est parfait, cherchez du côté des ressources tierces (analytics, ads, chat), du cache CDN, ou des variations géographiques.

Mettez en place des alertes automatiques dès qu'une métrique CrUX dépasse un seuil critique. Des outils comme Treo ou SpeedCurve permettent de recevoir une notification si le LCP médian franchit 2,5 secondes. Réagir vite évite qu'une régression se généralise.

- Installer et surveiller le rapport Core Web Vitals de la Search Console

- Configurer un monitoring RUM pour suivre les métriques réelles en temps réel

- Segmenter les analyses par type de page (homepage, catégorie, fiche produit, article)

- Lancer au minimum 3 tests Lighthouse consécutifs et prendre la médiane des résultats

- Comparer les données CrUX et les tests labo pour identifier les écarts et leurs causes

- Mettre en place des alertes automatiques sur les seuils critiques (LCP > 2,5s, CLS > 0,1, INP > 200ms)

- Éviter de se focaliser sur le score composite Lighthouse — privilégier les métriques individuelles

- Auditer régulièrement les ressources tierces (scripts analytics, publicités, widgets) qui dégradent l'expérience réelle

❓ Questions frequentes

Les données CrUX sont-elles disponibles pour tous les sites ?

Faut-il ignorer complètement les recommandations de Lighthouse ?

Quelle est la différence entre FID et INP dans les Core Web Vitals ?

Un mauvais score Lighthouse peut-il pénaliser mon référencement ?

Combien de temps faut-il pour que mes optimisations apparaissent dans CrUX ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/06/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.