Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Les Core Web Vitals sont-ils vraiment un outil de diagnostic UX ou juste un critère de ranking ?

- □ Pourquoi Google insiste-t-il sur les données utilisateurs réels pour mesurer la performance SEO ?

- □ Pourquoi Google privilégie-t-il les données lab pour le débogage SEO ?

- □ Lighthouse est-il vraiment l'outil de référence pour diagnostiquer les problèmes de performance ?

- □ Pourquoi Lighthouse ne peut-il pas mesurer la vraie réactivité de votre site ?

- □ Pourquoi Lighthouse ne détecte-t-il pas tous vos problèmes de Core Web Vitals ?

- □ Pourquoi le performance panel Chrome DevTools change-t-il la donne pour le debug des Core Web Vitals ?

- □ Faut-il vraiment tester les Core Web Vitals en laboratoire plutôt qu'en production ?

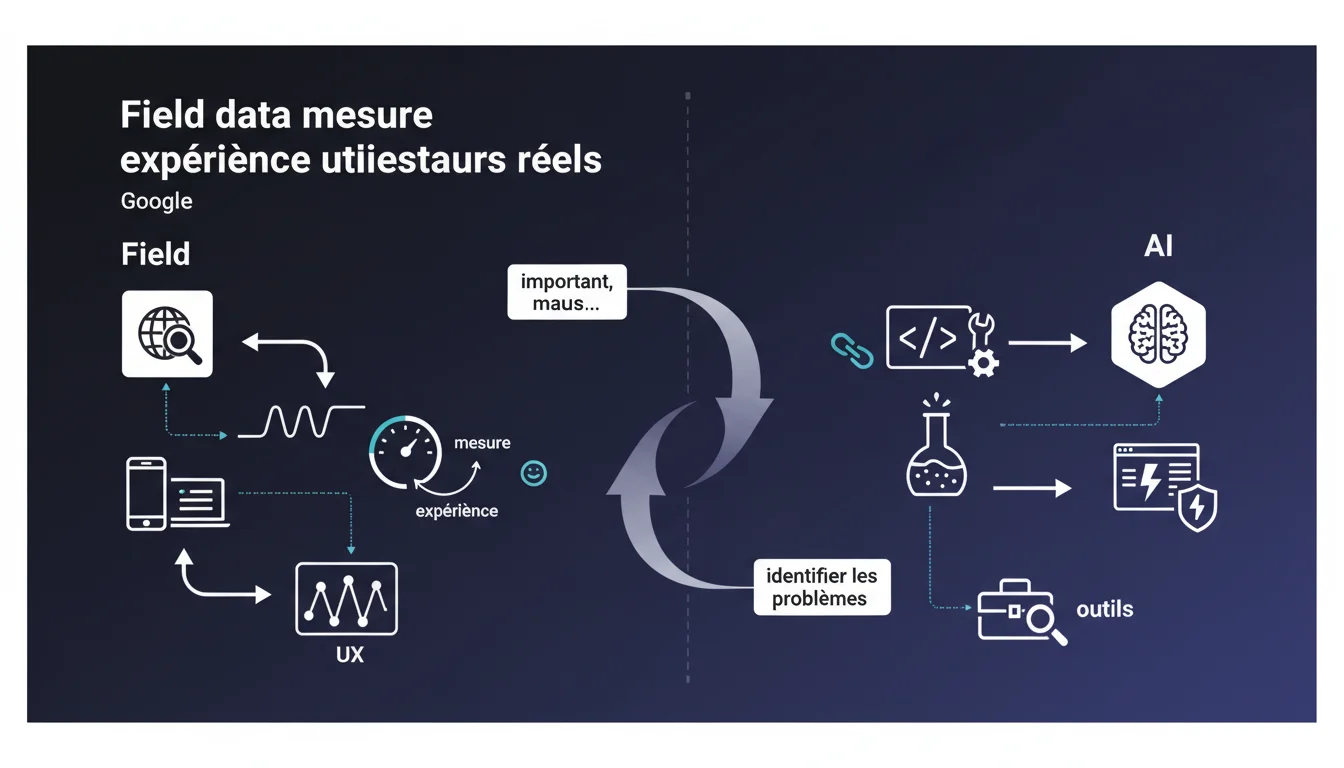

Google confirme que les données terrain (RUM) restent la référence pour mesurer l'expérience utilisateur réelle, mais que les outils de laboratoire suffisent largement pour identifier les problèmes de performance. Autrement dit : diagnostiquer en labo, valider en conditions réelles.

Ce qu'il faut comprendre

Quelle est la différence entre données terrain et données de laboratoire ?

Les données terrain (field data) proviennent d'utilisateurs réels naviguant sur votre site avec leurs appareils, connexions et navigateurs variés. Elles reflètent l'expérience vécue — avec ses aléas, ses pics de trafic, ses configurations exotiques.

Les données de laboratoire (lab data) sont générées dans un environnement contrôlé : même machine, même réseau, mêmes conditions. Lighthouse, PageSpeed Insights en mode labo, WebPageTest — tous produisent des métriques reproductibles mais artificielles.

Pourquoi Google insiste-t-il sur l'importance des données terrain ?

Parce que ce qui compte pour le classement (et pour vos conversions), c'est l'expérience réelle des visiteurs. Les Core Web Vitals utilisés par Google proviennent du Chrome User Experience Report (CrUX), donc de données terrain agrégées sur 28 jours.

Un site peut afficher d'excellents scores Lighthouse en labo et planter lamentablement sur mobile 3G au fin fond de la Creuse. C'est cette réalité-là que Google mesure.

Alors à quoi servent les données de labo si le terrain fait foi ?

À diagnostiquer rapidement et itérer sans attendre que CrUX accumule assez de données. Vous testez une modification ? Lighthouse vous donne un retour immédiat. Vous identifiez un goulot d'étranglement ? Les outils labo le mettent en évidence avec précision.

Le terrain valide, le labo oriente. L'un n'annule pas l'autre — ils se complètent.

- Les données terrain reflètent l'expérience réelle des utilisateurs et alimentent le classement via CrUX

- Les données de laboratoire permettent d'identifier les problèmes sans attendre 28 jours de collecte

- Diagnostiquer en labo, puis vérifier en conditions réelles : c'est le workflow efficace

- Ne jamais se fier uniquement aux scores Lighthouse pour juger de la performance perçue

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Totalement. Depuis des années, on jongle entre Lighthouse (pratique pour débugger) et CrUX (seul qui compte vraiment). Google ne fait que formaliser ce qu'on sait déjà : le labo sert à identifier, le terrain à valider.

Sauf que cette formulation peut prêter à confusion. Dire qu'on dispose de « nombreux outils pour identifier les problèmes en utilisant uniquement des données de laboratoire » pourrait laisser croire qu'on peut s'en contenter. Faux. Si votre site n'a pas assez de trafic pour apparaître dans CrUX, vous naviguez à l'aveugle côté classement.

Quelles nuances faut-il apporter à cette affirmation ?

D'abord, tous les sites ne génèrent pas assez de visites Chrome pour figurer dans CrUX. Pour eux, pas de données terrain publiques — Google utilise alors probablement d'autres signaux ou n'applique pas les Core Web Vitals comme critère de classement. [A vérifier] car Google reste flou sur ce cas précis.

Ensuite, les outils labo ne reproduisent jamais parfaitement la diversité des configurations utilisateurs : anciens smartphones, réseaux saturés, extensions parasites. Un score Lighthouse à 95 ne garantit rien si 40% de vos visiteurs sont sur mobile bas de gamme avec une 4G capricieuse.

Dans quels cas les données labo deviennent-elles trompeuses ?

Quand votre stack technique diffère significativement entre environnement de test et production. CDN pas configuré pareil, cache côté serveur absent en dev, scripts tiers qui se chargent différemment selon le contexte — autant de biais qui rendent le labo mensonger.

Autre cas classique : les sites avec beaucoup de contenu dynamique ou personnalisé. Lighthouse teste une page anonyme, mais vos vrais utilisateurs voient du contenu ajusté, des recommendations, des popups conditionnels. L'écart peut être brutal.

Impact pratique et recommandations

Que faut-il faire concrètement pour équilibrer labo et terrain ?

Installez un monitoring RUM si votre trafic ne suffit pas pour CrUX ou si vous voulez des données plus granulaires. Des solutions comme SpeedCurve, Cloudflare Web Analytics (gratuit), ou même Google Analytics 4 (avec ses limites) vous donnent une vision temps réel de la performance perçue.

Continuez à utiliser Lighthouse en CI/CD pour détecter les régressions avant la mise en prod. Mais ne vous arrêtez jamais là : vérifiez systématiquement l'impact réel post-déploiement via CrUX ou votre outil RUM.

Quelles erreurs éviter absolument ?

Ne jamais se contenter d'un seul test Lighthouse pour valider une page. Les scores fluctuent — lancez plusieurs tests, idéalement sur différentes pages types (homepage, fiche produit, article) et avec throttling réseau activé.

Évitez aussi de comparer vos scores labo aux données terrain d'un concurrent. Vous n'avez aucune visibilité sur leurs conditions réelles : peut-être qu'ils ont 80% de trafic desktop sur fibre, là où vous avez 60% mobile sur 4G. Comparez-vous à vous-même, pas aux autres.

Comment s'assurer que mon site performe vraiment pour mes utilisateurs ?

Configurez des alertes sur les Core Web Vitals dans Search Console. Dès qu'un seuil devient orange ou rouge, réagissez. Croisez ces données avec votre taux de rebond et vos conversions par device/région — souvent, les corrélations sautent aux yeux.

Testez régulièrement depuis des devices et connexions variés. Un vieux Samsung Galaxy A sous Android 10 sur 4G saturée vous en apprendra plus qu'un MacBook Pro M3 sur fibre symétrique.

- Mettre en place un monitoring RUM pour capturer l'expérience réelle au-delà de CrUX

- Intégrer Lighthouse dans votre pipeline CI/CD pour détecter les régressions en amont

- Lancer plusieurs tests labo par page type, avec throttling réseau activé

- Consulter régulièrement CrUX via Search Console ou BigQuery pour valider l'impact réel

- Configurer des alertes sur les Core Web Vitals et corréler avec les métriques business

- Tester manuellement sur devices bas/moyen de gamme et connexions limitées

- Ne jamais se fier uniquement aux scores labo pour valider une refonte majeure

❓ Questions frequentes

Les Core Web Vitals utilisent-ils des données labo ou terrain ?

Mon site n'apparaît pas dans CrUX, suis-je pénalisé sur les Core Web Vitals ?

Faut-il atteindre 100/100 sur Lighthouse pour bien se classer ?

Quels outils RUM sont recommandés pour compléter CrUX ?

Dois-je optimiser pour mobile ou desktop en priorité ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/08/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.