Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Les Core Web Vitals sont-ils vraiment un outil de diagnostic UX ou juste un critère de ranking ?

- □ Pourquoi Google insiste-t-il sur les données utilisateurs réels pour mesurer la performance SEO ?

- □ Pourquoi Google privilégie-t-il les données lab pour le débogage SEO ?

- □ Lighthouse est-il vraiment l'outil de référence pour diagnostiquer les problèmes de performance ?

- □ Pourquoi Lighthouse ne peut-il pas mesurer la vraie réactivité de votre site ?

- □ Pourquoi Lighthouse ne détecte-t-il pas tous vos problèmes de Core Web Vitals ?

- □ Pourquoi le performance panel Chrome DevTools change-t-il la donne pour le debug des Core Web Vitals ?

- □ Les données de laboratoire peuvent-elles remplacer les données terrain pour optimiser l'UX ?

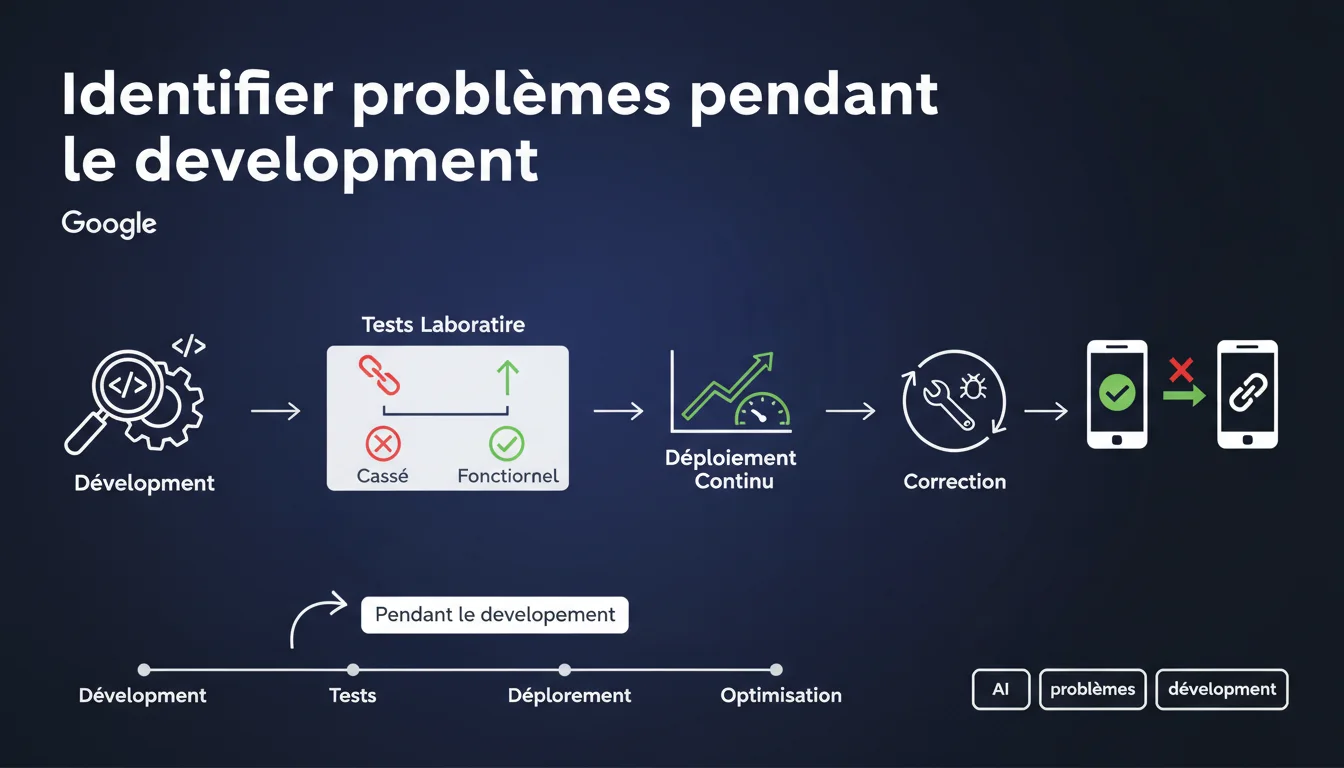

Google insiste sur l'importance des données de laboratoire pour identifier les problèmes de performance avant le déploiement. L'approche préventive permet de corriger les failles pendant le développement plutôt que de livrer un site cassé et chercher ensuite des solutions correctives. Pour les praticiens SEO, c'est un signal fort : la mesure synthétique reste un pilier incontournable de l'optimisation.

Ce qu'il faut comprendre

Pourquoi Google valorise-t-il autant les données de laboratoire ?

Les données de laboratoire (Lab Data) désignent les mesures réalisées dans un environnement contrôlé — PageSpeed Insights, Lighthouse, WebPageTest. Contrairement aux données terrain (Field Data) issues du CrUX Report, elles permettent de tester avant la mise en production.

Google reconnaît ici explicitement que cette approche préventive est non seulement valable, mais préférable. Déployer du code cassé puis corriger en urgence coûte cher — en temps, en ressources, et surtout en positions perdues dans les SERP si le problème persiste plusieurs jours.

Qu'est-ce que cela change concrètement pour un site en production ?

Concrètement ? Vous pouvez détecter une régression de performance avant qu'elle n'impacte vos utilisateurs réels. Un bout de JavaScript mal optimisé, un CSS bloquant ajouté par erreur — ces erreurs sont visibles en lab data avant que le CrUX ne les enregistre.

Le CrUX compile des données sur 28 jours. Si vous déployez un correctif le 15 du mois, vous attendrez début du mois suivant pour voir l'impact complet. Les données de laboratoire, elles, vous donnent un feedback immédiat.

Le lab data remplace-t-il le terrain pour les Core Web Vitals ?

Non. Google utilise les données terrain (CrUX) pour le classement. Mais le lab data reste votre outil de diagnostic et de prévention. C'est votre première ligne de défense avant qu'un problème ne devienne visible dans la Search Console.

- Lab data : environnement contrôlé, feedback immédiat, idéal pour le développement

- Field data : mesures réelles utilisateurs, données agrégées sur 28 jours, utilisées pour le ranking

- Les deux approches sont complémentaires, pas interchangeables

- Tester en continu pendant le développement évite les déploiements catastrophiques

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Les sites qui ont intégré des tests automatisés de performance dans leur pipeline CI/CD détectent les régressions avant qu'elles ne touchent la production. Soyons honnêtes : combien de fois avez-vous vu un client déployer une nouvelle feature un vendredi soir, pour découvrir lundi matin que le LCP a explosé ?

Le problème — et c'est là que ça coince — c'est que beaucoup d'équipes n'ont pas mis en place de monitoring continu. Elles testent manuellement avec Lighthouse une fois par mois, si elles y pensent. Google dit ici noir sur blanc que cette approche ne suffit pas.

Quelles nuances faut-il apporter à ce discours ?

Première nuance : les données de laboratoire ne capturent pas la diversité des conditions réelles. Lighthouse simule un Moto G4 sur du 4G bridé. Vos utilisateurs peuvent avoir un iPhone 15 sur fibre ou un vieux Samsung sur Edge. Le lab vous donne une baseline, pas la vérité absolue.

Deuxième nuance : Google reste vague sur ce qu'il faut corriger en priorité. [A vérifier] : un LCP à 2,6s en lab mais 2,4s dans le CrUX pose-t-il problème ? La déclaration ne donne aucun seuil précis pour déclencher l'alarme. Vous devez définir vos propres budgets de performance.

Dans quels cas cette approche montre-t-elle ses limites ?

Les tests en laboratoire ne voient pas les problèmes spécifiques à certains segments d'utilisateurs. Un bug qui touche uniquement Safari 15 sur iPad en mode portrait ? Le lab Lighthouse ne le détectera pas forcément. Les interactions complexes — scroll infini, modales imbriquées — sont difficiles à automatiser.

Et c'est là que l'expérience terrain devient indispensable. Le CrUX vous dira si vos utilisateurs réels souffrent, même si vos tests passent au vert. Les deux sources de données doivent se compléter — ne misez jamais tout sur une seule.

Impact pratique et recommandations

Que faut-il mettre en place concrètement dans son workflow ?

Intégrez des tests de performance automatisés dans votre pipeline de déploiement. Utilisez des outils comme Lighthouse CI, SpeedCurve ou Calibre pour bloquer un merge si les Core Web Vitals dépassent vos seuils. Fixez des budgets : LCP < 2,5s, FID < 100ms, CLS < 0,1.

Configurez des alertes qui se déclenchent si une Pull Request dégrade les métriques de plus de 10%. Vous détecterez le coupable avant qu'il n'atteigne la prod. C'est cette logique que Google valorise ici — le test continu, pas ponctuel.

Quelles erreurs éviter dans l'interprétation des données de laboratoire ?

Ne vous fixez pas sur le score global Lighthouse (0-100). Ce chiffre synthétique masque souvent des problèmes critiques. Concentrez-vous sur les métriques individuelles — LCP, CLS, TBT — et sur leur évolution dans le temps.

Évitez aussi de comparer vos scores lab avec ceux d'un concurrent sans connaître son environnement de test. Les conditions réseau, le device simulé, les extensions actives — tout ça influe sur les résultats. Mesurez-vous contre votre propre historique, pas contre des benchmarks hors contexte.

Comment vérifier que votre stratégie de monitoring est efficace ?

Posez-vous ces questions : combien de temps s'écoule entre un déploiement et la détection d'une régression ? Si la réponse dépasse 24h, votre monitoring est insuffisant. Avez-vous déjà bloqué un déploiement à cause de métriques dégradées ? Si non, vos seuils sont probablement trop laxistes.

Vérifiez aussi la corrélation entre lab et field. Si votre LCP en lab est à 1,8s mais que le CrUX affiche 3,2s, il y a un problème dans votre setup de test — vous ne simulez pas les bonnes conditions.

- Intégrer Lighthouse CI ou équivalent dans le pipeline de déploiement

- Définir des budgets de performance strictes (LCP, CLS, TBT) et bloquer les merges qui les dépassent

- Monitorer l'évolution des métriques lab ET field en parallèle

- Tester sur plusieurs profils de devices et connexions, pas uniquement le preset par défaut

- Automatiser les alertes en cas de régression > 10% sur une métrique clé

- Documenter chaque correction pour identifier les patterns de régression récurrents

❓ Questions frequentes

Les données de laboratoire suffisent-elles pour optimiser les Core Web Vitals ?

Quel outil de test en laboratoire Google recommande-t-il ?

À quelle fréquence faut-il tester les performances en laboratoire ?

Un bon score Lighthouse garantit-il un bon classement SEO ?

Comment savoir si mes tests lab reflètent bien la réalité de mes utilisateurs ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/08/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.