Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Pourquoi Google insiste-t-il sur les données utilisateurs réels pour mesurer la performance SEO ?

- □ Pourquoi Google privilégie-t-il les données lab pour le débogage SEO ?

- □ Lighthouse est-il vraiment l'outil de référence pour diagnostiquer les problèmes de performance ?

- □ Pourquoi Lighthouse ne peut-il pas mesurer la vraie réactivité de votre site ?

- □ Pourquoi Lighthouse ne détecte-t-il pas tous vos problèmes de Core Web Vitals ?

- □ Pourquoi le performance panel Chrome DevTools change-t-il la donne pour le debug des Core Web Vitals ?

- □ Les données de laboratoire peuvent-elles remplacer les données terrain pour optimiser l'UX ?

- □ Faut-il vraiment tester les Core Web Vitals en laboratoire plutôt qu'en production ?

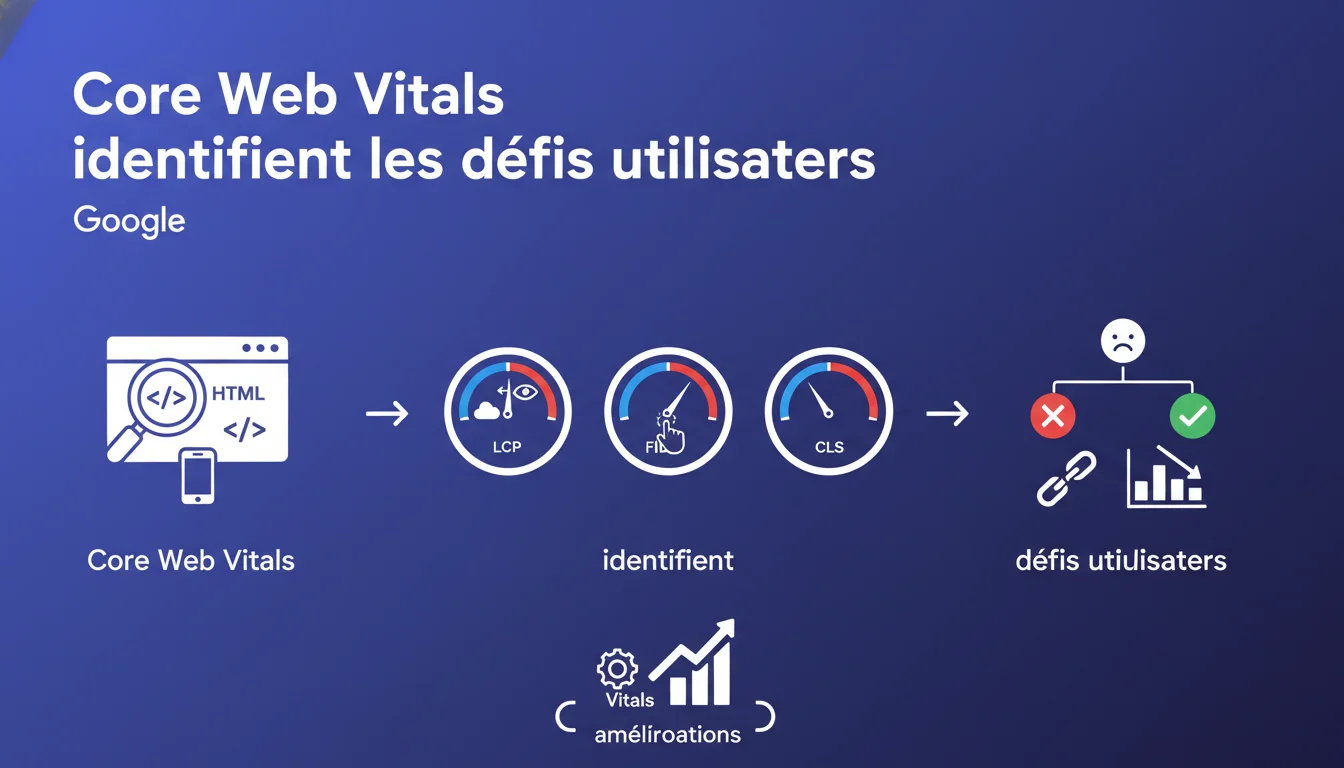

Google présente les Core Web Vitals comme un moyen d'identifier les problèmes d'expérience utilisateur sur vos pages. Le message est clair : ces métriques ne servent pas qu'au ranking, elles révèlent des frictions concrètes que rencontrent vos visiteurs. Reste à savoir si cette vision « altruiste » correspond à la réalité terrain.

Ce qu'il faut comprendre

Que signifie vraiment « identifier les défis utilisateurs » ?

Google positionne les Core Web Vitals comme des indicateurs diagnostiques, pas uniquement comme des critères de classement. L'idée : si votre LCP est catastrophique, ce n'est pas juste un signal pour l'algo — c'est un symptôme que vos visiteurs patientent trop longtemps avant de voir du contenu.

Cette approche vise à recadrer la conversation. Plutôt que de dire « optimisez pour nous », Google dit « optimisez pour vos utilisateurs, on vous donne les outils ». Sauf que dans la pratique, beaucoup de sites optimisent les CWV uniquement parce qu'ils craignent un impact ranking.

Pourquoi Google insiste-t-il sur cet angle « utilisateur » ?

Parce que les métriques de performance ont longtemps été perçues comme obscures et techniques. En les liant directement à des irritants utilisateurs (chargement lent, layout qui saute, boutons qui ne répondent pas), Google humanise le discours.

C'est aussi une manière de contrer les critiques : si vous grinchez contre les CWV, vous passez pour quelqu'un qui se fiche de l'expérience visiteur. Malin.

Les CWV capturent-ils réellement tous les défis UX ?

Non. Les Core Web Vitals mesurent trois dimensions — vitesse de chargement perçue, stabilité visuelle, réactivité. Mais l'UX, c'est bien plus large : navigation confuse, CTA invisibles, contenu illisible, pop-ups agressifs, etc.

Google le sait parfaitement. Les CWV sont un proxy, pas une radiographie complète de l'expérience utilisateur. Ils détectent certains symptômes techniques, pas la maladie dans son ensemble.

- Les CWV identifient des frictions techniques : lenteur, instabilité, latence d'interaction

- Ils ne remplacent pas une vraie analyse UX qualitative (tests utilisateurs, heatmaps, session replay)

- Google les présente comme des outils de diagnostic, mais la plupart des sites les traitent comme des critères de ranking à cocher

- Les seuils (bon/moyen/mauvais) sont arbitraires et ne reflètent pas forcément les attentes réelles de votre audience

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées ?

Sur le papier, oui. Les Core Web Vitals mesurent effectivement des irritants réels : un LCP de 6 secondes, c'est objectivement pénible pour un visiteur. Un CLS chaotique, pareil — le texte qui bouge pendant la lecture, c'est agaçant.

Mais voilà le hic : dans la pratique, énormément de sites optimisent les CWV uniquement pour le ranking, sans se poser la question de l'impact utilisateur réel. On voit des sites bricoler des lazy-loading agressifs pour gonfler le LCP, au détriment de l'UX. Alors l'intention louable de Google — « utilisez ça comme diagnostic » — se heurte à la réalité du marché.

Quelles nuances faut-il apporter ?

Première nuance : les CWV sont mesurés avec des données de terrain (CrUX), donc influencés par la connexion et le device de vos visiteurs. Un site peut avoir des CWV médiocres parce que son audience est majoritairement sur mobile 3G en zones rurales — pas forcément parce que le code est pourri.

Deuxième nuance : les seuils Google (2,5s pour LCP, 0,1 pour CLS, etc.) sont arbitraires. Ils ne correspondent pas à des études UX spécifiques à votre secteur ou audience. Un site e-commerce de luxe et un média d'actualité n'ont pas les mêmes standards de tolérance utilisateur. [À vérifier] : Google n'a jamais publié d'étude détaillée justifiant ces seuils précis.

Troisième nuance : les CWV ne capturent pas tout. Un site peut avoir d'excellents CWV et une UX désastreuse (navigation incompréhensible, wording foireux, tunnel de conversion cassé). Inversement, un site avec des CWV moyens mais un contenu exceptionnel et une ergonomie soignée performera mieux.

Dans quels cas cette approche « diagnostic » est-elle vraiment utile ?

Elle l'est quand vous avez des symptômes UX flous et que les CWV pointent vers un coupable technique précis. Par exemple : taux de rebond élevé sur mobile + LCP catastrophique = probablement un problème de chargement initial.

Elle l'est moins si vous prenez les CWV comme une checklist à cocher sans corréler avec vos KPIs métier (conversion, engagement, temps passé). J'ai vu des sites passer de « moyen » à « bon » sur les CWV sans aucun impact sur la conversion — parce que le vrai problème était ailleurs.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette déclaration ?

Première étape : mesurez vos CWV avec les bons outils (Search Console, PageSpeed Insights, CrUX Dashboard). Regardez les données terrain, pas juste les tests lab — ce qui compte, c'est l'expérience réelle de vos visiteurs.

Deuxième étape : correlez CWV et métriques métier. Si votre LCP est mauvais ET que votre taux de rebond explose sur mobile, vous avez un problème à traiter. Si vos CWV sont moyens mais que vos conversions sont stables, peut-être que ce n'est pas votre priorité numéro un.

Troisième étape : traitez les CWV comme un diagnostic, pas comme une fin en soi. Un mauvais CLS vous dit « il y a de l'instabilité visuelle », pas « virez toutes vos pubs ». Creusez pour comprendre d'où vient le problème — images sans dimensions, fonts qui chargent tard, éléments injectés dynamiquement — et corrigez intelligemment.

Quelles erreurs éviter absolument ?

Erreur numéro un : optimiser pour le score, pas pour l'utilisateur. J'ai vu des sites retarder artificiellement l'affichage de contenu pour améliorer le LCP — techniquement ça marche, en pratique c'est absurde.

Erreur numéro deux : ignorer le contexte de votre audience. Si 80% de vos visiteurs sont sur desktop fibre, vous n'avez pas les mêmes enjeux qu'un site consulté majoritairement sur mobile 4G fluctuante. Les CWV globaux peuvent masquer des disparités cruciales.

Erreur numéro trois : négliger les autres dimensions UX. Les CWV ne détectent pas un tunnel de paiement confus, un wording anxiogène, ou une navigation incompréhensible. Ne vous arrêtez pas là.

Comment vérifier que votre approche est pertinente ?

Comparez avant/après : améliorez vos CWV sur un segment de pages, et mesurez l'impact sur vos KPIs métier (taux de rebond, temps passé, conversion, pages par session). Si ça bouge positivement, vous êtes sur la bonne piste.

Utilisez des outils qualitatifs en complément : session replay, heatmaps, tests utilisateurs. Les CWV vous disent « il y a un problème », ces outils vous disent « voilà ce que vivent vraiment vos visiteurs ».

- Mesurez vos CWV avec des données terrain (CrUX), pas uniquement lab

- Correlez CWV et métriques métier pour prioriser les actions

- Identifiez les causes racines des mauvais scores (images, fonts, JS, ads) avant de corriger

- Évitez les optimisations cosmétiques qui gonflent le score sans améliorer l'expérience réelle

- Segmentez par device et connexion pour détecter les vraies frictions

- Complétez avec des outils UX qualitatifs (heatmaps, session replay, tests utilisateurs)

- Testez l'impact de vos optimisations sur la conversion et l'engagement, pas juste sur le score

❓ Questions frequentes

Les Core Web Vitals sont-ils un facteur de ranking majeur ?

Faut-il viser le « bon » (vert) sur tous les CWV pour être bien classé ?

Les données CrUX reflètent-elles vraiment l'expérience de mes visiteurs ?

Peut-on avoir d'excellents CWV et une UX désastreuse ?

Les seuils Google (2,5s pour LCP, etc.) sont-ils basés sur des études scientifiques ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/08/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.