Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Pourquoi votre site peut-il être invisible pour Googlebot alors qu'il s'affiche parfaitement dans votre navigateur ?

- □ Comment vérifier si Googlebot crawle vraiment votre contenu JavaScript ?

- □ Pourquoi Google insiste-t-il sur la surveillance des erreurs serveur dans le rapport Statistiques d'exploration ?

- □ Faut-il vraiment s'inquiéter de chaque erreur de crawl remontée dans la Search Console ?

- □ Faut-il vraiment agir sur chaque erreur 500 détectée par Google dans le rapport de crawl ?

- □ Comment analyser vos logs serveur pour optimiser le crawl de Google ?

- □ Pourquoi vos pages n'entrent-elles pas dans Google Search malgré tous vos efforts SEO ?

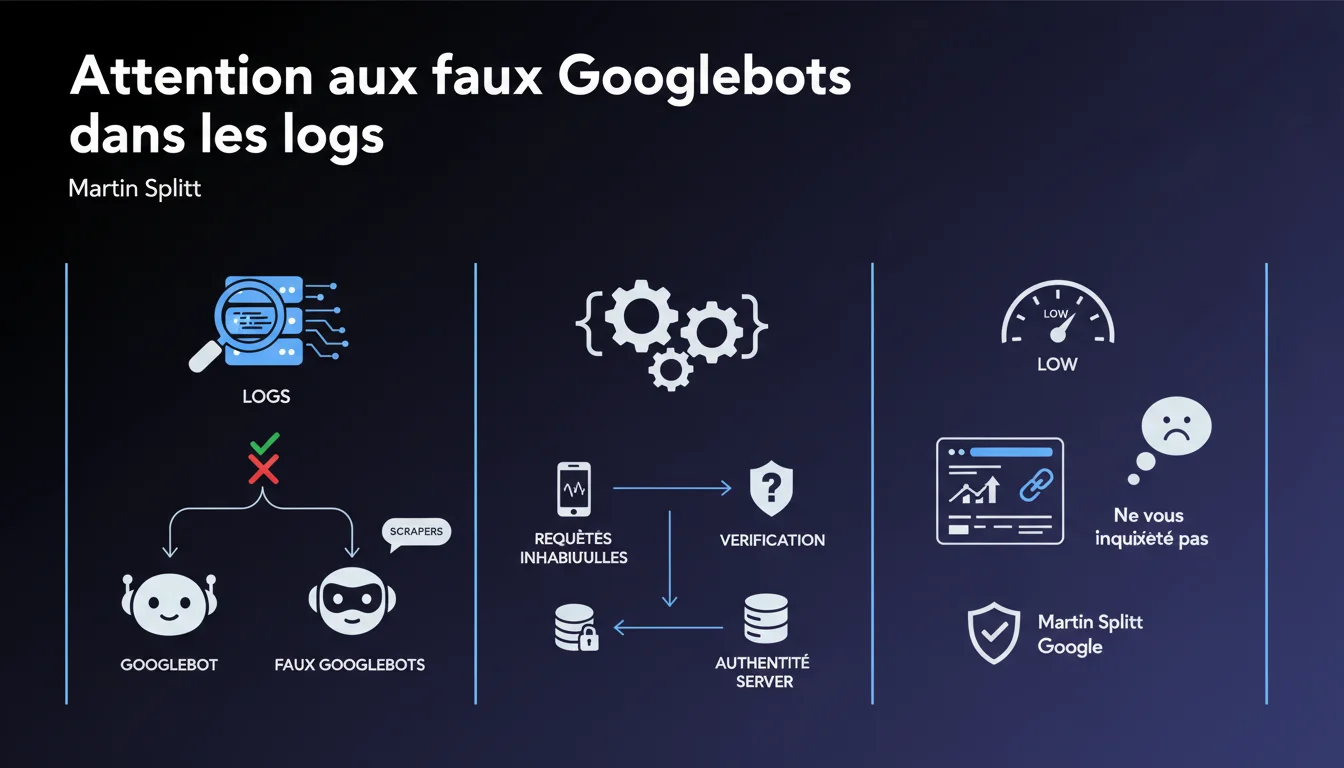

Martin Splitt rappelle que de nombreux robots se font passer pour Googlebot dans les logs. Ces scrapers tiers peuvent générer des requêtes inhabituelles et fausser vos analyses. La seule solution fiable : vérifier systématiquement l'authenticité via reverse DNS ou la Search Console.

Ce qu'il faut comprendre

Pourquoi tant de faux Googlebots circulent-ils sur le web ?

Le user-agent Googlebot est trivial à usurper. N'importe quel script peut déclarer « Je suis Googlebot » dans ses headers HTTP. Les scrapers malveillants exploitent cette faille pour deux raisons principales : contourner les protections anti-bot (nombreux sites autorisent Googlebot par défaut) et masquer leur véritable identité lors du scraping massif.

Le problème devient critique quand ces faux bots génèrent des milliers de requêtes. Votre équipe technique panique en voyant un « Googlebot » crawlant 50 000 pages par jour, alors que le vrai Google n'a jamais eu ce comportement sur votre site.

Quels risques concrets pour votre analyse SEO ?

Si vous basez vos décisions sur des logs pollués, vous allez tirer des conclusions erronées. Un crawl massif attribué à tort à Googlebot peut vous faire croire que Google explore enfin vos pages profondes — alors qu'il s'agit d'un concurrent qui aspire votre catalogue.

Autre cas fréquent : vous détectez des erreurs 404 ou 500 dans les logs « Googlebot ». Vous corrigez en urgence… sauf que ces requêtes viennent d'un scraper qui teste des URLs bidons. Résultat : temps perdu, ressources gâchées.

Comment vérifier l'authenticité d'un Googlebot dans les logs ?

Google recommande deux méthodes officielles. La première : reverse DNS lookup — vous vérifiez que l'IP se résout en *.googlebot.com ou *.google.com, puis vous effectuez un DNS forward pour confirmer que ce domaine pointe bien vers la même IP. C'est la méthode la plus fiable côté serveur.

La seconde : consulter la Search Console dans « Statistiques d'exploration ». Si votre firewall bloque une IP prétendant être Googlebot, croisez avec les timestamps et URLs réellement crawlées par Google. Un décalage flagrant ? C'est un imposteur.

- Les faux Googlebots exploitent la facilité d'usurpation des user-agents HTTP

- Ils faussent vos métriques de crawl et peuvent masquer des activités de scraping

- Seules les vérifications DNS ou la Search Console garantissent l'authenticité

- Ne jamais se fier uniquement au user-agent dans les headers

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et c'est même un euphémisme. Tous les audits techniques que je mène révèlent une pollution massive des logs. Certains sites e-commerce voient 40 à 60 % de leur « trafic Googlebot » provenir en réalité de scrapers chinois, russes ou de services d'agrégation qui se déguisent.

Le vrai Googlebot a des patterns reconnaissables : il respecte le crawl budget, évite les boucles infinies, se concentre sur les sections stratégiques. Un faux bot va souvent crawler des URLs absurdes, ignorer le robots.txt, ou marteler une catégorie pendant des heures. Soyons honnêtes — si votre Googlebot crawle 500 pages par seconde, c'est un imposteur.

Quelles nuances faut-il apporter à cette recommandation ?

Martin Splitt dit « ne vous inquiétez pas des requêtes inhabituelles ». C'est vrai… jusqu'à un certain point. Si ces faux bots saturent votre serveur, vous devez agir. Un scraper agressif peut dégrader les temps de réponse pour le vrai Googlebot, ce qui impacte indirectement votre crawl budget.

Autre limite : la vérification DNS prend du temps et ne peut pas être faite en temps réel sur chaque requête. Sur un site à fort trafic, vous devrez scripter cette vérification et maintenir une whitelist d'IPs validées. [À vérifier] — Google met-il à jour une liste publique des plages IP Googlebot ? Officiellement non, mais des listes circulent.

Enfin, attention aux outils d'analyse de logs type Oncrawl ou Botify : la plupart filtrent par user-agent par défaut. Si vous ne corrigez pas ce biais, vos rapports sont faussés dès le départ.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si vous exploitez un CDN type Cloudflare avec bot management activé, une partie du tri est déjà faite en amont. Cloudflare maintient sa propre liste d'IPs Googlebot validées et filtre les imposteurs automatiquement — mais pas à 100 %.

Les très gros sites (millions de pages) avec des équipes DevOps dédiées peuvent se permettre des systèmes de détection avancés basés sur le comportement (machine learning, analyse des patterns de crawl). Pour les autres ? La méthode reverse DNS reste la plus accessible.

Impact pratique et recommandations

Que faut-il faire concrètement pour nettoyer vos logs ?

Première étape : auditer vos logs serveur sur une période représentative (au moins 30 jours). Extrayez toutes les requêtes avec le user-agent Googlebot, puis isolez les IPs. Lancez un script de vérification DNS reverse/forward sur chaque IP unique. Vous allez vite repérer les imposteurs.

Ensuite, bannissez ces IPs via votre .htaccess, nginx.conf ou votre WAF. Attention — ne bloquez pas par user-agent, ça ne sert à rien puisque justement c'est ce qui est usurpé. Bloquez par adresse IP validée comme fausse.

Quelles erreurs éviter lors de la mise en place des vérifications ?

Erreur classique : croire qu'un user-agent complexe ou récent est forcément légitime. Les scrapers modernes copient les derniers user-agents Googlebot smartphone ou desktop à la lettre. Ça ne prouve rien.

Autre piège : se fier aux stats de votre hébergeur. Beaucoup d'outils analytics serveur agrègent par user-agent sans validation DNS. Vous voyez « Googlebot a crawlé 10 000 pages », mais c'est un mélange d'IPs légitimes et d'imposteurs.

Et c'est là que ça coince — certains collègues bloquent des plages IP entières par peur, et finissent par exclure une IP Google légitime nouvellement ajoutée. Résultat : le vrai Googlebot ne peut plus crawler, et vous perdez en visibilité sans comprendre pourquoi.

Comment automatiser cette vérification à l'échelle ?

Pour un site avec du volume, scripter la vérification DNS est indispensable. Python avec les librairies socket ou dnspython fait le job. Vous créez une whitelist dynamique des IPs Googlebot validées, que vous mettez à jour chaque semaine.

Intégrez cette whitelist dans votre WAF ou votre reverse proxy. Les requêtes provenant d'IPs non validées avec un user-agent Googlebot sont soit bloquées, soit servies avec un délai (rate limiting), soit redirigées vers une page piège pour identifier le scraper.

- Auditer vos logs sur 30 jours minimum pour identifier les patterns suspects

- Utiliser un script de vérification DNS reverse/forward sur toutes les IPs « Googlebot »

- Bannir par IP (pas par user-agent) les imposteurs confirmés

- Croiser vos logs avec les données de la Search Console pour valider la cohérence

- Automatiser la mise à jour de votre whitelist Googlebot via script hebdomadaire

- Configurer un rate limiting différencié pour les IPs non validées

- Documenter les IPs Google légitimes dans un fichier partagé avec l'équipe DevOps

❓ Questions frequentes

Peut-on se fier uniquement au user-agent pour identifier Googlebot ?

Quels sont les patterns typiques d'un faux Googlebot dans les logs ?

Comment croiser les données de logs avec la Search Console ?

Est-il risqué de bannir des IPs sans vérification approfondie ?

Les CDN comme Cloudflare filtrent-ils automatiquement les faux Googlebots ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 13/12/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.