Google manque-t-il vraiment d'espace de stockage pour indexer votre contenu ?

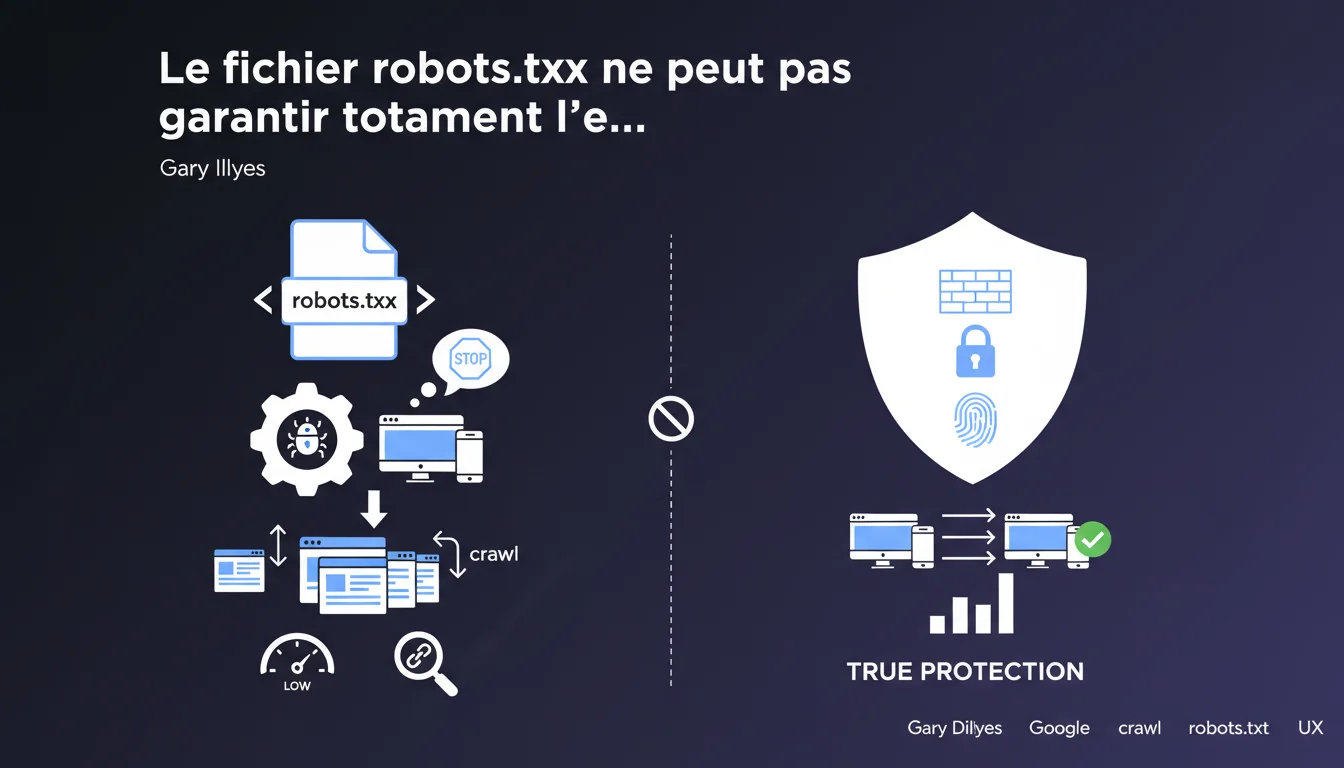

Gary Illyes

🎥 YouTube

14/03/2024

★★★

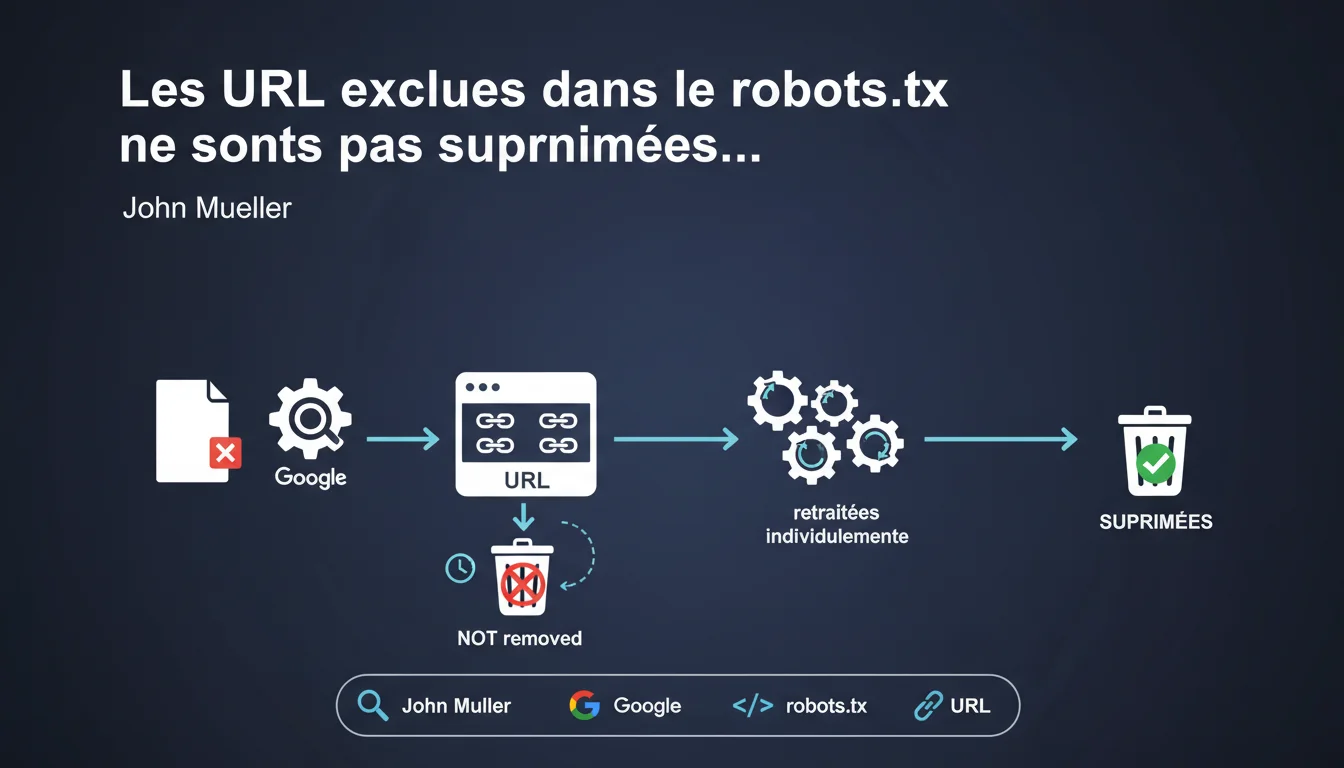

Google doit gérer ce qui est mis dans l'index et ce qui en est exclu. Souvent, l'exclusion n'est pas due à la faible qualité du contenu, mai...