Declaration officielle

Ce qu'il faut comprendre

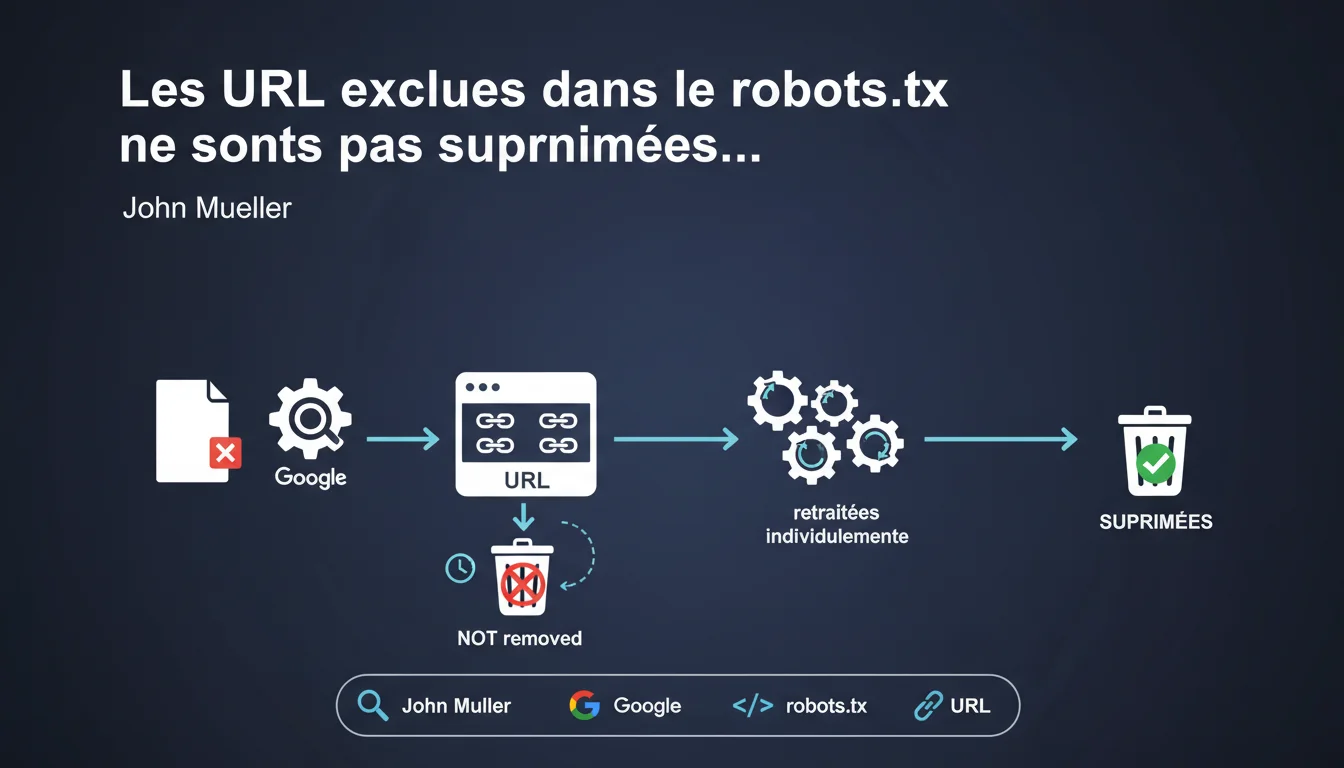

Lorsqu'un praticien SEO ajoute une directive d'exclusion dans le fichier robots.txt, il s'attend souvent à ce que les URL concernées disparaissent rapidement de l'index Google. La réalité est différente.

Google ne supprime pas instantanément les URL du moment où le robots.txt modifié est découvert. Le processus se déroule en deux étapes distinctes : d'abord Google doit détecter et traiter le nouveau robots.txt, puis chaque URL concernée doit être retraitée individuellement par les robots d'exploration.

Ce retraitement individuel dépend du budget de crawl alloué au site et de la priorité que Google accorde à chaque URL. Une page très populaire avec de nombreux backlinks sera recrawlée plus fréquemment qu'une page orpheline enfouie dans l'arborescence.

- Le changement du robots.txt n'a pas d'effet immédiat sur l'indexation

- Chaque URL bloquée doit être individuellement recrawlée pour que la directive s'applique

- Le délai peut varier de quelques jours à plusieurs mois selon les URL

- Le budget de crawl et la popularité des pages influencent directement ce délai

Avis d'un expert SEO

Cette clarification est parfaitement cohérente avec ce que nous observons sur le terrain depuis des années. Il n'est pas rare de constater qu'une URL bloquée via robots.txt reste visible dans les SERP pendant 2 à 3 mois, voire davantage pour les pages rarement crawlées.

Un point crucial souvent négligé : bloquer une URL dans le robots.txt n'est pas la méthode recommandée pour supprimer du contenu de l'index. Cette approche empêche Googlebot de crawler la page, mais si celle-ci possède des backlinks, Google peut continuer à l'afficher dans les résultats avec une description générique basée sur les signaux externes uniquement.

Dans les faits, certaines URL bénéficiant d'un crawl quotidien verront la directive appliquée en quelques jours, tandis que d'autres avec un crawl mensuel prendront logiquement plusieurs mois. La fréquence de crawl historique de vos pages est le meilleur indicateur du délai à prévoir.

Impact pratique et recommandations

- Ne comptez jamais sur le robots.txt pour une désindexation rapide ou urgente – privilégiez l'outil de suppression temporaire dans la Search Console

- Utilisez la balise noindex plutôt que le robots.txt si votre objectif est de retirer des pages de l'index (tout en laissant Google y accéder pour lire la directive)

- Anticipez un délai de plusieurs semaines à plusieurs mois pour que les modifications du robots.txt s'appliquent complètement sur l'ensemble des URL concernées

- Surveillez la désindexation via des requêtes "site:" et la Search Console pour vérifier progressivement la prise en compte des changements

- Priorisez les URL importantes en créant des liens internes vers elles si vous souhaitez accélérer leur recrawl (si elles ne sont pas bloquées)

- Documentez vos changements de robots.txt avec des dates pour pouvoir corréler les effets observés dans le temps

- Testez votre robots.txt avec l'outil de test de la Search Console avant publication pour éviter les erreurs de syntaxe qui retarderaient encore le processus

Le blocage via robots.txt est un processus asynchrone et progressif, pas une suppression instantanée. Pour une stratégie de désindexation efficace, il faut comprendre la différence entre empêcher le crawl (robots.txt) et demander la désindexation (noindex).

La gestion technique de ces directives et le monitoring de leur application nécessitent une expertise pointue et une surveillance régulière. Ces optimisations, bien que fondamentales, s'inscrivent dans une stratégie SEO technique globale où chaque décision peut avoir des répercussions durables. Si vous gérez un site de grande envergure ou si vous devez orchestrer des migrations complexes, l'accompagnement par une agence SEO spécialisée peut s'avérer précieux pour éviter les erreurs coûteuses et garantir une exécution maîtrisée de ces manipulations délicates.

💬 Commentaires (0)

Soyez le premier à commenter.