Declaration officielle

Ce qu'il faut comprendre

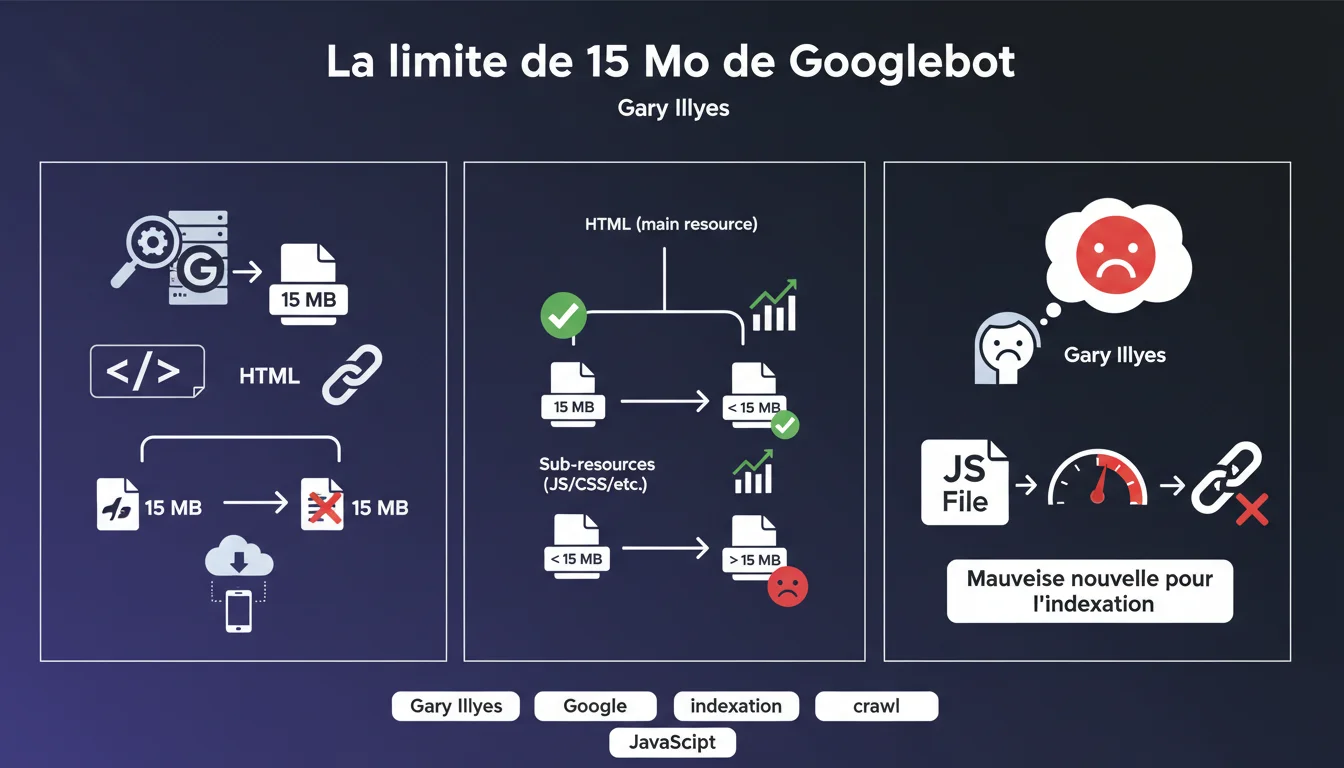

Google a clarifié les règles d'exploration de son robot Googlebot en précisant qu'une limite stricte de 15 Mo s'applique non seulement au code HTML de vos pages, mais également à chaque ressource individuelle référencée : fichiers JavaScript, CSS, images, etc.

Cette limite, augmentée de 10 Mo à 15 Mo en 2022, signifie concrètement que toute ressource dépassant ce seuil sera tronquée lors de l'exploration. Googlebot n'analysera que les premiers 15 Mo du fichier, ignorant le reste du contenu.

Pour les fichiers JavaScript volumineux dépassant cette limite, les conséquences peuvent être significatives : fonctionnalités manquantes, contenu non indexé, ou rendu incomplet de vos pages dans les résultats de recherche.

- La limite de 15 Mo concerne chaque fichier individuellement, pas la page entière

- Les fichiers JavaScript et CSS sont particulièrement concernés par cette restriction

- Un fichier tronqué peut empêcher le bon rendu et l'indexation de votre contenu

- La taille moyenne d'un fichier HTML est de 30 Ko, bien en dessous de la limite

- Les applications JavaScript modernes (SPA) sont les plus à risque

Avis d'un expert SEO

Dans la pratique quotidienne du SEO, cette limite de 15 Mo ne pose problème que pour une minorité de sites, principalement ceux utilisant des frameworks JavaScript lourds ou des bibliothèques non optimisées. La majorité des sites web respectent naturellement cette contrainte.

Cependant, il existe des cas limites préoccupants : certaines applications web modernes compilent l'ensemble de leur code JavaScript en un seul bundle, qui peut facilement dépasser plusieurs mégaoctets. Les sites utilisant de nombreuses bibliothèques tierces sans tree-shaking approprié sont également vulnérables.

Les frameworks comme React, Vue ou Angular, lorsqu'ils sont mal configurés en production, peuvent générer des bundles dépassant cette limite. Le code splitting et la minification deviennent alors des nécessités techniques, pas simplement des optimisations.

Impact pratique et recommandations

- Auditez la taille de vos ressources : Utilisez les outils de développement de votre navigateur (onglet Network) pour identifier tous les fichiers JavaScript et CSS chargés sur vos pages principales

- Vérifiez vos bundles JavaScript : Si vous utilisez un framework moderne, contrôlez la taille des fichiers générés en production et activez la minification

- Implémentez le code splitting : Divisez vos gros fichiers JavaScript en modules plus petits chargés à la demande plutôt qu'en un seul bloc monolithique

- Optimisez vos bibliothèques tierces : Supprimez les dépendances inutiles et utilisez des imports sélectifs plutôt que d'importer des bibliothèques entières

- Activez la compression Gzip/Brotli : Même si la limite s'applique au fichier décompressé, réduire la taille téléchargée améliore les performances globales

- Surveillez régulièrement : Mettez en place un monitoring automatique de la taille de vos ressources dans votre pipeline de déploiement

- Testez avec Google Search Console : Utilisez l'outil d'inspection d'URL pour vérifier que Googlebot rend correctement vos pages les plus importantes

- Priorisez les pages stratégiques : Concentrez vos efforts d'optimisation sur les pages à fort enjeu commercial ou SEO en premier lieu

Ces optimisations techniques, particulièrement sur les architectures JavaScript modernes, nécessitent souvent une expertise approfondie en développement front-end et en SEO technique. La configuration du code splitting, l'audit des dépendances et la mise en place d'une architecture optimisée peuvent rapidement devenir complexes.

Pour les sites à fort trafic ou ceux reposant sur des frameworks JavaScript, faire appel à une agence SEO spécialisée permet de bénéficier d'un accompagnement personnalisé. Des experts peuvent auditer votre architecture technique, identifier précisément les ressources problématiques et mettre en œuvre les solutions adaptées à votre contexte spécifique, tout en préservant les fonctionnalités de votre site.

💬 Commentaires (0)

Soyez le premier à commenter.