Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Pourquoi la limite de 15 Mo de Googlebot n'est-elle documentée que maintenant ?

- □ Quelles sont les 3 seules exigences techniques absolues pour être indexé par Google ?

- □ Faut-il vraiment ignorer ce que Google ne supporte pas ?

- □ Pourquoi Google a-t-il divisé ses guidelines en règles strictes et simples recommandations ?

- □ Comment prioriser vos actions SEO selon le système de classification de Google ?

- □ L'accessibilité Googlebot est-elle vraiment une condition binaire pour l'indexation ?

- □ Google distingue-t-il vraiment les changements de documentation des changements d'algorithme ?

- □ HTTPS et vitesse : peut-on vraiment s'en passer pour ranker sur Google ?

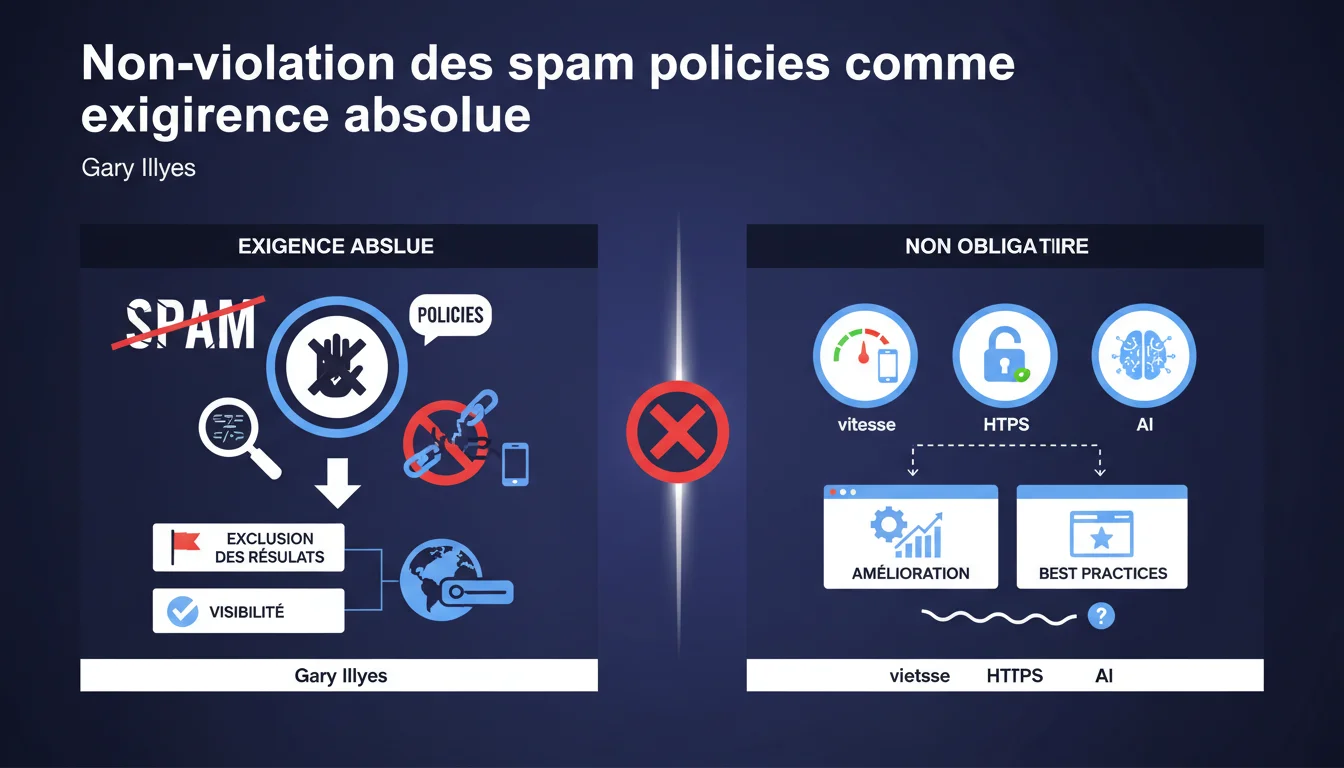

Google pose désormais une ligne claire : le respect des spam policies est une exigence absolue pour rester indexé, contrairement à la vitesse ou HTTPS qui restent des facteurs de classement mais non éliminatoires. Cette distinction entre « hard requirements » et « best practices » change la manière dont il faut prioriser les chantiers SEO — certains points deviennent non négociables.

Ce qu'il faut comprendre

Pourquoi Google formalise-t-il cette distinction maintenant ?

Pendant des années, Google a mélangé recommandations et exigences sans clarifier ce qui relevait du « nice to have » ou du « must have ». Cette déclaration marque un tournant : le non-spam devient une condition sine qua non d'inclusion dans l'index, au même titre que l'accessibilité technique du site.

Ce changement de communication n'est pas anodin. Il reflète une volonté de responsabiliser les éditeurs et de justifier des actions manuelles ou algorithmiques plus sévères. En séparant clairement spam policies et best practices, Google se donne aussi un cadre juridique plus solide pour défendre ses décisions d'exclusion.

Qu'est-ce qui bascule dans la catégorie « exigence absolue » ?

Concrètement, tout ce qui touche aux spam policies : contenu automatisé de mauvaise qualité, cloaking, keyword stuffing agressif, redirections trompeuses, liens manipulateurs à grande échelle, scraping massif. Si votre site viole ces règles, il peut être désindexé partiellement ou totalement, indépendamment de ses performances techniques.

À l'inverse, la vitesse, HTTPS, les Core Web Vitals, la compatibilité mobile restent des facteurs de classement. Un site lent avec du HTTP peut toujours être indexé et ranker — mal, certes, mais il reste dans la course. Un site qui spamme, lui, sort du jeu.

Cette hiérarchisation change-t-elle vraiment la donne pour les praticiens ?

En pratique, la plupart des SEO sérieux ne franchissaient déjà pas ces lignes rouges. Mais cette formalisation clarifie les priorités, surtout pour les clients qui veulent tout optimiser en même temps sans budget suffisant.

Elle permet aussi de justifier certaines recommandations : non, on ne peut pas « tester » du contenu auto-généré à la chaîne en espérant que ça passe. Le risque n'est plus un simple déclassement, c'est la sortie de l'index.

- Le respect des spam policies devient une condition d'indexation, pas seulement un facteur de ranking

- La vitesse, HTTPS, CWV restent importants mais non éliminatoires

- Cette distinction clarifie la priorisation des chantiers SEO face à des budgets limités

- Google se donne un cadre plus ferme pour justifier des pénalités manuelles ou algorithmiques

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui et non. Depuis des années, on observe que certains sites spammeurs survivent dans l'index malgré des violations flagrantes — scraping massif, fermes de liens, contenu auto-généré. L'écart entre la doctrine officielle et l'application réelle reste parfois béant.

Cette déclaration ne change donc pas grand-chose à court terme pour ceux qui exploitent les failles. Elle sert surtout à poser un cadre officiel pour des actions futures. [A vérifier] si Google renforce réellement la détection automatisée ou les actions manuelles suite à cette communication.

Quelles nuances faut-il apporter à cette « exigence absolue » ?

Soyons honnêtes : Google ne peut pas examiner manuellement les milliards de pages indexées. L'exigence est « absolue » en théorie, mais son application dépend de la capacité de détection — algorithmique ou suite à un signalement.

Certaines zones grises subsistent. Par exemple, jusqu'où peut aller l'assistance IA dans la génération de contenu avant de tomber sous le coup du « spammy automatically-generated content » ? Google reste volontairement flou. De même, la frontière entre netlinking naturel et « link schemes » reste une interprétation casuistique.

Dans quels cas cette règle ne protège-t-elle pas ?

Un site peut respecter scrupuleusement toutes les spam policies et ne jamais ranker s'il n'a ni autorité, ni contenu pertinent, ni signaux utilisateurs positifs. L'absence de spam est une condition nécessaire mais pas suffisante.

Inversement, des sites qui frôlent les limites (contenu borderline, backlinks moyennement propres) peuvent continuer à performer s'ils apportent une vraie valeur et génèrent de l'engagement. Le contexte et l'intention comptent encore, même si Google durcit le discours.

Impact pratique et recommandations

Que faut-il faire concrètement pour rester du bon côté de la ligne ?

Avant de courir après les Core Web Vitals ou HTTPS, auditez votre conformité aux spam policies. Passez en revue chaque section des guidelines : contenu automatisé, cloaking, keyword stuffing, redirections suspectes, liens achetés ou échangés en masse.

Si vous utilisez de l'IA pour produire du contenu, assurez-vous qu'un humain relit, enrichit et valide chaque publication. Le contenu généré doit apporter une valeur réelle, pas dupliquer du texte reformulé. Et documentez ce processus — en cas de review manuelle, vous devez pouvoir prouver votre bonne foi.

Quelles erreurs éviter pour ne pas franchir la ligne rouge ?

Ne misez jamais sur la non-détection comme stratégie. Ce qui passe aujourd'hui peut être rattrapé par un algorithme demain — et Google ne prévient pas avant de dégainer. Évitez les tactiques « limite » : PBN même discret, contenu spinner même « amélioré », achats de liens même déguisés.

Soyez particulièrement vigilant sur les contenus tiers : commentaires, UGC, annuaires, forums. Si votre site héberge du spam sans modération, vous en êtes responsable aux yeux de Google. Mettez en place une modération stricte et des noindex/nofollow sur les sections à risque.

Comment vérifier que mon site respecte ces exigences absolues ?

Utilisez la Search Console pour repérer d'éventuelles actions manuelles déjà en cours. Consultez le rapport « Problèmes de sécurité et actions manuelles » régulièrement — certaines pénalités passent inaperçues si on ne vérifie pas.

Faites auditer votre profil de liens par un tiers indépendant, surtout si vous avez hérité d'un historique SEO opaque. Désavouez ce qui est clairement toxique, mais sans paranoïa — un nettoyage trop agressif peut aussi nuire.

- Auditer la conformité de chaque section du site aux spam policies officielles

- Documenter les processus éditoriaux, surtout si vous utilisez l'IA pour la production

- Mettre en place une modération stricte sur tout contenu généré par les utilisateurs

- Surveiller la Search Console pour détecter toute action manuelle dès son apparition

- Faire auditer le profil de backlinks par un expert externe pour identifier les risques

- Désavouer les liens manifestement toxiques sans tomber dans la sur-réaction

- Prioriser la conformité anti-spam avant l'optimisation technique ou la vitesse

❓ Questions frequentes

Un site lent peut-il être désindexé par Google ?

HTTPS est-il obligatoire pour rester dans l'index Google ?

Quelles sont exactement les spam policies dont la violation entraîne une désindexation ?

Si mon site a été pénalisé pour spam, puis-je revenir dans l'index ?

Cette distinction entre exigences et bonnes pratiques change-t-elle la stratégie SEO globale ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/12/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.