Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Faut-il optimiser son site différemment pour AI Overviews et AI Mode ?

- □ Faut-il adapter sa stratégie SEO pour les fonctionnalités IA de Google ?

- □ Les clics depuis AI Overviews convertissent-ils vraiment mieux ?

- □ Les AI Overviews favorisent-elles vraiment une plus grande diversité de sites ?

- □ Pourquoi Google insiste-t-il autant sur la « valeur unique » du contenu ?

- □ Les recommandations Search Console sur Core Web Vitals vont-elles enfin servir à quelque chose ?

- □ L'analyse des logs est-elle vraiment la compétence SEO qui survivra à tout ?

- □ Faut-il arrêter de parler de SEO et adopter les nouveaux termes AIO, GEO ou optimisation pour LLM ?

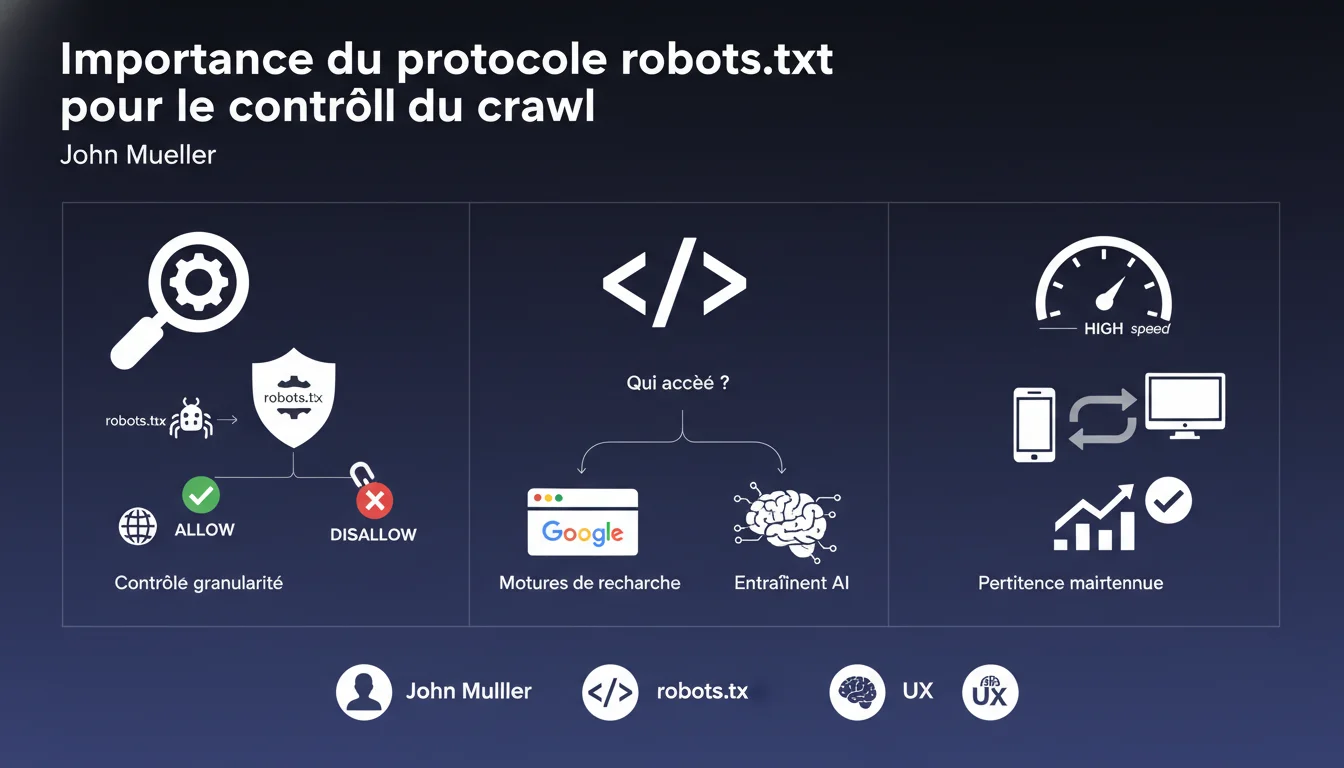

Google confirme que le fichier robots.txt reste un outil pertinent pour contrôler l'accès des crawlers, y compris ceux dédiés à l'entraînement des modèles d'IA. Les webmasters conservent donc un levier granulaire pour gérer ce qui est accessible ou non, au-delà du simple référencement classique.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il encore sur le robots.txt ?

Le protocole d'exclusion robots existe depuis plus de 30 ans, et on aurait pu penser qu'avec l'évolution des technologies et des APIs, ce fichier texte archaïque aurait perdu de sa superbe. Pourtant, John Mueller réaffirme son importance.

La raison ? L'explosion des crawlers non-SEO, notamment ceux dédiés au scraping de contenu pour entraîner des modèles d'IA générative. Le robots.txt devient un rempart — certes imparfait — contre ces nouvelles formes d'aspiration de données.

Qu'est-ce qui change concrètement avec l'IA ?

Jusqu'à récemment, le robots.txt servait principalement à gérer le crawl budget et éviter l'indexation de pages inutiles. Désormais, il sert aussi à bloquer les bots d'OpenAI, Anthropic, Google Bard ou autres acteurs qui raclent le web pour alimenter leurs LLM.

Le problème, c'est que tous les crawlers ne respectent pas ce fichier. Certains ignorent volontairement les directives, d'autres changent de user-agent pour contourner les blocages. On est donc sur un contrôle théorique plus que réel.

Quelles sont les limites de ce contrôle granulaire ?

Google parle de contrôle "granulaire", mais soyons honnêtes : le robots.txt ne permet que de bloquer ou autoriser des répertoires ou des fichiers. Pas de nuances, pas de conditions.

De plus, bloquer un crawler IA ne protège pas le contenu déjà scrapé. Si votre site a été crawlé avant que vous n'ajoutiez une directive, c'est trop tard. Le fichier robots.txt n'est pas rétroactif.

- Le robots.txt reste un standard reconnu par la majorité des crawlers légitimes

- Il permet de bloquer spécifiquement les user-agents des crawlers IA (ex: GPTBot, Google-Extended, CCBot)

- Son respect dépend entièrement de la bonne volonté du crawler — aucune garantie technique

- Il ne protège pas contre les crawlers qui falsifient leur user-agent

- Les directives ne s'appliquent qu'aux futures visites, pas aux données déjà collectées

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. Dans l'écosystème SEO classique, le robots.txt fonctionne bien : Googlebot, Bingbot et consorts respectent scrupuleusement les directives. Aucun souci de ce côté.

Là où ça coince, c'est avec les crawlers tiers moins scrupuleux. Des analyses de logs montrent que certains bots continuent de crawler des sections bloquées en changeant de user-agent ou en passant par des proxies. Le "contrôle granulaire" vanté par Google n'est donc réel que pour les acteurs qui jouent le jeu.

Quelles nuances faut-il apporter à ce discours ?

Google met en avant le robots.txt comme solution universelle, mais omet de mentionner ses faiblesses. Un fichier robots.txt mal configuré peut bloquer des ressources critiques (CSS, JS) et nuire au rendu des pages côté Googlebot.

Autre point : bloquer les crawlers IA via robots.txt, c'est renoncer à toute visibilité dans les résumés générés par IA. Si demain Google Search Generative Experience ou ChatGPT deviennent des canaux d'acquisition majeurs, avoir bloqué ces bots pourrait s'avérer contre-productif. [A vérifier] sur le long terme.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si votre objectif est de protéger juridiquement votre contenu contre le scraping IA, le robots.txt ne suffit pas. Il n'a aucune valeur contractuelle contraignante — c'est juste un "gentlemen's agreement".

Pour une protection réelle, il faut combiner plusieurs leviers : conditions d'utilisation explicites, watermarking du contenu, rate limiting côté serveur, et éventuellement des actions légales. Le robots.txt seul ne protège rien juridiquement.

Impact pratique et recommandations

Que faut-il faire concrètement dès maintenant ?

Première étape : auditer votre fichier robots.txt actuel. Vérifiez qu'il ne bloque pas par erreur des ressources nécessaires au rendu (JS, CSS, images critiques). Google Search Console vous alerte si c'est le cas.

Ensuite, décidez si vous souhaitez bloquer les crawlers IA. Si oui, ajoutez des directives spécifiques pour chaque user-agent concerné (GPTBot, Google-Extended, CCBot, anthropic-ai, etc.). Si non, laissez-les crawler — vous pourriez bénéficier de citations dans les réponses générées.

Quelles erreurs critiques éviter absolument ?

Erreur n°1 : bloquer Googlebot sur des pages que vous voulez indexer. Ça arrive plus souvent qu'on ne le pense, notamment après des refontes où on oublie de nettoyer les vieilles directives.

Erreur n°2 : croire que "Disallow: /" dans robots.txt supprime les pages de l'index. Non. Ça empêche le crawl, mais Google peut quand même indexer des URLs via des backlinks externes. Pour vraiment désindexer, il faut une balise noindex.

Erreur n°3 : ne pas monitorer les logs serveur après modification. Certains crawlers ignorent robots.txt et continuent de squatter vos ressources. Sans analyse des logs, vous ne le verrez jamais.

Comment vérifier que tout est bien configuré ?

Utilisez l'outil de test robots.txt de Google Search Console. Il vous montre en temps réel quelles URLs sont bloquées pour Googlebot. Testez aussi avec différents user-agents pour voir le comportement.

Côté crawlers IA, la seule vérification fiable passe par l'analyse des logs serveur. Cherchez les user-agents suspects et vérifiez s'ils respectent vos directives. Si non, envisagez un blocage IP côté pare-feu.

- Auditer le robots.txt existant via Google Search Console

- Vérifier qu'aucune ressource critique (CSS, JS) n'est bloquée

- Ajouter des directives spécifiques pour les crawlers IA si souhaité

- Tester le fichier avec plusieurs user-agents

- Monitorer les logs serveur pour détecter les crawlers non-conformes

- Documenter chaque modification du robots.txt (date, raison, impact)

- Mettre en place des alertes si le taux de crawl explose

❓ Questions frequentes

Bloquer les crawlers IA via robots.txt empêche-t-il mon contenu d'être utilisé pour l'entraînement ?

Peut-on bloquer Googlebot pour l'IA tout en restant crawlé pour le SEO classique ?

Un robots.txt mal configuré peut-il faire chuter mon trafic SEO ?

Le robots.txt protège-t-il juridiquement contre le scraping non autorisé ?

Faut-il bloquer tous les crawlers IA ou laisser faire ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/07/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.