Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Faut-il adapter sa stratégie SEO pour les fonctionnalités IA de Google ?

- □ Les clics depuis AI Overviews convertissent-ils vraiment mieux ?

- □ Les AI Overviews favorisent-elles vraiment une plus grande diversité de sites ?

- □ Pourquoi Google insiste-t-il autant sur la « valeur unique » du contenu ?

- □ Les recommandations Search Console sur Core Web Vitals vont-elles enfin servir à quelque chose ?

- □ Le fichier robots.txt reste-t-il vraiment utile pour contrôler le crawl des IA ?

- □ L'analyse des logs est-elle vraiment la compétence SEO qui survivra à tout ?

- □ Faut-il arrêter de parler de SEO et adopter les nouveaux termes AIO, GEO ou optimisation pour LLM ?

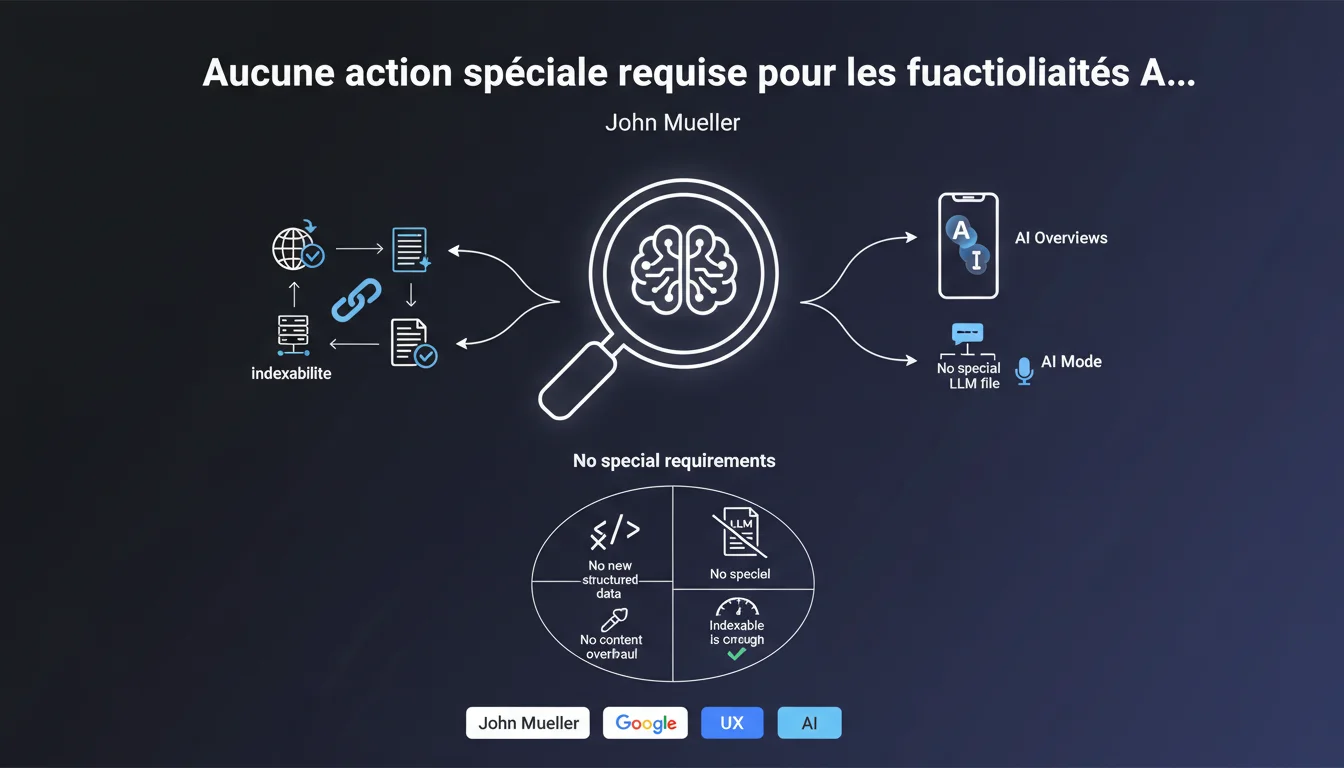

Google affirme qu'aucune optimisation spécifique n'est requise pour apparaître dans ses fonctionnalités IA comme AI Overviews ou AI Mode. Il suffit que le site soit indexable — pas de données structurées supplémentaires, pas de fichiers dédiés aux LLM, pas de refonte éditoriale. L'indexation classique reste le seul prérequis.

Ce qu'il faut comprendre

Que dit exactement Google sur les prérequis pour ses fonctionnalités IA ?

La position de John Mueller est limpide : un site indexable dispose déjà de tout ce qu'il faut pour être éligible aux fonctionnalités IA de Google. Pas de markup Schema.org exotique à implémenter, pas de fichier robots.txt spécial pour les crawlers IA, rien.

Cette déclaration intervient dans un contexte où de nombreux éditeurs et SEO se demandent s'il faut « optimiser pour l'IA » — reformuler les contenus, structurer différemment l'information, ajouter des couches de données. Google coupe court : l'indexabilité standard suffit.

Pourquoi cette clarification maintenant ?

Parce que l'industrie SEO a tendance à sur-réagir. Chaque nouvelle fonctionnalité de Google génère son lot de « best practices » autoproclamées, souvent sans fondement. Ici, Mueller recadre : les mécanismes d'indexation existants alimentent déjà les systèmes IA.

Concrètement ? Si Googlebot peut accéder à vos pages, les analyser et les comprendre, vous êtes dans la course. Le moteur utilise les mêmes signaux pour les résultats classiques et pour nourrir ses modèles d'IA.

Quels sont les points essentiels à retenir ?

- Indexabilité = critère unique : aucun fichier spécial type « llm.txt » ou équivalent n'est nécessaire

- Pas de données structurées nouvelles : le Schema.org classique (si pertinent) reste suffisant, rien d'additionnel pour l'IA

- Pas de refonte éditoriale obligatoire : inutile de réécrire vos contenus « pour les LLM » — l'existant fait l'affaire si la qualité est au rendez-vous

- Les fondamentaux SEO restent prioritaires : crawlabilité, structure technique, qualité de contenu — rien de neuf sous le soleil

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. Sur le principe, c'est cohérent : Google n'a jamais introduit de « canal séparé » pour alimenter ses nouvelles features. AI Overviews piochent dans l'index classique, c'est documenté. Mais — et c'est là que ça coince — dire qu'il n'y a « rien à faire de spécial » occulte une réalité : certains contenus performent nettement mieux dans AI Overviews que d'autres.

Les observations montrent que les pages avec une structure claire (titres hiérarchisés, réponses concises, listes), un markup FAQ ou HowTo pertinent, et une autorité thématique affirmée ressortent plus souvent. Ce n'est pas « obligatoire » au sens strict, mais ignorer ces leviers, c'est se tirer une balle dans le pied. [A vérifier] : Google ne précise pas si certains signaux sont pondérés différemment pour l'IA vs les SERPs classiques.

Quelles nuances faut-il apporter à cette affirmation ?

Soyons honnêtes : « rien de spécial » ne veut pas dire « rien du tout ». L'indexabilité n'est qu'un point d'entrée. Une fois dans l'index, la compétition se joue sur la pertinence, l'autorité, la fraîcheur, la structure — exactement comme pour les résultats organiques.

La nuance essentielle ? Google ne dit pas que tous les sites indexables ont les mêmes chances d'apparaître dans AI Overviews. Il dit juste qu'ils sont éligibles. La différence est énorme. Un site techniquement indexable mais avec un contenu superficiel, une architecture bancale ou une faible autorité ne décollera jamais — IA ou pas.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si votre site bloque Googlebot (volontairement ou par erreur), si vos contenus clés sont en JavaScript mal rendu, si vous servez du contenu différent aux bots vs aux users — vous êtes hors-jeu. L'indexabilité n'est pas binaire : elle se mesure en degrés.

Et c'est là que la déclaration de Mueller, bien que techniquement exacte, devient trompeuse pour un site moyen. Un CMS mal configuré, un temps de chargement catastrophique, une architecture en silo hermétique — tout ça dégrade l'indexabilité de facto, même si Googlebot parvient à accéder aux pages. Résultat : éligible sur le papier, invisible en pratique.

Impact pratique et recommandations

Que faut-il faire concrètement pour maximiser ses chances ?

Arrêtez de chercher le « hack IA ». Concentrez-vous sur les fondamentaux techniques et éditoriaux. Assurez-vous que Googlebot crawle efficacement vos pages prioritaires, que le rendu JavaScript (si applicable) fonctionne, que vos contenus sont structurés logiquement avec des titres clairs.

Exploitez les données structurées pertinentes — FAQ, HowTo, Article, Product — mais uniquement si elles apportent une vraie valeur sémantique. Le markup bidon pour gonfler artificiellement la visibilité ne passe plus. Google l'a répété : la sur-optimisation est contre-productive.

Quelles erreurs éviter absolument ?

Ne créez pas de fichiers « spécial LLM » ou de sections dédiées « pour l'IA ». C'est du temps perdu, voire contre-productif si ça fragmente votre architecture. Ne reformulez pas vos contenus en mode « prompt engineering » — Google ne cherche pas des réponses formatées comme des sorties ChatGPT, il cherche de l'information fiable et bien structurée.

Autre piège classique : négliger la fraîcheur et la mise à jour. Un contenu indexable mais obsolète ne remontera jamais dans AI Overviews, qui privilégient les sources récentes et actualisées. Et c'est là que ça coince pour beaucoup de sites corporate : ils sont indexés, mais figés.

Comment vérifier que mon site est réellement prêt ?

- Audit de crawlabilité : Search Console, logs serveur, simulation Googlebot — zéro blocage involontaire

- Rendu JavaScript opérationnel : test avec l'outil d'inspection d'URL de Google, vérification du DOM rendu

- Structure de contenu : titres H1-H6 cohérents, paragraphes courts, listes et tableaux pour les données factuelles

- Données structurées validées : test Schema.org, markup pertinent (pas de spam), alignement avec le contenu visible

- Vitesse et Core Web Vitals : un site lent dégrade l'indexabilité de facto, même si Googlebot y accède

- Autorité thématique : backlinks de qualité, citations, mentions — l'IA privilégie les sources reconnues

- Fraîcheur éditoriale : contenus mis à jour régulièrement, dates de publication/modification claires

En résumé : l'indexabilité est nécessaire, mais loin d'être suffisante. Google ne demande aucune action « spéciale », mais cela ne dispense pas d'un travail de fond sur la qualité technique et éditoriale. Les sites qui excellent dans les SERPs classiques ont toutes les chances de briller dans AI Overviews — les autres resteront invisibles, même parfaitement indexés.

Ces optimisations croisées — technique, éditoriale, autorité — peuvent rapidement devenir complexes à orchestrer, surtout sur des sites de taille moyenne ou grande. Si vous constatez que votre site peine à émerger malgré une indexation correcte, un accompagnement par une agence SEO spécialisée peut vous aider à identifier les leviers prioritaires et à structurer un plan d'action cohérent, sans disperser vos ressources sur des tactiques inefficaces.

❓ Questions frequentes

Dois-je créer un fichier robots.txt spécial pour les crawlers IA de Google ?

Les données structurées Schema.org influencent-elles l'apparition dans AI Overviews ?

Faut-il réécrire mes contenus dans un format « question-réponse » pour l'IA ?

Mon site est indexé mais n'apparaît jamais dans AI Overviews, pourquoi ?

Google privilégie-t-il certains types de contenus pour ses fonctionnalités IA ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/07/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.