Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Faut-il optimiser son site différemment pour AI Overviews et AI Mode ?

- □ Faut-il adapter sa stratégie SEO pour les fonctionnalités IA de Google ?

- □ Les clics depuis AI Overviews convertissent-ils vraiment mieux ?

- □ Les AI Overviews favorisent-elles vraiment une plus grande diversité de sites ?

- □ Pourquoi Google insiste-t-il autant sur la « valeur unique » du contenu ?

- □ Les recommandations Search Console sur Core Web Vitals vont-elles enfin servir à quelque chose ?

- □ Le fichier robots.txt reste-t-il vraiment utile pour contrôler le crawl des IA ?

- □ Faut-il arrêter de parler de SEO et adopter les nouveaux termes AIO, GEO ou optimisation pour LLM ?

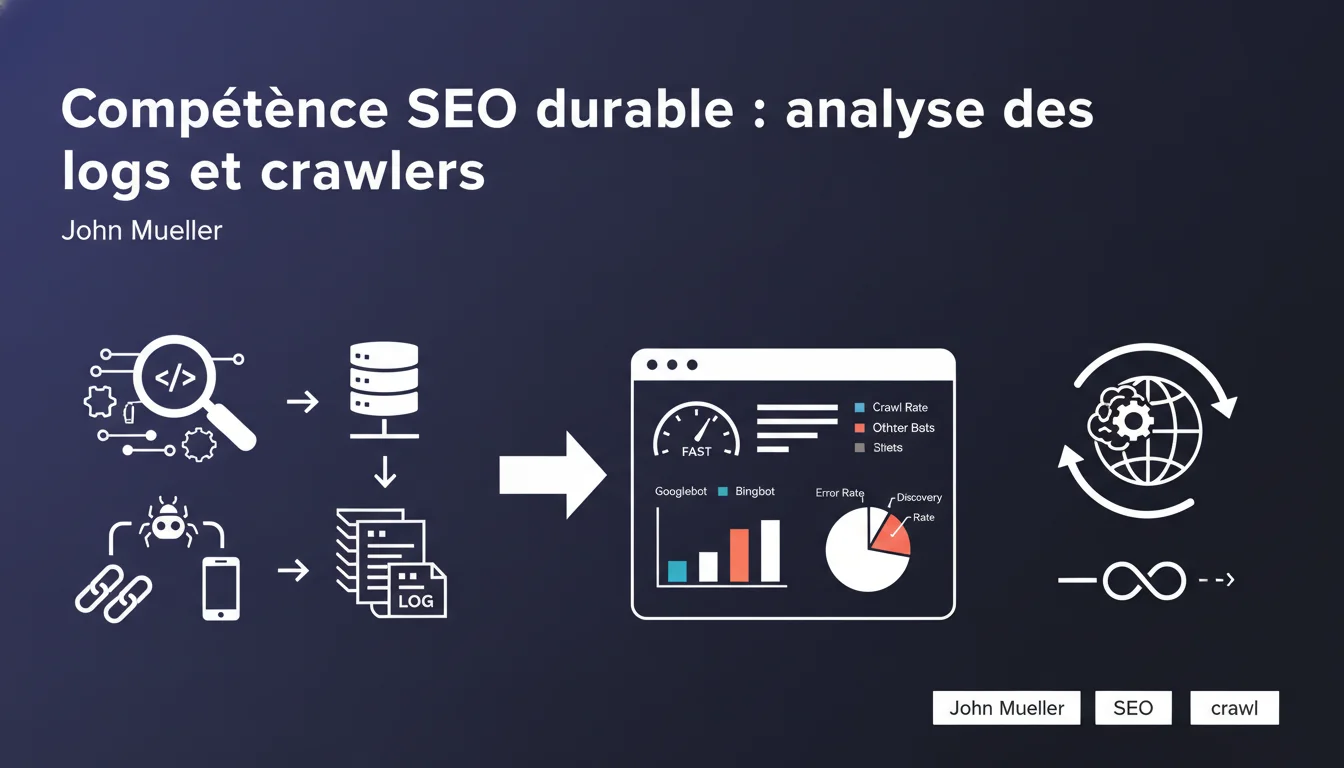

Mueller insiste sur l'analyse des fichiers logs comme compétence SEO intemporelle — comprendre comment les crawlers interagissent avec votre site restera crucial tant que le web existera. Cette déclaration repositionne l'analyse des logs au cœur de l'expertise technique SEO, loin des tendances passagères.

Ce qu'il faut comprendre

Pourquoi Mueller met-il l'analyse des logs au centre du jeu ?

La déclaration est claire : tant qu'il y aura des sites web, il y aura des crawlers. Et tant qu'il y aura des crawlers, comprendre leur comportement restera une compétence différenciante. Mueller ne parle pas ici de tactiques éphémères ou d'optimisations à la mode.

Il replace l'analyse des logs comme fondation technique durable. Contrairement aux signaux qui évoluent (PageRank, Core Web Vitals, IA générative), la logique crawler/serveur reste stable depuis des décennies. Maîtriser cette mécanique, c'est s'assurer une longueur d'avance structurelle.

Que révèle vraiment l'analyse des fichiers logs ?

Les logs serveur exposent les actions réelles des bots : fréquence de crawl, profondeur explorée, codes HTTP rencontrés, user-agents détectés. Rien de théorique — c'est la trace brute de ce qui s'est passé côté serveur.

Cette donnée permet d'identifier les incohérences entre ce que vous croyez que Googlebot fait et ce qu'il fait vraiment. Pages orphelines crawlées sans raison, sections entières ignorées, crawl budget gaspillé sur des URLs inutiles — tout ça devient visible.

En quoi cette compétence se distingue-t-elle des outils classiques ?

Search Console donne une vision agrégée et retardée. Les logs offrent une granularité à la seconde près, bot par bot, URL par URL. C'est la différence entre lire un résumé mensuel et consulter le journal de bord minute par minute.

Les outils tiers (Screaming Frog, Oncrawl, Botify) s'appuient justement sur cette donnée pour leurs analyses avancées. Mais savoir interroger directement les logs — sans intermédiaire — reste une compétence rare et puissante.

- Compétence durable : l'analyse des logs restera pertinente tant que le web existera

- Données brutes : accès direct aux actions réelles des crawlers, sans agrégation ni délai

- Visibilité fine : détection des anomalies invisibles dans Search Console ou Google Analytics

- Diagnostic précis : identification des gaspillages de crawl budget et des zones orphelines

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Totalement. Les sites qui maîtrisent l'analyse des logs ont un avantage concurrentiel mesurable — surtout sur les infrastructures complexes (sites multirégionaux, e-commerce à large catalogue, médias avec des milliers d'articles). Le crawl budget devient un facteur limitant dès que le volume dépasse quelques milliers de pages.

Mais soyons honnêtes : cette compétence reste marginale dans la profession. Beaucoup de SEO s'appuient uniquement sur Search Console et des crawlers tiers. Résultat ? Ils passent à côté de problèmes structurels invisibles ailleurs.

Quelles nuances faut-il apporter à cette affirmation ?

Mueller ne précise pas à partir de quel seuil l'analyse des logs devient réellement discriminante. Pour un site vitrine de 50 pages, l'investissement temps/compétence peut être disproportionné. L'impact se mesure vraiment sur des sites avec un volume conséquent ou des problématiques techniques spécifiques.

Autre nuance : l'analyse des logs nécessite un accès technique que tous les SEO n'ont pas. Certains hébergements mutualisés rendent la collecte complexe. Et l'exploitation brute des logs sans outillage adapté (Splunk, ELK, scripts Python) devient vite ingérable. [A vérifier] : est-ce une compétence accessible à tous les profils SEO ou réservée aux profils techniques avancés ?

Dans quels cas cette compétence ne suffit-elle pas ?

L'analyse des logs montre ce qui a été crawlé, pas pourquoi certaines pages ne rankent pas malgré un crawl régulier. Elle ne dit rien sur la qualité du contenu, la pertinence sémantique, ou la compétitivité des backlinks.

C'est une compétence diagnostique, pas une solution miracle. Si votre problème est un contenu faible ou une stratégie de liens inexistante, les logs ne révéleront qu'une partie du tableau. Et c'est là que ça coince : certains SEO surinvestissent dans l'analyse technique en négligeant le reste.

Impact pratique et recommandations

Que faut-il faire concrètement pour exploiter cette compétence ?

Première étape : configurer un accès aux logs serveur. Selon votre infrastructure (Apache, Nginx, hébergement cloud), la méthode varie. Certains hébergeurs proposent des exports automatisés, d'autres nécessitent une configuration SSH.

Ensuite, choisissez votre outil d'analyse. Les solutions vont du script Python maison (pour les profils techniques) aux plateformes dédiées comme Oncrawl, Botify, ou Screaming Frog Log Analyzer. L'investissement dépend du volume et de la complexité de votre site.

Quelles erreurs éviter dans l'interprétation des logs ?

Première erreur classique : confondre tous les bots Googlebot. Il existe plusieurs agents (Googlebot Desktop, Mobile, Image, News) avec des comportements distincts. Ne pas les séparer dans l'analyse fausse les conclusions.

Deuxième piège : ignorer les codes HTTP non-200. Un crawl intensif sur des 404 ou 301 révèle souvent un problème de maillage interne ou de redirections en chaîne. C'est un signal d'alerte, pas du bruit.

Troisième erreur : ne regarder que le volume total de crawl. La distribution du crawl compte autant — si 80% du budget va sur des URLs à faible valeur (facettes, pagination mal gérée), c'est là que se situe le problème.

Comment vérifier que votre crawl budget est optimisé ?

Comparez le volume de pages stratégiques crawlées versus le volume total de crawl. Si vos pages à forte valeur (produits phares, articles piliers) ne sont pas visitées régulièrement, il y a un souci structurel.

Examinez la fréquence de crawl par section. Une section mise à jour quotidiennement (actualités) devrait être crawlée plus souvent qu'une section statique (mentions légales). Si ce n'est pas le cas, votre architecture interne ne guide pas efficacement les crawlers.

- Mettre en place un accès régulier aux logs serveur (quotidien ou hebdomadaire selon le volume)

- Segmenter l'analyse par type de bot (Googlebot Desktop, Mobile, autres crawlers)

- Identifier les URLs crawlées à forte fréquence mais à faible valeur business

- Repérer les pages stratégiques sous-crawlées ou ignorées

- Analyser les codes HTTP pour détecter redirections inutiles ou erreurs récurrentes

- Corréler les pics de crawl avec vos modifications techniques ou de contenu

- Utiliser un outil d'analyse dédié si le volume dépasse plusieurs milliers de lignes de logs par jour

❓ Questions frequentes

L'analyse des logs est-elle utile pour tous les sites, quelle que soit leur taille ?

Quels outils gratuits permettent d'analyser les logs serveur ?

Comment différencier le vrai Googlebot d'un bot imitateur dans les logs ?

À quelle fréquence faut-il analyser les logs pour un suivi efficace ?

L'analyse des logs peut-elle remplacer Search Console pour le diagnostic SEO ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 01/07/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.