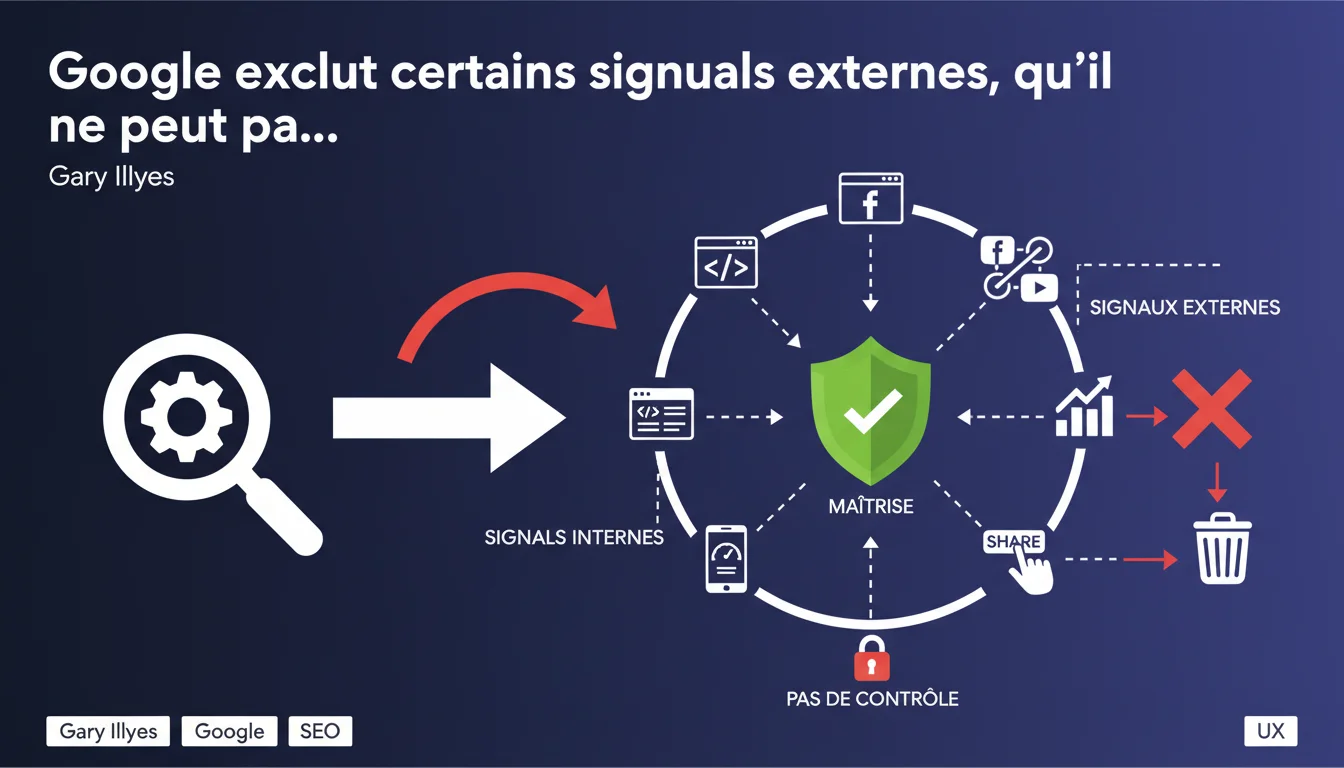

Le robots.txt suffit-il vraiment à contrôler le crawl de zones spécifiques de votre site ?

Gary Illyes

🎥 YouTube

01/11/2023

★★

En utilisant robots.txt, les éditeurs peuvent définir des contrôles sur le crawling ou le traitement de zones spécifiques de leur site web....