Declaration officielle

Ce qu'il faut comprendre

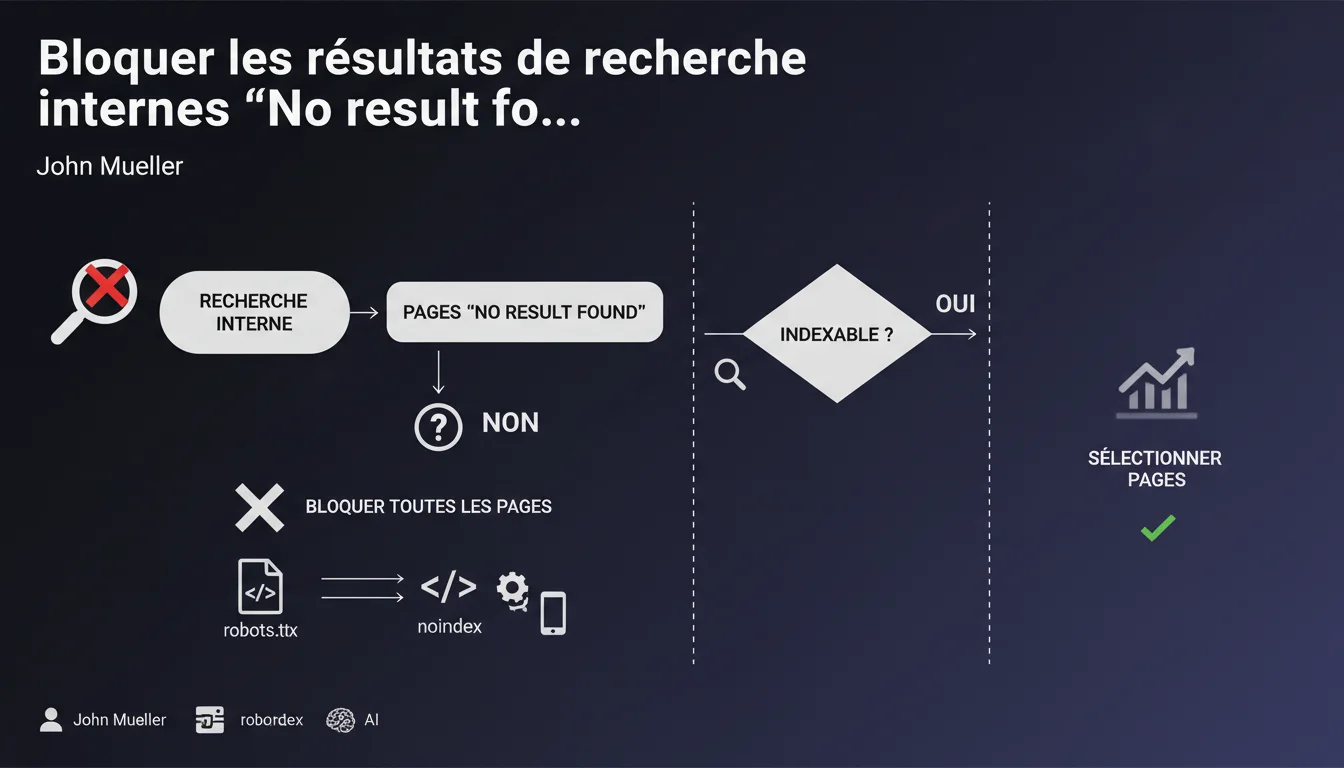

Les moteurs de recherche interne génèrent des pages de résultats qui peuvent être indexées par Google. Ces pages posent un problème majeur : elles créent du contenu dupliqué et des URLs peu pertinentes dans l'index.

Le cas le plus problématique concerne les pages "Aucun résultat trouvé". Ces pages n'apportent aucune valeur aux utilisateurs et consomment inutilement le budget crawl de votre site.

Google recommande explicitement de bloquer ces pages depuis 2007, soulignant que cette pratique reste d'actualité aujourd'hui. La recommandation est claire : si vous ne pouvez pas sélectionner finement quelles pages de recherche interne méritent l'indexation, il vaut mieux toutes les bloquer.

- Les pages de recherche interne diluent la qualité globale de votre indexation

- Les résultats vides représentent un gaspillage de ressources pour les robots

- Deux méthodes sont recommandées : robots.txt (disallow) ou meta robots (noindex)

- La directive s'applique particulièrement aux sites e-commerce et aux sites avec fonctionnalités de recherche avancée

Avis d'un expert SEO

Cette recommandation est parfaitement cohérente avec les bonnes pratiques SEO observées sur le terrain. Les sites qui indexent massivement leurs pages de recherche interne constatent généralement une dilution de leur autorité et une baisse de performance sur leurs pages stratégiques.

Cependant, il existe des exceptions notables. Certains sites comme Amazon ou eBay indexent volontairement certaines recherches populaires qui génèrent du trafic qualifié. La clé réside dans la capacité à discriminer les recherches à forte valeur ajoutée des requêtes génériques ou vides.

La méthode à privilégier dépend de votre architecture. Le robots.txt empêche le crawl mais pas nécessairement l'indexation si des liens externes pointent vers ces pages. La balise noindex garantit la désindexation mais nécessite que la page soit crawlée, ce qui peut poser problème avec un gros volume.

Impact pratique et recommandations

- Auditez vos pages de recherche interne actuellement indexées via Search Console (requête site:votredomaine.com/search ou équivalent)

- Identifiez les patterns d'URLs générées par votre moteur de recherche interne (paramètres ?q=, ?s=, /search/, etc.)

- Analysez si certaines recherches génèrent du trafic organique qualifié qui justifierait leur maintien en index

- Pour les sites avec peu de recherches indexées : implémentez une balise meta robots noindex sur toutes les pages de recherche

- Pour les gros volumes : bloquez le crawl via robots.txt avec une directive Disallow ciblant les URLs de recherche

- Configurez des règles spécifiques pour bloquer systématiquement les pages "0 résultat" si votre CMS le permet

- Vérifiez que votre fichier robots.txt n'empêche pas Google de voir les balises noindex (ne jamais bloquer une page avec noindex dans robots.txt)

- Surveillez l'évolution du nombre de pages indexées dans les semaines suivantes pour valider l'efficacité

- Ajoutez ces URLs dans votre sitemap.xml avec une balise <priority> basse si vous choisissez de garder certaines recherches indexables

💬 Commentaires (0)

Soyez le premier à commenter.