Official statement

Other statements from this video 25 ▾

- □ Does Google really experience delays in discovering JavaScript links?

- □ Why does Google ignore your canonical tags when the raw HTML contradicts the rendered output?

- □ Can you really modify title, meta, and links on the client side with JavaScript without risks?

- □ Is client-side JavaScript really holding back your SEO performance?

- □ Raw HTML vs Rendered: Does Google really not care?

- □ Does Google AdSense really penalize your site's speed like any other third-party script?

- □ Should you be worried about 'other error' issues with images in the Search Console?

- □ Should you prioritize user agent or viewport detection for your separate mobile versions?

- □ Do JavaScript navigation links really affect your site's SEO?

- □ Can you really lose control of your canonical by leaving the href attribute empty at load time?

- □ Does Google really use different crawlers for its SEO testing tools?

- □ Are the structured data from your mobile version also applicable to desktop?

- □ Should you really stop fearing JavaScript for SEO?

- □ Do JavaScript links really slow down Google's discovery process?

- □ How can a different canonical tag between raw HTML and rendered output destroy your canonicalization strategy?

- □ Can you really remove a noindex via JavaScript without risking de-indexation?

- □ Is it truly safe to modify meta tags and links with JavaScript without risking your SEO?

- □ Do Google products really get a hidden SEO advantage in search results?

- □ Should you be concerned about 'other' errors in the URL Inspection Tool?

- □ Does Google really overlook your images during web search rendering?

- □ User agent or viewport: Does Google really differentiate for mobile indexing?

- □ Do JavaScript-generated links truly pass ranking signals like traditional HTML links?

- □ Can an empty HTML canonical tag mistakenly force Google to auto-canonicalize your page?

- □ Can the Mobile-Friendly Test really substitute the URL Inspection Tool for auditing mobile crawling?

- □ Why does Google ignore your desktop structured data after switching to mobile-first indexing?

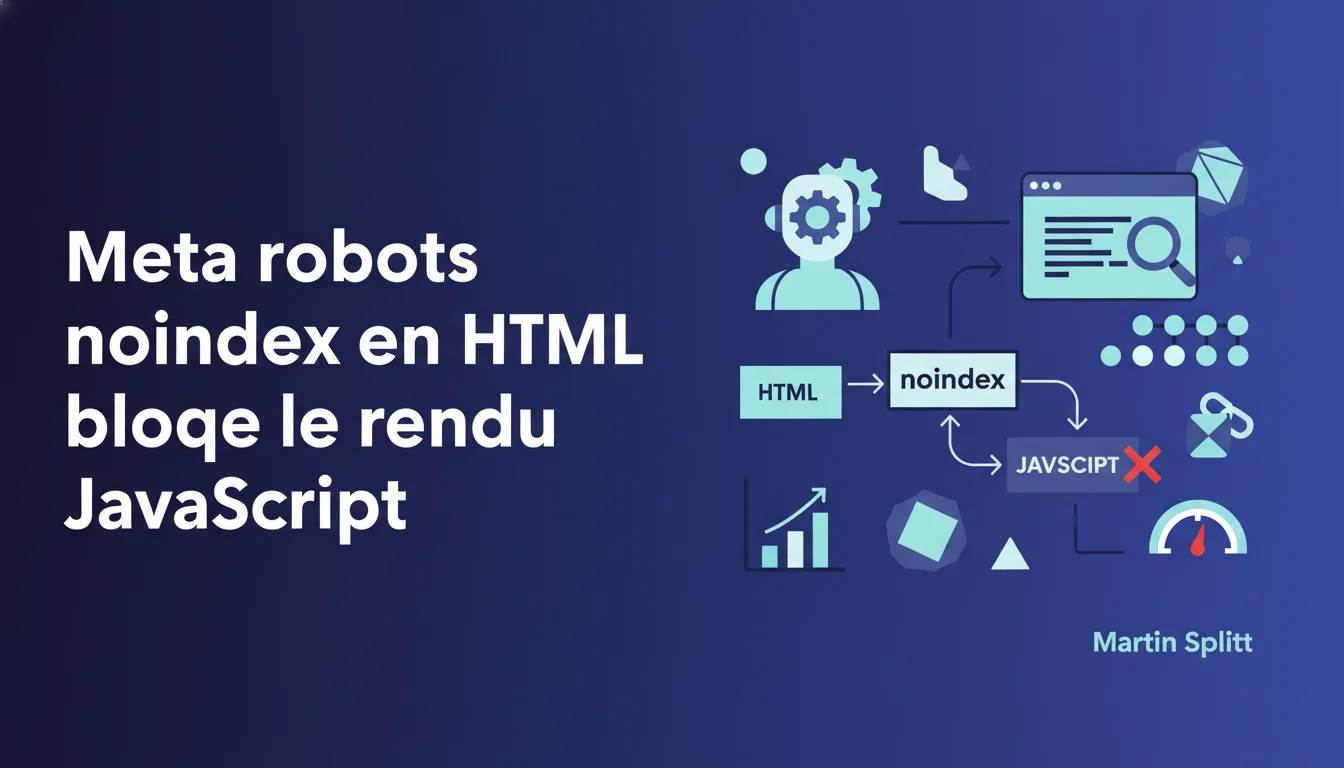

Google completely halts JavaScript rendering if the raw HTML contains a noindex meta robots tag. As a result, any removal of this directive via JavaScript remains invisible to Googlebot. The opposite works fine: adding a noindex via JavaScript after the initial load is detected. This asymmetry radically changes how you must manage indexing on JavaScript sites.

What you need to understand

Why does Google block JavaScript rendering when a noindex is present?

The logic is straightforward: Googlebot first analyzes the raw HTML before deciding whether to allocate resources for rendering JavaScript. If a <meta name="robots" content="noindex"> tag appears in this first layer, the bot assumes you don't want this page in the index.

Thus, it immediately respects your directive and skips the rendering step. It’s a logical crawl budget optimization: why consume CPU resources to render a page that the site itself is asking not to index?

What happens if JavaScript later removes the noindex?

That’s where it gets tricky. Your JavaScript code can perfectly remove or modify this tag in the DOM once the page is loaded. Problem: Google will never see it, since it has already abandoned the rendering process.

The raw HTML serves as a definitive checkpoint for this directive. Any further manipulation via JavaScript is off the table. This decision occurs even before the rendering engine is engaged.

Does the opposite really work smoothly?

Yes, and it represents a significant asymmetry. If your raw HTML is clean (without noindex), Googlebot proceeds with JavaScript rendering normally. At that moment, if your code injects a <meta name="robots" content="noindex"> tag into the DOM, Google detects and respects it.

This direction is consistent with the rendering pipeline: Google analyzes the initial HTML, runs the JavaScript engine, waits for the DOM to stabilize, and then inspects the final result. A noindex added at this stage is therefore fully operational.

- The raw HTML is the decisive checkpoint: a noindex present at this stage blocks any subsequent rendering

- Removing a noindex via JavaScript is invisible: the bot will never revisit its initial decision

- Adding a noindex in JavaScript works: rendering occurs, the DOM is inspected, the directive is applied

- This asymmetry impacts conditional indexing strategies: you must anticipate server-side logic, not just client-side logic

- Crawl budget is preserved: Google avoids wasting resources on pages explicitly excluded from the get-go

SEO Expert opinion

Is this statement consistent with field observations?

Absolutely. SEOs managing complex JavaScript architectures have already faced this behavior. Cases of pages with client-side conditional noindex are a classic: you want to exclude certain variations according to user criteria (geolocation, A/B testing, URL parameters), and you manage this in JavaScript.

However, if the raw HTML contains a default noindex while awaiting the script’s decision, Google stops there and indexes nothing. Conversely, sites that add noindex via React/Vue/Angular frameworks after the first paint see their directives respected, provided that the initial HTML is indexable.

What nuances should be added to this rule?

The main nuance concerns the timing of detection. Google does not precisely document when in the rendering cycle it checks for a noindex added via JavaScript. Observations suggest it waits for DOM stabilization (usually a few seconds after the load event), but there is no absolute guarantee of this timing.

Another point: this rule applies to meta robots noindex, not other exclusion methods. An X-Robots-Tag in HTTP headers takes priority over everything else, whether HTML or JavaScript. If you serve a X-Robots-Tag: noindex in the HTTP headers, even raw HTML without noindex will not be rendered. The hierarchy of directives remains: HTTP header > raw HTML > JavaScript.

In what situations does this rule pose concrete problems?

The typical scenario: Single Page Applications (SPAs) with complex state management. You have a React app that decides client-side whether a page should be indexed according to business parameters. If your HTML shell contains a

Practical impact and recommendations

Que faut-il vérifier immédiatement sur son site ?

Commencez par inspecter le HTML brut de vos pages indexables. Pas le DOM après JavaScript — le vrai code source tel que le serveur l'envoie. Un simple curl ou « Afficher le code source » dans le navigateur suffit. Cherchez toute balise <meta name="robots"> dans le <head>.

Si vous trouvez un content="noindex" sur des pages censées être indexées, vous avez un problème urgent. Vérifiez ensuite si votre JavaScript tente de manipuler cette balise : c'est un anti-pattern qui ne fonctionne pas avec Googlebot. Testez vos URLs dans Google Search Console via l'outil d'inspection d'URL — regardez le HTML rendu ET le HTML brut.

Comment restructurer une architecture problématique ?

La règle d'or : décidez de l'indexation côté serveur, pas côté client. Si vous avez besoin de logique conditionnelle (environnement de prod vs staging, variantes d'URL, critères métier), implémentez-la dans votre backend. Votre serveur doit servir un HTML propre sans noindex si la page est censée être indexable.

Pour les SPA, envisagez le Server-Side Rendering (SSR) ou la génération statique (SSG) pour le contenu critique. Next.js, Nuxt.js et leurs équivalents permettent de générer du HTML propre côté serveur avant même que JavaScript n'intervienne. Alternativement, utilisez les X-Robots-Tag en HTTP headers pour un contrôle plus fin et prioritaire.

Quelles erreurs critiques faut-il éviter absolument ?

Ne placez jamais un noindex « par défaut » dans votre template en espérant que JavaScript le retirera. C'est la configuration la plus dangereuse observée sur le terrain. Certaines équipes pensent sécuriser leur environnement de dev ainsi, mais elles oublient que Google ne voit que le premier état.

Évitez aussi les frameworks qui injectent automatiquement des meta tags via des plugins mal configurés. Auditez vos plugins et composants tiers — certains ajoutent du noindex dans le shell HTML pour des raisons obscures. Enfin, ne vous fiez pas uniquement aux outils de test JavaScript : testez toujours avec l'outil d'inspection Google Search Console, qui reflète le comportement réel de Googlebot.

- Inspecter le HTML brut (pas le DOM après JS) de toutes les pages stratégiques avec

curlou « Afficher le code source » - Supprimer tout noindex présent dans le HTML initial si la page doit être indexée — gérer la logique côté serveur

- Tester les URLs critiques dans Google Search Console avec l'outil d'inspection pour comparer HTML brut et HTML rendu

- Migrer les SPA vers SSR/SSG pour le contenu indexable ou utiliser les X-Robots-Tag HTTP pour un contrôle serveur

- Auditer les plugins et composants tiers qui pourraient injecter du noindex dans les templates HTML

- Documenter clairement dans votre équipe que JavaScript ne peut PAS retirer un noindex du HTML brut pour Googlebot

❓ Frequently Asked Questions

Google reviendra-t-il rendre une page si je retire le noindex du HTML brut ultérieurement ?

Un X-Robots-Tag en HTTP header est-il prioritaire sur l'absence de noindex en HTML brut ?

Puis-je utiliser JavaScript pour ajouter un noindex sur des pages dynamiques après le chargement ?

Comment tester si mon site est affecté par ce problème ?

Les frameworks JavaScript modernes comme Next.js ou Nuxt.js contournent-ils ce problème ?

🎥 From the same video 25

Other SEO insights extracted from this same Google Search Central video · published on 26/04/2021

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.