Declaration officielle

Autres déclarations de cette vidéo 25 ▾

- □ Les liens JavaScript retardent-ils vraiment la découverte par Google ?

- □ Pourquoi Google ignore-t-il vos balises canoniques quand le HTML brut contredit le rendu ?

- □ JavaScript et SEO : peut-on vraiment modifier title, meta et liens côté client sans risque ?

- □ Le JavaScript côté client est-il vraiment un frein pour vos performances SEO ?

- □ HTML brut vs rendu : Google s'en fiche-t-il vraiment ?

- □ Google AdSense pénalise-t-il vraiment la vitesse de votre site comme n'importe quel script tiers ?

- □ Faut-il s'inquiéter des erreurs 'other error' sur les images dans la Search Console ?

- □ User agent ou viewport : quelle détection privilégier pour vos versions mobiles séparées ?

- □ Les liens de navigation JavaScript affectent-ils vraiment le référencement de votre site ?

- □ Peut-on vraiment perdre le contrôle de sa canonical en laissant l'attribut href vide au chargement ?

- □ Quel crawler Google utilise vraiment ses outils de test SEO ?

- □ Les données structurées de votre version mobile s'appliquent-elles aussi au desktop ?

- □ Faut-il vraiment arrêter de craindre le JavaScript pour le SEO ?

- □ Les liens JavaScript retardent-ils vraiment la découverte par Google ?

- □ Pourquoi une balise canonical différente entre HTML brut et rendu peut-elle ruiner votre stratégie de canonicalisation ?

- □ Peut-on vraiment retirer un noindex via JavaScript sans risquer la désindexation ?

- □ Peut-on vraiment modifier les balises meta et les liens en JavaScript sans risque SEO ?

- □ Les produits Google bénéficient-ils d'un avantage SEO caché dans les résultats de recherche ?

- □ Faut-il s'inquiéter des erreurs 'other' dans l'outil d'inspection d'URL ?

- □ Google ignore-t-il vraiment vos images lors du rendu pour la recherche web ?

- □ User agent ou viewport : Google fait-il vraiment la différence pour l'indexation mobile ?

- □ Les liens générés en JavaScript transmettent-ils vraiment les signaux de ranking comme les liens HTML classiques ?

- □ Une balise canonical vide en HTML peut-elle forcer Google à auto-canonicaliser votre page par erreur ?

- □ Le Mobile-Friendly Test peut-il remplacer l'URL Inspection Tool pour auditer le crawl mobile ?

- □ Pourquoi Google ignore-t-il vos données structurées desktop après le mobile-first indexing ?

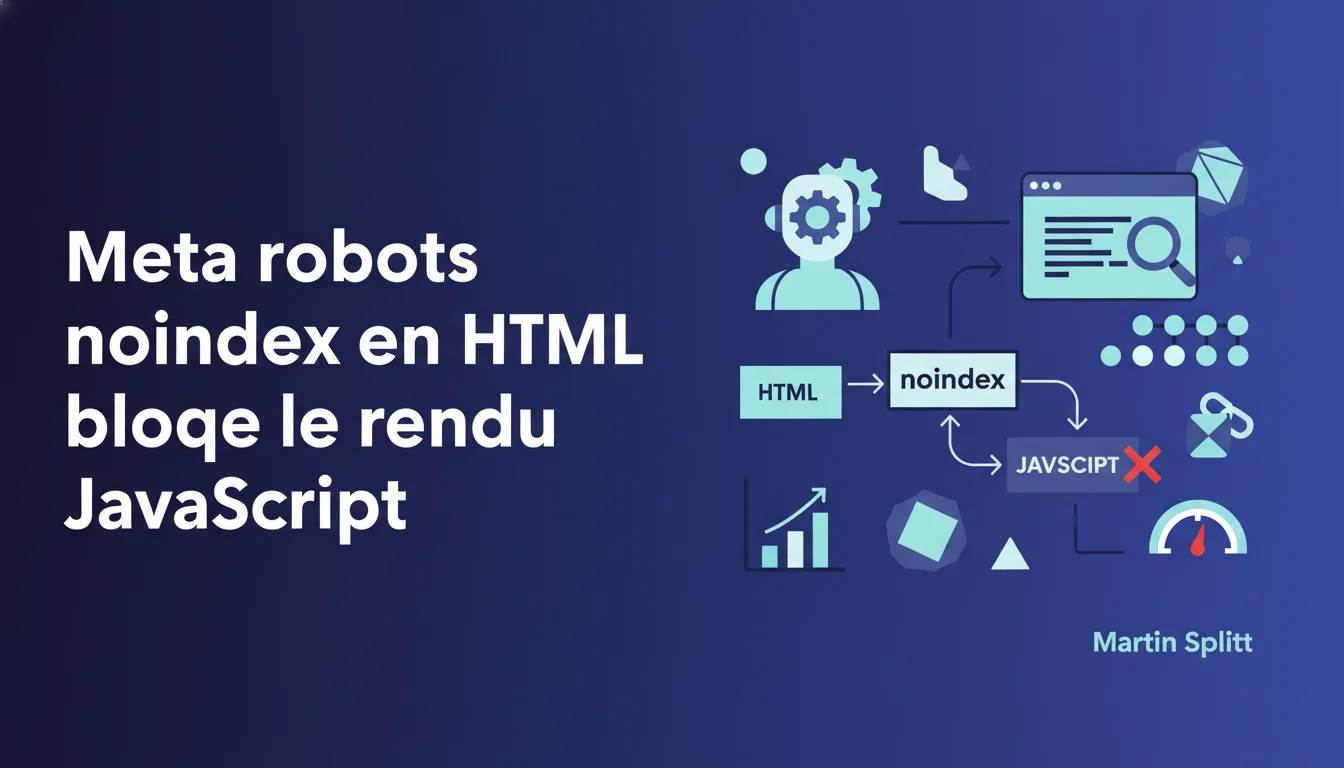

Google stoppe net le rendu JavaScript si le HTML brut contient une balise meta robots noindex. Résultat : toute suppression de cette directive via JavaScript reste invisible pour Googlebot. L'inverse fonctionne sans problème : ajouter un noindex en JavaScript après le chargement initial est bien détecté. Cette asymétrie change radicalement la façon dont vous devez gérer l'indexation sur les sites en JavaScript.

Ce qu'il faut comprendre

Pourquoi Google bloque-t-il le rendu JavaScript en présence d'un noindex ?

La logique est implacable : Googlebot analyse d'abord le HTML brut avant de décider s'il doit allouer des ressources au rendu JavaScript. Si une balise <meta name="robots" content="noindex"> apparaît dans cette première couche, le bot considère que vous ne voulez pas de cette page dans l'index.

Il respecte donc immédiatement votre directive et saute toute l'étape de rendu. C'est une optimisation de crawl budget logique : pourquoi consommer des ressources CPU pour rendre une page que le site lui-même demande de ne pas indexer ?

Que se passe-t-il si JavaScript retire ensuite le noindex ?

C'est là que ça coince. Votre code JavaScript peut parfaitement supprimer ou modifier cette balise dans le DOM une fois la page chargée. Problème : Google ne le verra jamais, puisqu'il a déjà abandonné le processus de rendu.

Le HTML brut fait office de point de contrôle définitif pour cette directive. Toute manipulation ultérieure via JavaScript est hors circuit. Cette décision intervient avant même que le moteur de rendu ne soit sollicité.

L'inverse fonctionne-t-il vraiment sans friction ?

Oui, et c'est une asymétrie importante. Si votre HTML brut est propre (sans noindex), Googlebot procède au rendu JavaScript normalement. À ce moment-là, si votre code injecte une balise <meta name="robots" content="noindex"> dans le DOM, Google la détecte et la respecte.

Cette direction est cohérente avec le pipeline de rendu : Google analyse le HTML initial, lance le moteur JavaScript, attend la stabilisation du DOM, puis inspecte le résultat final. Un noindex ajouté à cette étape est donc pleinement opérationnel.

- Le HTML brut est le point de contrôle décisif : un noindex présent dès cette étape bloque tout rendu ultérieur

- La suppression d'un noindex via JavaScript est invisible : le bot ne reviendra jamais sur sa décision initiale

- L'ajout d'un noindex en JavaScript fonctionne : le rendu a lieu, le DOM est inspecté, la directive est appliquée

- Cette asymétrie impacte les stratégies d'indexation conditionnelle : vous devez anticiper la logique serveur, pas uniquement la logique client

- Le crawl budget est préservé : Google évite de gaspiller des ressources sur des pages explicitement exclues dès le départ

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Parfaitement. Les SEO qui gèrent des architectures JavaScript complexes ont déjà buté sur ce comportement. Les cas de pages avec noindex conditionnel côté client sont un classique : vous voulez exclure certaines variantes selon des critères utilisateur (géolocalisation, A/B test, paramètres d'URL), et vous le gérez en JavaScript.

Sauf que si le HTML brut contient un noindex par défaut en attendant que le script décide, Google s'arrête là et n'indexe rien. À l'inverse, les sites qui ajoutent du noindex via des frameworks React/Vue/Angular après le premier paint voient bien leurs directives respectées, à condition que le HTML initial soit indexable.

Quelles nuances faut-il apporter à cette règle ?

La nuance principale concerne le timing de détection. Google ne documente pas précisément à quel moment du cycle de rendu il vérifie la présence du noindex ajouté via JavaScript. Les observations suggèrent qu'il attend une stabilisation du DOM (généralement quelques secondes après l'événement load), mais il n'existe pas de garantie absolue sur ce délai.

Autre point : cette règle s'applique à meta robots noindex, pas aux autres méthodes d'exclusion. Un X-Robots-Tag en HTTP header reste prioritaire sur tout le reste, HTML ou JavaScript. Si vous servez un X-Robots-Tag: noindex dans les headers HTTP, même un HTML brut sans noindex ne sera pas rendu. La hiérarchie des directives reste : HTTP header > HTML brut > JavaScript.

Dans quels cas cette règle pose-t-elle problème concrètement ?

Le scénario typique : les Single Page Applications (SPA) avec gestion d'état complexe. Vous avez une app React qui décide côté client si une page doit être indexée selon des paramètres métier. Si votre shell HTML contient un noindex « de sécurité » en attendant que l'app décide, vous venez de bloquer toute indexation.

Autre cas fréquent : les systèmes de preview ou de staging qui injectent un noindex par défaut dans le template serveur, puis tentent de le retirer via JavaScript si l'environnement est production. Stratégie risquée : une erreur de configuration côté client et toutes vos pages restent en noindex. [À vérifier] : Google pourrait-il ré-évaluer cette décision lors d'un recrawl ultérieur si le HTML brut change ? La documentation ne le précise pas, mais les observations suggèrent que non — il faudrait forcer un nouveau crawl explicitement.

Impact pratique et recommandations

Que faut-il vérifier immédiatement sur son site ?

Commencez par inspecter le HTML brut de vos pages indexables. Pas le DOM après JavaScript — le vrai code source tel que le serveur l'envoie. Un simple curl ou « Afficher le code source » dans le navigateur suffit. Cherchez toute balise <meta name="robots"> dans le <head>.

Si vous trouvez un content="noindex" sur des pages censées être indexées, vous avez un problème urgent. Vérifiez ensuite si votre JavaScript tente de manipuler cette balise : c'est un anti-pattern qui ne fonctionne pas avec Googlebot. Testez vos URLs dans Google Search Console via l'outil d'inspection d'URL — regardez le HTML rendu ET le HTML brut.

Comment restructurer une architecture problématique ?

La règle d'or : décidez de l'indexation côté serveur, pas côté client. Si vous avez besoin de logique conditionnelle (environnement de prod vs staging, variantes d'URL, critères métier), implémentez-la dans votre backend. Votre serveur doit servir un HTML propre sans noindex si la page est censée être indexable.

Pour les SPA, envisagez le Server-Side Rendering (SSR) ou la génération statique (SSG) pour le contenu critique. Next.js, Nuxt.js et leurs équivalents permettent de générer du HTML propre côté serveur avant même que JavaScript n'intervienne. Alternativement, utilisez les X-Robots-Tag en HTTP headers pour un contrôle plus fin et prioritaire.

Quelles erreurs critiques faut-il éviter absolument ?

Ne placez jamais un noindex « par défaut » dans votre template en espérant que JavaScript le retirera. C'est la configuration la plus dangereuse observée sur le terrain. Certaines équipes pensent sécuriser leur environnement de dev ainsi, mais elles oublient que Google ne voit que le premier état.

Évitez aussi les frameworks qui injectent automatiquement des meta tags via des plugins mal configurés. Auditez vos plugins et composants tiers — certains ajoutent du noindex dans le shell HTML pour des raisons obscures. Enfin, ne vous fiez pas uniquement aux outils de test JavaScript : testez toujours avec l'outil d'inspection Google Search Console, qui reflète le comportement réel de Googlebot.

- Inspecter le HTML brut (pas le DOM après JS) de toutes les pages stratégiques avec

curlou « Afficher le code source » - Supprimer tout noindex présent dans le HTML initial si la page doit être indexée — gérer la logique côté serveur

- Tester les URLs critiques dans Google Search Console avec l'outil d'inspection pour comparer HTML brut et HTML rendu

- Migrer les SPA vers SSR/SSG pour le contenu indexable ou utiliser les X-Robots-Tag HTTP pour un contrôle serveur

- Auditer les plugins et composants tiers qui pourraient injecter du noindex dans les templates HTML

- Documenter clairement dans votre équipe que JavaScript ne peut PAS retirer un noindex du HTML brut pour Googlebot

❓ Questions frequentes

Google reviendra-t-il rendre une page si je retire le noindex du HTML brut ultérieurement ?

Un X-Robots-Tag en HTTP header est-il prioritaire sur l'absence de noindex en HTML brut ?

Puis-je utiliser JavaScript pour ajouter un noindex sur des pages dynamiques après le chargement ?

Comment tester si mon site est affecté par ce problème ?

Les frameworks JavaScript modernes comme Next.js ou Nuxt.js contournent-ils ce problème ?

🎥 De la même vidéo 25

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/04/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.