Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Peut-on vraiment utiliser un sous-répertoire unique pour gérer plusieurs marchés internationaux avec hreflang ?

- □ Pourquoi Google n'indexe-t-il pas toutes les URLs de votre site ?

- □ Peut-on utiliser des avis tiers pour les résultats enrichis produits ?

- □ Comment savoir si Google vous pénalise vraiment ?

- □ Faut-il abandonner les URI de thésaurus NALT pour optimiser son référencement ?

- □ Pourquoi les erreurs robots.txt unreachable sont-elles toujours de votre faute ?

- □ Faut-il vraiment rediriger vos 404 vers la homepage ?

- □ Faut-il vraiment maintenir les redirections lors d'une migration de domaine ?

- □ Faut-il s'inquiéter de millions d'URLs non indexées sur son site ?

- □ Faut-il vraiment éviter le cloaking de codes HTTP entre Googlebot et utilisateurs ?

- □ Google traite-t-il vraiment les redirections 308 et 301 de la même manière ?

- □ WiFi vs Wi-Fi : Google fait-il vraiment la différence pour le référencement ?

- □ Un nombre d'avis à zéro pénalise-t-il le référencement d'une page produit ?

- □ Pourquoi certains sites migrés apparaissent-ils dans Google en quelques minutes et d'autres mettent des mois ?

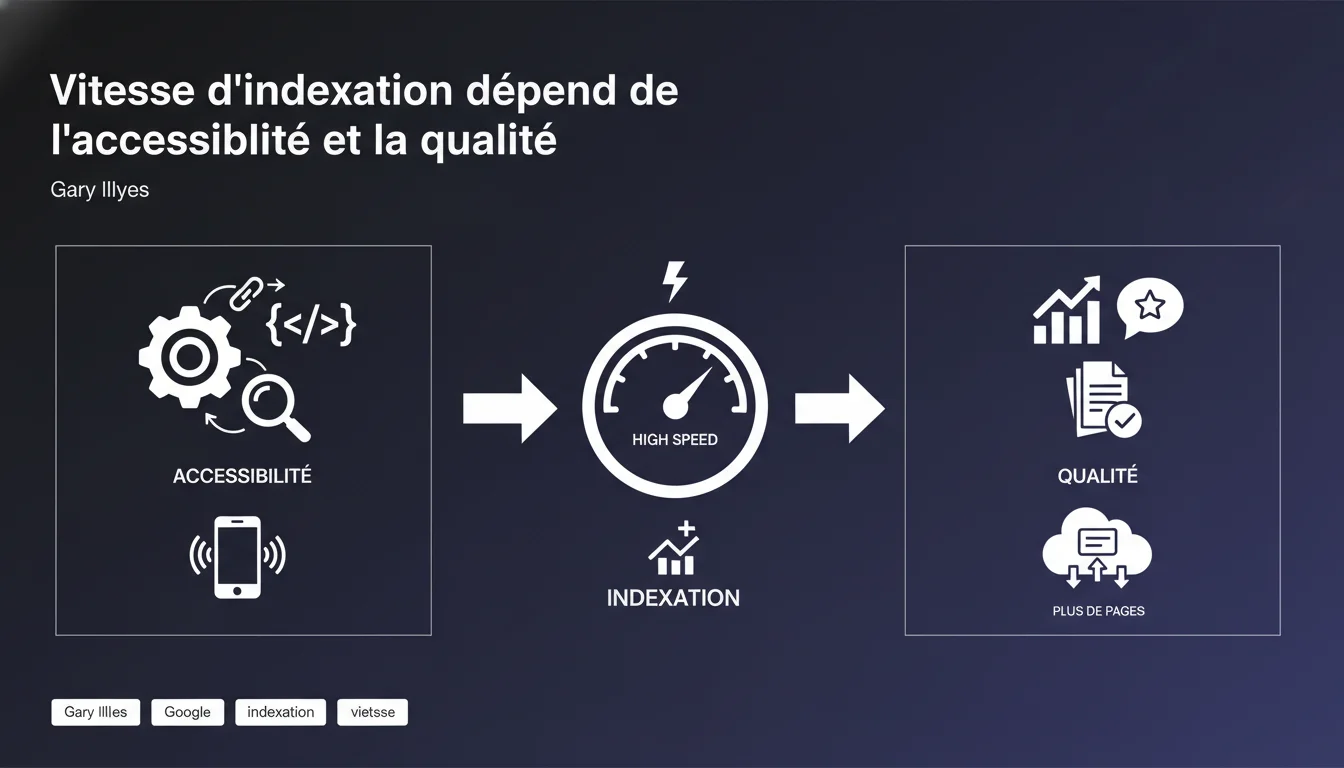

Google affirme que la vitesse et la quantité de pages indexées dépendent directement de deux facteurs : l'accessibilité technique du site pour Googlebot et la qualité du contenu. Plus la qualité est élevée, plus Google indexe de pages rapidement. Cela remet en perspective le débat sur le crawl budget et confirme que la qualité n'est pas qu'un critère de classement.

Ce qu'il faut comprendre

Quel lien Google établit-il entre qualité et indexation ?

La déclaration de Gary Illyes introduit une notion souvent négligée : la qualité du contenu ne sert pas uniquement au ranking, elle conditionne aussi l'indexation elle-même. Autrement dit, un site bourré de pages médiocres ou dupliquées verra Google ralentir volontairement son crawl et limiter le nombre de pages indexées.

Cette logique s'inscrit dans une gestion optimisée des ressources de crawl. Google ne veut pas gaspiller du temps serveur sur du contenu sans valeur. L'accessibilité technique reste un prérequis — fichier robots.txt correct, sitemap propre, temps de réponse serveur acceptable — mais ne suffit plus si le contenu derrière est faible.

Qu'entend Google par « qualité » dans ce contexte ?

Google reste volontairement flou, mais on peut déduire que la qualité combine plusieurs signaux : pertinence thématique, unicité du contenu, profondeur de traitement, engagement utilisateur potentiel. Ce n'est pas juste une question d'absence de duplicate ou de bourrage de mots-clés.

Concrètement, une page qui apporte une réponse complète à une intention de recherche aura plus de chances d'être indexée rapidement qu'une page fine générée automatiquement. La différence se joue aussi sur la cohérence éditoriale du site dans son ensemble — un site avec 80% de contenu solide sera mieux traité qu'un site avec 20% de bon contenu noyé dans du remplissage.

L'accessibilité technique suffit-elle sans qualité ?

Non, et c'est là que la déclaration bouscule certaines idées reçues. Vous pouvez avoir un serveur ultra-rapide, un sitemap XML impeccable, un maillage interne parfait — si vos pages sont médiocres, Google choisira d'en indexer moins et moins vite.

Cette approche s'oppose à la vision purement technique du SEO où l'on pensait qu'optimiser le crawl suffisait. Désormais, il faut penser indexation en deux temps : d'abord lever les blocages techniques, ensuite prouver que le contenu mérite d'être crawlé fréquemment.

- L'accessibilité technique (robots.txt, sitemap, performance serveur) est une condition nécessaire mais non suffisante

- La qualité du contenu détermine la vitesse et le volume d'indexation

- Google alloue son crawl budget en fonction de la valeur perçue du site

- Un site avec beaucoup de contenu faible sera pénalisé en termes de fréquence de crawl

- L'indexation n'est plus un acquis — elle se mérite par la qualité éditoriale

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et elle confirme ce que beaucoup de SEO observent depuis plusieurs mois. Les sites qui ont nettoyé leurs pages zombies ou supprimé du contenu automatisé de mauvaise qualité voient souvent une amélioration de la fréquence de crawl sur leurs pages stratégiques. Google redistribue le budget vers ce qui compte vraiment.

En revanche, la notion de « qualité élevée » reste floue. [À vérifier] : Google ne fournit aucun seuil, aucun indicateur concret pour mesurer si notre contenu atteint ce niveau. On navigue à vue, en croisant les signaux indirects — taux de clic, temps de session, taux de rebond — sans certitude absolue.

Quelles nuances faut-il apporter à cette affirmation ?

Première nuance : la taille du site joue un rôle. Un site de 50 pages de haute qualité sera intégralement indexé rapidement, mais un site de 500 000 pages — même avec 60% de contenu solide — devra composer avec des contraintes de crawl budget. Google ne peut pas tout crawler en même temps, même si tout est bon.

Deuxième nuance : certains secteurs génèrent naturellement beaucoup de pages (e-commerce, petites annonces, immobilier). Pour eux, maintenir une « qualité élevée » sur chaque page relève parfois de l'impossible. La réalité, c'est qu'on doit prioriser — et accepter que certaines pages ne seront jamais indexées ou mises à jour rarement.

Dans quels cas cette règle ne s'applique-t-elle pas pleinement ?

Les sites d'actualité bénéficient souvent d'un traitement spécial. Même si la qualité éditoriale varie, Google indexe rapidement les nouveaux articles pour alimenter Google News et les résultats temps réel. La fraîcheur compense en partie la qualité dans ce contexte.

Autre exception : les sites avec une très forte autorité de domaine. Un site établi depuis des années, avec un profil de liens solide, verra ses nouvelles pages indexées plus vite qu'un site récent, même si la qualité du contenu est comparable. L'historique et la confiance jouent un rôle d'accélérateur.

Impact pratique et recommandations

Que faut-il faire concrètement pour améliorer la vitesse d'indexation ?

D'abord, auditer impitoyablement le contenu existant. Identifie les pages qui génèrent zéro trafic organique depuis 6 mois, celles avec un taux de rebond supérieur à 90%, celles créées automatiquement sans valeur ajoutée. Ensuite, décide : amélioration substantielle, fusion avec une autre page, ou suppression pure et simple avec redirection 301 si nécessaire.

Parallèlement, assure-toi que l'accessibilité technique est irréprochable. Vérifie que le sitemap ne liste que des pages indexables (pas de noindex, pas de canonicales vers d'autres URLs). Contrôle les temps de réponse serveur — vise moins de 200 ms. Élimine les chaînes de redirections et les erreurs 4xx/5xx.

Quelles erreurs éviter absolument ?

Erreur classique : publier massivement du contenu médiocre en espérant qu'une partie sera indexée. Cette stratégie volume fonctionne de moins en moins. Google ajuste son crawl à la baisse quand il détecte un ratio qualité/quantité défavorable.

Autre piège : croire qu'une page techniquement parfaite sera forcément indexée vite. Si elle traite un sujet déjà couvert par 50 autres pages du même site sans apporter de différenciation, Google la mettra en file d'attente basse priorité. La cannibalisation interne ralentit l'indexation.

Comment vérifier que mon site bénéficie d'un crawl optimal ?

Consulte régulièrement le rapport d'exploration dans Google Search Console. Regarde l'évolution du nombre de requêtes par jour — une hausse progressive signale que Google augmente sa confiance. Compare le nombre de pages soumises via sitemap et le nombre effectivement indexé.

Utilise aussi les logs serveur pour analyser la profondeur de crawl. Si Googlebot ne visite que les 3 premiers niveaux de navigation, c'est un signal d'alerte. Soit ton maillage interne est insuffisant, soit Google estime que les pages profondes ne méritent pas sa visite.

- Supprimer ou améliorer les pages sans trafic organique depuis 6+ mois

- Vérifier que le sitemap XML ne liste que des pages indexables (HTTP 200, sans noindex)

- Réduire le temps de réponse serveur en dessous de 200 ms

- Éliminer les chaînes de redirections et les erreurs 4xx/5xx

- Éviter la cannibalisation : une intention de recherche = une page de référence

- Analyser les logs serveur pour mesurer la profondeur de crawl effective

- Suivre l'évolution du nombre de requêtes Googlebot dans Search Console

- Prioriser la publication de contenu à forte valeur ajoutée plutôt que le volume

❓ Questions frequentes

Un sitemap XML garantit-il une indexation rapide ?

Faut-il supprimer les pages peu visitées pour améliorer le crawl budget ?

Comment Google mesure-t-il la qualité d'une page avant de l'indexer ?

Un site récent peut-il être indexé aussi vite qu'un site établi ?

L'utilisation d'un CDN ou d'un serveur plus rapide améliore-t-elle l'indexation ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/04/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.